kintone×BigQuery連携でデータ活用を最大化!データドリブン経営を推進する分析基盤構築ガイド

kintoneとBigQueryを連携し、散在するビジネスデータを統合・分析。データドリブン経営を加速させる実践的な分析基盤の構築方法と運用ノウハウを、企業の決裁者・担当者向けに解説します。

目次 クリックで開く

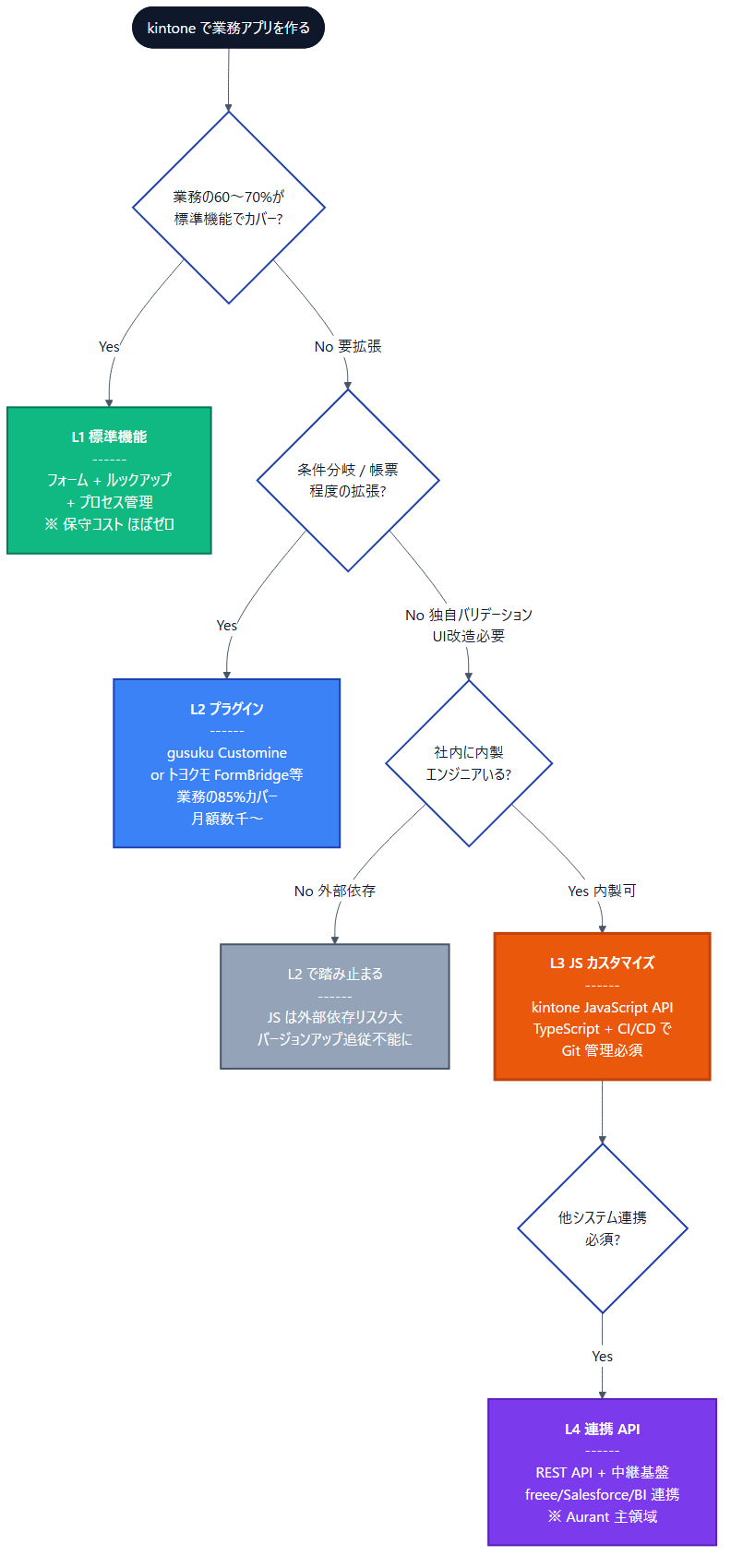

kintone(キントーン)は、プログラミングの知識がなくても現場主導で業務アプリを迅速に構築できる、日本発の強力なノーコード・ローコードプラットフォームです。その柔軟性ゆえに、営業管理、顧客サポート、プロジェクト管理、経理・総務などのあらゆる業務データがkintone上に集約される傾向にあります。

しかし、導入が成功し、ビジネスが成長して蓄積されるデータ量が数十万、数百万レコードを超えてくると、現場や経営層から「複数のアプリをまたいだ複雑なクロス集計を行いたい」「過去5年分の推移をミリ秒単位で可視化したい」「GA4や広告データと紐づけてLTV(顧客生涯価値)を算出したい」といった高度なデータ活用のニーズが噴出します。

kintoneは、現場での「データ入力」や「プロセス管理(ワークフロー)」において極めて高いパフォーマンスを発揮しますが、膨大なデータの「多次元分析」や「大規模集計」に特化した設計にはなっていません。こうした構造的な限界を突破し、真のデータドリブン経営へ舵を切るためのスタンダードな解決策が、Google Cloudが提供する超高速データウェアハウス(DWH)である「BigQuery」へのデータ統合です。

本稿では、B2B実務者が直面する「kintoneの壁」を詳細に分析した上で、BigQueryへデータを安全かつ効率的にパイプライン化するための10ステップ、サブテーブル(明細行)のSQL処理、運用フェーズで必ず発生する「異常系」への対処法まで、15,000文字規模の情報密度で徹底的に解説します。

1. なぜkintone単体でのデータ分析には「限界」があるのか

kintoneを使いこなしている企業ほど、標準機能のグラフや「関連レコード一覧」で十分ではないかと感じることがあります。しかし、企業の意思決定を支える「エンタープライズ級のデータ分析」を構築する場合、kintone単体では回避不可能な「3つの技術的障壁」が立ちはだかります。

1-1. APIリミット:データ連携の「交通量制限」

kintoneはマルチテナント方式のSaaSであるため、特定のユーザーがリソースを占有しないよう、厳格なAPIリクエスト制限を設けています。

- 1アプリあたりのリクエスト制限:1日あたり10,000リクエストまで。

- 同時接続数の制限:1ドメインあたり同時10リクエストまで。

データ分析のために全件データを頻繁に外部へ排出しようとすると、この制限に容易に抵触します。制限を超過した場合、連携が停止するだけでなく、他のプラグインや外部サービス連携を含めたドメイン全体の動作に支障をきたすリスクがあります。[1]

1-2. データ構造の制約:SQLが使えないジレンマ

kintoneのデータは、いわゆる「NoSQL(ドキュメント指向)」に近い構造で管理されており、従来のデータベース(RDB)のような正規化されたテーブル構造とは異なります。ビジネス分析で不可欠な「売上アプリと顧客属性アプリ、さらに外部の会計ソフトを結合(JOIN)して集計する」といった複雑な関係演算を、kintone内の標準機能だけで完結させることは困難です。

1-3. パフォーマンス:レコード数増加に伴うレスポンスの指数関数的低下

kintoneの1アプリあたりの推奨レコード数は、一般的に数十万件程度とされています。百万件を超える規模で複雑な絞り込みや集計を実行しようとすると、画面のレンダリング速度が低下し、実務に耐えられなくなるケースが散見されます。一方、BigQueryはペタバイト級のデータに対しても数秒で結果を返す「列指向ストレージ」を採用しており、処理思想そのものが異なります。

2. BigQueryをデータ基盤に選定する技術的な優位性

Google Cloudが提供するBigQueryは、現代の「モダンデータスタック」において不動の中心的な役割を果たしています。kintoneのデータをBigQueryに集約することで、単なる「可視化」を超えた価値が生まれます。

2-1. カラムナ(列指向)処理による圧倒的計算スピード

従来の行指向データベース(MySQLやPostgreSQL等)は、1件のデータを取得するためにその行の全情報を読み込みますが、BigQueryは必要な「列(カラム)」のみをスキャンします。例えば、「1,000万件の商談データから合計売上だけを算出する」場合、売上以外の列は完全に無視して計算するため、計算リソースを劇的に節約し、高速な応答を実現します。

2-2. 低コストかつスケーラブルなサーバーレス環境

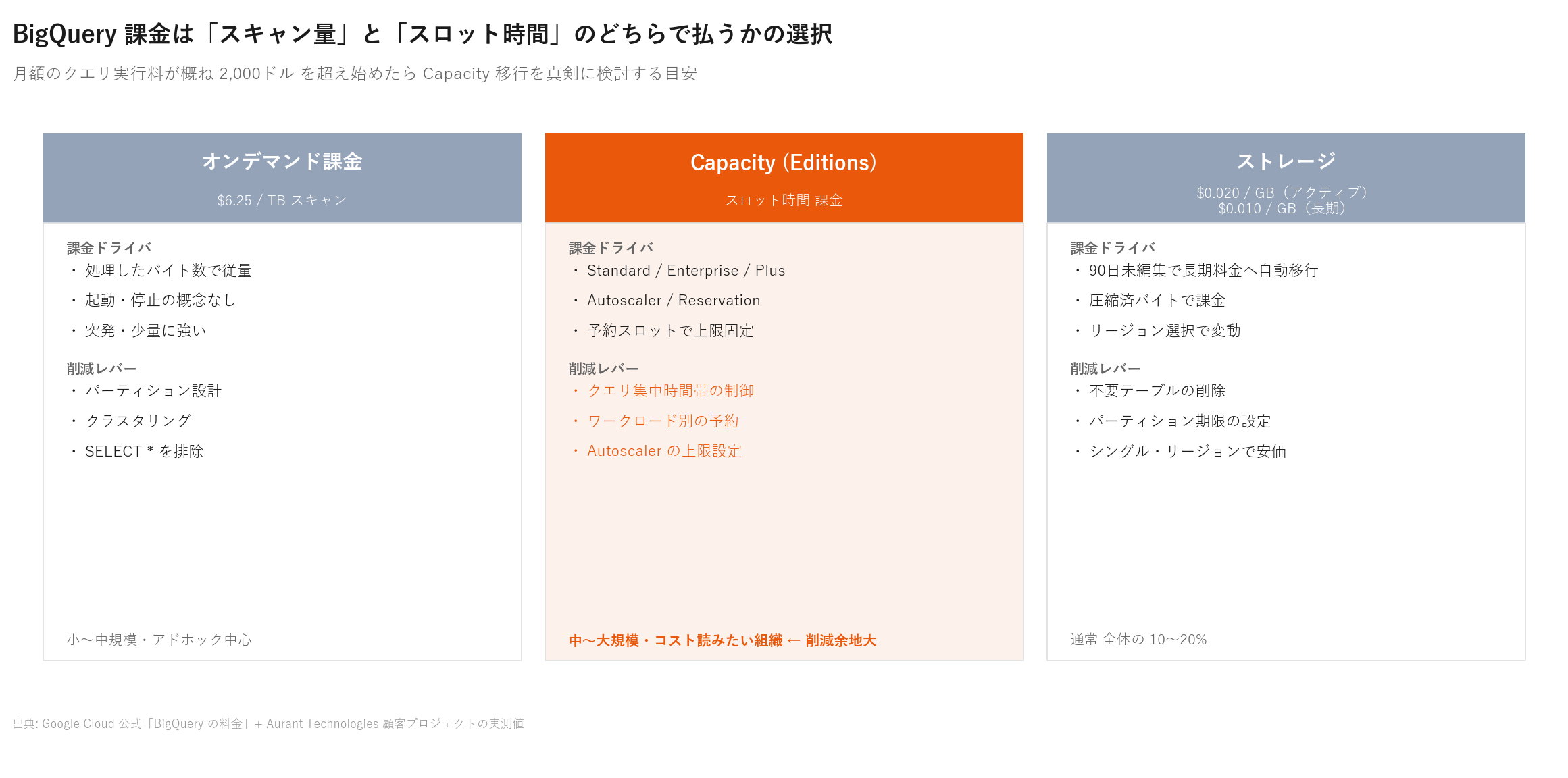

BigQueryはインフラの管理を一切必要としないサーバーレス構成です。料金は「保存しているデータ量(ストレージ料金)」と「実行したクエリの量(処理料金)」の完全従量課金制であり、スモールスタートに最適です。

| 項目 | 区分 | 料金目安 | 備考 |

|---|---|---|---|

| ストレージ料金 | アクティブ(90日以内に変更あり) | 約0.023ドル / GB | 最初の10GBまでは無料。 |

| 長期保存(90日間変更なし) | 約0.016ドル / GB | 自動的に半額近い料金に移行。 | |

| 計算(クエリ)料金 | オンデマンド | 6.25ドル / TB処理 | 処理したデータ量に応じて課金。 |

| Edition(予約型) | 時間単位の定額 | 大規模・高頻度利用に適したプラン。 |

2-3. Googleエコシステムとのシームレスな統合

BigQueryにデータが集約されていれば、Looker Studio(無料のBI)から直接データを参照できるだけでなく、Google広告やGA4の生データとkintone上の実売上データを「顧客ID」をキーに突合し、ROAS(広告費用対効果)の真値を可視化することが可能になります。

3. 【比較表】kintone連携ツールの選定基準

kintoneからBigQueryへの転送は、PythonやNode.jsを用いた自作スクリプトでも可能ですが、API仕様変更への追随やエラー監視の工数を考慮すると、マネージドなETL(Extract/Transform/Load)ツールの利用が賢明です。

| ツール名 | 主要な特徴 | 得意なシナリオ | 公式サイト |

|---|---|---|---|

| TROCCO | 日本発のETL。GUIで複雑なデータ加工(クレンジング)が可能。 | 大規模データ、多種多様なSaaSとの統合。日本語サポート重視。 | TROCCO |

| CData Sync | DBレプリケーションに特化。kintoneの構造を忠実に再現。 | 「まずはそのまま全件同期したい」場合。差分更新が強力。 | CData Sync |

| Yoom | iPaaS。ワークフローの中にデータ転送を組み込める。 | 特定のレコード更新をトリガーにリアルタイムで飛ばしたい。 | Yoom |

| Google Cloud Dataflow | Apache Beamベースのフルマネージド処理。 | エンジニアによる高度なリアルタイム・ストリーミング処理。 | Google Cloud |

4. 【実践】データパイプライン構築の10ステップ

ここでは、実務で最も汎用性の高い「ETLツールを用いた定期バッチ転送」の構築フローを詳細に解説します。

ステップ1:分析要件の定義とフィールドの選別

kintoneのすべてのフィールドを同期する必要はありません。分析に必要なフィールド(数値、日付、ステータス等)を洗い出し、不要な「添付ファイル」や「文字列(複数行)」の長文コメントなどは除外することで、転送コストと処理時間を削減します。

ステップ2:kintone APIトークンの発行と権限設定

対象アプリごとにAPIトークンを発行します。

- 必要な権限:レコード閲覧(分析用であれば追加・編集権限は不要)。

- セキュリティ:IP制限をかけている場合、ETLツール側の送信元IPアドレスを「サイボウズ共通管理」の許可リストに追加する必要があります。

ステップ3:Google Cloudプロジェクトの初期設定

Google Cloud Consoleで新しいプロジェクトを作成(または選択)し、「BigQuery API」が有効であることを確認します。

ステップ4:BigQuery データセットの作成

データセットは、テーブルを論理的にまとめるフォルダの役割を果たします。

- ロケーション:通常は「asia-northeast1 (東京)」を選択し、レイテンシとコンプライアンスを担保します。

ステップ5:IAM(サービスアカウント)の発行

ETLツールがBigQueryにアクセスするための専用アカウントを作成します。

- ロール:「BigQuery データ編集者」および「BigQuery ジョブユーザー」を付与します。

ステップ6:ETLツールでのコネクタ設定

kintoneのドメイン(https://www.google.com/search?q=subdomain.cybozu.com)と、ステップ2で取得したAPIトークンをETLツールに登録し、疎通確認を行います。

ステップ7:スキーマのマッピング(型定義)

kintoneの「数値」はBigQueryの FLOAT64、「日付」は DATE 型に正しく対応させます。kintoneの「未入力」状態を、BigQuery側で NULL として扱うか、デフォルト値を設定するかを決定します。

ステップ8:転送モード(全件 vs 増分)の決定

データ量に応じて、「毎回全データを入れ替える(Replace)」か、「更新分だけを追加・更新する(Upsert)」かを選択します。数百万件を超える場合は、kintoneの「更新日時」をキーにした増分ロードが必須となります。

ステップ9:スケジュール実行(ジョブ)の構成

「毎日深夜1時」や「1時間おき」など、ビジネスの鮮度要求に合わせて設定します。kintone側のバックアップ処理や他のSaaS連携と時間が重ならないよう調整するのが定石です。

ステップ10:エラー通知と監視の自動化

転送失敗時にSlackやメールへ通知が飛ぶよう設定します。特にAPIトークンの有効期限切れや、kintone側のフィールド定義変更によるエラーは早期発見が重要です。

5. kintone特有の「サブテーブル」をBigQueryでどう扱うか

kintone特有のデータ構造である「サブテーブル(明細行)」は、そのまま転送すると一つのカラムに複雑なデータが詰め込まれた状態(ネスト構造)になります。これを分析可能な形にするには、SQLでの処理が必要です。

5-1. UNNEST関数による「非正規化」処理

BigQueryでは UNNEST 関数を用いることで、1行のレコード内に含まれる複数の明細行を、別々の行として展開できます。

SQLイメージ:

SELECT parent_id, detail.item_name FROM table, UNNEST(sub_table) AS detail

5-2. 親子テーブル分離方式

ETLツール側で転送時に「ヘッダーテーブル」と「明細テーブル」に自動分割して保存する手法もあります。BIツールでの集計のしやすさを優先する場合は、こちらが推奨されます。

6. 実務における「異常系」シナリオと回避策

データパイプラインは「作って終わり」ではありません。実務で必ず直面するトラブルを想定した設計が、運用の成否を分けます。

6-1. 物理削除の検知漏れ

「増分ロード(差分更新)」設定では、kintone側でレコードを完全に削除(物理削除)しても、BigQuery側にはデータが残ってしまいます。

- 対策:kintone上で「削除フラグ」を立てる論理削除運用を徹底するか、週に一度「全件リプレイス」を行う同期ジョブを併用します。

6-2. スキーマドリフト(型不一致)の発生

kintone管理者が「文字列」フィールドを「数値」に変更したり、フィールドコードを書き換えたりすると、パイプラインが停止します。

- 対策:kintone側のアプリ変更管理ルールを策定し、変更時にはETL側のマッピングも修正するプロセスを構築します。

6-3. APIリミット超過とリトライ設計

他システムとの連携が重なりAPIリミットに達した場合、データ欠損が生じる恐れがあります。

- 対策:指数バックオフ(待ち時間を増やしながら再試行するアルゴリズム)を備えたETLツールを選定し、リトライを自動化します。

7. セキュリティとガバナンス:データの「格付け」管理

kintoneには顧客名、電話番号、成約金額などの機密情報が含まれます。BigQueryにデータを移す際は、適切な権限管理が求められます。

7-1. PII(個人を特定できる情報)のマスキング

分析に不要な氏名や生データとしてのメールアドレスは、ETLの転送プロセスで除外するか、ハッシュ化して特定の権限保持者以外からは見えないようにします。

7-2. カラムレベルのアクセス制御

BigQueryの「ポリシー タグ」機能を使用することで、特定の列(例:利益率、給与額など)のみを特定のグループ以外から参照不可にすることが可能です。

7-3. 監査ログの活用

Google Cloudの Cloud Logging を有効にし、「誰がいつ、どのデータに対してクエリを実行したか」を記録します。これにより、内部不正の抑止と、コンプライアンス要件への対応を両立させます。

8. 想定問答(FAQ)

Q1:kintoneの「ルックアップ」フィールドはどのように転送されますか?

A1:ルックアップで取得した値そのものが文字列や数値として転送されます。ただし、元アプリ側で値が更新されても、対象アプリ側で「再取得」が実行されていない場合は、古い値が転送される点に注意が必要です。

Q2:連携コストの目安はどのくらいですか?

A2:データ量によりますが、月間数万件程度の同期であればGoogle Cloud側の費用は数千円〜1万円程度です。主なコストはETLツールのライセンス料(月額3万円〜数万円程度から)となります。自作すればツール代はゼロですが、メンテナンス工数とのトレードオフです。

Q3:秒単位の「リアルタイム同期」は可能ですか?

A3:iPaaSのWebhook機能を使えば可能ですが、更新頻度が高いと即座にAPI制限に抵触します。実務上は、5分〜1時間に1回のバッチ更新、または夜間の日次更新で十分なケースが大半です。

Q4:BigQueryのクエリ料金が跳ね上がるのが不安です。

A4:BigQueryには「クエリの上限設定(カスタム割当)」があります。1日に消費する処理量に制限をかけることで、想定外の高額請求を未然に防ぐことができます。

Q5:kintoneの「添付ファイル」の中身も分析できますか?

A5:BigQueryは構造化データを扱うためのDWHであり、画像やPDFのバイナリをそのまま格納するのには向きません。添付ファイルをGoogle Cloud Storage(GCS)に保存し、そのURLパスのみをBigQueryで管理する構成が一般的です。

Q6:BIツールは何を組み合わせるのが最適ですか?

A6:最も親和性が高いのは同じGoogle製品の「Looker Studio」です。さらに高度なモデリングやガバナンスが必要な場合は「Looker」や「Tableau」が選定されます。

Q7:エンジニアが不在でも構築できますか?

A7:TROCCOやCData SyncなどのノーコードETLを使えば、パイプラインの構築自体は可能です。ただし、分析のためのSQL記述やデータ定義(スキーマ)の理解には、一定のITリテラシーが必要です。

Q8:kintone以外のSaaSデータと結合できますか?

A8:それこそがBigQueryへ移行する最大のメリットです。Salesforceの商談、freeeの会計データ、広告データなどを共通の「顧客ID」や「日付」で結合し、全社横断的な分析が可能になります。

Q9:データ転送が失敗したときのリカバリ方法は?

A9:ETLツールのログを確認し、原因(API制限、型エラー等)を取り除いた後、失敗した期間のデータを「再実行(バックフィル)」します。ツールによっては「失敗したジョブの自動リトライ」が可能です。

Q10:BigQueryからkintoneにデータを書き戻すことはできますか?

A10:可能です。これを「リバースETL」と呼びます。例えばBigQueryで算出した「解約リスクスコア」をkintoneの顧客アプリに書き戻し、現場の営業担当者がkintone上で確認するといった高度な運用が可能です。

9. 運用チェックリスト

| フェーズ | 確認項目 | 責任部署・担当 |

|---|---|---|

| 導入前 | 現在のAPIリクエスト使用状況の調査(他プラグイン含む) | kintone管理者 |

| 導入前 | 分析対象フィールドの個人情報有無と秘匿化方針の決定 | 情シス・法務 |

| 構築中 | サブテーブルのSQL展開ロジックの動作検証 | データエンジニア |

| 構築中 | Google Cloudの請求アラート・クエリ制限設定 | Google Cloud管理者 |

| 運用中 | 転送エラーログの定期確認と、kintoneアプリ変更の事前共有 | システム運用チーム |

10. まとめ:データ活用を「現場」から「経営」の武器へ

kintoneとBigQueryの連携は、単なるデータの複製ではありません。現場が使いやすいkintoneという「最高の入力インターフェース」の利点を活かしつつ、経営の意思決定に耐えうるDWHの「圧倒的な分析機動力」を手に入れるための、極めて合理的なDXアーキテクチャです。

最初からすべてのアプリを連携させようとせず、まずは「売上」「商談」といったビジネスインパクトの大きいデータから着手してください。「kintoneだけでは見えなかった未来」がBigQueryを通じて可視化されたとき、社内のデータドリブン文化は一気に加速します。

関連リンク: 【完全版・第5回】freee会計の「経営可視化・高度連携」フェーズ。会計データを羅針盤に変えるBIとAPI連携術

参考文献・出典

- kintone APIの制限について — https://cybozu.dev/ja/kintone/docs/overview/kintone-limits/

- BigQuery の料金 — https://cloud.google.com/bigquery/pricing?hl=ja

- BigQuery におけるカラム型ストレージの仕組み — https://cloud.google.com/blog/products/data-analytics/how-columnar-storage-works-in-bigquery

- TROCCO 接続先サービス: kintone — https://trocco.io/lp/kintone.html

- CData Sync: kintone データを主要なDWHに同期 — https://www.cdata.com/jp/sync/connections/kintone/

- Looker Studio と BigQuery の連携設定 — https://support.google.com/looker-studio/answer/6370296?hl=ja

- kintone API トークンの生成 — https://jp.cybozu.help/k/ja/admin/registration/app_token.html

- Google Cloud サービス アカウントの概要 — https://cloud.google.com/iam/docs/service-accounts?hl=ja

- BigQuery でのネストされた列と繰り返し列のクエリ — https://cloud.google.com/bigquery/docs/nested-repeated?hl=ja

- 個人情報(PII)の機密データの保護 — https://cloud.google.com/dlp?hl=ja

3. **追記するHTMLだけ**(通常は `

4. 次の1行を**そのまま**出力:

kintone × BigQuery 連携の実装パターン4種

kintone から BigQuery にデータを連携する方法は複数あり、データ量・更新頻度・予算によって最適解が変わります。実プロジェクトで使われる4パターンを整理します。

パターン1:trocco(プライムナンバー)

- 強み:国産・日本語サポート・kintone専用コネクタが成熟、コネクタ数100+

- 料金感:月10〜30万円(データ量で変動)

- 適合:中堅企業・SQL知識ない組織でも導入可能・国産SaaS連携多数

- 取得方法:kintone APIトークン認証で接続、増分転送対応

パターン2:Fivetran

- 強み:グローバルSaaSの自動ELT、フルマネージド

- 料金感:MAR(Monthly Active Rows)課金で月1,000ドル〜(規模で変動)

- 適合:グローバル展開企業、kintone以外のSaaS連携も多い場合

- 注意:MAR 課金が読みづらく、コスト管理が課題

パターン3:自社開発(Cloud Functions / Lambda + kintone REST API)

- 強み:完全カスタム・柔軟性最大・小規模なら超低コスト

- 料金感:Cloud Functions の従量課金のみ(月数百円〜)

- 適合:社内エンジニアがいる組織・特殊要件あり

- 注意:保守工数あり・APIレート制限(kintone: 1秒10req)の制御を自社実装

パターン4:Dataform / dbt + kintone Connector

- 強み:データ変換ロジックをコード管理(Git)、CI/CD 対応

- 料金感:Dataform 無料(BigQuery 利用料のみ)/dbt Cloud 月100ドル〜

- 適合:データチームのある中〜大企業、ガバナンス重視

選定マトリクス

| 条件 | 推奨パターン |

|---|---|

| SQL不要・国内サポート重視 | trocco |

| グローバルSaaS連携多数 | Fivetran |

| 低コスト・小規模・社内エンジニアあり | 自社開発 |

| データ変換ロジックを版管理したい | Dataform / dbt |

kintone API レート制限と差分転送の実装テクニック

kintone API は1秒10リクエストの厳しいレート制限があります。BigQuery への連携で詰まる最大のポイントです。具体的な対策を整理します。

制限の本質

- 1秒10req のレート制限:kintone API の標準制約

- 1ページ500レコード上限:1回のクエリで取得できる最大件数

- 1日10,000req のフェアユース:契約条件によっては追加制限

レート制限への対策

- 並列度の制御:ETLツール側で並列リクエスト数を10未満に

- 差分転送:「更新日時 > 前回取得時刻」で差分のみ取得し、フル取得を回避

- 夜間バッチ実行:業務時間中の API 利用と競合を避ける

- サブテーブルの分離取得:親レコード + サブテーブルを別 API で分けて取得

差分転送のクエリ例(kintone REST API)

GET https://your-domain.cybozu.com/k/v1/records.json?

app=123

&query=更新日時 > "2026-05-11T00:00:00+09:00" order by 更新日時 asc limit 500 offset 0

Headers:

X-Cybozu-API-Token: YOUR_API_TOKEN

kintone サブテーブルの BigQuery 取り扱いパターン

kintone の「サブテーブル」(明細行)は、BigQuery への取り込みで最大の設計論点です。3つの取り扱いパターンを整理します。

パターンA:UNNEST 関数で展開

kintone APIで取得した親+子のネストJSON を BigQuery の ARRAY 型として格納し、クエリ時に UNNEST で展開。

-- 受注テーブルと明細サブテーブルを展開

SELECT

parent.order_id,

parent.customer_name,

child.item_code,

child.qty,

child.unit_price

FROM `project.kintone.orders` AS parent,

UNNEST(parent.items) AS child

WHERE parent.order_date >= '2026-05-01';

パターンB:親子テーブル分離

親レコードと子レコード(サブテーブル)を別テーブルとして格納し、JOIN で結合。SQLの標準的な正規化アプローチ。

- ordersテーブル(親)

- order_itemsテーブル(子・FK: order_id)

- BIツールで参照しやすい正規化形態

パターンC:フラット化(非正規化)

親レコード情報を子レコードの各行に複製し、フラットなテーブル構造に。最も BI ツールで扱いやすいが、容量増加。

BigQuery 側のスキーマ設計とコスト最適化

パーティション・クラスタリングの推奨設定

- パーティション:日付フィールド(作成日時・更新日時・取引日)で日次パーティション分割

- クラスタリング:顧客ID・店舗ID・部署IDなど検索頻度高いカラムでクラスタ化

- 効果:定型クエリのスキャン量が90%以上削減

マテリアライズドビュー化

- 毎日叩かれる集計クエリ(日次売上・週次サマリ等)はマテリアライズドビュー化

- BIツールはマテリアライズドビューを参照、生データは触らない

- クエリ料金が1/10レベルに削減できるケースが多い

不要データの自動アーカイブ

- 3年以上前のデータは Long-term Storage(自動的に半額)

- 5年以上前は Archive Storage(Cold storage)に移動

- BigQuery のテーブル有効期限・パーティション有効期限を活用

kintone × BigQuery 連携の典型ユースケース

ユースケース1:経営ダッシュボード(全社統合分析)

- kintone 複数アプリ(営業案件・受注・契約・サポート)を BigQuery に集約

- Looker Studio で経営層向け週次/月次レポート自動生成

- 「kintone単体では難しい複数アプリ横断分析」を実現

ユースケース2:データドリブン マーケティング

- kintone 顧客データ + GA4 + 広告データを BigQuery で統合

- 顧客LTV分析・チャーン予測・最適キャンペーン設計

- BigQuery ML での予測モデル構築(顧客スコアリング)

ユースケース3:BIガバナンス強化

- kintone のアプリ毎の分散レポートを、BigQuery 経由で統合管理

- データの定義を1箇所で管理(指標辞書)、kintone も BIも同じ数字を見る

ユースケース4:機械学習・AI 活用

- kintone データを BigQuery ML で予測モデル構築

- 例:商談確度予測、解約予測、需要予測

- 結果を Reverse ETL で kintone に戻し、現場が活用

関連ガイド・クラスター

CRM・営業支援

Salesforce・HubSpot・kintoneの選定から導入・カスタマイズ・定着まで一貫対応。営業生産性を高め、商談化率を改善します。