情シス必見!エンタープライズ生成AIのセキュリティ実践【自社番外編】

情シス・情報管理担当向けに、エンタープライズでの生成AIセキュリティ実践を整理。ガバナンスと運用の観点から自社番外編として解説します。

目次 クリックで開く

【自社実践・番外編】「AI利用は全面禁止」で終わらせない。情シスを納得させるエンタープライズAIセキュリティの実態

こんにちは。Aurant Technologiesです。前編・後編の記事では、SaaSの隙間を埋めるためにAIエージェント(Claude等)を活用し、現場が継続的に高い成果を出す仕組みを解説してきました。

一方で、この実践を紹介すると経営層、CISO、情報システム部門から必ず出る懸念があります。「機密情報をAIに渡して漏洩しないか」「自律エージェントが誤操作しないか」。この懸念は正しく、本質的です。

本記事では、AI活用を全面禁止にせず、現場のアジリティを維持しながらエンタープライズ水準の安全性を担保する実務アーキテクチャを、省略せずに解説します。

なぜ「全面禁止」は解にならないのか

情報漏洩を恐れて「生成AIは原則禁止」にすると、表面上は統制が効いたように見えます。しかし実際には、現場が個人アカウントや未承認ツールを使う「シャドーAI」が発生しやすくなります。禁止だけでは統制できず、むしろ見えないリスクを増やす可能性があります。

現在のAIは、対話だけでなく外部ツールを操作する自律型エージェントへ進化しています。従来の境界防御だけでは不十分で、「正しく使わせる設計」が必要です。

要点: いま必要なのは「使わせない」統制ではなく、「安全に使わせる」ゼロトラスト運用です。

何から守るべきか: 脅威モデルのアップデート

最新の脅威は、ハルシネーションだけではありません。AIエージェントがAPI経由で社内システムに接続することで、攻撃面(アタックサーフェス)が拡大します。特に重要なのが、悪意ある入力で指示を乗っ取るプロンプトインジェクション(目標ハイジャック)です。

したがって、入力画面だけ守る局所防御では足りません。AIのアクセス権、実行範囲、監査証跡まで含めた全体制御が必須です。

鉄則1: Enterpriseプラン強制とログ監視でデータ流出を構造的に防ぐ

Zero Data Retention契約を前提にする

個人向けプランや設定任せ運用では、入力データが学習利用されるリスクや設定漏れが残ります。企業利用では、管理者強制が可能なEnterpriseプランを前提とし、Zero Data Retention(入力データの保持・学習利用なし)を契約条件にしてください。

SSOと退職者権限剥奪を標準化する

AIツールも他SaaS同様に、入退社管理を統合すべきです。SSO連携でアカウント統制し、退職・異動時の権限剥奪を即時化することで、運用抜け漏れを防ぎます。

Datadog等でローカル死角を可視化する

盲点はローカル環境です。開発者端末でのAI実行ログが監査外だと、重大な死角になります。統合監視基盤でプロンプト実行ログを収集しつつ、送信前に機密情報を自動マスキングする処理を必須化してください。

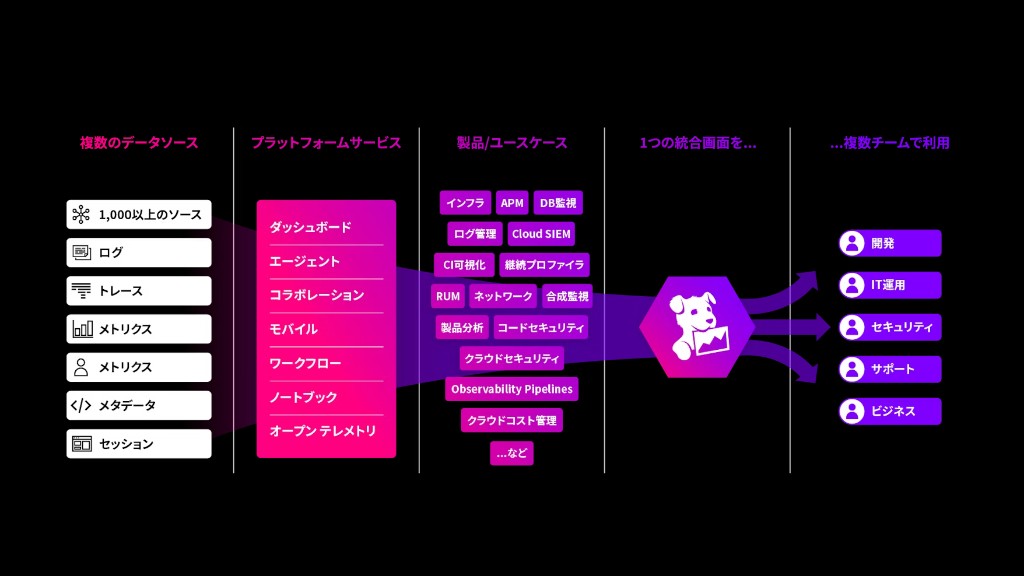

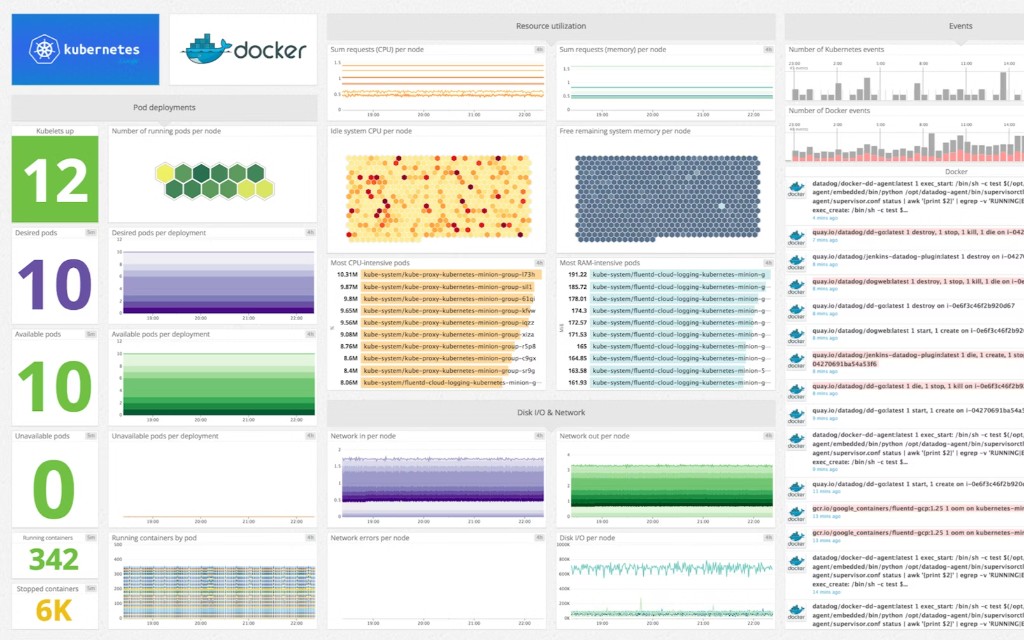

Datadogとは?

Datadog はクラウドアプリケーション向けのモニタリングとセキュリティプラットフォームです。SaaS型の基盤として、インフラストラクチャ監視、アプリケーションパフォーマンス監視(APM)、ログ管理を統合・自動化し、テクノロジースタック全体を一元的にリアルタイム監視できます。

またDatadogでは、利用ユーザーのアクセス行動を平時と比較し、明らかに不審な動きを検知する運用が可能です。例えば、日本で作業しているユーザーが突然海外からアクセスする、深夜帯にアクセスが急増する、といった兆候を検知して早期対応につなげられます。

現状、多くの組織ではAIエージェントに対する統制整備が利用スピードに追いついていません。ルールより利用が先行する状況だからこそ、こうした監視基盤を継続的に追い、運用へ組み込むことが重要です。

鉄則2: MCPを禁止するのではなく、権限設計で制御する

MCP(Model Context Protocol)は、LLMと外部システム接続を標準化する規格です。危険だから使わない、ではなく「使う前提で安全設計する」ことが実務解です。従来API連携のみで進めると、プロバイダー差異吸収や変換処理の開発負荷が大きく、速度・保守性で不利になります。

推奨方針: MCPは活用する。代わりにIAMとゼロトラストを徹底する。

MCP運用の最低要件

- Read-Only原則: 原則は検索・取得のみ。書き込み・削除は限定承認。

- 最小権限: タスクに必要な最小領域のみ付与(フォルダ、テーブル、ビュー単位)。

- 短寿命トークン: 永続キーを避け、時間限定で権限付与。

- 監査ログ: いつ誰が何にアクセスしたかを追跡可能にする。

鉄則3: ブラックボックス化を防ぐ推論記録と静的解析

AI活用が進むほど、「なぜその判断をしたか」が説明できない問題が発生します。API通信ログだけでなく、推論ステップ(どの情報を参照し、どの判断経路を通ったか)を構造化して残す設計が必要です。これにより、インシデント時のフォレンジックが現実的になります。

また、AI生成コードは人間コード同様に脆弱性検査が必要です。CI/CDにSAST(例: SonarQube、Snyk等)を組み込み、リリース前の自動検査を標準化してください。

鉄則4: Human-in-the-Loopで最終責任を明確化する

本番DB更新、顧客向け送信、金銭影響のある操作など高リスク処理は、完全自動にすべきではありません。実行直前に人間承認を挟むHuman-in-the-Loop(HITL)を必須化し、AIは90%の下準備まで、人間が最後の10%を確定する運用が現実的です。

加えて、承認履歴(誰がいつ何を承認したか)を監査証跡として自動保存してください。SOC 2など外部監査を見据える場合、この証跡設計は不可欠です。

実装チェックリスト(情シス・CISO向け)

| 観点 | 最低要件 | 未対応時の主なリスク |

|---|---|---|

| 契約・データ保護 | Enterprise契約、ZDR、SSO統合 | 設定漏れ、データ学習利用、退職者権限残存 |

| MCP/接続 | Read-Only原則、最小権限、短寿命トークン | 誤操作、過剰権限、情報漏洩 |

| 監視・監査 | 実行ログ収集、機密マスキング、承認証跡保全 | 原因追跡不能、監査不適合 |

| 開発統制 | SAST統合、レビュー基準明文化 | 脆弱コード混入、本番障害 |

| 実行統制 | HITL承認、高リスク操作の自動実行禁止 | 誤送信、誤更新、ビジネスインパクト拡大 |

参考になる関連記事

- 【自社実践・前編】SaaSの隙間を埋める運用設計

- 【自社実践・後編】バックオフィス連携とAI運用の実務

- 【DXの罠】SaaS導入・AI活用で失敗する8つのアンチパターン

- WebAPPという選択肢: SaaSだけで足りない領域の補完

- オンプレCRM移行でのガバナンス実務

- Salesforce × バクラク連携(業務自動化の統制例)

参考・出典ガイドライン

AIガバナンス設計にあたり、実務で参照すべき主要ガイドラインです。

- OWASP Top 10 for LLM Applications / Agentic Applications

- NIST AI RMF

- IPA 生成AIセキュリティガイドライン

- Anthropic Trust Center

- Cursor Privacy and Data Governance

まとめ: 正しく恐れ、ゼロトラストで使い倒す

エンタープライズAIセキュリティは「不適切発言を防ぐ」局所対策では終わりません。自律エージェントへの権限委譲をいかに安全に設計し、監視・統制するかという、構造課題への対応が本質です。

「生産性を上げたいがセキュリティ要件を満たせるか不安」「シャドーAIが広がっている」「MCP等の最新技術を安全に導入したい」といった課題がある場合、設計と運用を同時に見直す必要があります。

無料相談: AIセキュリティ × CX to Backoffice 構造診断

貴社のAI活用とシステム構造が、最新のセキュリティ要件に適合しているかを診断し、セキュアでアジャイルな推進基盤をご提案します。