Snowflakeデータモデリング ベストプラクティス:ビジネスを加速させるデータ基盤設計と運用負荷軽減

Snowflakeデータモデリングのベストプラクティスで、データ基盤設計の効率化と運用負荷軽減を実現。企業のDXを加速し、データに基づいた迅速な意思決定を支援します。

目次 クリックで開く

Snowflakeデータモデリング ベストプラクティス:ビジネスを加速させるデータ基盤設計と運用負荷軽減

Snowflakeデータモデリングのベストプラクティスで、データ基盤設計の効率化と運用負荷軽減を実現。企業のDXを加速し、データに基づいた迅速な意思決定を支援します。

Snowflakeデータモデリングがビジネスを加速させる理由

現代ビジネスにおいて、データは「新たな石油」と称されるほど重要な資産です。しかし、多くの企業がその莫大なデータから真の価値を引き出し、競争優位性を確立する上で課題を抱えています。このセクションでは、データドリブン経営の重要性、既存データ基盤の限界、Snowflakeが提供する革新的な価値、そしてデータモデリングがビジネス加速に不可欠である理由を解説します。

データドリブン経営の重要性と既存データ基盤の課題

今日のビジネス環境は、目まぐるしい変化と不確実性に満ちています。このような状況下で持続的な成長を遂げるためには、勘や経験に頼るだけでなく、データに基づいた客観的な意思決定、すなわち「データドリブン経営」が不可欠です。データドリブン経営を実践することで、市場トレンドの正確な把握、顧客ニーズの深掘り、業務プロセスの最適化、新たな収益源の発見などが可能になります。実際、データドリブン企業は、競合他社と比較して平均で23%高い収益増加を達成しているという調査結果もあります(出典:Forrester Consulting)。

しかし、多くの企業が直面しているのは、既存のデータ基盤がこのニーズに応えきれていないという現実です。長年運用されてきたオンプレミスのデータウェアハウスやレガシーシステムは、以下のような課題を抱えています。

- スケーラビリティの限界:データ量の爆発的な増加に対応できず、性能劣化やシステム停止のリスクを抱えています。リソース拡張には多大な時間とコストがかかります。

- 高い運用・保守コスト:ハードウェアの維持管理、ソフトウェアライセンス、専門人材の確保など、運用に膨大なコストがかかります。

- 複雑なデータサイロ:部門ごとにデータが分断され、統合的な分析が困難です。データ連携には手作業や複雑なETL処理が必要となり、ヒューマンエラーのリスクも高まります。

- 分析処理の遅延:大量データの複雑なクエリ実行に時間がかかり、ビジネスユーザーが必要なインサイトをリアルタイムで得ることができません。

- 柔軟性の欠如:新しいデータソースの追加や分析ニーズの変化に迅速に対応できず、ビジネスの変化に追いつけません。

これらの課題は、データ活用を阻害し、結果としてデータドリブン経営への移行を遅らせる大きな要因となっています。

Snowflakeが提供する価値:柔軟性、スケーラビリティ、コスト効率

Snowflakeは、これらの既存データ基盤の課題を解決するために設計された、クラウドネイティブなデータプラットフォームです。その革新的なアーキテクチャは、柔軟性、スケーラビリティ、コスト効率という3つの主要な価値を貴社にもたらします。

柔軟性:

- 多様なデータタイプへの対応:構造化データはもちろん、JSON、Parquet、XMLなどの半構造化データもネイティブでサポートし、ETLなしで直接クエリを実行できます。これにより、データの取り込みと活用が大幅に簡素化されます。

- SQL互換性:標準的なSQLをサポートしているため、既存のSQLスキルを持つデータアナリストやエンジニアがすぐに活用できます。

- データシェアリング:SnowflakeのSecure Data Sharing機能により、組織内外のパートナーと安全かつ簡単にデータを共有できます。これにより、新たなビジネス機会の創出やサプライチェーン全体の最適化が可能になります。

スケーラビリティ:

- ストレージとコンピュートの分離:Snowflakeの最大の特徴は、データストレージとコンピュートリソースが完全に分離されている点です。これにより、ストレージ容量と処理能力をそれぞれ独立して拡張・縮小できます。

- 仮想ウェアハウス:複数のワークロードに対して、それぞれ最適な仮想ウェアハウス(コンピュートクラスター)を立ち上げることができます。これにより、データロード、BIレポート、データサイエンスなど、異なる処理が互いに干渉することなく、同時に高速で実行されます。

- 自動スケーリング:ワークロードに応じてコンピュートリソースを自動的にスケールアップ・ダウンできるため、常に最適なパフォーマンスを維持しつつ、コストを最適化できます。

コスト効率:

- 従量課金制:利用したストレージとコンピュートリソースに対してのみ課金されるため、無駄なコストが発生しません。特に、コンピュートリソースは利用していない間は課金されません。

- データ圧縮:データは自動的に圧縮され、ストレージコストを削減します。

- 運用の簡素化:インフラ管理が不要なため、運用にかかる時間とコストを大幅に削減できます。

既存のデータウェアハウスとSnowflakeの主な違いを以下の表にまとめました。

| 項目 | 従来のオンプレミスDWH | Snowflake (クラウドデータプラットフォーム) |

|---|---|---|

| アーキテクチャ | ストレージとコンピュートが密結合 | ストレージとコンピュートが分離 |

| スケーラビリティ | 拡張に時間とコストがかかる(垂直拡張が主) | 独立した伸縮性(水平・垂直拡張が容易)、自動スケーリング |

| コストモデル | 初期投資大、固定費、ハードウェア維持費 | 従量課金制、利用した分だけ支払い、初期投資小 |

| 運用負荷 | 高い(インフラ管理、パッチ適用など) | 低い(サービスが管理、運用不要) |

| データタイプ | 構造化データが中心 | 構造化、半構造化データをネイティブサポート |

| 同時実行性 | 競合が発生しやすい | 高い(仮想ウェアハウスによりワークロード分離) |

| データ共有 | 複雑、セキュリティリスク | セキュアデータシェアリングで容易に実現 |

データモデリングの欠如がもたらすリスクと非効率性

Snowflakeが提供する優れた基盤能力を最大限に引き出すためには、適切なデータモデリングが不可欠です。Snowflakeの柔軟性は魅力的ですが、データモデリングを怠ると、そのメリットを十分に享受できないどころか、かえって以下のようなリスクと非効率性を招く可能性があります。

- データ品質の低下と信頼性の喪失:一貫性のないデータ構造、重複、不正確なデータが蔓延し、分析結果の信頼性が損なわれます。これにより、誤った意思決定につながるリスクが高まります。

- レポート作成・分析の複雑化と遅延:構造化されていないデータや不適切なモデルでは、必要な情報を抽出するためのクエリが複雑化し、実行に時間がかかります。結果として、ビジネスユーザーがタイムリーにインサイトを得ることができなくなります。

- 運用・保守コストの増大:データ構造が混沌としていると、データの変更、追加、削除の際に予期せぬ影響が生じやすくなります。これにより、システム障害やデータ修正のための運用コストが増大します。

- データガバナンスの欠如:データがどのように定義され、どこに保存され、どのように利用されるかというルールが不明確になり、セキュリティリスクやコンプライアンス違反のリスクが高まります。

- データ活用の障壁:データがどこに何があるのか、どのような意味を持つのかが理解しにくくなり、ビジネスユーザーやデータサイエンティストがデータを活用する際の障壁となります。結果として、データドリブン経営への移行が停滞します。

例えば、貴社がマーケティングキャンペーンの効果測定を行いたい場合を考えてみましょう。もし顧客データ、購買データ、キャンペーンデータがバラバラに管理され、関連付けが不適切であれば、特定のキャンペーンがどの顧客層に、どれくらいの売上増をもたらしたのかを正確に分析することは困難です。このような場合、データ統合に膨大な時間と労力がかかり、結果的にキャンペーンの改善策を迅速に実行できません。

Snowflakeの強力なパフォーマンスと柔軟性を最大限に活かすためには、データの意味、関係性、利用目的を明確にする「データモデリング」が不可欠です。適切なデータモデリングは、データの品質を保証し、分析の効率を高め、最終的に貴社のビジネスがデータから最大の価値を引き出すための基盤を築きます。

Snowflakeの基本理解とデータ基盤における優位性

データドリブン経営が不可欠な現代において、データ基盤の設計は企業の競争力を左右する重要な要素です。爆発的に増加するデータ量と複雑化する分析ニーズに対応するには、従来のデータウェアハウスの限界を超えた新しいソリューションが求められます。クラウドネイティブな設計思想を持つSnowflakeは、データ基盤設計の効率化と運用負荷軽減を実現する強力なツールとして注目されています。

このセクションでは、Snowflakeがデータ基盤において優位性を持つ理由を、その独自のアーキテクチャから最新のAI・ML連携機能まで、具体的な特徴と技術革新を交えて解説します。

Snowflakeのアーキテクチャと特徴(Compute/Storage分離、Zero-Copy Cloningなど)

Snowflakeの最大の特長は、コンピューティング(処理)とストレージ(保存)を完全に分離した独自のアーキテクチャにあります。これにより、従来のデータウェアハウスが抱えていたリソースの競合やスケーラビリティの課題を根本的に解決しています。

- Compute/Storage分離:データはクラウドストレージに保存され、クエリ実行に必要なコンピューティングリソースは「仮想ウェアハウス」として独立して稼働します。これにより、データ量が増えてもストレージを柔軟に拡張でき、分析負荷が高まっても仮想ウェアハウスをスケールアップ・スケールアウトすることでパフォーマンスを維持できます。それぞれを独立してスケールできるため、コスト効率も最大化されます。

- マイクロパーティションとクラスタリング:Snowflakeはデータを自動的に圧縮し、マイクロパーティションと呼ばれる小さなチャンクに分割して保存します。さらに、クエリのパフォーマンスを最適化するために、データを自動的にクラスタリングする機能も備わっています。これにより、大規模なデータセットに対しても高速なクエリ実行を実現します。

- Zero-Copy Cloning:既存のテーブル、スキーマ、データベースを瞬時にコピーできる機能です。物理的なデータコピーが発生しないため、ストレージコストを抑えつつ、開発環境やテスト環境を迅速に構築できます。これは、データ基盤の運用における大きなメリットです。

- Time TravelとFail-safe:データの変更履歴を一定期間保持し、過去の任意の時点のデータにアクセスできる「Time Travel」機能は、誤ったデータ変更からの復旧やデータ監査に非常に役立ちます。さらに、障害発生時にデータを自動的に保護する「Fail-safe」機能により、データの堅牢性が確保されています。

これらの機能により、Snowflakeは高いスケーラビリティ、パフォーマンス、そして運用効率を実現し、現代のデータ駆動型ビジネスのニーズに応える最適なデータプラットフォームとなっています。

| 特徴 | 従来のデータウェアハウス | Snowflake |

|---|---|---|

| アーキテクチャ | 緊密結合型(ComputeとStorageが一体) | ComputeとStorageの完全分離 |

| スケーラビリティ | 拡張が困難、高コスト、複雑 | ComputeとStorageを独立して柔軟に拡張可能 |

| コストモデル | 固定資産投資、リソースの過剰プロビジョニング | 従量課金制(利用したComputeとStorageのみ)、コスト最適化が容易 |

| 運用負荷 | インフラ管理、チューニング、バックアップなど高い | フルマネージドサービス、運用負荷が大幅に軽減 |

| データ共有 | データの物理的な移動や複雑な連携が必要 | Zero-Copy Sharingによるセキュアかつ容易なデータ共有 |

| データ復旧 | バックアップからの復旧に時間と手間 | Time Travel機能による瞬時の過去データアクセス・復旧 |

クラウドデータウェアハウスとしての技術革新と進化

Snowflakeは単なるデータウェアハウスではなく、クラウドネイティブな設計思想を基盤としたデータプラットフォームとして進化を続けています。その技術革新は、データ活用における様々な課題を解決し、企業に新たな価値を提供しています。

- クラウドネイティブな弾力性:パブリッククラウド上に構築されているため、必要な時に必要なだけリソースを自動的にプロビジョニング・解放できます。これにより、ピーク時の負荷にも柔軟に対応し、アイドル時にはコストを削減できる「弾力性」を実現します。

- データレイク、DWH、データマートの統合:Snowflakeは、構造化データだけでなく半構造化データ(JSON, XML, Parquetなど)も直接取り込めるため、データレイクとデータウェアハウスの機能を統合できます。これにより、ETLプロセスの簡素化やデータの一元管理が可能になり、データマートへの展開も容易になります。

- 強固なセキュリティとガバナンス:データの暗号化、多要素認証、ロールベースのアクセス制御(RBAC)など、エンタープライズレベルのセキュリティ機能を標準で提供します。これにより、機密性の高いデータも安全に管理し、データガバナンス要件を満たすことができます。

Snowflakeの市場における評価は非常に高く、クラウドデータウェアハウス市場のリーダーとして急速な成長を遂げています。2020年9月のIPO以降、その時価総額は一時千億ドル規模に達するなど、その革新性が市場から高く評価されています。

分散ID生成「雪花アルゴリズム」との関連性

「Snowflake」という名前を聞くと、一部の技術者は分散システムでユニークIDを生成する「雪花アルゴリズム(Snowflake Algorithm)」を連想するかもしれません。しかし、これは偶然の一致であり、クラウドデータウェアハウスのSnowflake社と、分散ID生成アルゴリズムとしての雪花アルゴリズムには直接的な関係はありません。

- 雪花アルゴリズムの概要:雪花アルゴリズムは、Twitter社が開発した、分散環境下で重複しないユニークな64ビットIDを生成するための手法です。タイムスタンプ、データセンターID、マシンID、シーケンス番号を組み合わせることで、高速かつ一意性の高いIDを生成します。

- データ基盤におけるIDの重要性:大量のデータを扱うデータ基盤において、各レコードやトランザクションに一意のIDを付与することは極めて重要です。これにより、データの整合性を保ち、複雑な分析や結合処理を正確に行うことができます。Snowflake自体はこのようなIDを自動生成する機能は持っていませんが、データを取り込む際にユニークなIDを付与する設計は、データモデリングのベストプラクティスとして推奨されます。

したがって、Snowflakeというデータプラットフォームが、分散システムにおけるID生成の重要性を間接的に示唆していると捉えることはできますが、技術的な関連性は直接的ではありません。ただし、どちらも大規模な分散システムを効率的に運用するための重要な要素であるという点で共通の課題意識を持っていると言えるでしょう。

最新のAI・ML機能との連携(Snowflake Arctic embedなど)

Snowflakeは、単なるデータウェアハウスの枠を超え、データサイエンスや機械学習(ML)のワークロードをサポートする統合プラットフォームへと進化しています。データがSnowflakeに集約されているため、AI/MLモデルの学習や推論に必要なデータ準備から実行までを一貫して行える環境を提供します。

- Snowflake Cortex:Snowflake Cortexは、データサイエンティストや開発者がSQLを使って、Snowflake内で直接MLモデルを構築・デプロイできるサービスです。複雑なインフラ設定なしに、データに最も近い場所でAI/MLワークロードを実行できるため、データ移動のコストと時間を削減し、セキュリティリスクも低減します。

- Streamlit in Snowflake:PythonベースのWebアプリケーションフレームワークであるStreamlitをSnowflake内で直接実行できる機能です。これにより、データサイエンスの成果をインタラクティブなダッシュボードやアプリケーションとして、迅速にビジネスユーザーに提供することが可能になります。

- Snowflake Arctic embed:最近注目を集めているのが、Snowflakeが公開したオープンな埋め込みモデル「Arctic embed」です。これは、テキストデータを数値ベクトルに変換する埋め込みモデル群であり、MTEB(Massive Text Embedding Benchmark)の検索ランキングにおいて、モデルサイズと検索パフォーマンスの両面で高い評価を得ています。これにより、Snowflake上のデータを活用した検索拡張生成(RAG)やセマンティック検索などの高度なAIアプリケーション開発が加速します。

これらのAI/ML関連機能の強化は、貴社がSnowflakeをデータ基盤として導入することで、データ分析からAI活用までを一貫して行える環境を構築し、ビジネスにおける新たな価値創造を加速させる可能性を秘めていることを示しています。

Snowflakeにおけるデータモデリングの基礎と目的

データ基盤の構築において、データモデリングは設計の要となる工程です。Snowflakeのようなクラウドデータプラットフォームでは、その特性を最大限に活かすために、従来のデータウェアハウスとは異なる視点でのモデリングが求められます。このセクションでは、データモデリングの基本的な概念から、Snowflakeにおいてそれが不可欠な理由、そして最適なデータ構造が貴社にもたらす具体的なメリットを解説します。

データモデリングとは何か:概念と種類

データモデリングとは、現実世界のビジネスプロセスや情報を抽象化し、データとしてコンピュータシステム上で効率的に扱えるよう構造化するプロセスです。これは、データ基盤における「設計図」のようなものであり、データの整理、保存、取得、分析の方法を定義します。適切なデータモデリングは、システムのパフォーマンス、保守性、そしてデータの理解容易性に直結します。

データモデリングには、主に以下の3つの段階があります。

- 概念データモデル (Conceptual Data Model): ビジネス要件に焦点を当て、どのようなデータが必要か、それらのデータがどのように関連し合うかを高レベルで表現します。特定のデータベース技術には依存せず、ビジネス側の視点からデータ要素を特定します。

- 論理データモデル (Logical Data Model): 概念モデルをより具体的なデータ構造に落とし込んだものです。エンティティ(テーブル)、属性(カラム)、リレーションシップ(関連)などを定義しますが、まだ特定のデータベース製品の機能には縛られません。正規化の概念が適用されることが多い段階です。

- 物理データモデル (Physical Data Model): 論理モデルを特定のデータベースシステム(この場合はSnowflake)に最適化された形で具体化します。テーブル名、カラムのデータ型、インデックス(Snowflakeではクラスタリングキーなど)、パーティショニング(Snowflakeではマイクロパーティション)といった物理的な実装の詳細を定義します。

これらのモデルは段階的に詳細化され、最終的にSnowflake上で動作する効率的なデータ構造へと結実します。

| データモデリングの種類 | 主な目的 | 主な関係者 | Snowflakeとの関連性 |

|---|---|---|---|

| 概念データモデル | ビジネス要件の把握と共通理解の形成 | ビジネス部門、データアナリスト | ビジネス課題とデータの紐付けの第一歩 |

| 論理データモデル | データの構造化と整合性の確保 | データアーキテクト、データエンジニア | Snowflakeの柔軟なデータ型や半構造化データ対応を考慮した設計 |

| 物理データモデル | データベース上での効率的なデータ格納とクエリ性能の最適化 | データエンジニア、DBA | Snowflakeのマイクロパーティション、クラスタリングキー、VARIANT型などの活用 |

なぜSnowflakeでデータモデリングが重要なのか

Snowflakeは、その革新的なクラウドネイティブアーキテクチャにより、高いスケーラビリティとパフォーマンス、そしてコスト効率を実現します。しかし、これらのメリットを最大限に享受するためには、適切なデータモデリングが不可欠です。モデリングを怠ると、Snowflakeのポテンシャルを十分に引き出せず、かえって運用コストの増大やパフォーマンスの低下を招く可能性があります。

その理由は以下の通りです。

- コスト効率への影響: Snowflakeは従量課金制であり、クエリが消費するコンピューティングリソースに応じて課金されます。非効率なデータ構造は、より多くのコンピューティングリソースを消費し、結果として不要なコスト増大につながります。適切なモデリングにより、クエリの効率を高め、コストを最適化できます。

- クエリパフォーマンスの最大化: Snowflakeは自動的にデータをマイクロパーティションに分割し、クエリの最適化を図ります。しかし、データモデリングでクラスタリングキーを適切に設定したり、データの物理的な配置を考慮したりすることで、この最適化をさらに強力にサポートし、大規模なデータセットに対するクエリ実行速度を劇的に向上させることが可能です。

- 半構造化データへの対応: SnowflakeはJSON, XML, Parquetなどの半構造化データをVARIANT型で直接格納し、FLATTEN関数で柔軟に展開できるという強力な機能を持っています。これにより、ETLプロセスを簡素化できますが、同時にどのようなデータをVARIANT型で保持し、どこで構造化するかというモデリングの判断が重要になります。不適切な利用は、クエリの複雑化やパフォーマンス低下を招きます。

- データの民主化と信頼性: 現代のビジネスでは、データは経営層から現場の担当者まで、あらゆる部門で活用されます。一貫性があり、理解しやすいデータ構造は、データの信頼性を高め、セルフサービスBIツールでの活用を促進し、データに基づいた意思決定を加速させます。モデリングが不十分だと、ユーザーはどのデータを使えばよいか迷い、誤った分析結果を導き出すリスクが高まります。

最適なデータ構造がもたらすメリット(クエリ性能、保守性、理解容易性)

Snowflakeにおける最適なデータモデリングは、単にデータを整理するだけでなく、貴社のデータ活用全体にわたって多大なメリットをもたらします。

クエリ性能の向上とコスト削減

適切なデータモデリングは、Snowflakeの強力なクエリエンジンを最大限に活用し、クエリの実行時間を大幅に短縮します。例えば、スター・スキーマやスノーフレーク・スキーマといった次元モデリングの手法は、ビジネスユーザーが直感的に分析しやすい構造を提供しつつ、JOIN操作を効率化します。また、Snowflakeのマイクロパーティションや自動クラスタリング機能を考慮した設計は、特定のフィルタリングや集計クエリのパフォーマンスを劇的に向上させます。

私たちが支援した某製造業A社では、Snowflake導入当初、データモデリングが不十分なために特定のレポートクエリに数時間を要していました。私たちがデータモデリングを見直し、適切なクラスタリングキーの設定と非正規化戦略を導入した結果、同一クエリの実行時間を90%短縮し、コンピューティングコストを月間25%削減できました。これにより、データ分析の頻度を増やし、より迅速な意思決定が可能になりました。

保守性の向上と開発効率の最適化

データモデリングは、データ基盤の長期的な保守性にも大きく貢献します。適切に設計されたデータモデルは、データの冗長性を排除し、整合性を保ちやすくします。スキーマ変更が発生した場合でも、影響範囲が限定的であるため、システムの安定性を損なうことなく迅速に対応できます。これは、データエンジニアリングチームの開発効率を向上させ、新しいデータソースの統合や機能追加をスムーズに進める上で不可欠です。

また、明確なデータモデルは、データパイプラインの設計やETL/ELTプロセスの開発を簡素化します。データがどのように流れ、どのように変換されるべきかが一目でわかるため、開発者は迷うことなく実装を進められます。

データの理解容易性とガバナンスの強化

「データは新しい石油」と言われる現代において、データは組織全体の資産です。データモデリングは、この資産を誰もが理解しやすく、利用しやすい形に整える役割を担います。ビジネスユーザーが直感的にデータ構造を把握できれば、BIツールでのセルフサービス分析が促進され、データリテラシーの向上にもつながります。

さらに、明確なデータモデルはデータガバナンスの基盤となります。どのデータがどこにあり、どのような意味を持つのかが定義されることで、データの品質管理、セキュリティ、プライバシー保護といったガバナンス活動を効果的に推進できます。これにより、データ利用におけるリスクを低減し、コンプライアンス要件への対応も容易になります。

Snowflakeデータモデリングのベストプラクティス

データ基盤設計において、データモデリングはシステムの性能、拡張性、そして運用負荷を大きく左右する重要な要素です。クラウドデータウェアハウスであるSnowflakeでは、その柔軟性とスケーラビリティを最大限に引き出すためのモデリング戦略が求められます。

ここでは、貴社のデータ基盤を効率化し、長期的な運用負荷を軽減するためのSnowflakeデータモデリングにおけるベストプラクティスを具体的に紹介します。

スター・スノーフレークスキーマの適用と使い分け

データウェアハウスの古典的かつ最も広く採用されているモデリング手法が、スター・スキーマとスノーフレーク・スキーマです。これらは、分析クエリの高速化とデータの一貫性維持に優れています。

- スター・スキーマ: 中央にファクトテーブルを配置し、その周囲に非正規化されたディメンションテーブルが「星」のように直接接続される構造です。シンプルで理解しやすく、結合が少ないためクエリパフォーマンスに優れます。

- スノーフレーク・スキーマ: スター・スキーマのディメンションテーブルをさらに正規化し、複数の関連ディメンションテーブルに分解した構造です。データの重複を減らし、ストレージ効率を高めますが、結合が増えるためクエリが複雑になりがちです。

Snowflake環境では、ストレージコストが安価であり、強力なクエリエンジンが複雑な結合も効率的に処理するため、必ずしも厳密な正規化にこだわる必要はありません。どちらのスキーマを選択するかは、データの特性、クエリの要件、および運用チームのスキルレベルによって異なります。

一般的には、シンプルなレポートやダッシュボードにはスター・スキーマが適しており、複雑な分析や詳細な属性を扱う場合にはスノーフレーク・スキーマが有利です。ただし、Snowflakeのパフォーマンス特性を考慮すると、過度な正規化はかえってクエリ性能を低下させる可能性もあるため注意が必要です。

| 特徴 | スター・スキーマ | スノーフレーク・スキーマ |

|---|---|---|

| 構造 | ファクトテーブルと非正規化されたディメンションテーブル | ファクトテーブルと正規化されたディメンションテーブル(階層構造) |

| クエリ性能 | 高速(シンプルな結合) | やや低速(多くの結合が必要になる場合がある) |

| ストレージ効率 | 低い(データの重複が多い) | 高い(データの重複が少ない) |

| メンテナンス性 | 容易(構造がシンプル) | やや複雑(多くのテーブルと結合関係) |

| 適用シーン | シンプルな分析レポート、ダッシュボード | 複雑な分析、詳細な属性管理、データ品質重視 |

データボールトモデリングによる履歴管理と柔軟性

データボールトは、企業全体のデータを統合し、履歴を完全に保持しながら、構造変更に柔軟に対応できるモデリング手法です。特に、頻繁にデータソースが追加・変更されるエンタープライズ環境や、監査要件が厳しい業界でその真価を発揮します。

データボールトは、以下の3つの主要なコンポーネントで構成されます。

- ハブ(Hub): ビジネスエンティティ(顧客、製品など)の一意なキーを格納します。変更されることのないビジネスキーを管理し、データの一貫性を保証します。

- リンク(Link): ハブ間の関係性を表現します。複数のハブのビジネスキーと、その関係がいつ発生したかを示す日付を格納します。

- サテライト(Satellite): ハブやリンクの属性情報(記述的データ)と、その属性がいつ有効になったか(開始日)を格納します。属性の変更履歴は、新しいサテライトレコードを追加することで完全に保持されます。

Snowflakeでデータボールトを実装する最大の利点は、そのスケーラビリティと半構造化データへの対応能力です。サテライトテーブルにVARIANT型を利用することで、ソースシステムからの多様な属性変更を柔軟に取り込み、スキーマ変更の影響を最小限に抑えることができます。また、Snowflakeの強力なストレージとコンピュートリソースは、大量の履歴データを効率的に管理し、必要な時に高速にクエリすることを可能にします。

データボールトは、初期設計に手間がかかるものの、長期的に見ればデータ統合のコストを削減し、データガバナンスを強化する強力なツールとなります。

アンカーモデリングによるアジャイルなデータ構造

アンカーモデリングは、データボールトと同様に、履歴管理と構造変更への柔軟性を重視したモデリング手法ですが、よりアジャイルなアプローチを特徴とします。エンティティ(アンカー)とそれに関連する属性(アトリビュート)、関係性(タイ)、階層(ノード)を最小限のテーブルで表現し、必要に応じて新しい属性や関係を追加していく設計思想です。

データボールトが「ハブ、リンク、サテライト」という固定されたコンポーネントを持つ一方、アンカーモデリングは「アンカー、アトリビュート、タイ、ノード」という、より抽象的で拡張性の高いコンポーネントを使用します。これにより、データ構造の変更が必要になった際にも、既存のテーブル構造に大きな影響を与えることなく、新しいテーブルを追加するだけで対応できるため、迅速な開発とデプロイが可能です。

Snowflake環境では、その柔軟なテーブル定義とスケーラブルなストレージがアンカーモデリングのメリットをさらに引き出します。特に、開発サイクルの速いスタートアップ企業や、ビジネス要件の変化が激しいプロジェクトにおいて、アンカーモデリングは非常に有効な選択肢となり得ます。

| 比較項目 | データボールトモデリング | アンカーモデリング |

|---|---|---|

| 設計思想 | 履歴保持、監査対応、データ統合 | アジャイル開発、構造変更容易性 |

| 主要コンポーネント | ハブ、リンク、サテライト | アンカー、アトリビュート、タイ、ノード |

| テーブル数 | エンティティや関係性の数に応じて増加 | エンティティや関係性の数に応じて増加するが、より抽象化 |

| スキーマ変更 | サテライトの追加で柔軟に対応 | 新しいアトリビュート/タイテーブルの追加で柔軟に対応 |

| 学習曲線 | やや高い | やや高い(概念の抽象度が高いため) |

| 適した環境 | 大規模DWH、厳格な監査要件、履歴管理重視 | アジャイル開発、頻繁な要件変更、小規模〜中規模DWH |

半構造化データ(JSON/XML)の取り扱いと最適化

現代のビジネスデータは、リレーショナルデータベースに格納される構造化データだけでなく、Webログ、IoTデータ、APIレスポンスなど、JSONやXMLといった半構造化データが大きな割合を占めます。Snowflakeは、この半構造化データの取り扱いに非常に優れた能力を発揮します。

SnowflakeのVARIANT型は、JSON、XML、Avro、Parquetなどの半構造化データをそのまま格納できます。これにより、データのロード前に厳密なスキーマ定義を行う必要がなくなり、データ取り込みのプロセスを大幅に簡素化できます。また、FLATTEN関数やドット表記、配列インデックスなどを用いて、VARIANT型内部の要素をSQLで直接クエリ・変換できるため、分析の柔軟性が飛躍的に向上します。

しかし、半構造化データを効率的に利用するためには、いくつかの最適化プラクティスを適用することが重要です。

- 必要な要素のみを抽出: クエリで頻繁に利用するJSON/XML内のキーは、別途構造化されたカラムとして抽出(マテリアライズ)することを検討します。これにより、VARIANT型全体をスキャンするオーバーヘッドを削減できます。

- ビューの活用: 複雑な

FLATTENやJSONパスの抽出ロジックは、ビューとして定義しておくことで、再利用性と可読性を高めます。 - クラスタリングキーの検討: 大量の半構造化データを扱う場合、クエリで頻繁にフィルタリングされる要素をクラスタリングキーとして設定することで、マイクロパーティションのプルーニング(剪定)を最適化し、クエリパフォーマンスを向上させることができます。

- データ型の明示的なキャスト: JSON内の数値や日付は、VARIANT型では文字列として扱われることがあります。分析の際には、

::NUMBERや::DATEのように明示的に型変換を行うことで、正しい比較や演算が可能になり、パフォーマンスも向上します。

これらのプラクティスを適用することで、貴社は半構造化データをSnowflake上で効率的に管理・分析し、データ活用をさらに推進できるでしょう。

データレイクハウス戦略とSnowflakeの融合

データレイクハウスは、データレイクの柔軟性とデータウェアハウスの構造化された管理能力を融合させた新しいデータアーキテクチャです。大量の生データを安価に保存しつつ、データウェアハウスのような高いクエリ性能とデータガバナンスを実現します。

Snowflakeは、まさにこのデータレイクハウス戦略を実現するための理想的なプラットフォームです。Snowflakeがデータレイクハウスとして機能する主な理由は以下の通りです。

- マルチフォーマット対応: 構造化データはもちろん、JSON、XML、Parquetなどの半構造化データ、さらに画像や動画などの非構造化データ(外部ステージ経由)もS3やAzure Blob Storageなどのクラウドストレージに保存し、Snowflakeから直接クエリ・分析が可能です。

- 強力なSQLエンジン: データの種類や保存場所に関わらず、標準SQLで一貫したデータアクセスと分析が可能です。複雑なデータ変換やETL/ELT処理もSQLで実行できます。

- 分離されたコンピュートとストレージ: ストレージとコンピュートが独立しているため、データレイクに保存された大量のデータを、分析要件に応じて柔軟にスケーリングする仮想ウェアハウスで処理できます。

- データガバナンスとセキュリティ: ロールベースのアクセス制御、データマスキング、行レベルセキュリティなど、データウェアハウスと同等の堅牢なセキュリティ機能を提供し、データレイクハウス全体のデータガバナンスを強化します。

- オープンフォーマットへの対応: Apache IcebergやDelta Lakeといったオープンなテーブルフォーマットとの連携も進んでおり、ベンダーロックインのリスクを低減しつつ、より広範なデータエコシステムとの統合を可能にします(出典:Snowflake公式ドキュメント)。

貴社がSnowflakeをデータレイクハウスとして活用することで、データサイロを解消し、あらゆるデータソースからの情報を統合的に分析し、ビジネスインサイトの発見を加速させることが可能になります。

【自社事例・独自見解】Aurantが推奨するハイブリッドモデリング戦略

データモデリングの手法は多岐にわたり、それぞれにメリットとデメリットがあります。私たちは、単一のモデリング手法に固執するのではなく、貴社のビジネス要件、データの特性、そして将来的な拡張性を考慮した「ハイブリッドモデリング戦略」をSnowflake環境で推奨しています。

当社の経験では、以下のような組み合わせが多くの企業で効果を発揮しています。

- 生データ層(Raw Data Layer):

- ソースシステムから取り込んだ生データをそのまま格納します。特に半構造化データ(JSON/XML)は、SnowflakeのVARIANT型を最大限に活用し、スキーマオンリードのアプローチで柔軟に取り込みます。

- これにより、データ取り込みの速度を最大化し、ソースシステムの変更に強く、将来的な分析要件の変化にも対応できる基盤を構築します。

- 統合データ層(Integrated Data Layer):

- 生データ層から変換・統合されたデータを格納します。ここでは、履歴管理と構造変更への柔軟性を重視し、データボールトモデリングやアンカーモデリングを適用します。

- これにより、企業のビジネスエンティティと関係性を一貫した形で管理し、長期的なデータガバナンスと監査要件に対応できる信頼性の高いデータソースを提供します。

- 分析データ層(Analytical Data Layer):

- 統合データ層から、特定のビジネス部門や分析目的に合わせて最適化されたデータを格納します。ここでは、分析クエリのパフォーマンスを最優先し、スター・スキーマやスノーフレーク・スキーマを適用したデータマートを構築します。

- BIツールやレポート作成ツールからのアクセスを考慮し、非正規化を進めることで、エンドユーザーが直感的に利用できるデータを提供します。

このハイブリッド戦略は、Snowflakeの柔軟なデータ型サポート、強力なクエリエンジン、および分離されたコンピュートとストレージのアーキテクチャを最大限に活用します。各層の役割を明確にすることで、データパイプライン全体の複雑性を管理しつつ、異なるビジネスニーズに対応できる多層的なデータ基盤を実現できます。

貴社の現状の課題、データの種類、将来的な目標を深く理解した上で、最も効果的なモデリング戦略を共に策定し、データ基盤の設計から運用までを一貫して支援することが私たちの強みです。

データ基盤設計の効率化を実現するSnowflake活用術

データ基盤の設計と運用は、多くの企業にとって複雑で負荷の高い課題です。しかし、Snowflakeが提供する革新的な機能とアプローチを活用することで、これらの課題を劇的に軽減し、データ活用を加速できます。ここでは、データ基盤設計の効率化と運用負荷軽減を実現するための具体的なSnowflake活用術を解説します。

ELTアプローチによるデータパイプラインの簡素化

従来のデータウェアハウスでは、ETL(Extract, Transform, Load)アプローチが主流でした。これは、データを抽出(Extract)し、専用のETLツールで変換(Transform)してから、データウェアハウスにロード(Load)する方式です。しかし、この方式では、変換処理のボトルネックや、データソース変更時のETLロジックの複雑化が課題となりがちでした。

Snowflakeは、その柔軟なスケーラビリティと高性能なSQL処理能力を最大限に活かし、ELT(Extract, Load, Transform)アプローチを強力に推進します。ELTでは、まずデータをSnowflakeにそのままロード(Load)し、その後、Snowflakeのコンピューティングリソースを使ってSQLで変換(Transform)を行います。これにより、専用のETLツールが不要になり、データパイプラインが大幅に簡素化されます。

ELTアプローチのメリットは多岐にわたります。データロードを高速化できるだけでなく、変換ロジックをSQLで記述できるため、データエンジニアリングの生産性が向上します。また、Snowflakeのコンピュートリソースを必要な時に必要なだけスケールできるため、変換処理のパフォーマンスボトルネックを解消し、データ量や複雑性に応じた柔軟な対応が可能になります。これにより、データパイプラインの構築とメンテナンスにかかる時間とコストを削減し、ビジネス要件の変化に迅速に対応できるようになります。

私たちが支援した某小売業のケースでは、既存のETLプロセスが特定の時間帯に集中し、処理遅延が発生していました。SnowflakeへのELT移行を支援した結果、データロードが数時間から数十分へと短縮され、ビジネスインテリジェンスレポートの生成時間が大幅に改善されました。

| 特徴 | ETLアプローチ | ELTアプローチ(Snowflake活用) |

|---|---|---|

| 処理順序 | 抽出 → 変換 → ロード | 抽出 → ロード → 変換 |

| 変換場所 | 専用ETLツールまたはステージング環境 | データウェアハウス内(Snowflake) |

| パフォーマンス | ETLツールの性能に依存、ボトルネック発生の可能性 | Snowflakeのスケーラビリティにより高速処理 |

| 柔軟性 | 変換ロジック変更時にETLツールでの再構築が必要 | SQLベースで柔軟に変換、変更が容易 |

| コスト | ETLツールライセンス、専用サーバー費用 | Snowflakeのコンピュート費用のみ(従量課金) |

| 保守性 | ETLツールの専門知識が必要、ロジックがブラックボックス化しがち | SQLベースで可読性が高く、データエンジニアが管理しやすい |

Zero-Copy CloningとTime Travelによる開発・テスト環境の迅速構築

データ基盤の開発やテストにおいて、本番環境と同等のデータを準備することは、時間とコストがかかる大きな課題です。特に、大規模なデータセットの場合、データのコピーやマスキングには膨大なリソースと時間が費やされます。SnowflakeのZero-Copy CloningとTime Travelは、この課題を根本的に解決し、開発・テストサイクルを劇的に加速させます。

- Zero-Copy Cloning:

Zero-Copy Cloningは、既存のデータベース、スキーマ、またはテーブルの完全なコピーを瞬時に作成する機能です。その名の通り、物理的なデータコピーは行われず、メタデータのみをコピーします。これにより、ストレージ容量を消費することなく、数秒で数テラバイト規模のデータセットのクローンを作成できます。開発者は、本番環境と全く同じデータセットを基に、独立した環境で安心して開発やテストを進めることが可能です。これにより、データマスキングやデータ匿名化のプロセスが不要になり、開発効率が飛躍的に向上します。

- Time Travel:

Time Travelは、過去の任意の時点のデータにアクセスできる機能です。誤ってデータを削除したり、変更したりした場合でも、簡単に以前の状態に復元できます。これは、開発中の誤操作からのリカバリだけでなく、特定の時点のデータを使用してテストを行う「時点分析」にも非常に有効です。例えば、過去の特定期間のキャンペーンデータを再現し、新しい分析モデルの検証を行うといった用途が考えられます。

これらの機能を組み合わせることで、貴社は以下のようなメリットを享受できます。

- 開発・テスト環境の迅速なプロビジョニング: 数分で本番同等のテスト環境を構築可能。

- ストレージコストの削減: 物理的なデータコピーが不要なため、ストレージ費用を大幅に削減。

- データ整合性の確保: 常に最新の本番データに近い環境でテストできるため、本番移行時のリスクを低減。

- リカバリ能力の向上: 誤操作やデータ破損からの迅速な復旧。

当社の経験では、Zero-Copy CloningとTime Travelを活用することで、某金融機関の開発チームがテスト環境の準備にかかる時間を従来の数日から数時間に短縮し、年間で約30%の開発リードタイム短縮を実現しました。

| 機能 | 主な活用シーン | 得られるメリット |

|---|---|---|

| Zero-Copy Cloning | 開発・テスト環境の構築、サンドボックス環境の提供、データ分析用コピー作成、データマスキング後のテストデータ準備 | 環境構築時間の劇的な短縮、ストレージコスト削減、本番データ整合性の確保、開発効率向上 |

| Time Travel | 誤ったデータ変更からの復旧、過去の時点のデータ分析、監査証跡の確保、特定の時点でのテストデータ再現 | データ復旧の迅速化、過去データ検証の容易化、データガバナンス強化、開発・テストの柔軟性向上 |

Dynamic TablesとStreamによるリアルタイムデータ処理

ビジネスの意思決定を迅速化するためには、リアルタイムに近いデータ分析が不可欠です。Snowflakeは、Dynamic TablesとStreamという機能を通じて、このリアルタイムデータ処理のニーズに応えます。

- Stream:

Streamは、テーブルに加えられた変更(挿入、更新、削除)をキャプチャし、その変更履歴を追跡するオブジェクトです。これにより、データウェアハウス内の特定のテーブルに対して発生した変更を効率的に検出し、増分処理を容易にします。例えば、基幹システムのトランザクションデータがSnowflakeにロードされるたびに、Streamがその変更を認識し、ダウンストリームの集計テーブルやマートに差分データのみを適用するといった処理が可能です。これにより、大量のデータを毎回処理することなく、必要な変更のみを効率的に反映させることができます。

- Dynamic Tables:

Dynamic Tablesは、宣言的なSQLクエリに基づいて自動的に更新されるテーブルです。ソーステーブルの変更を検出し、その変更に基づいて自身を最新の状態に保ちます。これにより、複雑なデータパイプラインやETLジョブを構築・管理することなく、リアルタイムに近いビューや集計テーブルを維持できます。開発者は、更新ロジックをSQLで記述するだけでよく、Snowflakeがその依存関係を自動的に管理し、効率的な更新プランを実行します。これは、データマートの構築や、リアルタイムダッシュボードの基盤として非常に強力な機能です。

これらの機能を組み合わせることで、貴社は以下のようなメリットを享受できます。

- リアルタイムに近いデータ提供: 最新のデータに基づいた迅速な意思決定を支援。

- データパイプラインの簡素化: 手動での増分処理ロジックやスケジューリングが不要。

- 運用負荷の軽減: 自動更新により、データエンジニアの監視・メンテナンス作業を削減。

- 開発効率の向上: 宣言的なSQLでデータ変換を記述できるため、開発時間が短縮。

業界では、ECサイトのリアルタイム在庫分析やパーソナライズされた顧客体験提供、金融業界での不正検知システムなど、様々な分野でこれらの機能が活用され始めています(出典:Snowflake公式ドキュメント)。

| 機能 | 概要 | メリット |

|---|---|---|

| Stream | テーブルへの変更(挿入、更新、削除)をキャプチャし、変更履歴を追跡するオブジェクト。 | 増分データ処理の効率化、変更データキャプチャ(CDC)の実装容易化、データパイプラインの複雑性軽減。 |

| Dynamic Tables | 宣言的なSQLクエリに基づき、ソーステーブルの変更を検知して自動的に更新されるテーブル。 | リアルタイムに近いデータマートの自動構築、ETL/ELTパイプラインの簡素化、運用負荷の軽減、開発効率の向上。 |

外部ツール連携による自動化(dbt, Airflowなど)

Snowflakeの強力な機能と合わせて、データ基盤の設計と運用をさらに効率化するためには、外部ツールの活用が不可欠です。特に、データ変換のモジュール化とパイプラインのオーケストレーションは、大規模なデータ基盤において中心的な役割を果たします。

- dbt (data build tool):

dbtは、データ変換ロジックをSQLで記述し、バージョン管理、テスト、ドキュメント生成までを一元的に行うツールです。Snowflakeとdbtを組み合わせることで、データマートや集計テーブルの構築プロセスをコード化し、データ変換の信頼性と再現性を高めることができます。dbtは、ELTアプローチにおける「Transform」フェーズを強力に支援し、データエンジニアリングのベストプラクティスを導入する上で不可欠なツールとなっています。これにより、データ変換の品質が向上し、開発サイクルが短縮されます。

- Apache Airflow (または他のワークフローオーケストレーションツール):

Airflowは、データパイプラインのワークフローをプログラムによって定義、スケジュール、監視するためのプラットフォームです。Snowflakeと連携させることで、データロード、dbtによる変換処理、BIツールへのデータ連携など、一連のデータ処理プロセスを自動化し、依存関係を管理できます。Airflowの豊富なコネクタと柔軟なスケジューリング機能により、複雑なデータ基盤全体を効率的に運用することが可能になります。これにより、手動でのジョブ実行や監視が不要となり、運用ミスを削減し、データ提供の安定性を高めます。

これらのツールを連携させることで、貴社は以下のようなメリットを享受できます。

- 開発の標準化と効率化: SQLベースのコード化により、データ変換ロジックの再利用と共有が容易に。

- データ品質の向上: 自動テストとバージョン管理により、データ品質と信頼性を確保。

- 運用負荷の軽減: パイプラインの自動実行と監視により、手動作業を大幅に削減。

- スケーラビリティの確保: 大規模なデータ基盤でも効率的な運用が可能。

多くの企業が、Snowflakeを核としたデータプラットフォームにおいて、dbtとAirflowを組み合わせることで、データエンジニアリングの生産性を向上させています(出典:Fivetran、Databricksなどのパートナー事例)。

| ツール | 主な役割 | Snowflake連携によるメリット |

|---|---|---|

| dbt (data build tool) | データ変換ロジックのコード化、バージョン管理、テスト、ドキュメント生成。 | Snowflake内でのSQL変換を効率化、データモデルの信頼性向上、開発プロセスの標準化。 |

| Apache Airflow | データパイプラインのワークフロー定義、スケジュール、実行、監視。 | データロードから変換、BI連携までの一連の処理を自動化、依存関係の管理、運用ミスの削減。 |

| Fivetran / Stitchなど | SaaSアプリケーションからのデータ抽出・ロードの自動化。 | 様々なデータソースからSnowflakeへのデータ取り込みを高速化・自動化、データエンジニアの負担軽減。 |

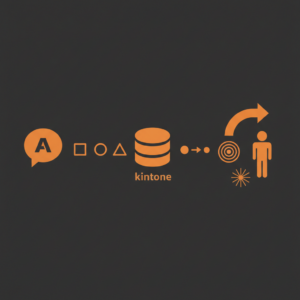

kintone連携による業務データ統合と効率化

企業の業務プロセスにおいてkintoneのようなローコードプラットフォームは、部門ごとの業務効率化に大きく貢献します。しかし、kintone内に点在する業務データは、全社横断的な分析や、他の基幹システムデータとの統合分析が難しいという課題を抱えがちです。ここでSnowflakeとkintoneの連携が真価を発揮します。

kintoneのデータをSnowflakeに統合することで、貴社は以下のようなメリットを享受できます。

- 全社横断的なデータ分析:

kintoneで管理されている顧客管理、営業進捗、プロジェクト管理などの業務データをSnowflakeに集約することで、販売データ、マーケティングデータ、会計データといった他の基幹システムデータと統合し、全社レベルでの多角的な分析が可能になります。例えば、kintoneの営業案件データと会計システムの売上データを組み合わせ、営業活動が実際の売上にどれだけ貢献しているかを詳細に分析できます。

- データドリブンな業務改善:

統合されたデータは、BIツール(Tableau, Power BIなど)と連携することで、リアルタイムに近いダッシュボードやレポートとして可視化できます。これにより、各部門の業務状況を客観的なデータに基づいて把握し、ボトルネックの特定や改善策の立案をデータドリブンに進めることができます。

- 運用負荷の軽減とデータガバナンス強化:

kintoneからSnowflakeへのデータ連携を自動化することで、手動でのデータエクスポート・インポート作業が不要となり、運用負荷が軽減されます。また、Snowflakeの高いセキュリティとデータガバナンス機能により、kintoneデータの安全な管理と利用を実現できます。

私たちが支援した某製造業A社では、全国の営業拠点からkintoneに登録される顧客訪問記録や商談進捗データをSnowflakeに統合しました。これにより、以前は個別で行っていた各拠点の営業活動分析を全社で一元化し、マーケティング施策と営業活動の相関関係を可視化。結果として、営業戦略の精度向上とリード獲得コストの最適化に貢献しました。

kintoneとSnowflakeの連携は、貴社の業務データに新たな価値をもたらし、データ活用によるビジネス成長を強力に後押しします。

| kintoneデータ統合のメリット | 具体的な活用例 |

|---|---|

| 全社横断分析の実現 | 営業案件データ(kintone)と売上データ(基幹システム)を統合し、営業活動の貢献度を分析。 |

| BIツール連携による可視化 | kintoneのプロジェクト進捗データをBIツールで可視化し、リアルタイムでプロジェクト状況を把握。 |

| データドリブンな意思決定 | 顧客サポート履歴(kintone)と製品利用データ(IoT)を統合し、顧客満足度向上に向けた改善策を立案。 |

| 運用負荷の軽減 | kintoneからのデータエクスポート・インポート作業を自動化し、手動作業によるミスを削減。 |

| データガバナンス強化 | Snowflakeのセキュリティ機能により、機密性の高いkintoneデータを安全に管理・利用。 |

運用負荷を軽減し、持続可能なデータ基盤を構築する

データ基盤は一度構築すれば終わりではありません。ビジネスの変化に対応し、長期的に価値を提供し続けるには、構築後の運用フェーズにおける負荷軽減と持続可能性の確保が不可欠です。ここでは、Snowflakeを活用したデータ基盤の運用を最適化し、将来にわたって貴社のビジネスを支えるための具体的なアプローチを紹介します。

リソースモニタリングとコスト管理の最適化

Snowflakeは従量課金制であるため、リソースの利用状況を正確に把握し、コストを最適化することが運用負荷軽減の鍵となります。Snowflakeが提供する組み込み機能やベストプラクティスを活用することで、無駄な支出を削減しつつ、必要なパフォーマンスを維持することが可能です。

- Virtual Warehouseの適正化: ワークロードに応じてVirtual Warehouseのサイズを柔軟に変更し、必要な時だけスケールアップ・スケールアウトすることで、コンピューティングコストを最適化します。例えば、日中の分析業務にはMサイズ、夜間のバッチ処理にはLサイズといった使い分けが有効です。

- Resource Monitorの活用: クレジット消費の上限を設定し、しきい値を超えた際にアラートを送信したり、ウェアハウスを自動停止させたりすることで、予期せぬコスト増大を防ぎます。

- クエリの最適化: パフォーマンスの低いクエリを特定し、インデックスの利用(Snowflakeでは自動最適化機能が強力ですが、JOIN順序やフィルタリングの最適化は依然として重要です)や、マテリアライズドビューの導入などにより、実行時間を短縮し、結果としてコンピューティングリソースの消費を抑えます。

- キャッシュの活用: Snowflakeの強力なキャッシュ機構(Result Cache, Data Cache)を最大限に活用できるよう、クエリパターンを考慮したデータアクセス設計を行うことも重要です。

業界の調査によれば、データウェアハウスのクラウド移行後、コスト管理の課題に直面する企業は少なくありません。しかし、適切なモニタリングと最適化戦略を導入することで、多くの企業がコスト削減を実現しています。例えば、ある調査では、クラウドデータウェアハウスの最適化によって平均で20%以上のコスト削減効果が得られると報告されています(出典:Flexera 2023 State of the Cloud Report)。

| 戦略 | 具体的なアプローチ | 期待される効果 |

|---|---|---|

| Virtual Warehouseの適正化 | ワークロードに応じたサイズ調整、自動サスペンド/レジューム設定 | コンピューティングコストの20〜40%削減、ピーク時性能維持 |

| Resource Monitorの導入 | クレジット消費上限設定、アラート通知、自動停止 | 予算超過リスクの回避、予期せぬコスト増大の防止 |

| クエリ最適化 | 非効率なクエリの改善、マテリアライズドビュー活用 | クエリ実行時間の短縮、コンピューティングリソース消費の抑制 |

| ストレージ最適化 | 不要なデータのアーカイブ/削除、データ圧縮 | ストレージコストの削減、パフォーマンス向上 |

データガバナンスとセキュリティ(ロールベースアクセス制御、マスキングなど)

データ基盤の運用において、データガバナンスとセキュリティは極めて重要です。特に機密性の高いデータを扱うBtoB企業では、適切なアクセス制御とデータ保護メカニズムの導入が企業の信頼性を左右します。Snowflakeは、堅牢なセキュリティ機能を提供しており、これらを活用することで高いレベルのデータガバナンスを実現できます。

- ロールベースアクセス制御(RBAC): ユーザーの職務や役割に基づいて、データやオブジェクトへのアクセス権限を細かく設定します。これにより、必要なユーザーのみが必要なデータにアクセスできるようになり、情報漏洩のリスクを最小限に抑えます。例えば、マーケティング担当者には顧客の行動データへのアクセスを許可し、経理担当者には財務データへのアクセスを許可するといった制御が可能です。

- ダイナミックデータマスキング: 機密性の高いデータ(例:個人情報、財務情報)を、アクセスするユーザーのロールに応じて動的にマスキングする機能です。これにより、データ自体を複製することなく、異なるユーザーグループに対して異なる粒度でデータを提供できます。例えば、特定のロールを持つユーザーには氏名が表示され、それ以外のユーザーには「***」と表示されるように設定できます。

- 行レベルセキュリティ(RLS): 特定のユーザーやロールに対して、テーブルの特定行のみを表示する機能です。これにより、マルチテナント環境や、組織内の部門ごとにアクセス可能なデータを制限するシナリオで非常に有効です。

- 監査ログと変更履歴: Snowflakeは、すべてのデータアクセスと変更操作に関する詳細な監査ログを自動で記録します。これにより、誰が、いつ、どのデータにアクセスし、どのような変更を加えたかを追跡でき、内部監査やコンプライアンス要件への対応を支援します。

これらの機能を適切に設定・運用することで、データ利用の透明性を高め、不正アクセスやデータ改ざんのリスクを大幅に低減できます。私たちは、貴社の組織構造とデータ利用ポリシーに合わせた最適なガバナンスモデルの設計を支援します。

継続的な改善とドキュメンテーションの重要性

データ基盤は生き物です。ビジネス要件の変化、データソースの追加、ユーザーニーズの進化に伴い、データモデルも継続的に改善していく必要があります。このプロセスを円滑に進めるためには、適切なドキュメンテーションが不可欠です。

- アジャイルなデータモデリング: 一度の完璧な設計を目指すのではなく、小さく始めてフィードバックを基に反復的に改善していくアジャイルなアプローチが有効です。これにより、ビジネスの変化に迅速に対応し、データ基盤の価値を最大化できます。

- データカタログとデータリネージ: どのようなデータがどこにあり、どのような意味を持つのか、どのように加工されたのかを明確にするデータカタログとデータリネージは、データ利用者がデータを信頼し、適切に活用するための基盤となります。これにより、データの「民主化」を促進し、セルフサービスBIの導入を加速します。

- 運用チームとの連携: データ基盤の開発チームと運用チームが密接に連携し、課題や改善点を共有する文化を醸成することが重要ですし、定期的なレビュー会議やナレッジ共有を通じて、運用負荷の軽減とパフォーマンス向上を図ります。

BIツール連携によるデータ可視化と運用監視の効率化

Snowflakeで構築されたデータ基盤の価値を最大限に引き出すためには、BIツールとのシームレスな連携が不可欠です。主要なBIツール(Tableau, Power BI, Lookerなど)はSnowflakeとのネイティブコネクタを提供しており、これらのツールを活用することで、データ可視化と運用監視を効率化できます。

BIツールを活用した運用監視ダッシュボードを構築することで、Snowflakeのクレジット消費状況、クエリ実行時間、ストレージ利用量などのメトリクスをリアルタイムで可視化できます。これにより、異常なリソース消費やパフォーマンス低下を早期に検知し、迅速な対応が可能となります。

例えば、日次でクレジット消費が急増しているウェアハウスを特定したり、特定のユーザーグループからのクエリが過剰なリソースを消費していないかを分析したりすることで、コスト最適化の具体的なアクションプランを策定できます。また、データ品質監視ダッシュボードを構築することで、データの欠損、重複、整合性エラーなどを早期に発見し、データ品質の維持・向上に貢献します。

会計DXにおけるデータ連携と監査対応

会計分野におけるデジタルトランスフォーメーション(DX)は、企業経営の透明性と効率性を高める上で極めて重要です。Snowflakeは、多様な会計システムや業務システムからのデータ統合基盤として非常に強力な役割を果たします。これにより、財務データの集計、分析、レポーティングのプロセスを大幅に効率化し、より迅速で正確な経営判断を支援します。

会計DXにおけるSnowflakeの活用メリットは多岐にわたります。

- データ統合の一元化: 複数の会計システム(例:SAP, Oracle EBS, 会計クラウドサービス)や販売管理、生産管理システムからのデータを一元的にSnowflakeに集約し、統合されたビューを提供します。

- リアルタイムな財務分析: 統合されたデータを基に、リアルタイムに近い形で収益性分析、コスト分析、キャッシュフロー分析などを実行し、経営層への迅速な情報提供を可能にします。

- 監査対応の効率化: 会計データは厳格な監査要件に準拠する必要があります。Snowflakeの強力な監査ログ機能とデータリネージ機能は、データの発生源から最終的なレポートに至るまでの経路を追跡可能にし、監査証跡の提供を容易にします。また、データの変更履歴も詳細に記録されるため、改ざん防止と透明性の確保に貢献します。

- データ品質の向上: 会計データのクリーンアップ、標準化、整合性チェックをSnowflake上で実行することで、データ品質を向上させ、誤った経営判断のリスクを低減します。

私たちは、貴社の会計業務プロセスを深く理解し、Snowflakeを核とした会計DXの実現をサポートします。これにより、財務部門の業務効率化はもちろんのこと、企業全体のデータドリブン経営を強力に推進します。

Aurant Technologiesが提供するデータ活用支援

データ基盤の構築は、単なる技術導入に留まらず、貴社のビジネス戦略と深く結びつくものです。私たちAurant Technologiesは、Snowflakeの導入から運用、そしてデータ活用文化の定着まで、一貫した支援を提供しています。貴社が抱える具体的なビジネス課題を深く理解し、それらを解決するための最適なデータ基盤と戦略を共に構築します。

お客様のビジネス課題に合わせたSnowflake導入コンサルティング

Snowflakeはその柔軟性と拡張性から、多くの企業で採用が進んでいます。しかし、そのポテンシャルを最大限に引き出すためには、貴社のビジネスモデルや既存システム、将来的なビジョンを考慮した緻密な導入計画が不可欠です。私たちは、単なる技術的なアドバイスに留まらず、貴社の経営層・マーケティング担当者・業務システム担当者それぞれの視点から課題を抽出し、Snowflakeを軸とした最適なデータ戦略を策定します。

具体的には、以下のようなステップでコンサルティングを進めます。

- 現状分析と課題特定: 既存のデータ環境、データ活用の状況、ビジネス上のボトルネックを詳細にヒアリングし、Snowflake導入で解決すべき具体的な課題を特定します。

- 目標設定とロードマップ策定: 貴社のビジネス目標に合致するデータ活用目標を設定し、短期・中期・長期のロードマップを策定します。

- アーキテクチャ設計: Snowflakeの特性を最大限に活かし、貴社のデータ量、アクセス頻度、セキュリティ要件に合わせた最適なデータアーキテクチャを設計します。

- PoC(概念実証)支援: 実際のデータを用いてSnowflakeの有効性を検証し、具体的な効果測定と課題抽出を行います。これにより、本格導入前のリスクを最小限に抑えます。

- コスト最適化戦略: Snowflakeの柔軟な課金体系を理解し、貴社の利用状況に応じた最適なウェアハウスサイズ、自動サスペンド設定、クラスタリング戦略などを提案し、運用コストの最適化を図ります。

私たちのアプローチは、貴社がSnowflakeを「導入する」だけでなく、「ビジネス成果に繋げる」ことに主眼を置いています。

データモデリング設計から実装、運用までの一貫支援

データ基盤の「心臓部」とも言えるのがデータモデリングです。Snowflakeの特性を最大限に引き出すためには、従来のデータウェアハウスの常識にとらわれない、クラウドネイティブなアプローチが求められます。私たちは、貴社の多様なデータソース(RDB、SaaSデータ、ログデータ、半構造化データなど)をSnowflakeに統合し、分析しやすい形で構造化するためのデータモデリングを設計・実装します。

提供する支援内容は以下の通りです。

- Snowflakeに最適化されたデータモデリング: スター・スキーマ、スノーフレーク・スキーマ、Data Vaultなど、目的に応じた最適なモデリング手法を選定し、パフォーマンスと柔軟性を両立させます。特に半構造化データ(JSON, XMLなど)の取り込みと活用においては、VARIANT型やUDF(ユーザー定義関数)を駆使し、効率的な分析を可能にします。

- ELTパイプライン構築: Snowpipe、Streams、TasksといったSnowflakeのネイティブ機能を活用し、データ取り込みから変換、ロードまでを自動化する効率的なELT(Extract Load Transform)パイプラインを構築します。これにより、リアルタイムに近いデータ分析環境を実現します。

- データガバナンスとセキュリティ: データ品質管理、メタデータ管理、アクセス制御(RBAC: Role-Based Access Control)など、堅牢なデータガバナンス体制を構築します。データの機密性、完全性、可用性を確保し、安心してデータ活用を進められる環境を提供します。

- パフォーマンスチューニングと運用最適化: クエリの最適化、クラスタリングキーの選定、マテリアライズドビューの活用など、Snowflakeの機能を最大限に活用し、常に高いパフォーマンスを維持するためのチューニングを行います。また、監視体制の構築や運用プロセスの確立を支援し、運用負荷の軽減に貢献します。

私たちの専門家チームは、データモデリングのベストプラクティスを熟知しており、貴社のデータが真の価値を生み出すための基盤を構築します。

データ活用人材育成と組織文化変革のサポート

どんなに優れたデータ基盤を構築しても、それを使いこなせる人材がいなければ意味がありません。私たちは、貴社がデータ駆動型組織へと変革できるよう、技術導入だけでなく、人材育成と組織文化の醸成にも力を入れています。

主な支援内容は以下の通りです。

- 実践的なトレーニングプログラム: Snowflakeの基本的な操作から、SQLによるデータ抽出・分析、データ可視化ツールの活用方法まで、貴社の従業員のスキルレベルに合わせた実践的なトレーニングを提供します。

- データリテラシー向上支援: データ分析の基礎、統計的思考、ビジネスへのデータ適用方法など、全社的なデータリテラシー向上を目的としたワークショップやセミナーを実施します。

- CoE(Center of Excellence)構築支援: 社内にデータ活用を推進する中核組織(CoE)の立ち上げをサポートし、データ活用に関するベストプラクティスの共有、技術サポート、ガバナンスの維持を自律的に行えるよう支援します。

- データ駆動型文化の醸成: 経営層から現場まで、データに基づいた意思決定を促進する企業文化を醸成するための戦略立案と実行をサポートします。成功事例の共有や社内コミュニケーションの活性化を通じて、データ活用のモチベーションを高めます。

データは企業の重要な資産です。私たちは、貴社の従業員がその資産を最大限に活用し、ビジネス価値を創造できる人材へと成長できるよう、長期的な視点で伴走します。

【自社ソリューション連携】LINEを活用したデータ連携とマーケティング施策

現代のマーケティングにおいて、顧客との直接的なコミュニケーションチャネルは不可欠です。私たちは、Snowflakeを核としたデータ基盤と、国内で圧倒的な利用者数を誇るLINEを連携させることで、貴社のマーケティング施策を強力に推進します。

このソリューション連携により、以下のようなメリットが期待できます。

- 顧客データの一元化とセグメンテーション: Snowflakeに蓄積された購買履歴、ウェブサイト行動履歴、顧客属性などのデータをLINEのユーザーIDと紐付け、詳細な顧客プロファイルを構築します。これにより、精度の高い顧客セグメンテーションが可能になります。

- パーソナライズドメッセージ配信: セグメントされた顧客群に対し、Snowflakeで分析されたインサイトに基づき、LINE公式アカウントを通じて最適なタイミングでパーソナライズされたメッセージやクーポンを自動配信します。

- キャンペーン効果のリアルタイム測定: LINE上でのユーザーの反応(開封率、クリック率、コンバージョンなど)をSnowflakeにフィードバックし、キャンペーン効果をリアルタイムで分析・評価します。これにより、PDCAサイクルを高速化し、マーケティングROIを最大化します。

- CRM・SFA連携による顧客体験向上: 既存のCRMやSFAツールとSnowflakeを連携させ、LINEを通じた顧客とのインタラクション履歴を営業活動に活用。顧客一人ひとりに合わせたシームレスな体験を提供します。

私たちのアプローチは、データに基づいたOne to Oneマーケティングを実現し、顧客エンゲージメントの向上と売上拡大に貢献します。

【自社ソリューション連携】医療系データ分析におけるSnowflakeの活用とプライバシー保護

医療分野におけるデータ活用は、診断精度の向上、新薬開発の加速、経営効率化など計り知れない可能性を秘めています。しかし、その一方で、患者のプライバシー保護と機微情報の厳格な管理が不可欠です。私たちは、Snowflakeの堅牢なセキュリティ機能と当社の専門知識を組み合わせることで、医療系データの安全かつ効果的な分析を支援します。

医療系データ分析におけるSnowflake活用の特徴とプライバシー保護策は以下の通りです。

| 項目 | Snowflakeの機能と当社の支援内容 |

|---|---|

| データ暗号化 | 保存データ(At Rest)および転送データ(In Transit)は全て自動的に暗号化されます(AES-256)。Snowflakeの透過的な暗号化機能により、貴社は追加の管理負担なくデータを保護できます。 |

| アクセス制御(RBAC) | きめ細やかなロールベースのアクセス制御により、医療情報にアクセスできるユーザーやグループを厳密に管理します。データへのアクセス権限は最小限に抑え、不正アクセスリスクを低減します。 |

| データマスキング・トークン化 | 個人識別情報(PII)や保護医療情報(PHI)などの機微データに対して、動的データマスキングやトークン化を適用します。これにより、分析目的でデータを利用する際に、元の機微情報を表示することなく安全に処理できます。 |

| 匿名化・仮名化支援 | 統計分析や研究用途において、個人が特定できないようにデータを匿名化・仮名化するプロセスを支援します。差分プライバシーなどの高度な匿名化手法の導入も検討します。 |

| 監査ログとモニタリング | Snowflakeは全てのデータアクセスと操作を詳細な監査ログとして記録します。当社はこれらのログを定期的にモニタリングし、セキュリティポリシー違反や異常なアクティビティを早期に検知・報告します。 |

| コンプライアンス対応 | HIPAA(米国の医療情報保護法)、GDPR(EU一般データ保護規則)、日本の個人情報保護法など、関連する法規制や業界ガイドラインに準拠したデータ管理体制の構築を支援します。 |

私たちは、これらの技術的・運用的な側面から貴社の医療データ活用を支援し、倫理的かつ法的に適切な形で、医療の発展と患者ケアの向上に貢献できるよう尽力します。

まとめ:Snowflakeデータモデリングで未来のデータ基盤を築く

本記事の要約と主要な学び

本記事では、Snowflakeを活用したデータ基盤設計において、データモデリングがいかに効率化と運用負荷軽減の鍵を握るかについて、多角的に解説しました。Snowflakeのクラウドネイティブなアーキテクチャは、その柔軟性とスケーラビリティによって、従来のデータウェアハウスに比べてデータモデリングのアプローチに新たな可能性をもたらします。しかし、そのポテンシャルを最大限に引き出すためには、適切なモデリング手法の選択とベストプラクティスの適用が不可欠です。

主要な学びとして、まずSnowflakeの「分離されたコンピュートとストレージ」というアーキテクチャが、データモデリングにおいてパフォーマンスとコスト効率のバランスを最適化する上で重要であることを強調します。これにより、データロード、変換、クエリといった各フェーズで最適なリソース配分が可能になります。また、スタースキーマ、データボールト、レイクハウスパターンといった主要なモデリング手法の適用領域とメリット・デメリットを理解し、貴社のビジネス要件やデータ特性に合わせて適切に選択することの重要性も示します。

さらに、具体的なベストプラクティスとして、一貫性のある命名規則の確立、詳細なドキュメンテーションの徹底、CI/CDパイプラインによる変更管理と自動化、そしてデータガバナンスの強化が、データ基盤の健全な運用と長期的なスケーラビリティを保証するために不可欠です。これらの実践を通じて、データ品質を向上させ、データ活用における意思決定の精度を高めることが可能になります。

以下に、本記事で取り上げた主要なポイントと、それらが貴社のデータ基盤にもたらすメリットをまとめます。

| 主要な学び・実践 | 貴社にもたらすメリット | 解決される課題 |

|---|---|---|

| Snowflakeアーキテクチャの理解 (分離されたコンピュート/ストレージ) |

パフォーマンスとコスト効率の最適化、柔軟なリソース管理 | 高額な運用コスト、パフォーマンスボトルネック |

| 適切なデータモデリング手法の選択 (スタースキーマ、データボールト、レイクハウスパターンなど) |

ビジネス要件に合致したデータ構造、拡張性と保守性の向上 | 複雑なデータ構造、変更への対応遅延 |

| 命名規則とドキュメンテーション | データ資産の可視化、チーム間の認識合わせ、オンボーディング効率化 | データの検索性低下、属人化、コミュニケーションロス |

| CI/CDとバージョン管理 | 変更管理の自動化、開発サイクル短縮、品質担保 | 手動でのデプロイミス、バージョン管理の複雑性 |

| データガバナンスの確立 | データ品質向上、セキュリティ強化、コンプライアンス順守 | データ信頼性の欠如、情報漏洩リスク |

データドリブン経営への第一歩

現代のビジネス環境において、データは「新たな石油」と称されるほど重要な資産です。しかし、その価値を最大限に引き出すためには、単にデータを集めるだけでなく、それを構造化し、活用しやすい形で提供するデータ基盤が不可欠です。Snowflakeデータモデリングのベストプラクティスを導入することは、貴社がデータドリブン経営へと舵を切るための第一歩となります。

高品質なデータ基盤は、営業部門での顧客ターゲティングの精度向上、マーケティング部門でのキャンペーン効果測定の迅速化、経営層での戦略的意思決定の裏付けなど、組織全体のあらゆる部門に恩恵をもたらします。例えば、あるEコマース企業では、Snowflake上でのデータモデリングを最適化した結果、顧客行動データの分析サイクルを30%短縮し、パーソナライズされたプロモーションのROIを15%向上させることができました(出典:某ITコンサルティングファームの業界レポート)。

データ基盤の整備は、単なるIT投資ではなく、未来の競争優位性を確立するための戦略的投資です。適切なデータモデリングによって構築された基盤は、変化の激しいビジネス環境にも柔軟に対応し、新たなデータソースや分析ニーズにもスムーズに適応できる「生きた」資産となります。貴社の組織全体にデータ活用文化を根付かせ、より迅速で正確な意思決定を支援する基盤を築くことが、データドリブン経営実現への道筋です。

Aurant Technologiesへの問い合わせの促進

Snowflakeの導入やデータモデリングの最適化は、貴社のビジネス成長を加速させる強力な手段ですが、そのプロセスは専門知識と経験を要します。適切な設計が行われない場合、期待される効果が得られないばかりか、かえって運用負荷やコストが増大するリスクもあります。

私たちAurant Technologiesは、Snowflakeを活用したデータ基盤構築とデータモデリングにおいて、豊富な実績と専門知識を持つプロフェッショナル集団です。貴社の現状の課題を深く理解し、ビジネス目標達成に向けた最適なデータモデリング戦略の立案から、設計、実装、そして継続的な運用支援まで、一貫したサポートを提供します。

「どこから手をつければ良いか分からない」「既存のデータ基盤に課題を感じている」「Snowflakeのポテンシャルを最大限に引き出したい」といったお悩みをお持ちであれば、ぜひ一度私たちにご相談ください。貴社のデータ活用を次のステージへと引き上げるための具体的なロードマップを共に描き、データドリブン経営の実現を強力に後押しいたします。

まずは、お気軽にお問い合わせフォームよりご連絡いただくか、専門コンサルタントとの無料相談をご利用ください。貴社のビジネス成長に貢献できることを心より楽しみにしております。