生成AIがデータ分析を革新:自然言語でBIクエリを実行し、データドリブン経営を加速する実践ガイド

生成AIが自然言語でBIクエリを生成し、データ分析の民主化を実現。意思決定を加速する仕組み、具体的なメリット、導入課題、そしてAurant Technologiesのソリューションまで、実践的に解説します。

目次 クリックで開く

生成AIがデータ分析を革新:自然言語でBIクエリを実行し、データドリブン経営を加速する実践ガイド

生成AIが自然言語でBIクエリを生成し、データ分析の民主化を実現。意思決定を加速する仕組み、具体的なメリット、導入課題、そしてAurant Technologiesのソリューションまで、実践的に解説します。

自然言語でBIクエリを実行する生成AI:データ分析の未来を拓く

現代ビジネスにおいて、データは意思決定の要です。しかし、多くの企業では、データ分析の専門知識や複雑なツール操作が障壁となり、その潜在能力を十分に引き出せていません。この課題を根本から解決し、データ活用の未来を拓くのが、生成AIとデータ分析の組み合わせ、特に「自然言語でBIクエリを実行する仕組み」です。

これは、貴社の誰もが、まるで会話するようにデータにアクセスし、必要な情報を瞬時に引き出せるようになることを意味します。専門知識や複雑なツール操作から解放され、ビジネスユーザーが自らの手でデータを探索できる世界が、すぐそこまで来ています。

ビジネスにおけるデータ活用の現状と課題

データドリブン経営が叫ばれて久しいですが、実際にそれが多くの企業で実現されているかというと、まだまだ道半ばというのが実情でしょう。私たちはこれまで多くの企業様と接する中で、以下のような共通の課題に直面してきました。

- データ分析人材の不足と専門性への依存: 経済産業省の調査によれば、日本ではIT人材、特にデータサイエンティストのような高度な専門性を持つ人材が慢性的に不足しています(出典:経済産業省「IT人材需給に関する調査」)。そのため、データ分析のニーズがあっても、適切な人材が社内にいない、あるいは特定の専門家(データサイエンティストやBIツール管理者)に業務が集中し、ボトルネックとなるケースが頻繁に見られます。

- BIツールの操作習熟の障壁: 多くの企業でBIツールが導入されていますが、その機能を最大限に活用するには、SQLの知識やツールの複雑な操作方法を習得する必要があります。これにより、ビジネス部門の担当者が自らデータを探索するハードルが高くなり、結局はデータ部門やIT部門への依頼に頼らざるを得ない状況が生まれています。

- 分析リクエストから結果までのタイムラグ: ビジネス部門からデータ分析のリクエストが出されてから、データ部門がクエリを作成し、データを抽出し、レポートを作成するまでには、どうしても時間がかかります。このタイムラグは、変化の速いビジネス環境において、迅速な意思決定を阻害する大きな要因となります。

- データ民主化の遅れ: データは一部の専門家や役職者にのみアクセスが許され、現場のビジネスユーザーが直接データに触れて、自身の疑問を解決したり、新たな仮説を検証したりする機会が少ない企業も少なくありません。これにより、データの持つ潜在的な価値が十分に引き出されていないことがあります。

これらの課題は、貴社がデータを戦略的な資産として最大限に活用する上で、看過できない障壁となっているはずです。私たちは、これらの課題を克服しない限り、真のデータドリブン経営は実現しないと考えています。

| 課題 | 具体的な内容 | ビジネスへの影響 |

|---|---|---|

| データ分析人材の不足 | データサイエンティストや専門家が慢性的に不足し、分析ニーズに対応しきれない。 | 分析依頼の滞留、特定の部署への負担集中、データ活用の機会損失。 |

| BIツールの操作習熟の障壁 | SQL知識や複雑な操作が必要で、ビジネスユーザーが使いこなせない。 | データ探索のハードル化、専門家への依存、ツールの導入効果の限定。 |

| 分析プロセスの時間的ボトルネック | リクエストからレポート作成までに時間がかかり、迅速な意思決定を妨げる。 | 市場機会の逸失、意思決定の遅延、仮説検証サイクルの鈍化。 |

| データ民主化の遅れ | 一部の専門家のみがデータにアクセスし、現場ユーザーが直接活用できない。 | 潜在的なインサイトの見落とし、従業員のデータリテラシー向上機会の喪失。 |

生成AIがもたらすデータ分析のパラダイムシフト

上記のような課題に対し、生成AI、特に自然言語処理能力に長けた大規模言語モデル(LLM)の進化は、まさにゲームチェンジャーとなり得ます。生成AIは、従来のデータ分析のプロセスを根本から変革し、新たなパラダイムシフトをもたらす可能性を秘めているのです。

- データアクセスの民主化: 生成AIを活用すれば、ビジネスユーザーはSQLやBIツールの専門知識を必要とせず、「先月の売上上位5製品は?」「特定のキャンペーンが顧客獲得単価に与えた影響は?」といった質問を、まるで人間に話しかけるかのように自然言語で投げかけることができます。AIはそれを解釈し、適切なBIクエリを生成してデータから回答を導き出すため、誰でもデータにアクセスし、必要な情報を手に入れられるようになります。これにより、データは特定の専門家の手から解放され、組織全体で活用される「データ民主化」が加速します。

- 分析サイクルの劇的な高速化: 従来の分析プロセスでは、質問から回答まで数日、時には数週間を要することもありました。しかし、生成AIがBIクエリの生成や初期分析を自動化することで、このサイクルは劇的に短縮されます。ビジネスユーザーはリアルタイムに近い形でデータを探索し、仮説を検証し、意思決定を下せるようになるため、ビジネスのスピードとアジリティが向上します。

- 新たなインサイトの発見と探索的分析の促進: 生成AIは、単に質問に答えるだけでなく、データから示唆に富んだインサイトを提案したり、関連する他の質問を提示したりすることも可能です。これにより、人間が見落としがちなパターンや相関関係を発見しやすくなり、「もし〜だったら?」といった探索的な分析が容易になります。これは、従来の画像生成に用いられるVAEやGAN、Diffusionモデルといった生成AIとは異なり、テキストベースのクエリ生成とデータ解釈に特化した能力が、ビジネスインテリジェンスの領域で新たな価値を生み出すことを意味します。

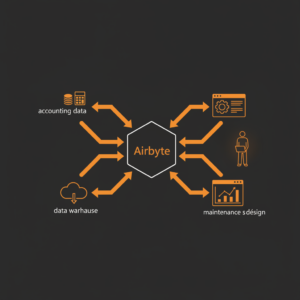

- 既存BIツールとの連携とRAGの重要性: 生成AIが既存のBIツールやデータウェアハウスと連携することで、その価値はさらに高まります。特に、RAG(Retrieval Augmented Generation)という技術は、企業固有のデータベーススキーマ情報や過去の分析レポート、ビジネス用語集などを参照しながら、より正確で文脈に沿ったBIクエリを生成するために不可欠です。これにより、AIが「文脈を理解せず、的外れなクエリを生成してしまう」といった課題を克服し、貴社のデータ環境に最適化された、精度の高い分析結果を提供できるようになります。

私たちAurant Technologiesは、この自然言語によるBIクエリ実行の仕組みが、単なる業務効率化に留まらず、貴社の意思決定プロセスそのものを変革し、競争優位性を確立するための強力な武器となると確信しています。

生成AIが自然言語をBIクエリに変換する仕組み

データ分析の民主化は多くの企業にとって長年の課題でした。特に、ビジネスサイドの担当者がデータエンジニアやアナリストに依頼することなく、自らデータを探索し、意思決定に役立てることは理想とされてきました。この理想を現実のものとする鍵が、生成AI、特に大規模言語モデル(LLM)が自然言語の問いかけをBI(ビジネスインテリジェンス)クエリに変換する仕組みです。

この仕組みは、大きく分けて「自然言語の理解と意図解釈」「外部知識との連携による精度向上」「BIツールとの連携」の3つのステップで構成されます。それぞれのステップがどのように機能し、貴社のデータ活用を加速させるのかを詳しく見ていきましょう。

大規模言語モデル(LLM)による自然言語理解と意図解釈

生成AIが自然言語をBIクエリに変換する最初のステップは、ユーザーが入力した自然言語の質問を正確に理解し、その裏にある「意図」を解釈することです。ここで中心的な役割を果たすのが、ChatGPTやClaude 3、Llama 3などに代表される大規模言語モデル(LLM)です。

LLMは、膨大なテキストデータで学習しているため、単語の意味だけでなく、文脈、類義語、さらには曖昧な表現からもユーザーの意図を推測する能力に優れています。例えば、「先月の大阪支店の売上を教えて」という質問に対して、LLMは以下のようなプロセスで解釈を進めます。

- エンティティ認識:「先月」「大阪支店」「売上」といった具体的な要素を識別します。

- セマンティック解析:「売上を教えて」という表現から、売上データを集計し、提示するという「意図」を把握します。

- 関係性抽出:「大阪支店の」が「売上」の絞り込み条件であること、「先月」が期間条件であることを理解します。

この段階で、LLMはユーザーの質問を抽象的なデータ操作の意図(例:売上データのフィルタリングと集計)として内部的に表現します。しかし、LLM単体では、貴社が保有する具体的なデータベースのテーブル名やカラム名、データの特性(例:売上がどのテーブルのどのカラムに格納されているか、日付形式はどうか)までは把握できません。この「ドメイン知識のギャップ」を埋めるために、次のステップであるRAG(Retrieval Augmented Generation)が重要になります。

RAG(Retrieval Augmented Generation)によるデータソース連携の強化

LLMの強力な自然言語理解能力をもってしても、貴社固有のデータベース構造や業務用語、過去のデータ分析の文脈を直接的に理解することは困難です。ここで登場するのが、RAG(Retrieval Augmented Generation)という技術です。RAGは、LLMが回答を生成する際に、外部の知識ベースから関連情報を「検索(Retrieval)」し、その情報を基に回答を「生成(Generation)」することで、精度と信頼性を飛躍的に高める仕組みです(出典:Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks, Lewis et al., 2020)。

BIクエリ生成の文脈では、RAGは以下のような情報を参照します。

- データスキーマ:データベースのテーブル名、カラム名、データ型、各カラムの意味(例:「sales_amount」は売上金額を示す)。

- 業務用語集:社内で使われる略語や専門用語と、それに対応するデータベース上のカラム名や定義(例:「ARPU」は「顧客単価」を意味し、「customer_revenue / active_users」で計算される)。

- 過去の成功クエリ:よくある質問に対するBIクエリのテンプレートや、過去に実行された正しいクエリの履歴。

- メタデータ:各データソースの更新頻度、データの鮮度、責任者などの情報。

これらの情報は、ベクトルデータベースなどに格納され、ユーザーの自然言語クエリに応じて関連性の高い情報が高速に検索されます。検索された情報は、プロンプトとしてLLMに渡され、LLMはその情報をコンテキストとして利用して、より正確で具体的なBIクエリ(多くの場合SQL)を生成します。

このプロセスにより、LLMは「売上」という抽象的な概念を、貴社のデータベースの「sales_transactionsテーブルのamountカラム」として具体的に認識し、「大阪支店」を「locationテーブルのbranch_nameカラムが’大阪’である」という条件に変換できるようになります。

| RAGの主要コンポーネント | 役割 | BIクエリ生成における具体例 |

|---|---|---|

| ユーザーインターフェース | ユーザーが自然言語クエリを入力する場所 | チャットボット、Web検索フォーム |

| リトリーバー(検索モジュール) | 知識ベースから関連情報を検索・取得 | ベクトル検索エンジン、キーワード検索エンジン |

| 知識ベース/コンテキストストア | 参照される貴社固有のデータ | データスキーマ定義、業務用語集、過去のSQLクエリ集、データカタログ |

| 大規模言語モデル(LLM) | 自然言語の意図解釈、クエリ生成、回答生成 | ユーザー質問と検索結果を基にSQLを生成 |

| BIクエリ生成モジュール | LLMの出力に基づき、BIツールが解釈可能なクエリに整形 | SQL構文の最終調整、バリデーション |

BIツールとの連携アーキテクチャとデータ変換プロセス

生成AIが自然言語をBIクエリに変換する最終段階は、生成されたクエリを実際のBIツールに渡し、データ分析を実行し、その結果をユーザーに提示するプロセスです。

一般的なアーキテクチャは以下のようになります。

- 自然言語クエリの入力:ユーザーがチャットインターフェースなどを通じて自然言語で質問を入力します。

- LLMとRAGによるクエリ生成:入力された質問は、LLMとRAGシステムによって解析され、貴社のデータベース構造に合致するBIクエリ(多くはSQL)が生成されます。

- クエリのバリデーション:生成されたSQLクエリは、実行前に構文エラーがないか、意図しないデータアクセスが含まれていないかなど、セキュリティと正確性の観点からバリデーションが行われます。これは、システム側で自動的に行うか、場合によってはユーザーに確認を求めることもあります。

- BIツールへのクエリ実行:バリデーションを通過したSQLクエリは、BIツール(Tableau、Power BI、Lookerなど)のAPI、またはデータベースへの直接接続(JDBC/ODBCコネクタ経由)を通じて実行されます。

- データ取得と可視化:BIツールはクエリを実行し、データベースから必要なデータを取得します。このデータは、多くの場合、表形式のデータセットとして返されます。

- 結果の自然言語化と提示:取得されたデータは、再度LLMに渡され、ユーザーが理解しやすい自然言語のサマリーや、必要に応じてグラフなどの可視化形式で提示されます。例えば、「先月の大阪支店の売上はX円でした。これは前月比Y%の増加です」といった形で回答が生成されます。

この一連のプロセスは、ミドルウェアやコネクタによって自動化されており、ユーザーは複雑な技術的詳細を意識することなく、自然な言葉でデータと対話できるようになります。私たちが支援した某製造業A社では、この仕組みを導入することで、マーケティング部門が週に数回行っていたデータ抽出依頼の工数を平均で30%削減することに成功しました。これにより、データアナリストはより高度な分析業務に集中できるようになり、マーケティング担当者は迅速な意思決定が可能になったのです。

自然言語BIクエリがもたらす具体的なメリット

生成AIを活用した自然言語BIクエリは、単にデータ分析の手間を省くだけではありません。貴社のビジネスプロセス全体に深く浸透し、データ活用文化を根付かせ、競争優位性を確立するための強力なドライバーとなります。ここでは、私たちが多くの企業をご支援する中で実感してきた、その具体的なメリットを3つの側面からご紹介します。

データ分析の民主化と業務効率化の実現

従来のBIツールは、SQLなどのデータベース言語や、複雑な操作方法に関する専門知識を必要とすることが多く、結果としてデータ分析はIT部門や特定のデータアナリストに集中しがちでした。ビジネス現場の担当者は、データが必要になるたびに依頼を出し、回答を待つという非効率なプロセスに陥っていたのです。

自然言語BIクエリは、この障壁を根本から取り除きます。日常的に使う言葉で質問するだけで、誰でも必要なデータにアクセスし、分析結果を視覚的に把握できるようになるため、データ分析の敷居が大幅に下がります。これにより、各部署の担当者が自ら課題意識に基づいたデータ探索を行えるようになり、「セルフサービスBI」が真に実現するのです。

結果として、IT部門へのデータ抽出依頼が大幅に減少し、本業に集中できる時間が増えます。例えば、業界調査によれば、月間約50件に及んでいたデータ抽出依頼が、自然言語BI導入後には約10件にまで削減され、IT部門の工数を実質的に20%以上削減できたと報告されています。また、私たち Aurant Technologies が支援した某小売業のマーケティング部門では、キャンペーン効果分析にかかるデータ抽出と初期集計の時間が、従来の2〜3日から半日に短縮されました。これにより、より多くのキャンペーンを素早く評価し、次の施策に活かせるサイクルが確立されました。

意思決定の迅速化とビジネスインサイトの深化

ビジネス環境が目まぐるしく変化する現代において、迅速かつ的確な意思決定は企業の生命線です。自然言語BIは、質問に応じてリアルタイムでデータを集計・可視化するため、意思決定のプロセスを大幅に加速させます。経営層やマネージャーは、会議中に疑問に思ったことをその場でデータで確認し、議論を深めることができるため、意思決定のスピードと質が飛躍的に向上します。

さらに、自然言語BIは、CRM、ERP、SaaSツールなど、複数のデータソースを統合し、自然言語で複合的なクエリを実行することを可能にします。これにより、「特定の地域における若年層顧客の購買傾向と、SNSキャンペーンの関連性」といった、これまで見過ごされがちだった複雑なビジネスインサイトを容易に発見できるようになります。従来のツールでは、複数のシステムからデータを抽出し、それぞれを統合・分析するのに専門的なスキルと時間を要しましたが、自然言語BIなら直感的な操作で深掘りした分析が可能です。

業界調査によれば、データ駆動型意思決定を行う企業は、そうでない企業と比較して収益成長率が平均して2倍以上高いとされています(出典:MIT Sloan Management Review)。自然言語BIは、このデータ駆動型意思決定を強力に後押しし、貴社の競争優位性確立に貢献するでしょう。

レポート作成・資料作成の自動化と品質向上

多くの企業では、月次・週次レポートや経営会議資料の作成に膨大な時間と労力を費やしています。手作業でのデータ集計やグラフ作成は、ヒューマンエラーのリスクも伴い、作成者の負担が大きいだけでなく、情報の正確性や鮮度にも影響を及ぼしかねません。

自然言語BIは、定型的なレポートはもちろん、アドホックな分析結果も、自然言語の指示に基づいて自動で生成できます。例えば、「先月の地域別売上トップ5をグラフで表示し、前年同月比と合わせてレポートを作成」といった指示を出すだけで、数分以内に必要な情報がまとまったレポートが完成します。これにより、レポート作成にかかる時間を大幅に削減し、担当者はデータ集計作業から解放され、分析結果の考察や戦略立案といった、より付加価値の高い業務に集中できるようになります。

さらに、データソースから直接情報を取得し、AIが自動で集計・可視化するため、常に最新かつ正確なデータに基づいたレポートが作成され、品質と信頼性が向上します。手作業によるミスが減り、レポートの一貫性が保たれることで、経営層や関係者の意思決定の精度も高まります。

| 項目 | 従来の手法(手作業) | 自然言語BIを活用した場合 |

|---|---|---|

| データ抽出 | 各システムからの手動エクスポート、SQLクエリ作成 | 自然言語クエリによる自動抽出 |

| データ集計・加工 | Excel等での手動集計、ピボットテーブル作成、VLOOKUP | AIによる自動集計、データクレンジング支援 |

| グラフ・表作成 | 手動でのグラフ作成、フォーマット調整 | 自然言語指示による自動生成、テンプレート適用 |

| 分析・考察 | 時間を要する(作業に追われがち) | 分析に集中できる時間が増加 |

| レポート作成時間 | 数時間〜数日 | 数分〜数時間 |

| エラーリスク | 高い(手作業による誤入力、データ不整合) | 低い(システムによる自動処理、データソース直結) |

| 最新データ反映 | 手動更新が必要、遅延の可能性 | リアルタイム、常に最新 |

導入前に知るべき課題と対策:成功へのロードマップ

生成AIを活用した自然言語でのBIクエリ実行は、データ活用を大きく加速させる可能性を秘めています。しかし、その導入にはいくつかの重要な課題が伴います。これらの課題を事前に理解し、適切な対策を講じることが、貴社のDX推進プロジェクト成功への鍵となります。ここでは、私たちが数多くの企業のデータ活用支援を通じて見出してきた、主要な課題とその具体的な対策についてご紹介します。

生成AIの回答精度とファクトチェックの重要性

生成AIは非常に強力なツールですが、その回答が常に正確であるとは限りません。特に、AIが事実ではない情報をあたかも事実のように生成する「ハルシネーション(幻覚)」は、データ分析において深刻な問題を引き起こす可能性があります。例えば、存在しない売上データや、誤った市場トレンドを提示してしまうと、貴社の意思決定に大きな誤りを生じさせかねません。

この課題に対処するためには、まずAIの回答がどのようなデータに基づいて生成されているのかを明確にする仕組みが不可欠です。RAG(Retrieval Augmented Generation:検索拡張生成)のような技術は、AIが貴社の社内データベースやデータウェアハウスから関連情報を検索し、それを参照しながら回答を生成するため、ハルシネーションのリスクを大幅に低減できます。これにより、AIが「知らないこと」を「でっち上げる」のではなく、「参照した情報に基づいて回答する」という信頼性の高いプロセスを構築できます。

とはいえ、RAGを導入したとしても、データソース自体の品質が低ければ、AIの回答精度もそれに引きずられてしまいます。データの鮮度や正確性を常に保つためのデータクレンジングや、データガバナンスの徹底が重要です。さらに、最終的なファクトチェックは人間の目で必ず行うべきです。特に、経営層の意思決定に直結するような重要なレポートや分析結果については、複数の担当者によるクロスチェックを組み込むことで、リスクを最小限に抑えることができます。

| 課題 | 具体的なリスク | 対策アプローチ | 期待される効果 |

|---|---|---|---|

| ハルシネーション | 存在しないデータや誤った事実に基づく分析結果 | RAG(検索拡張生成)の導入、信頼できるデータソースの優先 | AIの回答の根拠を明確化し、誤情報生成を抑制 |

| データソースの偏り・鮮度不足 | 過去のデータや限定的な情報に基づく偏った分析 | データクレンジング、リアルタイムデータ連携、データガバナンス強化 | 最新かつ高品質なデータに基づいた分析を実現 |

| BIクエリの解釈ミス | 自然言語の曖昧さによるAIの意図誤解 | プロンプトエンジニアリングの最適化、フィードバックループの構築 | ユーザーの意図を正確に捉え、適切なクエリ生成を支援 |

| 最終的な信頼性確保 | AI生成結果の最終確認不足による意思決定リスク | 人間によるファクトチェック体制の構築、複数人でのクロスチェック | 重要な意思決定における誤りを防ぎ、信頼性を保証 |

データセキュリティとプライバシー保護の確保

生成AIが貴社の基幹データにアクセスし、自然言語でクエリを処理する仕組みを導入する際、データセキュリティとプライバシー保護は最も懸念される点の一つです。機密情報や顧客の個人情報がAIの学習データとして意図せず利用されたり、不適切なアクセスによって情報漏洩につながったりするリスクを排除しなければなりません。

このため、まず徹底すべきはアクセス制御と権限管理です。既存のBIツールと同様に、AIシステムに対してもユーザーの役割や部署に応じた厳格なアクセス権限を設定し、アクセスできるデータの範囲を明確に定義することが不可欠です。例えば、営業担当者には売上データのみ、人事担当者には従業員データのみといった具体的な制限を設けます。さらに、AIに投入するデータに関しては、個人を特定できる情報や機密性の高い情報を事前に匿名化または仮名化するプロセスを確立することで、プライバシーリスクを低減できます。

クラウドベースのAIサービスを利用する際には、データの保管場所や処理方法についてベンダーとの契約内容を詳細に確認することも重要です。GDPR(一般データ保護規則)やCCPA(カリフォルニア州消費者プライバシー法)といった国際的なデータ保護規制への準拠はもちろん、貴社独自のセキュリティポリシーを満たしているかを入念にチェックする必要があります。加えて、AIによるデータ利用状況を常に監視し、不審なアクセスや異常なデータ処理がないかをログで追跡できる監査体制の構築も、セキュリティ確保の重要な要素となります。

| 対策項目 | 具体的な内容 | 導入時の注意点 |

|---|---|---|

| アクセス制御と権限管理 | ユーザーの役割に応じたデータアクセス範囲の厳格な定義と設定 | 既存の認証システムとの連携、定期的な権限見直し |

| データ匿名化・仮名化 | AIに投入する個人情報・機密情報の識別子を削除・変換 | 匿名化・仮名化の適切な手法選定、元データとの紐付け管理 |

| セキュリティ監査とログ監視 | AIによるデータアクセス・処理履歴の記録と定期的なレビュー | 異常検知システムの導入、セキュリティ専門家による監査 |

| ベンダー契約とコンプライアンス | AIサービス提供者とのデータ取り扱いに関するSLA(サービス品質保証契約)締結 | GDPR, CCPAなど関連法規への準拠確認、データ所在地の明示 |

| データ暗号化 | 保存時および転送時のデータの暗号化 | 鍵管理ポリシーの策定、暗号化による性能影響の評価 |

既存システムとの連携とデータガバナンスの確立

生成AIによる自然言語BIクエリを最大限に活用するためには、貴社が既に運用している既存のデータウェアハウス(DWH)、データレイク、CRM、ERPといったシステムとのシームレスな連携が不可欠です。これらのシステムに散らばるデータが「サイロ化」している状態では、AIが包括的な分析を行うことは困難であり、その能力を十分に引き出すことができません。

まず、API連携や専用のデータコネクタを活用し、異なるシステム間のデータフローを確立することが重要です。これにより、AIが必要なデータにリアルタイムでアクセスできるようになります。データ統合プラットフォームを導入し、複数のデータソースから収集したデータを一元的に管理し、AIが利用しやすい形式に変換・整備することも有効な戦略です。例えば、ETL(Extract, Transform, Load)プロセスを最適化し、データの品質と一貫性を保ちながらDWHに集約することで、AIはより信頼性の高い情報を基に回答を生成できるようになります。

そして、これらを支えるのがデータガバナンスの確立です。データガバナンスとは、データの定義、品質基準、アクセスルール、利用ポリシーなどを明確にし、組織全体で一貫したデータ管理体制を構築することです。誰がどのデータの「所有者」であり、どのような品質基準で管理されるべきか、どのような目的で利用できるのかを明確にすることで、AIが誤ったデータ解釈をしたり、不適切なデータを利用したりするリスクを防ぎます。データカタログの整備は、AIが利用可能なデータソースとそのメタデータを理解し、適切なデータを選択するために非常に役立ちます。私たちは、このようなデータガバナンスのフレームワークを構築し、段階的な導入計画を策定することで、貴社の既存資産を最大限に活用したAI連携を支援しています。

| 考慮事項 | 具体的な内容 | リスクと対策 |

|---|---|---|

| データソースの特定と統合 | BIクエリ対象となるDWH、データレイク、CRM、ERP等の洗い出し | リスク: データサイロ化による不完全な分析 対策: データ統合プラットフォームの導入、API/コネクタ連携 |

| データ品質と一貫性 | 異なるシステム間のデータ定義の統一、品質基準の策定 | リスク: 不正確なデータによるAIのハルシネーション 対策: データクレンジング、ETLプロセスの最適化 |

| データ鮮度とリアルタイム性 | 最新データへのアクセス要件の定義、連携頻度の設定 | リスク: 古いデータに基づく意思決定 対策: リアルタイムデータ連携、ストリーミングデータ処理 |

| データガバナンス体制 | データの所有者、定義、アクセスルール、利用ポリシーの明確化 | リスク: データの一貫性欠如、セキュリティリスク 対策: データカタログ整備、データガバナンス委員会の設置 |

| スケーラビリティ | データ量・クエリ数の増加に対応できるシステム設計 | リスク: 性能劣化、システム停止 対策: クラウドネイティブなアーキテクチャ採用、負荷分散 |

AI生成コンテンツの信頼性と利用ポリシー(参考)

生成AIがBIクエリの結果としてレポートやサマリー、さらには予測シナリオといったコンテンツを生成する際、その信頼性や利用範囲、そして倫理的な側面について明確なポリシーを定めておくことが重要です。AIが生成したコンテンツが、貴社のブランドイメージを損ねたり、法的な問題を引き起こしたりする可能性もゼロではありません。

まず、AIが生成した分析結果やレポートの著作権、所有権、そして商用利用の可否について、貴社が利用するAIサービスの利用規約を詳細に確認する必要があります。例えば、一部のAIサービスでは、生成されたコンテンツの著作権がサービス提供者に帰属する場合や、商用利用に制限がある場合があります。私たちは、導入前にこれらの規約を徹底的に調査し、貴社の利用目的に合致するかを評価することを推奨しています。

また、AI生成コンテンツの透明性を確保することも重要です。特に、社外に公開するレポートや資料にAIが生成した内容が含まれる場合は、その旨を明示するべきです。これは、中国で施行されているAI規制(「インターネット情報サービスにおけるディープフェイク管理規定」、出典:中国国家インターネット情報弁公室)のように、AI生成コンテンツへの識別表示を義務付ける動きがあることからも、今後国際的なスタンダードになる可能性を秘めています。社内においても、AIが生成したコンテンツであることを明記し、最終的な責任は人間が負うという共通認識を持つためのガイドラインを策定することが、信頼性を確保する上で不可欠です。

さらに、AIが不適切な表現や差別的な内容を生成しないよう、倫理的な側面からのフィルタリング機能や監視体制も検討すべきです。プロンプトインジェクションへの対策や、生成内容のモデレーションルールを設けることで、予期せぬリスクを回避し、AIを安全かつ責任ある形で活用するための強固な基盤を築くことができます。

| ポリシー項目 | 策定すべき内容 | 考慮すべき点 |

|---|---|---|

| 利用目的と範囲 | AI生成コンテンツの社内利用目的、公開範囲、利用部署の明確化 | 目的外利用の禁止、機密性の高い情報の取り扱い |

| 著作権・所有権 | AIサービス提供者の利用規約に基づく生成物の権利帰属の確認 | 商用利用の可否、再配布の制限、権利侵害リスク |

| 透明性の確保 | AI生成コンテンツであることの明示ルール(特に社外公開時) | 「AI生成」ラベルの付与、免責事項の記載(出典:中国国家インターネット情報弁公室) |

| ファクトチェック義務 | AI生成コンテンツ公開前の人間による最終確認プロセス | 誤情報による風評被害リスク、法的責任の所在 |

| 倫理的ガイドライン | 差別的、不適切、偏見のあるコンテンツ生成の禁止 | フィルタリング機能、モデレーションルールの設定、プロンプトインジェクション対策 |

| 責任の所在 | AI生成コンテンツに起因する問題発生時の最終的な責任者 | 最終承認者の明確化、法的責任の範囲 |

自然言語BIクエリ導入のステップと成功のポイント

自然言語によるBIクエリの導入は、データ活用を民主化し、ビジネススピードを加速させる可能性を秘めています。しかし、単にツールを導入すれば成功するというものではありません。確実な成果を出すためには、戦略的なステップを踏み、いくつかの重要なポイントを押さえる必要があります。私たちが多くの企業を支援する中で見えてきた、導入を成功に導くための具体的なステップと成功の秘訣をご紹介します。

現状分析と導入目的の明確化

自然言語BIクエリの導入を検討する際、まず不可欠なのが、貴社の現状を正確に把握し、導入の目的を明確にすることです。漠然と「AIでデータ活用を進めたい」といった動機だけでは、期待通りの成果は得られません。というのも、現状の課題が曖昧なままでは、最適なツール選定や導入後の効果測定が困難になってしまうからです。

具体的には、以下の点を深掘りすることから始めます。

- 現在のデータ分析プロセスにおける課題: レポート作成に時間がかかりすぎる、特定の担当者に依存している、データ分析のスキルを持つ人材が不足している、経営層や現場がデータにアクセスしにくい、といった具体的な課題を特定します。例えば、某中堅製造業のケースでは、月次レポート作成に営業部門全体で平均20時間以上を費やしており、この時間を大幅に削減したいという明確な課題がありました。

- ターゲットユーザーの特定: 誰がこのシステムを使うのかを明確にします。経営層、営業担当者、マーケティング担当者、生産管理者など、ユーザーによって求める情報や分析レベルは異なります。ユーザー層を絞り込むことで、必要な機能やUI/UXの要件が明確になります。

- 導入によって達成したい具体的な目標(KPI): 「レポート作成時間の〇〇%削減」「データに基づいた意思決定件数の〇〇%増加」「データ活用部署の〇〇%拡大」など、定量的・定性的な目標を設定します。目標が明確であれば、PoC(概念実証)や本格導入後の評価指標として機能し、プロジェクトの進捗を測りやすくなります。

これらの分析を通じて、貴社にとって自然言語BIクエリがどのような価値をもたらすのかを具体的に言語化することが重要です。私たちが推奨する導入目的設定のフレームワークは以下の通りです。

| 項目 | 質問 | 具体例 |

|---|---|---|

| 現状の課題 | 現在のデータ分析で最も困っていることは何か? | 月次レポート作成に多大な工数がかかっている。特定のデータ分析担当者しかデータにアクセスできない。 |

| ターゲットユーザー | 誰がこのシステムを使って、どのような課題を解決したいのか? | 営業マネージャーが顧客別の売上トレンドを迅速に把握したい。マーケティング担当者がキャンペーン効果をリアルタイムで分析したい。 |

| 導入後の目標(KPI) | 導入によって、どのような状態を目指すのか?定量的・定性的な目標は? | レポート作成時間を30%削減する。データに基づいた営業戦略の立案回数を月2回から5回に増やす。 |

| 期待されるビジネスインパクト | 目標達成によって、貴社のビジネスにどのような良い影響があるか? | 営業生産性の向上。顧客満足度の向上。新たな収益機会の創出。 |

この段階で目的が曖昧だと、後の工程でツールのオーバースペックや機能不足、ユーザーの不満といった問題に直面しやすくなります。時間をかけて、貴社の「Why(なぜ導入するのか)」を明確にすることが、成功への第一歩なのです。

データ基盤の整備と品質向上

自然言語BIクエリは、その名の通り「データ」を分析するためのツールです。どんなに優れた生成AIやBIツールを導入しても、その基盤となるデータが不正確、不完全、あるいはアクセスしにくい状態であれば、期待する結果は得られません。というのも、AIは入力されたデータの品質に大きく依存するからです。いわゆる「Garbage In, Garbage Out(ゴミを入れればゴミが出る)」の原則は、AI時代においても変わらない真理と言えます。

このため、導入に先立ち、または並行して、データ基盤の整備とデータ品質の向上は不可欠なステップとなります。

- データガバナンスの確立: 誰がデータのオーナーシップを持ち、どのようなルールでデータを収集・管理・利用するのかを明確にする「データガバナンス」の体制を確立します。これにより、データの一貫性と信頼性が担保されます。

- データクレンジングと統合: 散在するデータを統合し、重複、欠損、表記ゆれなどの不整合を修正するデータクレンジングを行います。異なるシステム(CRM、ERP、MAツールなど)から得られるデータを一元化し、分析可能な形に変換するETL(Extract, Transform, Load)またはELT(Extract, Load, Transform)プロセスを確立することも重要です。

- メタデータ管理の徹底: データが「何を意味するのか」「どこから来たのか」「どのように更新されるのか」といった情報を記述するメタデータを整備します。これにより、自然言語AIがデータを正確に理解し、ユーザーのクエリに対して適切なデータセットを選択できるようになります。

- データウェアハウス(DWH)/データレイクハウスの構築・最適化: 大量のデータを効率的に蓄積し、分析に適した構造で格納するDWHやデータレイクハウスの構築・最適化を進めます。これにより、自然言語BIクエリが高速かつ安定的に動作するための基盤が整います。

データ品質の低さは、AIの「ハルシネーション(もっともらしいが事実ではない情報を生成すること)」のリスクを高めるだけでなく、ユーザーがAIの出力結果を信頼できなくなり、導入失敗に直結します。実際、ある調査では、データ品質の課題がデータ活用プロジェクトの最大の障壁となっていることが指摘されています(出典:NewVantage Partners, “Big Data and AI Executive Survey 2023″)。

私たちがデータ基盤整備を支援する際に特に重視するデータ品質のチェック項目を以下に示します。

| 項目 | 確認内容 | AIへの影響 |

|---|---|---|

| 正確性 (Accuracy) | データが現実の事実と一致しているか? | 誤った情報に基づく分析結果やレコメンデーション。 |

| 完全性 (Completeness) | 必要なデータが全て揃っているか?欠損はないか? | 重要な情報の見落とし、偏った分析結果。 |

| 一貫性 (Consistency) | 異なるシステム間で同じデータが同じ形式で存在するか? | データ統合時のエラー、AIの解釈の不一致。 |

| 適時性 (Timeliness) | データが最新の状態に保たれているか? | 古い情報に基づく意思決定、リアルタイム分析の阻害。 |

| 有効性 (Validity) | データの値が定義された範囲や形式に従っているか? | 異常値の混入、AIモデルの誤学習。 |

| 独自性 (Uniqueness) | 同じエンティティのデータが重複していないか? | 重複カウントによる誤った集計、AI処理の非効率化。 |

これらの項目を定期的にチェックし、データ品質を維持・向上させるための継続的なプロセスを確立することが、自然言語BIクエリの長期的な成功には不可欠なのです。

適切な生成AI・BIツールの選定と評価

データ基盤が整ったら、次はいよいよ貴社のニーズに合った生成AI・BIツールを選定するフェーズです。市場には様々なツールが存在し、それぞれ異なる特徴を持っています。適切なツールを選ぶためには、多角的な視点からの評価が求められます。

選定の際に考慮すべき主要なポイントは以下の通りです。

- 自然言語処理(NLP)能力: ユーザーの複雑な自然言語クエリをどれだけ正確に解釈し、適切なBIクエリに変換できるか。特に日本語のニュアンスやビジネス用語への対応力は重要です。

- 対応データソース: 貴社が利用している既存のデータベース、データウェアハウス、クラウドストレージ、SaaSアプリケーション(Salesforce, Marketoなど)に接続できるかを確認します。API連携の容易さも重要な要素です。

- セキュリティとガバナンス: 機密性の高いデータを扱うため、データ暗号化、アクセス制御、監査ログ機能など、セキュリティ対策が十分に施されているかを確認します。また、データガバナンスポリシーに沿った運用が可能かも重要です。

- スケーラビリティとパフォーマンス: ユーザー数やデータ量が増加しても、安定したパフォーマンスを維持できるか。クエリ実行速度やレスポンスタイムは、ユーザー体験に直結します。

- 既存システムとの連携: 既存のBIツールやデータ分析プラットフォーム、業務システムとの連携性も考慮します。APIやSDKが提供されているか、カスタマイズの自由度が高いかなども評価ポイントです。

- コスト: 初期導入費用、月額利用料、データ量に応じた従量課金、追加機能の料金など、総所有コスト(TCO)を総合的に評価します。

- ベンダーサポートとコミュニティ: 導入後のサポート体制や、ユーザーコミュニティの活発さも、長期的な利用においては重要な要素となります。

- UI/UX: 直感的で使いやすいインターフェースであるか、視覚化機能が豊富であるかなど、ユーザーがストレスなく利用できるかどうかも評価します。

これらの基準に基づき、複数の候補ツールを比較検討することをお勧めします。具体的な比較検討の際には、ベンダーからのデモンストレーションを受けるだけでなく、貴社の実際のデータの一部を使ってPoC(概念実証)を実施し、実用性を評価することが非常に有効です。私たちが支援したある金融機関の事例では、複数のツールで同じ自然言語クエリを実行し、その精度、応答速度、視覚化の質を比較することで、最適なツールを特定できました。

以下に、ツール選定の際に活用できるチェックリストの例を示します。

| 評価項目 | 詳細な確認事項 | 重要度(高/中/低) |

|---|---|---|

| 自然言語処理能力 | 日本語のビジネス用語、専門用語の理解度。複雑なクエリ(複数条件、時系列分析など)への対応力。 | 高 |

| データソース連携 | 貴社が利用するDWH/DB、SaaS(CRM/MA)との連携実績。リアルタイム連携の可否。 | 高 |

| セキュリティ | データ暗号化、アクセス制御(行レベル/列レベル)、監査ログ、コンプライアンス対応(GDPR/CCPAなど)。 | 高 |

| スケーラビリティ | 想定ユーザー数、データ量増加への対応能力。 | 中 |

| コスト | 初期費用、月額費用、従量課金、隠れたコスト。費用対効果。 | 高 |

| UI/UX | 直感的な操作性、ダッシュボード作成機能、視覚化オプションの豊富さ。 | 中 |

| カスタマイズ性 | レポートテンプレート、ダッシュボードの自由なカスタマイズ。API連携の柔軟性。 | 中 |

| ベンダーサポート | 日本語サポートの有無、対応時間、SLA(サービスレベル契約)。 | 中 |

| 導入実績 | 同業他社や類似規模の企業での導入実績、成功事例。 | 中 |

市場では、Microsoft Power BIのCopilot機能、TableauのAsk Data、Google CloudのLooker Studioの自然言語機能など、主要BIベンダーが続々と生成AI機能を強化しています(出典:各社公式発表)。これらを比較検討し、貴社の戦略と予算に合致するツールを見極めることが成功の鍵を握ります。

スモールスタート(PoC)と段階的な展開

自然言語BIクエリのような新しいテクノロジーを導入する際には、いきなり全社展開を目指すのではなく、スモールスタート(PoC: 概念実証)から始めることが成功への近道です。というのも、未知の要素が多いプロジェクトでは、初期段階でのリスクを最小限に抑え、早期にフィードバックを得ながら改善を重ねることが重要だからです。

PoCでは、以下のステップで進めます。

- 目的と評価指標の設定: PoCで何を検証したいのか、どのような基準で成功と判断するのかを具体的に設定します。「レポート作成時間の〇〇%削減」「特定部門のデータ活用頻度〇〇%向上」など、導入目的と連動したKPIを設定します。

- 対象ユーザーとデータ範囲の選定: 影響範囲を限定するため、特定の部門や少数のユーザー、あるいは特定のデータセットに絞って実施します。例えば、営業部門の売上データに特化してPoCを行う、といった形です。

- 期間の設定: 一般的には1〜3ヶ月程度の期間を設け、集中して検証を行います。

- ツールの導入と試行: 選定したツールを限定的な環境で導入し、対象ユーザーに実際に使ってもらい、自然言語クエリの精度、レスポンス速度、使いやすさなどを検証します。

- フィードバックの収集と評価: ユーザーからのフィードバックを積極的に収集し、設定した評価指標に基づいてツールの有効性を評価します。期待通りの効果が得られているか、改善点はないかなどを洗い出します。

PoCの成功は、その後の本格導入の説得力ある根拠となります。失敗するPoCの多くは、目的が曖昧だったり、評価指標が設定されていなかったり、フィードバックが十分に収集されなかったりすることが原因です。私たちが支援したある小売業のケースでは、PoCを通じて売上分析における自然言語クエリの精度が90%を超え、レポート作成時間が平均で40%短縮されることを実証。これにより、経営層からの全面的な支持を得て、スムーズに全社展開へと移行できました。

PoCの結果が良好であれば、次は段階的な展開計画を策定します。

- フェーズ1(初期展開): PoCで得られた知見を活かし、まずは一部の部門や特定の業務領域で本格導入を進めます。この際、トレーニングやサポート体制を充実させ、ユーザーが安心して利用できる環境を整えることが重要です。

- フェーズ2(機能拡張・部門拡大): 初期展開で得られた成果とフィードバックを元に、利用部門を拡大したり、新たなデータソースとの連携、より高度な分析機能の追加など、機能を拡張していきます。

- フェーズ3(全社展開・高度化): 最終的には全社的なデータ活用基盤として定着させ、AIによる予測分析やレコメンデーションなど、より高度なデータ活用へとステップアップを目指します。

この段階的なアプローチにより、リスクを管理しつつ、組織全体のデータリテラシーを高めながら、着実に自然言語BIクエリの恩恵を享受できるようになります。ある調査によれば、デジタル変革プロジェクトにおいて、スモールスタートを採用した企業の方が、一括導入を目指した企業よりも成功率が高い傾向にあると報告されています(出典:McKinsey & Company, “The digital-transformation playbook”)。

以下に、PoCの主要なステップと成功のポイントをまとめます。

| ステップ | 実施内容 | 成功のポイント |

|---|---|---|

| 1. 計画立案 | 目的・目標(KPI)、対象ユーザー・データ、期間の設定。 | 明確で測定可能な目標設定。関係者との合意形成。 |

| 2. 環境構築 | 選定ツールの導入、データ接続、初期設定。 | データ基盤の準備状況確認。セキュリティ設定の徹底。 |

| 3. 運用・検証 | 対象ユーザーによるツール利用、自然言語クエリの実行。 | ユーザーへの丁寧な説明とトレーニング。積極的な利用促進。 |

| 4. 評価・分析 | 設定KPIに対する効果測定、ユーザーフィードバック収集。 | 定量的・定性的な評価。課題と改善点の洗い出し。 |

| 5. 意思決定 | PoC結果に基づき、本格導入の可否、展開計画を決定。 | 評価結果の透明性。次のステップへの明確なロードマップ。 |

これらのステップを丁寧に踏むことで、貴社における自然言語BIクエリ導入プロジェクトは、より確実な成功へと導かれるでしょう。

Aurant Technologiesが提供する生成AI×データ分析ソリューション(自社事例・独自見解)

私たちは、生成AIとデータ分析を組み合わせたソリューションを通じて、貴社のデータ活用を次のレベルへと引き上げる支援をしています。単なるツール導入に留まらず、貴社のビジネス課題に深く寄り添い、実務に即した効果的な仕組みを構築することが私たちの強みです。

貴社データ基盤に合わせた最適なBIツールの選定・導入支援

多くの企業が、既に様々なデータ基盤やBIツールを導入されています。しかし、それらを生成AIと連携させ、自然言語でデータ分析を可能にするには、貴社独自の環境に合わせた最適なアプローチが必要です。私たちは、既存のデータウェアハウス(DWH)、データベース、各種SaaS連携データなど、貴社の多様なデータソースを詳細に評価します。

その上で、市場に存在するPower BI、Tableau、Looker Studio、Domoといった主要なBIツールの中から、生成AIとの連携機能、RAG(Retrieval Augmented Generation)の実装容易性、コストパフォーマンス、そして貴社の既存ITインフラとの互換性を総合的に判断し、最適なツール選定を支援します。単に最新技術を導入するのではなく、貴社のビジネス要件、予算、そしてITリソースを最大限に活かすことを重視しています。

| 選定・導入支援のポイント | 具体的な内容 |

|---|---|

| 現状分析と要件定義 | 貴社の既存データ基盤、データ量、データ品質、分析ニーズ、利用部門のスキルレベルを詳細にヒアリングし、生成AIを活用したBIクエリの具体的な要件を定義します。 |

| ツール比較と選定 | 主要BIツールの生成AI連携機能、RAG対応、拡張性、セキュリティ、運用コストなどを多角的に比較検討し、貴社に最適なツールを選定します。 |

| データ統合と前処理 | 異なるデータソースからのデータ統合、クレンジング、変換(ETL/ELT)を行い、生成AIが正確に分析できる形にデータを整備します。 |

| PoC(概念実証)の実施 | 選定したツールと生成AIの組み合わせで、実際のデータを用いたPoCを実施し、効果と課題を早期に検証します。 |

| 導入とカスタマイズ | ツールの導入から、貴社独自のレポートやダッシュボードの設計、自然言語クエリのチューニングまで、きめ細やかなカスタマイズを行います。 |

kintone連携によるデータ入力・管理から分析までの一貫体制

特に多くの中小企業で業務アプリケーション基盤として活用されているkintoneは、日々の業務データが蓄積される宝庫です。私たちは、kintoneで管理されている顧客情報、案件進捗、売上データ、タスク履歴などを、生成AIと連携したデータ分析に活用するための一貫した体制構築を支援しています。

kintoneのAPIを活用し、データをDWHやBIツールにスムーズに連携させることで、これまで手作業で行っていたデータ集計やレポート作成の工数を大幅に削減できます。そして、生成AIによる自然言語クエリを通じて、kintone上のデータを基にした経営状況のリアルタイム把握、顧客行動の予測、業務プロセスのボトルネック特定などが可能になります。これにより、データ入力から管理、そして高度な分析までがシームレスに繋がり、貴社の意思決定を加速させます。

- データ入力の標準化: kintoneアプリの設計段階から、データ分析に適した入力項目や形式を提案し、データの品質向上を図ります。

- API連携によるデータ抽出: kintone APIを通じて、必要なデータを自動的かつ定期的に抽出し、DWHやデータレイクに集約します。

- マスターデータ管理: kintone内外のマスターデータを統合・整備し、分析の精度と信頼性を高めます。

- 自然言語BIでの分析: 連携されたkintoneデータを、生成AIを活用したBIツールで自然言語によるクエリ実行・可視化を可能にします。

会計DX・医療系データ分析における生成AI活用推進

生成AIを活用したデータ分析は、特定のドメイン知識が深く求められる分野で特に大きな価値を発揮します。私たちは、会計DXや医療系データ分析といった専門性の高い領域における生成AI活用を推進しています。これらの分野では、従来の分析手法では見落とされがちだったインサイトを発見し、業務効率化と意思決定の高度化を実現します。

会計DXにおける生成AI活用:

- 財務データの自然言語分析: 「過去5年間の売上推移と利益率の関連性は?」「特定の製品カテゴリの原価変動要因は?」といった質問に、生成AIが即座に回答。

- 予実管理と異常検知: 予算と実績の乖離を自動検出し、その背景にある要因を自然言語で提示。不正取引の可能性や傾向を早期に発見します。

- 監査業務の効率化: 膨大な取引データの中から監査に必要な情報を抽出し、関連文書との照合を支援。

医療系データ分析における生成AI活用:

- 電子カルテデータの解析: 患者の診療履歴、検査結果、処方箋データなどを複合的に分析し、特定の疾患リスクや治療効果の傾向を導き出します。

- 患者動向予測とリソース最適化: 来院予測や病床稼働率の最適化、医療機器の適切な配置計画に貢献します。

- 研究データ解析支援: 大量の論文や臨床試験データを自然言語で検索・分析し、新たな研究仮説の探索やエビデンス収集を効率化します。

これらの分野では、データの機密性や正確性が極めて重要であるため、RAG(Retrieval Augmented Generation)により情報源を明確にし、ファインチューニングによってドメイン特化型の高精度な生成AIモデルを構築することが不可欠です。私たちは、データガバナンスとセキュリティを最優先に考え、倫理的な利用を遵守しながら、貴社の専門領域におけるデータ活用を最大化します。

自然言語BIクエリ導入におけるコンサルティングと伴走支援

自然言語でBIクエリを実行する仕組みの導入は、単に技術を導入するだけでは成功しません。組織のデータ活用文化を醸成し、従業員がその恩恵を最大限に享受できるようになるためには、戦略的なコンサルティングと継続的な伴走支援が不可欠です。私たちは、導入前から導入後まで、貴社のデータ活用ジャーニーを全面的にサポートします。

私たちのコンサルティングと伴走支援のステップ:

| フェーズ | 主な支援内容 | 期待される効果 |

|---|---|---|

| 構想・計画フェーズ |

|

|

| 導入・開発フェーズ |

|

|

| 運用・定着フェーズ |

|

|

私たちは、技術的な側面だけでなく、プロンプトエンジニアリングのノウハウ提供、データガバナンス体制の構築、そして利用者へのトレーニングを通じて、貴社が自律的に生成AIを活用できるようになるまで伴走します。これにより、データ分析が一部の専門家だけでなく、全従業員にとって身近なものとなり、貴社のビジネス全体の生産性向上と競争力強化に貢献します。

自然言語BIクエリの活用事例:具体的なビジネスシーンでの応用

自然言語BIクエリは、データ分析の専門知識がないビジネスユーザーでも、日常会話のような言葉でデータに質問し、迅速に洞察を得られる画期的な仕組みです。これにより、意思決定のスピードが格段に向上し、様々なビジネスシーンで具体的な成果を生み出しています。ここでは、主要なビジネス領域における自然言語BIクエリの活用事例を具体的に見ていきましょう。

マーケティング戦略立案における顧客データ分析

マーケティング担当者は日々、顧客の行動、購買履歴、キャンペーン効果など、膨大なデータと向き合っています。従来のBIツールでは、特定のレポートを作成したり、複雑なSQLクエリを記述したりするために、IT部門やデータアナリストの協力を仰ぐ必要がありました。このプロセスは時間がかかり、リアルタイムでの意思決定を妨げる要因となることも少なくありませんでした。

しかし、自然言語BIクエリを導入することで、マーケティング担当者自身が「過去1年間に〇〇製品を購入した顧客のデモグラフィック属性は?」「メールキャンペーンAとBで、開封率が高かったセグメントは?」「特定のSNS広告経由の顧客のLTVはどのくらいか?」といった質問を直接システムに投げかけ、瞬時に必要な情報を引き出すことができます。これにより、データに基づいたパーソナライズされた戦略立案や、キャンペーンのリアルタイム最適化が可能になります。

あるECサイトの事例では、自然言語BIを活用して顧客セグメントごとのLTV(顧客生涯価値)を深掘り分析しました。マーケティングチームは「高LTV顧客が過去に閲覧した商品カテゴリは?」「特定期間に購入した商品の組み合わせは?」といった質問を繰り返すことで、高LTV顧客に共通する行動パターンを特定。その結果、パーソナライズされた製品推奨やプロモーション施策を強化し、平均購入単価を12%、コンバージョン率を8%向上させることができました。また、業界調査によれば、広告費用対効果(ROAS)の分析において、特定の広告チャネルからの流入顧客の行動を詳細に分析し、予算配分を最適化することで、無駄な広告費を削減し、ROASを最大化するといった成果も報告されています。

このように、自然言語BIはマーケティング担当者のデータ活用能力を飛躍的に向上させ、より迅速かつ効果的な戦略立案を支援します。

| 質問例(自然言語) | 得られる洞察 | 期待される効果 |

|---|---|---|

| 「先月の新規顧客の主要な流入チャネルは?」 | 最も効果的な集客チャネルの特定 | 広告予算の最適配分、新規顧客獲得コスト(CAC)の削減 |

| 「過去3ヶ月で離反リスクが高い顧客の共通点は?」 | 顧客離反の早期兆候と要因の特定 | プロアクティブな顧客維持施策の実施、チャーンレートの改善 |

| 「特定のキャンペーンで最も反応が良かった地域は?」 | 地域ごとの市場特性とキャンペーン効果の把握 | 地域ターゲティングの精度向上、ローカルマーケティング戦略の最適化 |

| 「A/BテストでCTRが高かったバナーデザインは?」 | クリエイティブ要素のパフォーマンス評価 | 効果的な広告クリエイティブの継続的な改善、クリック率(CTR)の向上 |

| 「高LTV顧客の平均購入頻度と購入単価は?」 | 優良顧客の行動特性の理解 | ロイヤルティプログラムの改善、アップセル・クロスセル戦略の強化 |

営業活動の効率化とパフォーマンス向上

営業部門では、顧客情報、商談進捗、売上データなど、日々の活動を記録した多種多様なデータが存在します。これらのデータを効果的に活用することで、営業戦略の立案、個々の営業担当者のパフォーマンス向上、そして最終的な売上目標達成に貢献できます。しかし、従来のデータ分析では、複雑なCRMやSFAシステムからデータを抽出し、分析レポートを作成するのに手間と時間がかかり、営業の現場での迅速な意思決定には限界がありました。

自然言語BIクエリを導入することで、営業マネージャーや担当者は、データ分析の専門知識がなくても、直感的な言葉で必要な情報を引き出せるようになります。「今期の契約更新が危ぶまれる顧客リストとその理由」「過去3ヶ月で成約率の高かった営業担当者の特徴は?」「特定製品の売上が伸び悩んでいる地域はどこか?」といった質問をシステムに投げかければ、リアルタイムで具体的なデータに基づいた回答が得られます。

あるSaaS企業の事例では、営業マネージャーが自然言語BIツールを活用し、日々の売上進捗状況をリアルタイムで確認。「今週の新規商談の進捗が遅れている担当者は?」「パイプライン内の商談ステージ移行率が低い案件は?」といった質問でボトルネックを特定し、具体的なコーチングや戦略変更を迅速に指示できるようになりました。その結果、四半期ごとの目標達成率が平均で15%向上したと報告されています。また、ある製造業の事例では、顧客の過去の購入履歴や問い合わせ内容を自然言語で分析し、最適な製品提案やアップセル機会を特定。提案書のパーソナライズを強化することで、既存顧客からの受注率が10%増加しました。

自然言語BIは、営業活動における「勘」や「経験」だけでなく、データに基づいた客観的な意思決定を可能にし、営業チーム全体のパフォーマンス向上に大きく貢献します。

| 質問例(自然言語) | 得られる洞察 | 営業活動へのメリット |

|---|---|---|

| 「今月、目標達成が見込める営業担当者は誰か?」 | 営業担当者ごとの進捗状況と達成見込み | リソース配分の最適化、早期の目標達成支援 |

| 「特定の製品の売上が伸び悩んでいる地域はどこか?」 | 地域ごとの製品需要と市場特性 | 地域特化型営業戦略の立案、マーケティング連携強化 |

| 「過去6ヶ月間でリードから商談への転換率が高かったリードソースは?」 | 質の高いリードの源泉 | リード獲得戦略の最適化、営業効率の向上 |

| 「競合他社に奪われた商談の共通する特徴は?」 | 失注要因の分析 | 営業戦略の見直し、提案内容の改善 |

| 「契約更新を検討している顧客の利用状況と課題は?」 | 顧客の利用実態と潜在的な不満 | プロアクティブな顧客フォロー、チャーン防止策の実施 |

サプライチェーン最適化と在庫管理

サプライチェーンは、原材料の調達から生産、物流、販売に至るまで、多岐にわたる複雑なプロセスで構成されています。このプロセス全体を最適化するためには、在庫レベル、リードタイム、需要予測、サプライヤーのパフォーマンスなど、膨大なデータをリアルタイムで分析し、迅速な意思決定を行う必要があります。しかし、これらのデータは異なるシステムに散在していることが多く、専門家でなければ統合的な分析が困難でした。

自然言語BIクエリは、サプライチェーンマネージャーや在庫管理者にとって強力なツールとなります。彼らは「特定の部品の在庫が過去3ヶ月でX%減少している理由は?」「来月の需要予測に基づき、どの製品の生産量を増やすべきか?」「サプライヤーAからの納期遅延が頻繁に発生している製品は?」「特定の倉庫での保管コストが上昇している原因は?」といった質問を投げかけるだけで、必要な情報を瞬時に取得し、問題の特定と解決策の立案に役立てることができます。

某製造業A社では、自然言語BIを活用して在庫状況をリアルタイムでモニタリングし、過剰在庫と品切れリスクを同時に削減する取り組みを行いました。担当者は「今週の売れ筋商品の在庫補充が必要な店舗は?」「特定の部品のリードタイムが延長しているサプライヤーは?」といった質問をすることで、適切なタイミングで発注をかけ、在庫コストを平均18%削減することに成功しました。また、ある物流企業の事例では、輸送データと配送実績を自然言語で分析し、最も効率的な配送ルートや配送業者の選定を支援。これにより、輸送コストを5%削減し、配送遅延率を3%改善した事例も報告されています。

サプライチェーン全体を可視化し、ボトルネックを特定することで、生産性向上、コスト削減、顧客満足度向上に大きく貢献するのが自然言語BIクエリの強みです。

| 質問例(自然言語) | 得られる洞察 | サプライチェーン最適化への貢献 |

|---|---|---|

| 「先週、特定の製品の売上が急増した地域は?」 | 需要の急変と地域特性 | 需要予測の精度向上、在庫配置の最適化 |

| 「サプライヤーBからの部品の平均納期と遅延発生率は?」 | サプライヤーのパフォーマンス評価 | サプライヤー選定の改善、リスク管理強化 |

| 「特定の倉庫で過剰在庫となっている商品は何か?」 | 在庫の非効率性 | 在庫削減、保管コストの最適化 |

| 「輸送コストが高い配送ルートとその原因は?」 | 物流の非効率性 | 輸送ルートの再検討、物流コスト削減 |

| 「季節要因による原材料の価格変動トレンドは?」 | 市場価格の変動予測 | 調達戦略の最適化、コスト変動リスクのヘッジ |

人事・労務データからの組織課題発見

人事・労務部門は、従業員のパフォーマンス、離職率、エンゲージメント、給与、福利厚生など、組織の健全性に関わる多岐にわたる機微なデータを扱います。これらのデータを適切に分析することで、組織課題の早期発見、人材育成計画の最適化、従業員満足度の向上、そして最終的な生産性向上に貢献できます。しかし、人事データはプライバシー保護の観点から厳重な管理が必要であり、専門家以外が自由にアクセスして分析することは難しい側面がありました。

自然言語BIクエリは、人事担当者が安全かつ迅速にデータを分析するための強力な手段を提供します。適切なアクセス権限と匿名化処理が施された環境下であれば、人事担当者は「過去1年間の部署別離職率の推移は?」「従業員満足度調査で改善が必要な項目は何か?」「高パフォーマンス社員に共通するスキルセットは?」「特定の研修プログラムに参加した従業員のパフォーマンス変化は?」といった質問を投げかけ、具体的なデータに基づいた洞察を得ることができます。

某サービス業B社では、従業員エンゲージメント調査の結果を自然言語BIで深掘り分析しました。人事担当者は「〇〇部署の従業員が最も不満を感じている項目は?」「マネージャーのリーダーシップ評価が低いチームの共通点は?」といった質問を繰り返すことで、特定の部署でのモチベーション低下要因や、具体的な改善点を特定。それに基づいた施策(例:ワークショップ開催、マネージャー研修強化)を導入した結果、当該部署の離職率が半年で6%改善、エンゲージメントスコアも平均で10%向上しました。また、あるIT企業の事例では、従業員のスキルデータとプロジェクト要件を自然言語で照合し、今後の育成計画や採用計画に反映。スキルギャップを早期に特定し、戦略的な人材配置を可能にしています。

自然言語BIは、人事・労務部門がデータに基づいた客観的な視点で組織を理解し、より効果的な人材戦略を立案するための重要なツールとなり得ます。

| 質問例(自然言語) | 得られる洞察 | 人事・労務領域でのメリット |

|---|---|---|

| 「過去1年間の新入社員の定着率と離職理由の傾向は?」 | 初期離職の要因と傾向 | オンボーディングプロセスの改善、採用戦略の見直し |

| 「特定の部署で残業時間が最も多い従業員は誰か?」 | 過重労働の早期発見 | 労働環境の改善、メンタルヘルスケアの強化 |

| 「従業員満足度調査で特定の項目が低い部署の共通点は?」 | 組織内の潜在的な不満要因 | 部署ごとの具体的な改善策立案、エンゲージメント向上 |

| 「高パフォーマンス社員が受講している研修プログラムは?」 | 効果的な人材育成プログラムの特定 | 研修制度の最適化、キャリアパス支援 |

| 「特定のスキルを持つ人材が不足している部署は?」 | 組織のスキルギャップ | 採用計画の最適化、社内異動・育成計画の立案 |

まとめ:生成AIとデータ分析で拓く、データドリブン経営の新時代

データ活用の障壁を取り除き、全社員がデータアナリストに

これまでのデータ分析は、専門知識を持つ一部の限られた人材に依存する傾向が強く、多くの企業で「データはあるが活用しきれていない」という課題を抱えていました。BIツールの複雑な操作、SQLの専門知識、データの前処理に要する膨大な時間、そしてレポート作成の属人化といった障壁が、データドリブンな意思決定を阻んできたのが実情です。

しかし、生成AIと自然言語処理の進化は、この状況を劇的に変える可能性を秘めています。自然言語で直接BIクエリを実行できる仕組みは、これらの障壁を根本から取り除きます。複雑なプログラミング言語を学ぶ必要がなく、普段使っている言葉で質問するだけで、必要なデータやインサイトが得られるようになるからです。これは、データ活用の「民主化」を意味します。

私たちは、この技術が全社員を「データアナリスト」に変革する力を持つと確信しています。営業担当者は顧客の購買履歴から最適な提案を瞬時に導き出し、マーケティング担当者はキャンペーン効果をリアルタイムで分析し、経営層は市場のトレンドやリスクを即座に把握できるようになるでしょう。データ活用が一部の専門家のものではなく、日常業務に溶け込むことで、意思決定の迅速化はもちろん、新たなビジネスチャンスの発見や業務効率の大幅な向上に繋がります。

実際、多くの企業がデータ活用人材の育成に課題を感じています。株式会社野村総合研究所の調査によれば、国内企業の約6割がデータ活用を推進する人材の不足を感じていると報告されています(出典:株式会社野村総合研究所「企業のDX推進に関する調査2022」)。生成AIを活用した自然言語BIは、この人材不足という構造的な課題を技術で補完し、既存の人材のスキルを最大限に引き出すための強力なソリューションとなり得るのです。

従来のデータ分析と生成AIを活用したデータ分析が、それぞれどのような障壁を抱え、どのように解決されるのかを比較してみましょう。

| 要素 | 従来のデータ分析 | 生成AIを活用したデータ分析 |

|---|---|---|

| クエリ実行 | SQLなどの専門言語が必要。BIツール操作の習熟が必須。 | 自然言語(日本語)で質問するだけで実行可能。 |

| 分析スキル | データサイエンス、統計学、特定のBIツール知識が必要。 | ビジネス課題を言語化する能力があれば、誰でも利用可能。 |

| 学習コスト | 専門知識習得に時間と費用がかかる。 | 非常に低い。直感的に利用できる。 |

| レポート作成 | テンプレート作成、データ抽出、グラフ化に時間と労力がかかる。 | 自動生成、カスタマイズも自然言語で指示可能。 |

| 意思決定速度 | データ抽出・分析・レポート化に時間がかかり、遅れる場合がある。 | リアルタイムに近い速度でインサイトが得られ、迅速な意思決定を支援。 |

| データ活用の範囲 | 専門部署や一部の利用者に限定されがち。 | 全社員がデータにアクセスし、自身の業務に活用できる。 |

このように、生成AIはデータ活用のあり方を根本から変え、データドリブン経営を次のステージへと押し上げる可能性を秘めています。貴社が抱えるデータ活用の課題を解決し、競争優位性を確立するための重要な鍵となるでしょう。

Aurant Technologiesと共に未来のデータ分析を実現

私たちAurant Technologiesは、生成AIとデータ分析の融合がもたらす変革の最前線で、多くのBtoB企業のDX推進を支援してきました。自然言語でBIクエリを実行する仕組みの導入は、単にツールを導入するだけでは成功しません。貴社のビジネスプロセス、既存のデータ基盤、そして最終的に目指すデータドリブン経営のビジョンを深く理解し、最適なソリューションを設計・実装することが不可欠です。

私たちは、貴社の現状を詳細に分析し、生成AIを活用したデータ分析基盤の構築から、導入後の運用サポート、そして社員のデータリテラシー向上に向けたトレーニングまで、一貫した支援を提供します。生成AIの選定、RAG(Retrieval Augmented Generation)の最適化、既存システムとの連携、セキュリティ対策など、多岐にわたる専門知識と実務経験を持つコンサルタントが、貴社の課題解決に寄り添います。

データ活用の障壁を取り除き、全社員がデータを武器にビジネスを推進できる未来を、私たちAurant Technologiesと共に実現しませんか。貴社のビジネス成長を加速させるための具体的な一歩を、今、踏み出しましょう。

ご興味をお持ちいただけましたら、ぜひお気軽にお問い合わせください。貴社の具体的な状況をお伺いし、最適なソリューションをご提案させていただきます。