マーケティングDXを成功へ導くWebhook設計:再送、冪等性、署名検証で「壊れない配信連携」を構築する実践ガイド

マーケティングDXを加速させるWebhook連携。配信失敗、重複データ、セキュリティ不安を解消するため、「再送」「冪等性」「署名検証」の設計鉄則を徹底解説。壊れない配信連携で、ビジネス成果を最大化する実践的なノウハウを提供します。

目次 クリックで開く

マーケティングDXを成功へ導くWebhook設計:再送、冪等性、署名検証で「壊れない配信連携」を構築する実践ガイド

マーケティングDXを加速させるWebhook連携。配信失敗、重複データ、セキュリティ不安を解消するため、「再送」「冪等性」「署名検証」の設計鉄則を徹底解説。壊れない配信連携で、ビジネス成果を最大化する実践的なノウハウを提供します。

マーケティングDXを加速するWebhook連携の力:なぜ「壊れない配信」が重要か

現代のビジネス環境において、マーケティング活動はますます複雑化しています。顧客行動の多様化、Cookieless時代の到来、そしてAI・データ分析技術の進化は、企業に新たな挑戦と機会をもたらしています。このような状況下で、貴社が競争優位性を確立し、持続的な成長を実現するためには、データに基づいた迅速かつ正確な意思決定が不可欠です。

このセクションでは、マーケティングDXを加速するWebhook連携の重要性、特に「壊れない配信」がいかにビジネス価値を高めるかについて深掘りします。

AI・データ分析時代のリアルタイム連携の必要性

AIとデータ分析は、現代マーケティングの羅針盤です。顧客一人ひとりの行動や嗜好を深く理解し、パーソナライズされた体験を提供することで、顧客エンゲージメントとロイヤルティを高めることができます。しかし、そのためにはリアルタイムなデータ連携が不可欠です。顧客がウェブサイトで特定の商品を閲覧した、フォームを送信した、あるいは特定のキャンペーンに反応した、といった「今」の行動を即座に捉え、次のアクションに繋げるスピードが求められます。

例えば、ある見込み客が貴社の資料請求フォームを送信したとします。この情報がリアルタイムでCRMやMAツールに連携されなければ、営業担当者が顧客にアプローチするタイミングが遅れ、競合他社に機会を奪われる可能性があります。実際、「情報過多の現代において、顧客は企業のレスポンス速度に高い期待を抱いており、リアルタイムな対応が顧客満足度を大きく左右する」という調査結果もあります(出典:Salesforce Research)。

また、Cookieless時代においては、ファーストパーティデータをいかに効率的に収集し、活用するかがマーケティング戦略の鍵となります。Webhookは、顧客の同意を得た上で生成される貴重なファーストパーティデータを、発生と同時に連携システムへ送り出すことで、AIやデータ分析基盤が常に最新の情報を基に学習・予測を行うことを可能にします。これにより、より精度の高いターゲティングやパーソナライズを実現し、マーケティングROIの最大化に貢献します。

顧客体験(CX)向上と業務効率化におけるWebhookの役割

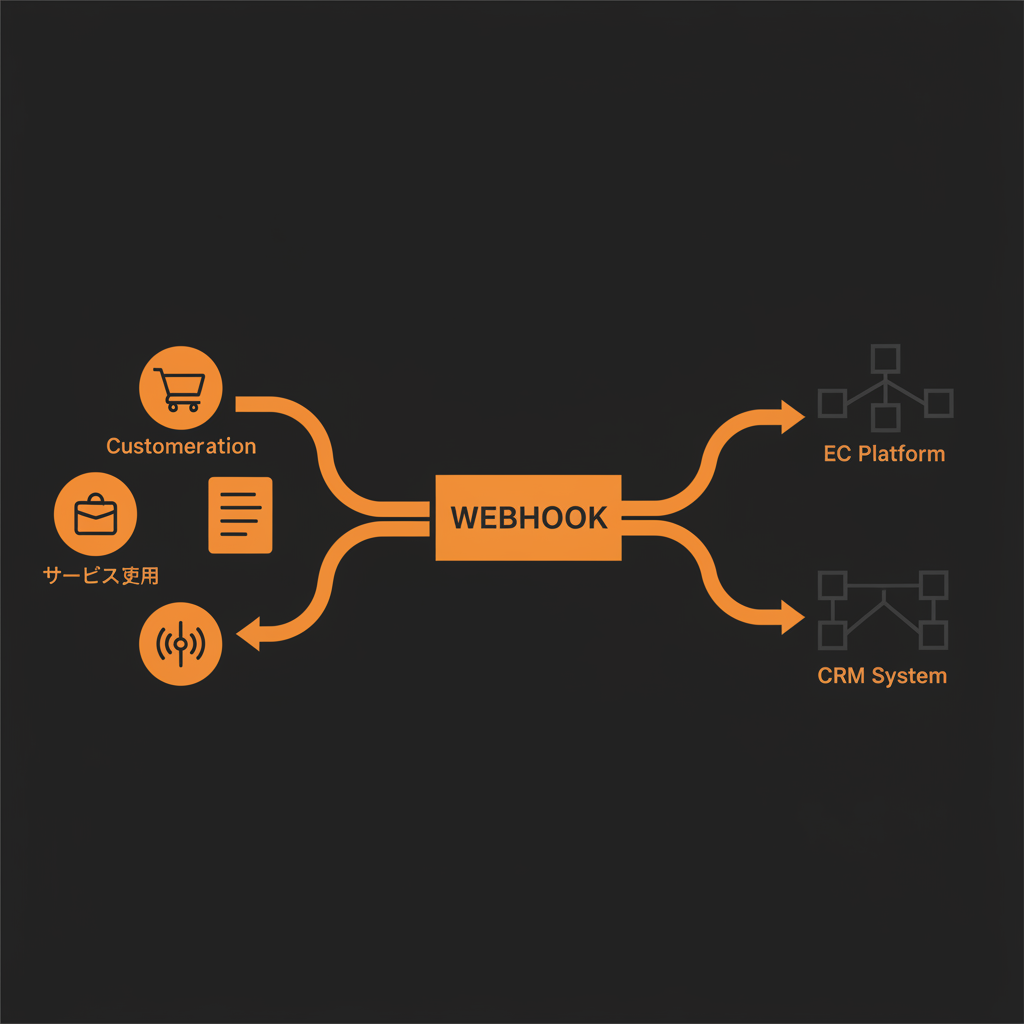

Webhookは、顧客体験(CX)の向上と業務効率化の両面で極めて重要な役割を果たします。顧客がウェブサイトで特定のアクションを起こした際、Webhookはそのイベントをトリガーとして、あらかじめ設定されたURLへデータを自動的に送信します。これにより、手動でのデータ入力やバッチ処理を待つことなく、即座に次のプロセスを実行できるため、顧客はパーソナライズされた、タイムリーな情報やサービスを受け取ることが可能になります。

例えば、ECサイトで顧客がカートに商品を追加したものの購入に至らなかった場合、Webhookを介してMAツールにその情報が連携され、数分後には自動で「カゴ落ちメール」を送信できます。このような即時性の高いアプローチは、顧客の購買意欲が高まっているタイミングを逃さず、コンバージョン率向上に直結します。ガートナーの調査によれば、「顧客体験の向上は、企業の収益成長に直接的な影響を与える」とされており、Webhookはその実現を強力に後押しします(出典:Gartner)。

さらに、業務効率化の観点では、異なるシステム間のデータ連携を自動化することで、人的ミスを削減し、従業員はより戦略的な業務に集中できるようになります。CRM、MA、EC、サポートシステムなど、複数のツールを連携させることで、顧客データの一元管理が容易になり、部門間の情報共有もスムーズになります。特に、オンラインとオフラインの顧客体験を統合するOMO(Online Merges with Offline)戦略においては、店舗での行動データとオンラインでの行動データをリアルタイムで連携させることが不可欠であり、Webhookはその中核を担う技術と言えるでしょう。

従来のデータ連携手法と比較して、Webhookがいかに優位性を持つかを表で示します。

| 項目 | Webhook | バッチ処理 |

|---|---|---|

| 連携タイミング | イベント発生と同時にリアルタイム | 定期的なスケジュール(例:1日1回、1時間ごと) |

| データの鮮度 | 常に最新 | 処理実行時点のデータ |

| システム負荷 | イベント駆動型で分散されやすい | 一括処理時に集中しやすい |

| 複雑性 | イベントとトリガーの設定が主 | データ抽出、変換、ロード(ETL)の設計が必要 |

| 適用シナリオ | リアルタイム通知、即時アクション、顧客体験向上 | 大規模データ移行、定期的なレポート作成、バックアップ |

| ビジネスインパクト | 機会損失の最小化、迅速な顧客対応、パーソナライズ強化 | データ分析基盤の構築、定常業務の自動化 |

「壊れない配信連携」がビジネスにもたらす価値

Webhookによるリアルタイム連携は多大なメリットをもたらしますが、その効果を最大限に引き出すためには「壊れない配信連携」を構築することが不可欠です。データが欠損したり、重複して配信されたり、あるいは遅延したりする「壊れた配信」は、貴社のビジネスに深刻な影響を及ぼす可能性があります。

例えば、購入完了通知が届かなかった顧客は不安を感じ、貴社への信頼を損なうかもしれません。また、プロモーションメールが二重に届いたり、誤った内容で配信されたりすれば、顧客体験を著しく損ない、ブランドイメージの低下に繋がりかねません。社内においても、データ連携の不備は業務の停滞を引き起こし、手動でのリカバリー作業によって余計なコストと時間を発生させます。デロイトトーマツの報告では、「データ品質の低下は、企業の意思決定ミスや非効率性を招き、最終的に収益に悪影響を与える」と指摘されています(出典:デロイトトーマツ『データマネジメント調査レポート』)。

「壊れない配信連携」とは、単にデータが届くこと以上の意味を持ちます。それは、イベント発生時にデータが「確実に」「一度だけ」「正しい順序で」「改ざんされずに」連携先に届くことを保証する設計思想です。この信頼性の高い連携が実現することで、貴社は以下のようなビジネス価値を享受できます。

- 顧客信頼の構築: 正確でタイムリーな情報提供により、顧客からの信頼と満足度を高めます。

- 機会損失の回避: 重要なイベントデータを見逃すことなく、ビジネスチャンスを最大限に活かします。

- 業務コストの削減: エラー対応やデータ修正にかかる時間とリソースを削減し、運用の効率化を図ります。

- データ品質の維持: 分析基盤に投入されるデータの正確性を保ち、AIやBIツールの出力精度を向上させます。

- 法的・規制遵守: 個人情報保護やデータガバナンスの観点からも、安全で信頼性の高いデータ連携は必須です。

このように、「壊れない配信連携」は、貴社のマーケティング活動の基盤を強固にし、長期的なビジネス成長と競争優位性の確立に不可欠な要素となるのです。

Webhookの基本を理解する:API連携との違いとマーケティングでの活用シーン

デジタルマーケティングの進化に伴い、企業が扱うデータ量と連携するシステムは爆発的に増加しています。顧客の行動は多様化し、リアルタイムでのパーソナライズされたコミュニケーションが求められる現代において、「壊れない配信連携」を構築することは、競争優位性を確立するための不可欠な要素です。その中心にあるのがWebhookという技術であり、その特性を深く理解し、適切に設計・運用することが成功の鍵を握ります。

Webhookとは?プッシュ型通知のメリット

Webhookは、特定のイベントが発生した際に、あらかじめ設定されたURL(エンドポイント)に対して自動的にHTTPリクエストを送信する「プッシュ型通知」のメカニズムです。これにより、システム間でリアルタイムな情報連携が可能になります。従来のデータ連携が「ポーリング」と呼ばれる、定期的に情報を問い合わせる「プル型」であったのに対し、Webhookはイベントドリブンで必要な情報を必要な時にだけ送信するため、非常に効率的です。

このプッシュ型通知の最大のメリットは、その「リアルタイム性」にあります。例えば、顧客がWebサイトで特定のアクションを起こした瞬間や、ECサイトで商品を購入した直後など、イベント発生と同時に情報が連携されるため、即座に次のアクション(例えば、パーソナライズされたメールの送信や営業担当への通知)へ移行できます。これにより、顧客体験の向上だけでなく、ビジネスプロセスの高速化と効率化が実現します。また、不要なポーリングがなくなることで、APIリクエスト数の削減やサーバー負荷の軽減にも寄与し、システムリソースの最適化にも繋がります。

APIポーリングとの比較:リアルタイム性の優位点

Webhookのメリットをより深く理解するためには、従来のAPIポーリングとの違いを明確に把握することが重要です。APIポーリングは、クライアントがサーバーに対して定期的にデータ更新を問い合わせる方式です。例えば、「5分ごとに新しい注文がないか確認する」といった処理がこれにあたります。

この方式は実装が比較的容易である一方で、いくつかの課題を抱えています。まず、リアルタイム性に欠ける点です。ポーリング間隔が短すぎるとサーバーに過剰な負荷がかかり、長すぎると情報連携に遅延が生じます。次に、無駄なリソース消費です。データが更新されていない場合でも、定期的な問い合わせが発生するため、ネットワーク帯域やサーバーリソースが無駄に消費される可能性があります。さらに、APIレートリミット(一定時間内のリクエスト数制限)に抵触するリスクも高まります。

一方、Webhookはイベント発生時にのみ通知を送信するため、これらの課題を解決します。データが更新された場合にのみ通知が来るため、常に最新の情報を即座に受け取ることができ、無駄なリクエストやリソース消費を削減できます。このリアルタイム性の優位点は、顧客の行動に即座に反応し、パーソナライズされた体験を提供する現代のマーケティングにおいて、不可欠な要素です。

| 比較項目 | Webhook(プッシュ型) | APIポーリング(プル型) |

|---|---|---|

| データ連携のタイミング | イベント発生時に即時 | 設定された間隔で定期的に |

| リアルタイム性 | 高い | ポーリング間隔に依存(遅延の可能性あり) |

| システム負荷 | イベント発生時のみ(効率的) | 定期的に発生(非効率な場合あり) |

| ネットワーク帯域 | イベント発生時のみ使用 | 定期的な問い合わせで常時使用 |

| 実装の複雑さ | 受信側のエンドポイント設定が必要 | 比較的シンプル |

| 主な用途 | リアルタイム通知、イベント駆動型処理 | 定期的なデータ同期、バッチ処理 |

マーケティングオートメーション(MA)とCRM連携

Webhookは、マーケティングオートメーション(MA)ツールと顧客関係管理(CRM)システムの連携において、その真価を発揮します。顧客がWebサイトを訪問し、特定のページを閲覧したり、資料をダウンロードしたり、フォームを送信したりといった行動は、MAツールによってリアルタイムで捕捉されます。これらの「イベント」をトリガーとしてWebhookを発動させることで、MAツールは即座にCRMシステムへ情報を連携できます。

例えば、ある見込み客が価格ページを3回以上閲覧したというイベントが発生したとします。このイベントをWebhookでCRMに通知することで、CRMは自動的にその見込み客のリードスコアを更新し、同時に担当営業に「ホットリードが発生しました」という通知を送信するといったワークフローを組むことができます。営業担当は、見込み客が最も関心を持っているタイミングでアプローチできるため、商談化率の向上に直結します。

また、CRMで顧客情報が更新された際にMAツールにWebhookで通知し、顧客の属性や購買履歴に基づいたパーソナライズされたメールキャンペーンを自動的に開始するといった連携も可能です。これにより、顧客は常に自身の状況に合わせた最適な情報を受け取ることができ、顧客体験が大幅に向上します。

ECサイトのイベント通知と顧客行動分析

ECサイトにおけるWebhookの活用は、顧客行動のリアルタイム分析と、それに基づいたパーソナライズされたマーケティング施策の実行を可能にします。購入完了、カート放棄、商品レビュー投稿、お気に入り登録、在庫状況の変化など、ECサイトで発生するあらゆるイベントをWebhookのトリガーとすることができます。

例えば、顧客が商品をカートに入れたものの、購入を完了せずにサイトを離脱した「カート放棄」のイベントが発生したとします。このイベントをWebhookでマーケティングシステムに通知することで、顧客がサイトを離れてから数分以内に「カートに入れた商品が残っています」というリマインドメールを自動送信したり、割引クーポンを提示したりする「カゴ落ち対策」をリアルタイムで実行できます。これにより、機会損失を最小限に抑え、コンバージョン率の向上に貢献します。

また、顧客が購入した商品の情報や閲覧履歴をWebhookでデータ分析基盤に連携することで、個々の顧客の購買傾向や好みを詳細に分析できます。このデータに基づき、次に購入する可能性が高い商品をレコメンドしたり、パーソナライズされた商品情報を提供したりすることで、顧客エンゲージメントを高め、リピート購入を促進することが可能です。これは、サードパーティーCookieの規制が進む「Cookieless時代」において、ファーストパーティーデータを活用した顧客理解とパーソナライズの重要性が高まる中で、特に有効な戦略となります。

LINEなどメッセージングツールとの連携

現代のマーケティングにおいて、顧客とのコミュニケーションチャネルは多岐にわたりますが、特にLINEなどのメッセージングツールは、その手軽さと高い開封率から重要な役割を担っています。Webhookを活用することで、これらのメッセージングツールと他のシステムを連携させ、よりパーソナライズされたリアルタイムな顧客コミュニケーションを実現できます。

例えば、顧客がLINE公式アカウントを通じて特定のキーワードを送信した場合、そのイベントをWebhookでバックエンドシステムに通知し、あらかじめ設定された情報(例:よくある質問への回答、キャンペーン情報、最寄りの店舗情報など)を自動で返信するチャットボットを構築できます。これにより、顧客は待つことなく必要な情報を得られ、企業は問い合わせ対応の効率化を図ることができます。

さらに、ECサイトでの購入完了、発送通知、ポイント付与などのイベントをWebhookでLINEに連携し、顧客にプッシュ通知として送信することも可能です。これにより、顧客は重要な情報をタイムリーに受け取ることができ、安心感と利便性が向上します。ある調査によれば、LINEのメッセージはメールと比較して高い開封率を誇るとされており(出典:LINE for Business「LINE公式アカウント活用事例」など)、Webhookによるリアルタイム通知は、顧客エンゲージメントの強化に非常に効果的です。メッセージングツールとの連携は、顧客との距離を縮め、より密接な関係を築くための強力な手段です。

配信失敗を許さない!Webhookの「再送(リトライ)」設計の鉄則

Webhookは、システム間のリアルタイムなデータ連携を実現する強力なツールです。マーケティングオートメーションにおけるリードスコアリングの更新、CRMへの顧客情報連携、ECサイトの注文ステータス通知など、その用途は多岐にわたります。しかし、このリアルタイム性が求められる連携において、一度の配信失敗がビジネスプロセス全体に大きな影響を与えかねません。

「一度送ったら終わり」の設計では、予期せぬ事態によって重要なデータが失われたり、連携が途絶えたりするリスクを常に抱えることになります。ここでは、いかにして配信失敗を許さない“壊れない”Webhook連携を構築するか、その核となる「再送(リトライ)」設計の鉄則を解説します。

なぜ再送が必要なのか:ネットワーク障害と受信側システムの負荷

Webhookの配信失敗は、決して珍しいことではありません。その原因は多岐にわたりますが、主に以下の二つに集約されます。

- 一時的なネットワーク障害: インターネットは常に安定しているわけではありません。送信側と受信側を結ぶ経路で、一時的な通信遅延やパケットロスが発生することは日常茶飯事です。数秒から数分で回復するような軽微な障害でも、その瞬間にWebhookが送信されれば、配信は失敗します。

- 受信側システムの負荷・障害: 貴社の連携先システムや、貴社が開発したWebhook受信エンドポイントも、常に完璧に稼働しているとは限りません。アクセス集中による過負荷、データベースのロック、デプロイ中のサービス停止、予期せぬバグなど、様々な要因で一時的にリクエストを処理できない状態になることがあります。例えば、ピーク時に処理能力を超えたリクエストが集中し、HTTP 503 (Service Unavailable) エラーを返すようなケースです。

これらの「一時的な」問題によって、重要なデータ連携が途絶えることは、ビジネスにとって大きな損失です。例えば、新規リード情報がCRMに連携されずフォローアップが遅れれば、商談機会を逸失する可能性があります。キャンペーンの成果データがリアルタイムに集計されなければ、迅速な施策改善ができません。手動でのデータ再入力やエラー調査には、時間とコストがかかり、従業員の生産性を低下させます。だからこそ、Webhook設計においては、これらの問題を織り込み、自動的に「再送」する仕組みが不可欠となるのです。

リトライポリシーの設計:回数、間隔、指数バックオフ

「再送」の重要性は理解できても、闇雲に再送を繰り返すのは賢明ではありません。無制限に再送を試みると、送信側システムのリソースを浪費するだけでなく、受信側システムにさらなる負荷をかけ、状況を悪化させる可能性もあります。そこで重要になるのが、効果的な「リトライポリシー」の設計です。

リトライポリシーの主要要素

- リトライ回数 (Max Retries): 何回まで再送を試みるかを明確に定義します。通常は5回から10回程度が一般的ですが、データの重要性や連携のリアルタイム性に応じて調整します。無限ループを防ぐため、必ず上限を設定してください。

- リトライ間隔 (Retry Interval): 再送を試みる際の時間間隔です。最初から長い間隔を置くのではなく、受信側システムが回復するまでの時間を考慮し、段階的に間隔を広げていく「指数バックオフ(Exponential Backoff)」が推奨されます。

- 指数バックオフ (Exponential Backoff): これは、リトライ間隔を徐々に長くしていく戦略です。例えば、1回目は1秒後、2回目は2秒後、3回目は4秒後、4回目は8秒後、といった形で、失敗するごとに間隔を指数関数的に増加させます。これにより、一時的な障害であれば早期に回復し、より深刻な障害であれば受信側システムに回復の時間を与え、過度な負荷を避けることができます。

- ジッター (Jitter): 指数バックオフに加えて、リトライ間隔にランダムな遅延(ジッター)を加えることも重要です。多数のWebhookが同時に失敗した場合、指数バックオフだけでは、それらがほぼ同時に再送され、再び受信側システムに集中攻撃を仕掛ける可能性があります。ジッターを導入することで、再送タイミングが分散され、受信側システムへの負荷スパイクを緩和できます。

- リトライ条件: 全てのHTTPエラーコードに対して再送するのではなく、リトライすべきエラーとそうでないエラーを区別します。

- リトライすべきエラー: HTTP 5xx系(Server Error)のエラーコード(例: 500 Internal Server Error, 502 Bad Gateway, 503 Service Unavailable, 504 Gateway Timeout)は、一時的なサーバー側の問題を示すため、再送が有効です。

- リトライすべきでないエラー: HTTP 4xx系(Client Error)のエラーコード(例: 400 Bad Request, 401 Unauthorized, 403 Forbidden, 404 Not Found, 422 Unprocessable Entity)は、リクエストの内容や認証情報に問題があることを示すため、再送しても成功する見込みはほとんどありません。これらのエラーに対しては、再送ではなく、設定の見直しや開発者への通知といった対応が必要です。

以下に、一般的なリトライポリシーの例を示します。

| リトライ回数 | リトライ間隔(指数バックオフ + ジッター) | 合計経過時間(概算) |

|---|---|---|

| 1回目 | 1秒後 + ランダム0〜0.5秒 | 1〜1.5秒 |

| 2回目 | 2秒後 + ランダム0〜1秒 | 3〜4.5秒 |

| 3回目 | 4秒後 + ランダム0〜2秒 | 7〜10.5秒 |

| 4回目 | 8秒後 + ランダム0〜4秒 | 15〜22.5秒 |

| 5回目 | 16秒後 + ランダム0〜8秒 | 31〜47.5秒 |

| 6回目 | 32秒後 + ランダム0〜16秒 | 63〜95.5秒 |

| 7回目 | 64秒後 + ランダム0〜32秒 | 127〜191.5秒 (約2〜3分) |

| 8回目 | 128秒後 + ランダム0〜64秒 | 255〜383.5秒 (約4〜6分) |

この例では、約4〜6分間にわたり最大8回のリトライを試みます。多くのSaaS連携やクラウドサービスでは、この程度のポリシーで一時的な障害のほとんどを吸収できるとされています。

デッドレターキュー(DLQ)による未処理イベントの管理

リトライポリシーで定められた最大回数を試行してもなおWebhookの配信が成功しなかった場合、そのイベントは「処理できなかった」と見なされます。この「最終的に失敗したイベント」をどのように扱うかが、システムの堅牢性を左右します。ここで登場するのが「デッドレターキュー(Dead Letter Queue, DLQ)」です。

DLQの役割とメリット

DLQは、リトライを尽くしても処理できなかったメッセージやイベントを隔離・保存するための特別なキュー(待ち行列)です。DLQを導入することで、以下のメリットが得られます。

- イベントの喪失防止: 配信できなかった重要なイベントがシステムから完全に失われることを防ぎます。これにより、ビジネス上の機会損失やデータの整合性問題を防ぐことができます。

- エラー原因の分析とデバッグ: DLQに格納されたイベントには、元のペイロード、エラー内容、試行回数、失敗したタイムスタンプなどの詳細な情報が付与されます。これにより、開発者や運用担当者は、後からエラーの原因を詳細に分析し、デバッグ作業を効率的に進めることができます。

- システム全体の安定性向上: 処理できないイベントがメインの処理フローに残り続けることを防ぎ、システム全体のパフォーマンス低下や障害の連鎖を防ぎます。DLQは、一種の「セーフティネット」として機能します。

- 手動または自動での再処理: DLQに蓄積されたイベントは、システムが回復した後や、エラー原因が特定・修正された後に、手動で再処理したり、別の自動プロセスで一括処理したりすることが可能です。

DLQの実装例

DLQは、AWS SQS (Simple Queue Service) のデッドレターキュー機能、Apache Kafkaの専用トピック、RabbitMQのデッドレターエクスチェンジなど、様々なメッセージキューイングサービスやミドルウェアで実装できます。貴社の技術スタックやクラウド環境に合わせて最適なものを選択してください。

DLQにイベントを格納する際は、単に元のペイロードだけでなく、なぜDLQに入ったのかを示すメタデータ(最終エラーコード、エラーメッセージ、リトライ回数、失敗した日時など)も合わせて記録することが重要です。これにより、後続の分析や再処理が格段に容易になります。

監視とアラート:異常検知と迅速な対応

どれほど精緻なリトライポリシーやDLQを設計しても、それらが適切に機能しているかを常に把握し、異常を早期に検知するための「監視」は不可欠です。そして、異常を検知した際には、関係者に迅速に通知する「アラート」の仕組みも併せて構築する必要があります。

監視すべき主要な指標

- Webhook配信成功率/失敗率: 全体的な配信状況を把握するための最も基本的な指標です。成功率が著しく低下したり、失敗率が急上昇したりした場合は、何らかの異常が発生している可能性が高いです。

- リトライ回数 (平均/最大): リトライが頻繁に発生しているということは、連携先システムが不安定であるか、一時的なネットワーク問題が多発していることを示唆します。平均リトライ回数の増加や、特定のWebhookで最大リトライ回数に達するケースの増加は、注目すべき兆候です。

- DLQに格納されたイベント数: DLQにイベントが蓄積され始めたら、最終的に処理できなかったイベントが増えていることを意味します。この数値の急増は、深刻な障害が発生している可能性を示します。

- Webhook受信側の応答時間 (レスポンスタイム): 貴社がWebhookを受信する側のシステムを持つ場合、そのエンドポイントの応答速度を監視することも重要です。応答時間が長くなると、タイムアウトエラーにつながり、リトライが頻発する原因となります。

- 特定のエラーコードの発生頻度: HTTP 5xx系エラーの発生頻度や、特定の4xx系エラー(例: 401 Unauthorized)が急増した場合など、エラーコードごとの監視も有効です。

アラート設定と対応

これらの監視指標に基づいて、適切なアラートを設定します。例えば、以下のような条件でアラートを発動させます。

- Webhook配信失敗率が過去1時間で5%を超えた場合

- DLQに格納されたイベント数が過去10分間で100件を超えた場合

- 特定のWebhookで、リトライ回数が連続して最大回数に達するケースが5回以上発生した場合

アラートは、Slack、メール、PagerDutyなどのツールを通じて、適切な担当者(開発チーム、運用チーム、マーケティング担当者など)に通知されるように設定します。単に通知するだけでなく、アラートの深刻度に応じたエスカレーションポリシー(例: 重大なアラートは夜間でも担当者の携帯電話に通知する)を定義し、迅速な原因究明と対応を促す体制を構築することが重要です。

私たちAurant Technologiesが支援した某SaaS企業では、Webhook連携の監視とアラートを強化したことで、以前は数時間〜半日かかっていた連携障害の検知と初動対応時間を、平均で15分以内に短縮することに成功しました。これにより、顧客への影響を最小限に抑え、顧客満足度と運用品質の向上に貢献しています。

これらの監視とアラートの仕組みを整備することで、貴社のWebhook連携は、ただ壊れないだけでなく、「異常をいち早く察知し、迅速に対処できる」真に堅牢なシステムへと進化するでしょう。

重複データでシステムを壊さない!「冪等性」担保のWebhook設計

Webhook連携において、システムが「壊れる」原因の一つに、意図しない重複データの発生があります。ネットワークの瞬断やタイムアウト、受信側の処理エラーなど、さまざまな理由でWebhookイベントが複数回送信されることは珍しくありません。このような「再送」のメカニズムは、配信の信頼性を高める上で不可欠ですが、同時に受信側システムが同じイベントを複数回処理してしまうリスクも伴います。

ここで重要になるのが「冪等性(Idempotency)」です。この概念をWebhook設計に組み込むことで、たとえ同じイベントが何度送られてきても、貴社システムは常に一貫した正しい状態を保ち、「壊れない」堅牢な連携を実現できます。

冪等性とは?同じ操作を何度行っても結果が変わらないこと

冪等性とは、ある操作を1回実行しても、複数回実行しても、最終的な結果が常に同じになる性質を指します。プログラミングやシステム設計の文脈では、特にデータの書き込みや状態変更を伴う操作において、この性質を担保することが極めて重要です。

例えば、ECサイトの注文処理を考えてみましょう。もし注文完了のWebhookがシステム障害で再送され、冪等性が担保されていないと、同じ注文が二重に登録されたり、顧客に二重請求が発生したりする可能性があります。これでは顧客体験が著しく損なわれるだけでなく、貴社の運用コストや信用にも大きなダメージを与えかねません。

Webhookの文脈では、送信元システムは配信の信頼性を高めるために「At-Least-Once(少なくとも1回)」の配信保証を行うことが一般的です。これは、イベントが確実に受信側に届くように、必要に応じて複数回再送する戦略です。この再送メカニズムを前提とする以上、受信側システムは「重複したイベントが届く可能性がある」ことを織り込み、冪等性を担保した設計を行う必要があります。

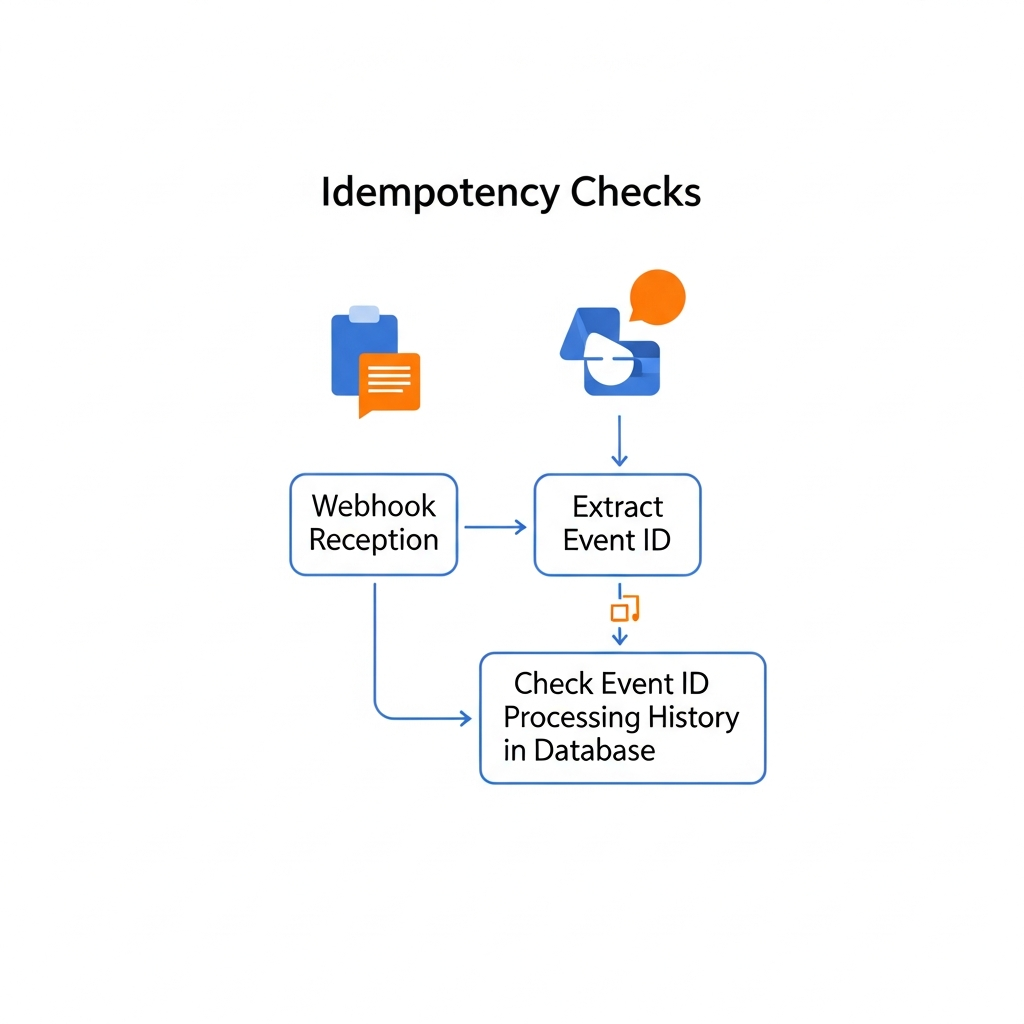

イベントIDの活用:ユニークな識別子で重複を排除

Webhook連携で冪等性を実現するための最も基本的なアプローチは、各イベントにユニークな識別子(イベントIDまたはリクエストID)を付与することです。

送信元システムは、Webhookペイロード(通知データ)にこのユニークなイベントIDを含めて送信します。このIDは、UUID(Universally Unique Identifier)のような衝突しにくい形式で生成されるのが一般的です。例えば、StripeやGitHubなどの主要なWebhookプロバイダーは、ペイロード内にユニークなイベントIDを含めています(例:Stripeのidフィールド、GitHubのX-GitHub-Deliveryヘッダーなど)。

受信側システムは、Webhookを受信するたびに、まずこのイベントIDをチェックします。そして、過去に同じイベントIDを持つリクエストを処理した履歴がないかを確認します。もし同じIDのイベントが既に処理済みであれば、そのリクエストは無視するか、成功応答を返して実際の処理は行いません。これにより、重複した操作を防ぎ、結果の一貫性を保証します。

このイベントIDは、データベースの主キーやユニークインデックスとして利用することで、効率的かつ確実に重複を排除できます。例えば、webhook_eventsのようなテーブルを作成し、event_idカラムにユニーク制約を設けることで、二度目以降の同じIDの挿入はデータベースレベルで拒否されます。

受信側システムでの冪等性実装パターン

受信側システムで冪等性を実装する方法はいくつかありますが、貴社のシステム要件やアーキテクチャに応じて最適なパターンを選択することが重要です。ここでは主要な実装パターンとその特徴を表で比較します。

| 実装パターン | 説明 | メリット | デメリット | 適用シーン |

|---|---|---|---|---|

| データベースのユニーク制約 | 受信したイベントIDを専用テーブルに保存し、event_idカラムにユニーク制約を設定。二度目以降の同じIDの挿入はDBが自動で拒否。 |

|

|

ほとんどのWebhook処理。特にデータ永続化が重要な場合。 |

| 処理ステータス管理 | イベントIDと共に処理のステータス(PENDING, PROCESSING, COMPLETED, FAILEDなど)を管理。処理開始時にステータスを確認・更新。 |

|

|

長時間かかる処理、複数ステップにわたる処理、複雑なビジネスロジックを持つ場合。 |

| 分散ロック(Redisなど) | イベントIDをキーとして、分散キャッシュシステム(Redisなど)でロックを取得。ロックが取れない場合は重複と判断し処理をスキップ。 |

|

|

高スループットが求められるシステム、マイクロサービスアーキテクチャ。 |

これらのパターンを単独で使うだけでなく、組み合わせてより堅牢なシステムを構築することも可能です。例えば、データベースのユニーク制約を基本としつつ、高負荷時には分散ロックを併用するといった戦略が考えられます。

貴社がWebhookを受信し、冪等性を担保する際の一般的なフローは以下のようになります。

「At-Least-Once」配信と冪等性の関係

前述の通り、多くのWebhookプロバイダーは「At-Least-Once(少なくとも1回)」の配信保証を採用しています。これは、イベントが一度も届かないことを避けるために、ネットワーク障害や受信側の一時的なエラーが発生した場合に、同じイベントを複数回再送する可能性があることを意味します。このアプローチは、配信の信頼性を最大限に高めるための実用的な選択です。

しかし、At-Least-Once配信は、受信側システムが冪等性を持たない場合、重複処理による問題を引き起こすリスクがあります。例えば、注文処理のWebhookが3回再送された場合、冪等性がなければ3件の注文が生成されてしまいます。

これに対し、「Exactly-Once(厳密に1回)」の配信保証は、理論上は理想的ですが、分散システムにおいては非常に実現が困難であり、パフォーマンスや複雑性の面で現実的ではありません。そのため、Webhook設計においては、送信元がAt-Least-Once配信を行うことを前提とし、受信側が冪等性を担保することで、結果的にExactly-Onceに限りなく近い状態を実現するのがベストプラクティスとされています。

つまり、Webhook連携において「壊れない」システムを構築するには、送信元のAt-Least-Once配信メカニズムを理解し、それに対応する形で受信側システムに冪等性ロジックを組み込むことが不可欠です。これにより、貴社のマーケティング施策や業務プロセスが、予期せぬ重複データによって混乱することなく、常に安定して稼働するようになります。

セキュリティを確保する:Webhookの「署名検証」で不正アクセスを防ぐ

Webhookはリアルタイムなデータ連携を実現する強力なツールですが、その利便性の裏にはセキュリティ上のリスクが潜んでいます。インターネット上に公開されたエンドポイントで外部からのデータを受信するため、適切な対策を怠ると、不正アクセスやデータ改ざんの標的となる可能性があります。ここでは、Webhookのセキュリティを確保するための最も重要な仕組みの一つである「署名検証」について、その必要性から具体的な実装方法までを詳しく解説します。

なぜ署名検証が必要なのか:なりすましとデータ改ざんのリスク

Webhookは、その性質上、外部からのリクエストを無条件に受け入れることが前提となります。しかし、この「無条件」がセキュリティ上の弱点となり得ます。署名検証が導入されていないWebhookエンドポイントは、以下のリスクに晒されることになります。

- なりすまし(Spoofing): 攻撃者が正規の送信元を装い、偽のイベントデータを貴社のシステムに送信する可能性があります。これにより、誤った処理が実行されたり、データベースが汚染されたりする危険性があります。例えば、架空の注文データが生成されたり、顧客情報が不正に更新されたりするシナリオが考えられます。

- データ改ざん(Tampering): 攻撃者が送信元と受信元の中間に割り込み、送信中のWebhookペイロードの内容を不正に変更する可能性があります。これにより、意図しないデータがシステムに登録されたり、重要な情報が漏洩したりするリスクがあります。例えば、価格情報が変更されたり、配送先が書き換えられたりすることが考えられます。

- リプレイアタック(Replay Attack): 攻撃者が過去に送信された正当なWebhookイベントを傍受し、それを繰り返し貴社のシステムに送信することで、同じ処理を何度も実行させようとするものです。例えば、一度の決済イベントが何度も発生したり、同じ通知が繰り返し送られたりする可能性があります。

これらのリスクは、貴社の業務システムに重大な影響を及ぼし、事業継続性や顧客からの信頼を損なうことにつながりかねません。特に、マーケティングオートメーションやCRM、ECサイトなど、顧客データや取引情報を取り扱うシステムでは、厳重なセキュリティ対策が不可欠です。

署名検証がない場合の主なセキュリティリスクを以下の表にまとめました。

| リスクの種類 | 説明 | 潜在的な影響 | 対策(署名検証) |

|---|---|---|---|

| なりすまし(Spoofing) | 攻撃者が正規のサービスを装い、偽のWebhookイベントを送信する。 |

|

送信元の正当性を検証し、偽のリクエストを拒否できる。 |

| データ改ざん(Tampering) | 送信中のWebhookペイロードの内容が、攻撃者によって不正に変更される。 |

|

ペイロードの整合性を検証し、改ざんされたリクエストを拒否できる。 |

| リプレイアタック(Replay Attack) | 過去に送信された正当なWebhookイベントが、攻撃者によって繰り返し送信される。 |

|

タイムスタンプの検証により、古いリクエストを拒否できる。 |

署名生成の仕組み:ハッシュ関数とシークレットキー

Webhookの署名検証は、送信側と受信側で共有する「シークレットキー」と「ハッシュ関数」を利用して行われます。基本的な流れは以下の通りです。

- シークレットキーの共有: 送信側と受信側で事前に、推測されにくいランダムな文字列であるシークレットキーを共有します。これはパスワードのようなもので、絶対に外部に漏洩してはいけません。

- 署名の生成: 送信側は、Webhookのペイロード(イベントデータ)と、リクエストが発生した時刻を示すタイムスタンプ、そして共有されたシークレットキーを結合し、ハッシュ関数(例: HMAC-SHA256)に入力します。ハッシュ関数は、入力されたデータから固定長の「署名(Signature)」を生成します。この署名は、入力データが少しでも変わると全く異なる値になるという特性(不可逆性)を持っています。

- 署名の付与: 生成された署名は、通常、HTTPリクエストヘッダー(例:

X-Hub-Signature,Stripe-Signatureなど)として、タイムスタンプとともにWebhookリクエストに付与されます。

多くのサービスプロバイダーでは、この署名生成に「HMAC-SHA256」というアルゴリズムが採用されています。HMAC(Keyed-Hash Message Authentication Code)は、共有されたシークレットキーを使ってメッセージの認証コードを生成する仕組みであり、SHA256はハッシュ関数の具体的な種類です。これにより、シークレットキーを知らない第三者がペイロードを改ざんしたり、偽の署名を生成したりすることは極めて困難になります。

受信側での署名検証プロセス

貴社のシステムがWebhookリクエストを受信した際、以下の手順で署名を検証します。

- ヘッダー情報の取得: 受信したHTTPリクエストから、署名ヘッダー(例:

X-Hub-Signature)とタイムスタンプ(例:X-Hub-Timestamp)を取得します。 - 共有シークレットキーの取得: 事前に共有しておいたシークレットキーを安全な場所(環境変数、キー管理サービスなど)から取得します。

- 署名の再生成: 受信したWebhookリクエストの生ペイロードと、受信したタイムスタンプ、そして取得したシークレットキーを使い、送信側と同じハッシュ関数(例: HMAC-SHA256)で署名を再生成します。

- 署名の比較: 貴社システムで再生成した署名と、リクエストヘッダーに付与されていた署名とを比較します。両者が完全に一致すれば、ペイロードは改ざんされておらず、正規の送信元から送られてきたと判断できます。

- 検証結果に基づく処理:

- 一致した場合: Webhookイベントは正当なものとして、貴社のビジネスロジックを実行します。

- 不一致の場合: 不正なリクエストとして処理を拒否し、エラーログを記録します。これにより、潜在的な攻撃を検知し、システムへの悪影響を防ぎます。

この検証プロセスは、Webhook連携のセキュリティ基盤を築く上で不可欠です。実装を誤ると、せっかくの署名検証が機能しなくなるため、慎重な設計とテストが求められます。

| ステップ | 詳細 | 注意点 |

|---|---|---|

| 1. ヘッダー情報取得 | 受信したHTTPリクエストから、署名ヘッダー(例: X-Hub-Signature)とタイムスタンプヘッダーを取得する。 |

ヘッダー名やフォーマットはサービスによって異なるため、APIドキュメントを確認する。 |

| 2. シークレットキー取得 | 貴社システムに設定済みの共有シークレットキーを安全に取得する。 | シークレットキーは環境変数やキー管理サービスで管理し、コードに直接書き込まない。 |

| 3. ペイロード取得 | 受信したHTTPリクエストの生ペイロード(JSONなど)を、パースせずにそのまま取得する。 | ペイロードをパースしてから署名生成に使用すると、文字コードの違いなどで署名が一致しない場合がある。 |

| 4. 署名再生成 | 取得したペイロード、タイムスタンプ、シークレットキーを用いて、送信側と同じアルゴリズム(例: HMAC-SHA256)で署名を再生成する。 | ハッシュアルゴリズム、エンコーディング、キーの扱い方など、送信側の仕様に厳密に従う。 |

| 5. 署名比較 | 再生成した署名と、リクエストヘッダーから取得した署名を比較する。 | 文字列比較ではなく、バイト列として比較することで、タイミング攻撃への耐性を高める場合もある。 |

| 6. タイムスタンプ検証 | 取得したタイムスタンプが、現在の時刻から許容範囲内にあるかを確認する(リプレイアタック対策)。 | 許容時間範囲はサービスやセキュリティポリシーによって設定する。 |

| 7. 結果に基づく処理 | 全ての検証が成功した場合のみ、ビジネスロジックを実行。失敗した場合はエラー応答を返し、ログを記録する。 | エラーログには、不正なリクエストの詳細を含め、監視体制を整える。 |

タイムスタンプとリプレイアタック対策

署名検証だけでは防ぎきれない攻撃の一つに「リプレイアタック」があります。これは、攻撃者が過去に送信された正当なWebhookリクエストを傍受し、それを繰り返し貴社のシステムに送信することで、同じ処理を何度も実行させようとするものです。例えば、一度の決済イベントが何度も発生したり、同じ通知が繰り返し送られたりする可能性があります。

このリプレイアタックを防ぐために有効なのが、Webhookに「タイムスタンプ」を付与し、受信側でその有効期限を検証する仕組みです。

- タイムスタンプの付与: 送信側は、Webhookリクエストを送信する際に、現在の時刻をタイムスタンプとしてペイロードの一部、またはHTTPヘッダーに含めます。

- タイムスタンプの検証: 受信側は、このタイムスタンプを取得し、現在の時刻と比較します。もしタイムスタンプが「現在時刻からX分以上前」である場合、そのリクエストは古いものと判断し、不正なリプレイアタックの可能性があるとして処理を拒否します。

一般的に、許容される時間範囲は数分(例えば、5分から10分)に設定されます。ネットワーク遅延などを考慮しつつ、セキュリティと実用性のバランスを取る必要があります。このタイムスタンプ検証と署名検証を組み合わせることで、なりすまし、データ改ざん、そしてリプレイアタックという主要な脅威からWebhook連携を保護し、「壊れない配信連携」を強固なものにすることができます。

貴社がWebhookを導入する際には、これらのセキュリティ対策を設計段階から組み込むことが、長期的な安定運用と信頼性確保の鍵となります。

「壊れない配信連携」を実現する追加の設計原則と運用ポイント

Webhookを活用したシステム連携は、現代のデジタルマーケティングや業務自動化において不可欠な要素となっています。しかし、単にイベントを送信するだけでなく、予期せぬ障害や負荷増大にも耐えうる「壊れない配信連携」を構築するには、追加の設計原則と運用上の工夫が求められます。ここでは、貴社のシステムが長期的に安定稼働するための重要なポイントを解説します。

エラーハンドリングの設計:具体的なエラーコードとメッセージ

Webhook連携において、エラーの発生は避けられない現実です。重要なのは、エラーが発生した際にそれをいかに迅速に検知し、適切に処理するかというエラーハンドリングの設計です。送信側と受信側の両方で、標準化されたエラーコードとメッセージを定義することで、問題の特定と解決を格段に効率化できます。

具体的には、HTTPステータスコードを適切に活用することが基本です。例えば、リクエストの形式が不正であれば 400 Bad Request、認証情報に問題があれば 401 Unauthorized、サーバー内部で予期せぬエラーが発生した場合は 500 Internal Server Error を返すといった具合です。

さらに、単にHTTPステータスコードを返すだけでなく、レスポンスボディに詳細なエラーメッセージを含めることで、原因特定の手がかりを増やします。このメッセージは、人間が読解できる形式であると同時に、プログラムで解析しやすい構造化された形式(例:JSON)であることが望ましいです。エラーメッセージには、固有のエラーコード、具体的な問題点、そして可能であれば解決策のヒントを含めると良いでしょう。

私たちの経験では、顧客企業がAPI連携で直面する課題の多くは、このエラーハンドリングの設計不足に起因しています。特に、500 Internal Server Error のみが返され、具体的な原因が不明なために調査に膨大な時間を要するケースが散見されます。詳細なエラーメッセージの設計は、開発・運用コスト削減に直結します。

以下に、Webhook連携でよく使われるHTTPステータスコードとその意味、推奨される対応をまとめました。

| HTTPステータスコード | 意味 | 推奨される送信側(Webhookプロバイダー)の対応 | 推奨される受信側(Webhookコンシューマー)の対応 |

|---|---|---|---|

200 OK |

リクエスト成功、正常処理 | 配信成功として記録、再送不要 | イベントを正常に処理 |

202 Accepted |

リクエスト受理、非同期処理 | 配信成功として記録、再送不要(処理完了は別途確認) | イベントを受理し、バックグラウンドで処理 |

400 Bad Request |

リクエスト形式が不正、ペイロードが無効 | ログに記録、再送せずにエラーとして通知 | リクエストの形式や内容を検証、詳細なエラーメッセージを返す |

401 Unauthorized |

認証情報が無効または不足 | ログに記録、再送せずにエラーとして通知 | 認証情報の有効性を確認、適切なエラーメッセージを返す |

403 Forbidden |

アクセス権限がない | ログに記録、再送せずにエラーとして通知 | アクセス制御(ACL)を確認、権限不足を通知 |

404 Not Found |

Webhookエンドポイントが見つからない | ログに記録、再送せずにエラーとして通知(登録解除を検討) | エンドポイントURLの存在を確認 |

409 Conflict |

リソースの競合、重複処理 | ログに記録、再送は避ける(冪等性設計が重要) | リクエストが既存リソースと競合する旨を通知 |

429 Too Many Requests |

レートリミット超過 | 指数バックオフで再送を試みる | レートリミット情報をヘッダーに含め、処理を一時停止 |

500 Internal Server Error |

受信側サーバーの内部エラー | 指数バックオフで再送を試みる | 内部エラーを詳細にログに記録、可能であれば回復を試みる |

503 Service Unavailable |

受信側サービスが一時的に利用不可 | 指数バックオフで再送を試みる | サービスの状態を監視、復旧後に処理を再開 |

スケーラビリティと負荷分散:大量イベントへの対応

マーケティングキャンペーンの成功やビジネスの成長に伴い、Webhookイベントの発生頻度やデータ量は増加の一途を辿ります。システムがこの増大する負荷に耐えられなければ、イベントの遅延や欠損、最悪の場合はサービス停止につながりかねません。スケーラビリティと負荷分散の設計は、「壊れない配信連携」の基盤となります。

最も基本的なアプローチは、Webhookイベントの処理を非同期化することです。受信側はイベントを受け取ったら即座に 200 OK または 202 Accepted を返し、実際の処理はメッセージキュー(例:Amazon SQS, RabbitMQ, Kafka)を介してバックグラウンドのワーカープロセスに任せます。これにより、Webhookの応答時間を短縮し、イベントの取りこぼしを防ぎます。

次に、受信側のシステム全体をスケーラブルに設計します。ロードバランサーを導入して複数のアプリケーションサーバーにトラフィックを分散させ、必要に応じてサーバーインスタンスを自動的に増減させるオートスケーリング機能を活用します。クラウドサービスを利用している場合、これらの機能は比較的容易に実装できます。

送信側(Webhookプロバイダー)も、受信側の処理能力を考慮した設計が必要です。レートリミットを設定し、一度に大量のイベントを送りつけすぎないように制御することで、受信側への過負荷を防ぎます。これは、受信側が 429 Too Many Requests を返してきた場合に、送信側が自動的に配信速度を調整する仕組みと連携させるのが理想的です。

私たちがある大規模ECサイトの顧客を支援した際、キャンペーン期間中にWebhookイベントが通常の10倍以上に急増し、システムがダウン寸前になったことがありました。その際、上記のようなメッセージキューとオートスケーリングを導入した結果、ピーク時でも安定稼働を維持し、イベント処理の遅延をほぼゼロに抑えることができました。

| スケーラビリティ向上技術 | 概要 | メリット | 考慮点 |

|---|---|---|---|

| メッセージキュー | イベントを一時的に保持し、後続の処理を非同期化する仕組み。 |

|

|

| ロードバランサー | 複数のサーバーにトラフィックを分散させる装置またはサービス。 |

|

|

| オートスケーリング | 負荷に応じて自動的にサーバーインスタンスを増減させる機能。 |

|

|

| レートリミット | APIコールやイベント配信の頻度を制限する仕組み。 |

|

|

ロギングとトレーシング:問題発生時の原因特定

「壊れない配信連携」を運用する上で、問題が発生した際に何が起こったのかを迅速に把握できる能力は極めて重要です。ロギングとトレーシングは、この原因特定のプロセスを支える不可欠な要素です。

ロギングは、システムの動作状況、イベントの送受信履歴、エラー情報などを記録することです。Webhook連携においては、以下の情報をログに含めることが推奨されます。

- 受信したWebhookリクエストのヘッダーとペイロード

- 送信したWebhookリクエストのヘッダーとペイロード(再送を含む)

- 処理の開始と終了時刻

- 処理結果(成功、失敗、エラーコード、エラーメッセージ)

- 再送試行回数とその結果

- 署名検証の結果

- イベントIDやトランザクションIDなどの識別子

ログは構造化された形式(例:JSON)で出力し、集中ロギングシステム(例:Elasticsearch, Splunk, Datadog)に集約することで、検索性や分析性を高めます。ログレベル(DEBUG, INFO, WARN, ERROR, CRITICAL)を適切に使い分け、運用に必要な情報が過不足なく記録されるように設計します。

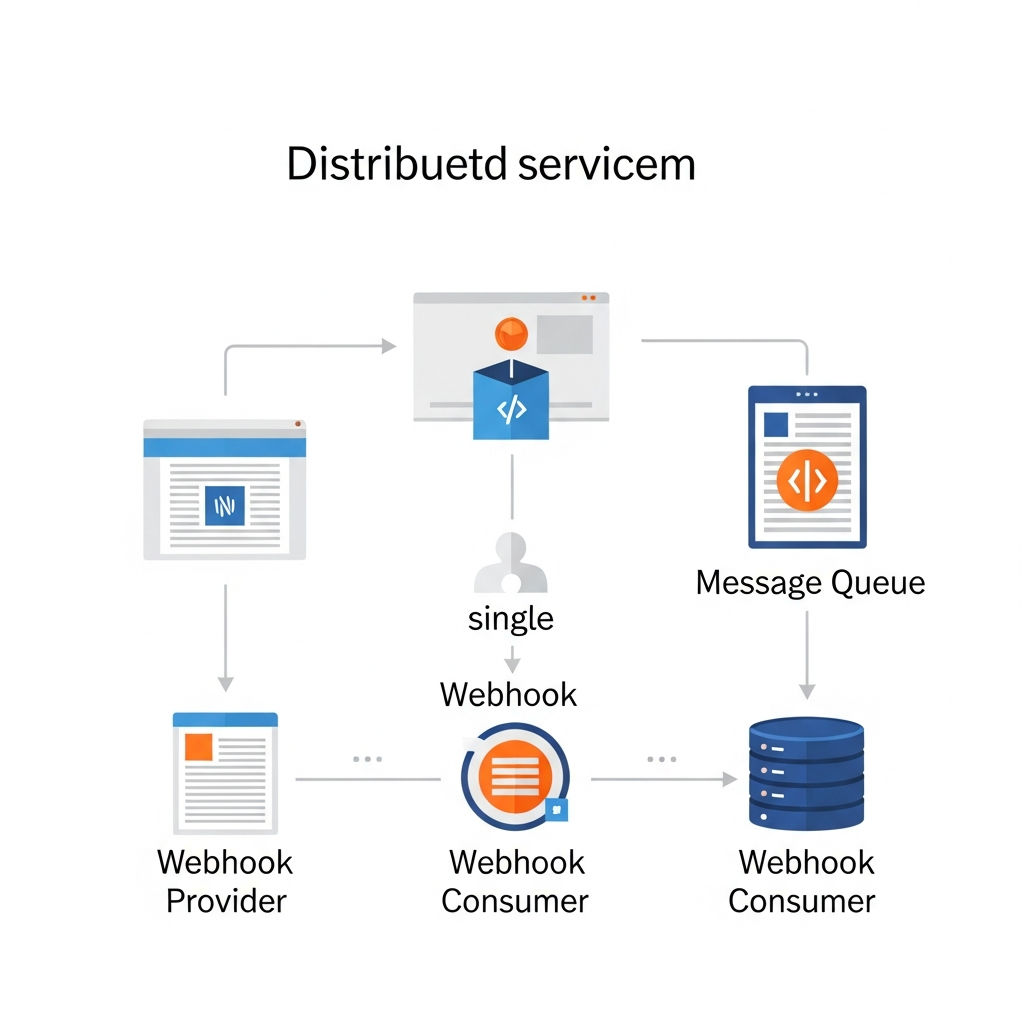

トレーシングは、分散システムにおける単一のリクエストやイベントが、複数のサービスやコンポーネントをどのように横断したかを追跡する仕組みです。Webhook連携では、イベントが生成されてから、Webhookプロバイダー、メッセージキュー、Webhookコンシューマー、そして最終的な業務処理に至るまでの一連の流れを可視化できます。OpenTelemetryのようなオープンソースの標準規格を利用することで、異なるシステム間でのトレーシングを連携させることが可能です。

ロギングとトレーシングを組み合わせることで、「このWebhookイベントはどこで、なぜ失敗したのか?」「どのサービスで処理が遅延しているのか?」といった問いに対し、明確な答えを導き出すことができます。これにより、障害発生時の平均復旧時間(MTTR: Mean Time To Recovery)を大幅に短縮し、システム全体の信頼性を向上させることができます。

| 項目 | ロギング | トレーシング |

|---|---|---|

| 目的 | システムの状態、イベントの発生、エラーなどを記録し、監査、デバッグ、監視に利用する。 | 分散システムにおける単一のリクエストのライフサイクルを追跡し、パフォーマンス問題やエラー発生箇所を特定する。 |

| 記録内容 | タイムスタンプ、ログレベル、メッセージ、イベントID、関連データなど。 | スパン(操作の単位)、トレースID、スパンID、親子関係、サービス名、処理時間など。 |

| 粒度 | 個々のイベントや処理ステップの詳細。 | リクエスト全体の流れと、各サービスでの処理時間。 |

| 活用シーン | エラー発生時の詳細な原因究明、システムの利用状況分析、セキュリティ監査。 | 分散トランザクションの追跡、ボトルネックの特定、サービス間の依存関係分析。 |

| 主要ツール・技術 | Fluentd, Logstash, Splunk, Datadog Logs, AWS CloudWatch Logs, Google Cloud Logging, Elasticsearch | OpenTelemetry, Jaeger, Zipkin, Datadog APM, AWS X-Ray, Google Cloud Trace |

バージョン管理と後方互換性

Webhookの連携先システムは、時間の経過とともに機能が追加・変更されるのが常です。しかし、APIの変更は連携しているシステム全体に影響を及ぼす可能性があります。特にWebhookのような非同期連携では、受信側が古いAPI仕様のまま動作し続けることで、データ形式の不一致やエラーが発生しやすくなります。これを防ぐためには、厳格なバージョン管理と後方互換性の維持が不可欠です。

APIのバージョン管理にはいくつかの戦略があります。最も一般的なのは、URIにバージョンを含める方法(例:/api/v1/events)や、HTTPヘッダーにバージョン情報を含める方法です。これにより、複数のバージョンのAPIを同時に提供し、既存の連携を壊さずに新しい機能を追加できます。

後方互換性(Backward Compatibility)の維持は、バージョンアップにおいて最も重要な原則の一つです。これは、新しいバージョンのAPIが、古いバージョンのクライアント(Webhook受信側)でも問題なく動作することを意味します。具体的には、以下の点に注意します。

- 既存のフィールドを削除しない。

- 既存のフィールドのデータ型を変更しない。

- 必須フィールドを任意フィールドに変更することは可能だが、その逆は避ける。

- 新しいフィールドを追加する場合は、既存のクライアントがそれを無視できるように設計する。

非互換な変更(Breaking Change)を行う場合は、十分な猶予期間を設け、事前に連携先企業に通知し、移行のためのドキュメントとサポートを提供することが不可欠です。古いバージョンのAPIを廃止(Deprecate)するポリシーを明確にし、いつまでに新しいバージョンへの移行が必要かを示します。例えば、「バージョンNは、リリースから12ヶ月後にサポートを終了します」といった具体的なポリシーを設定します。

私たちは、あるSaaS企業が提供するWebhook連携の改善を支援した際、バージョン管理の不備が原因で、顧客企業からの問い合わせが頻発している状況に直面しました。URIベースのバージョン管理と厳格な後方互換性ポリシーを導入し、変更通知プロセスを確立した結果、顧客サポートへの問い合わせが大幅に減少し、開発チームの負担も軽減されました。

| バージョニング方法 | 概要 | メリット | デメリット |

|---|---|---|---|

URIバージョニング/api/v1/resource |

URLパスにバージョン番号を含める。 |

|

|

ヘッダーバージョニングAccept: application/vnd.example.v1+json |

HTTPヘッダー(通常はAcceptヘッダー)にバージョン情報を含める。 |

|

|

クエリパラメータバージョニング/api/resource?version=1 |

クエリパラメータとしてバージョン番号を渡す。 |

|

|

テスト戦略:単体テストから結合テスト、負荷テストまで

Webhook連携の「壊れない」性質を保証するためには、開発ライフサイクルのあらゆる段階で包括的なテストを実施することが不可欠です。単体テストから始まり、結合テスト、システムテスト、そして負荷テストに至るまで、多角的な視点からシステムの堅牢性を検証します。

単体テスト(Unit Test)は、個々の関数やモジュールが期待通りに動作するかを確認します。Webhookペイロードのパース、署名検証ロジック、再送メカニズムの内部処理などが対象となります。これにより、個々のコンポーネントの品質を保証します。

結合テスト(Integration Test)では、複数のコンポーネントやサービスが連携して正しく機能するかを検証します。例えば、Webhookイベントがメッセージキューに格納され、ワーカープロセスがそれを取り出して処理し、最終的にデータベースに反映されるまでの一連の流れが正しく動作するかを確認します。モックサーバーやテスト用のWebhookプロバイダーを使用して、実際の外部システムとの連携をシミュレートすることもあります。

システムテスト(System Test)は、システム全体が要件を満たしているか、エンドツーエンドで動作するかを検証します。実際のWebhookプロバイダーからイベントが送信され、受信側システム全体がそれを処理し、最終的なビジネスプロセスが完了するまでのシナリオをテストします。これには、エラーハンドリングや再送処理、冪等性の検証も含まれます。

負荷テスト(Load Test)とパフォーマンステスト(Performance Test)は、システムが大量のWebhookイベントを処理できるか、またその際の応答時間やリソース消費量が許容範囲内であるかを評価します。これは、スケーラビリティの設計が適切であるかを確認するために非常に重要です。特定の期間に大量のイベントをシミュレートし、システムのボトルネックを特定します。

さらに、カオスエンジニアリングのような手法も有効です。これは、意図的にシステムに障害を注入し、その状況下でシステムがどのように振る舞い、回復するかをテストするものです。例えば、Webhookコンシューマーの一部を停止させたり、ネットワーク遅延を発生させたりすることで、再送メカニズムやエラーハンドリングの回復力を検証できます。

テストは一度行ったら終わりではありません。継続的なインテグレーション(CI)/継続的なデリバリー(CD)パイプラインにテストを組み込み、コード変更のたびに自動的に実行されるようにすることで、品質を維持し、回帰バグの発生を防ぎます。

| テストフェーズ | 目的 | 主な検証内容 | 利用ツール・手法(例) |

|---|---|---|---|

| 単体テスト | 個々のコンポーネントや関数が正しく動作するかを検証。 |

|

JUnit, NUnit, Pytest, Go testing |

| 結合テスト | 複数のコンポーネントやサービス間の連携が正しく行われるかを検証。 |

|

Postman, Cypress, Selenium, Testcontainers |

| システムテスト | システム全体がユーザー要件を満たしているかを検証。 |

|

JMeter, Locust, Playwright, E2Eテストフレームワーク |

| 負荷・パフォーマンステスト | 大量のイベント処理能力とシステムの応答性を評価。 |

|

JMeter, Locust, k6, Gatling |

| カオスエンジニアリング | 意図的な障害注入によるシステムの回復力と耐障害性を検証。 |

|

Chaos Monkey, Gremlin, LitmusChaos |

マーケティング現場でのWebhook活用事例とAurant Technologiesの支援

現代のマーケティングにおいて、顧客体験(CX)の向上と業務効率化は避けて通れないテーマです。特にBtoB企業では、複雑な顧客ジャーニーに対応するため、多岐にわたるシステム間の連携が不可欠となっています。この連携を「壊れない」ものにする上で、Webhookは極めて重要な役割を果たします。ここでは、Webhookがマーケティング現場でどのように活用され、貴社のDX推進に貢献しうるか、具体的な事例を交えてご紹介します。

【事例1】kintoneと外部サービス連携による業務自動化

多くの企業で、顧客管理、営業進捗管理、プロジェクト管理などにkintoneを活用されています。しかし、kintone単体では限界があり、外部のマーケティングオートメーション(MA)ツールやSaaSとの連携が求められます。Webhookを活用することで、kintone内のデータ更新をトリガーとして、外部サービスにリアルタイムで情報を連携し、業務を自動化することが可能です。

例えば、kintoneで顧客情報が更新された際に、その情報をWebhook経由でMAツールに連携し、顧客セグメントを自動変更したり、特定の条件を満たした顧客に対してパーソナライズされたメールキャンペーンを開始したりできます。また、営業担当者がkintoneで商談状況を「受注」に更新した際に、自動的に請求書作成システムに情報が連携され、経理部門への通知が行われるといったフローも構築可能です。

このような連携により、手作業によるデータ入力や転記ミスを削減し、営業・マーケティング部門の生産性を大幅に向上させることができます。特に、データの一貫性を保ちながら、複数システム間のタイムラグを最小限に抑えることは、迅速な顧客対応と機会損失の防止に直結します。

| Webhookによるkintone連携のメリット | 詳細 |

|---|---|

| リアルタイムなデータ同期 | kintoneのデータ更新を即座に外部サービスに反映し、常に最新の情報を共有。 |

| ヒューマンエラーの削減 | 手動でのデータ転記が不要になり、入力ミスや連携漏れのリスクを低減。 |

| 業務プロセスの自動化 | 特定のトリガーに基づいて一連のタスクを自動実行し、従業員の負担を軽減。 |

| 生産性の向上 | 手作業の削減により、営業・マーケティング担当者がより戦略的な業務に集中可能。 |

| データの一貫性確保 | 複数のシステム間で常に整合性の取れたデータを維持し、分析精度を向上。 |

【事例2】BIツールと連携したリアルタイムデータ分析基盤構築

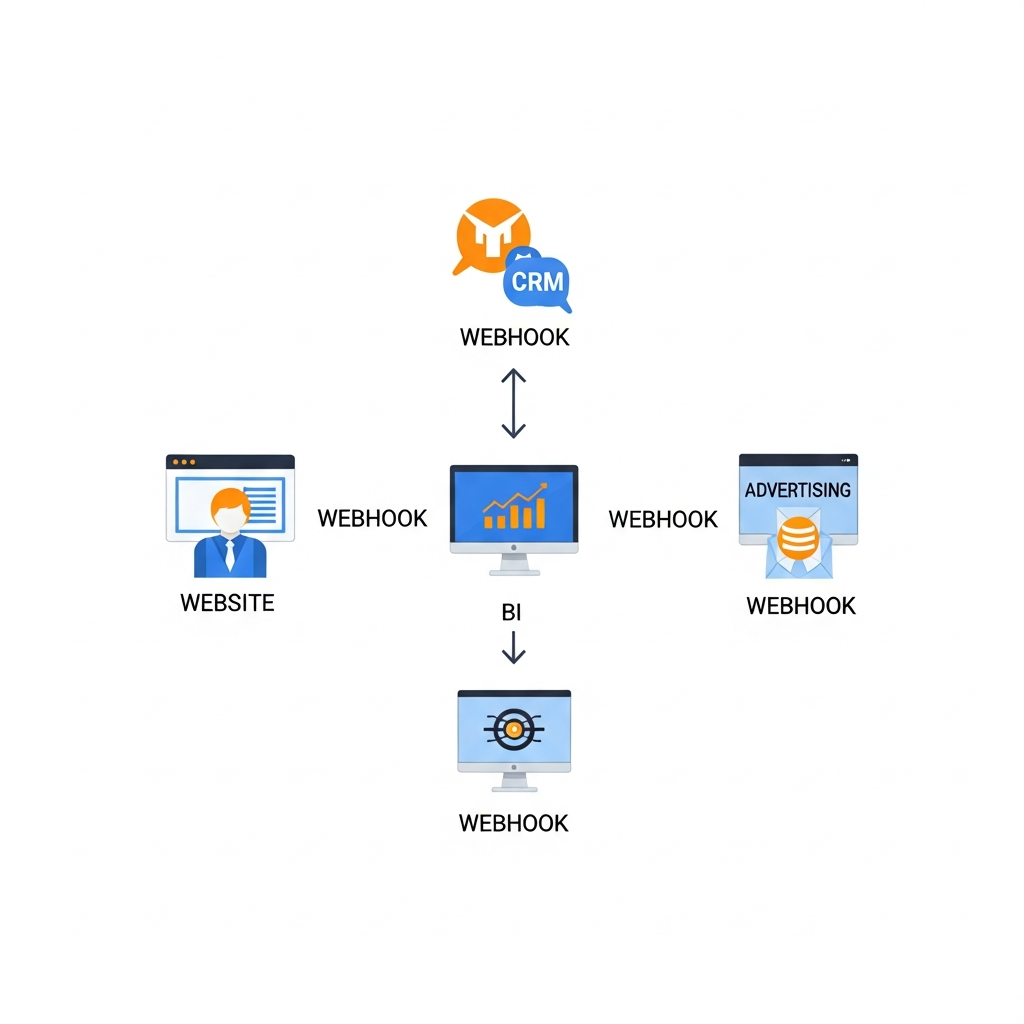

データドリブンマーケティングが不可欠な現代において、リアルタイムでのデータ分析は企業の競争力を左右します。Webサイトのアクセスログ、広告プラットフォームのパフォーマンスデータ、CRMの顧客行動データ、SaaSツールの利用状況など、様々なソースから発生する膨大なデータを一元的に収集し、BIツールで可視化するニーズが高まっています。

Webhookは、これらの多様なデータソースから発生するイベントをトリガーとして、リアルタイムでBIツールやデータウェアハウスにデータをプッシュする強力な手段となります。例えば、ECサイトでのユーザーのカート投入、購入完了、会員登録といったイベント発生時に、Webhookを通じて即座にBIツールにデータが送られ、リアルタイムで売上状況やユーザー行動の変化を把握できるようになります。

これにより、マーケティング担当者はキャンペーンの効果をほぼリアルタイムで測定し、必要に応じて戦略を調整することが可能になります。また、顧客の行動パターンを深く理解することで、パーソナライズされたプロモーションの精度を高め、顧客エンゲージメントの向上に繋げられます。Cookieless時代においては、このようなファーストパーティデータの一元管理とリアルタイム分析が、マーケティング戦略の成否を分ける鍵となります(出典:Google Ads & Commerce Blog)。

【事例3】LINE公式アカウントとCRMの連携でパーソナライズ配信

LINE公式アカウントは、日本国内で高い普及率を誇り、企業と顧客を結ぶ重要なチャネルとなっています。しかし、一斉配信だけでは顧客の心に響きにくく、パーソナライズされたコミュニケーションが求められます。ここでWebhookが活躍します。

貴社のCRMに蓄積された顧客データ(購買履歴、Webサイト閲覧履歴、問い合わせ内容など)を基に、特定の条件を満たした顧客に対してWebhookを通じてLINE公式アカウントから個別メッセージを自動配信する仕組みを構築できます。例えば、特定の商品をカートに入れたまま購入に至っていない顧客に「カゴ落ちリマインド」メッセージを送信したり、誕生日を迎える顧客にクーポンを配信したり、特定カテゴリの商品を閲覧した顧客に類似商品のレコメンドを送信したりすることが可能です。

このようなパーソナライズ配信は、顧客一人ひとりに寄り添った One-to-One マーケティングを実現し、顧客エンゲージメントとコンバージョン率の向上に大きく貢献します。また、Webhookによるリアルタイム連携は、顧客の直近の行動に基づいたタイムリーなコミュニケーションを可能にし、顧客体験を飛躍的に高めます(出典:LINE for Business)。

【Aurant Technologiesの独自見解】DX推進におけるWebhook設計の重要性

上記の事例からもわかるように、Webhookは単なる技術的なデータ連携手段に留まらず、貴社のDX推進戦略の中核を担う重要な要素です。特に、データドリブンマーケティングを成功させるためには、「壊れない配信連携」の実現が不可欠となります。

データ連携が途切れたり、不正確な情報が伝達されたりすれば、マーケティング施策の効果は著しく低下し、顧客体験を損なうことにも繋がります。私たちが提唱する「再送機能」「冪等性」「署名検証」といった堅牢なWebhook設計は、このようなリスクを最小限に抑え、信頼性の高いデータ連携基盤を構築するために不可欠です。

この堅牢なWebhook設計は、以下のような点で貴社のDX推進に貢献します。

- 顧客体験(CX)の向上: リアルタイムかつ正確なデータ連携により、顧客一人ひとりに合わせた最適な情報やサービスをタイムリーに提供できます。

- 業務効率の最大化: 手動でのデータ連携作業を排除し、ヒューマンエラーを削減することで、従業員がより創造的・戦略的な業務に集中できる環境を構築します。

- データドリブンな意思決定の強化: 常に最新かつ正確なデータに基づいた分析が可能となり、迅速かつ的確なビジネス判断を支援します。

- OMO(Online Merges Offline)戦略の実現: オンラインとオフラインの顧客データをシームレスに連携し、一貫性のある顧客体験を提供するための基盤となります。

- Cookieless時代への対応: ファーストパーティデータを堅牢に連携・活用することで、外部Cookieに依存しないマーケティング戦略の構築を支援します。

これらの要素は、貴社が持続的に成長し、競争優位性を確立するために不可欠なものです。Webhookの設計は、一度構築すれば終わりではなく、ビジネスの変化に合わせて柔軟に拡張・改善していく視点が求められます。

Aurant Technologiesが提供するコンサルティング・開発支援

私たちAurant Technologiesは、貴社のマーケティング戦略と業務効率化の双方を深く理解し、その実現を支援する専門家集団です。Webhookを活用したシステム連携は、単に技術的な実装だけでなく、貴社のビジネスプロセス、データガバナンス、セキュリティポリシー全体を考慮した設計が求められます。

私たちは、貴社の具体的な課題や目標をヒアリングし、最適なWebhook連携のアーキテクチャ設計から、堅牢なシステム開発、そして安定的な運用サポートまでを一貫して提供します。特に、「再送機能」「冪等性」「署名検証」といった「壊れない配信連携」の実現に不可欠な要素を網羅した設計思想に基づき、貴社にとって本当に価値のあるソリューションを構築します。

貴社が直面するシステム連携の課題に対し、技術的な知見と豊富な実務経験に基づいた最適なソリューションを提供することで、マーケティングROIの最大化とDX推進を強力にサポートいたします。ぜひ、お気軽にご相談ください。

信頼性の高いWebhook連携が拓く、未来のマーケティングDX

「壊れない配信」がもたらすビジネス成長への貢献

これまでのセクションで、再送、冪等性、署名検証といった技術的な側面からWebhookの信頼性向上策を解説してきました。では、こうした「壊れない配信連携」が、貴社のマーケティングDXとビジネス成長に具体的にどのような貢献をもたらすのでしょうか。単なる技術的要件に留まらず、ビジネスに直結するその価値を深掘りします。

リアルタイム性とパーソナライゼーションの極大化

信頼性の高いWebhook連携は、顧客行動やシステムイベントの発生をほぼリアルタイムで把握することを可能にします。これにより、顧客一人ひとりの状況に合わせた最適なパーソナライズされた体験を、タイムリーに提供できるようになります。

- ECサイトでの事例:顧客がカートに商品を追加したものの購入に至らなかった「カゴ落ち」が発生した際、Webhookがこのイベントを即座に検知し、マーケティングオートメーション(MA)ツールに通知。MAツールは、カゴ落ちした商品や顧客の閲覧履歴に基づいたパーソナライズされたリマインドメールを、数分以内に自動送信します。Epsilonの調査によれば、パーソナライズされたメールは平均で29%のコンバージョン率向上に繋がる可能性があると報告されています(出典:Epsilon)。

- コンテンツマーケティングの事例:特定のホワイトペーパーをダウンロードしたリードに対し、Webhookを通じてCRMシステムにその情報が連携され、営業担当者に通知されると同時に、関連するウェビナーの招待や追加コンテンツの推奨が自動で送られます。これにより、リードの関心度が高いタイミングを逃さず、ナーチャリングプロセスを加速させることができます。

このようなリアルタイムなパーソナライゼーションは、顧客体験(CX)を劇的に向上させ、結果として顧客エンゲージメントの強化、リピート率の向上、そしてLTV(顧客生涯価値)の最大化に直結します。

データドリブンな意思決定の加速とAI活用

現代のマーケティングにおいて、データは羅針盤です。信頼性の高いWebhook連携は、複数のマーケティングツール、業務システム、顧客接点から発生する膨大なデータを、欠損なく、かつリアルタイムで集約・統合する基盤となります。これにより、貴社はより正確で迅速なデータドリブンな意思決定を下すことが可能になります。

- 広告最適化の事例:広告プラットフォーム、Web解析ツール、CRMシステムがWebhookで連携することで、広告キャンペーンのクリック、コンバージョン、顧客属性といったパフォーマンスデータをリアルタイムで一元的に把握できます。これにより、広告予算の配分やクリエイティブの改善、ターゲット設定の調整などを迅速に行い、広告投資の費用対効果(ROI)を最大化できます。AIを活用した広告最適化においても、リアルタイムで高品質なデータフィードはAIの学習精度を飛躍的に向上させます(出典:ITmedia ビジネスオンライン「AIが変えるデータ分析マーケティング」)。

- OMO戦略の推進:オンラインとオフラインの顧客行動データをシームレスに連携させるOMO(Online Merges with Offline)戦略においても、Webhookは不可欠です。店舗での購買履歴や行動データがオンラインの行動データとリアルタイムで紐付けられることで、顧客の全体像を把握し、より一貫性のあるパーソナライズされた体験を提供できます(出典:ITmedia ビジネスオンライン「OMO時代の『最適解』:データ分析から読み解く顧客ニーズ」)。

運用コストの削減と業務効率化

手動でのデータ連携や、エラー発生時の原因究明・復旧作業は、多大な時間と人的リソースを消費します。再送メカニズムや冪等性、署名検証といった信頼性向上策が組み込まれたWebhookは、これらの非効率を解消し、運用コストの大幅な削減と業務の効率化を実現します。

- データ連携の自動化により、従業員はデータ入力や手動同期といった定型業務から解放され、より戦略的で創造的な業務に集中できるようになります。

- エラー発生時の自動再送や冪等性により、データ不整合や重複処理のリスクが軽減され、システム担当者の監視・対応負荷が大幅に減少します。これにより、インシデント対応にかかる時間とコストを抑制できます。

競争優位性の確立と新規事業・サービス開発の柔軟性

「壊れない配信連携」を基盤とする貴社は、市場の変化や顧客ニーズに迅速に対応できる柔軟なビジネス基盤を手に入れます。これにより、競合他社に先駆けて新しいサービスや機能を開発・提供し、持続的な競争優位性を確立することが可能になります。

- APIエコノミーの活用:信頼性の高いWebhookは、外部のSaaSツールやパートナー企業との連携を容易にし、新たな価値創造の機会を拡大します。例えば、新しい決済サービスや配送サービス、顧客サポートツールなどを迅速に自社システムに統合し、顧客に提供できます。

- Cookieless時代への対応:サードパーティCookieの廃止が進む中、ファーストパーティデータの活用が重要性を増しています(出典:ITmedia ビジネスオンライン「“Cookielessの時代”到来 変わるWebマーケティング」)。Webhookは、貴社が保有するファーストパーティデータを様々なシステム間でセキュアかつリアルタイムに連携させるための強力な手段となり、この変化の時代におけるマーケティング戦略の中核を担います。

以下に、信頼性の高いWebhook連携がもたらすビジネスメリットをまとめます。

| メリット | 具体的な効果 | 関連するビジネス指標 |

|---|---|---|

| 顧客体験(CX)の向上 | リアルタイムなパーソナライズ、一貫した顧客ジャーニー | 顧客満足度、リピート率、LTV、NPS |

| データドリブン意思決定の加速 | 高精度なデータ分析、迅速な施策改善、AI活用促進 | 広告ROI、コンバージョン率、マーケティング費用対効果 |

| 運用コストの削減 | 手動業務の自動化、エラー対応工数の削減 | 人件費、運用費、システム開発・保守コスト |

| 業務効率の向上 | 従業員の生産性向上、創造的業務への集中 | 業務処理時間、従業員満足度 |

| 競争優位性の確立 | 市場変化への迅速な対応、新規サービス開発の柔軟性 | 市場シェア、新サービスリリース数、競合優位性スコア |

| セキュリティと信頼性の強化 | データ漏洩リスクの低減、システム障害の抑制 | 情報セキュリティインシデント数、システム稼働率 |

Aurant Technologiesが伴走するDX推進の未来

貴社が「壊れない配信連携」を基盤としたマーケティングDXを実現するためには、技術的な専門知識と、貴社のビジネス特性を深く理解した上でのプロジェクト推進の知見が不可欠です。

私たちAurant Technologiesは、長年にわたりBtoB企業のDX・業務効率化・マーケティング施策を支援してきた経験と専門知識を活かし、貴社のビジネス成長を加速させる「壊れない配信連携」の実現を強力にサポートします。

- 戦略的コンサルティング:貴社のビジネス課題と目標を深く理解し、最適なWebhook設計と実装戦略を立案します。単なる技術導入に留まらず、貴社のマーケティング戦略全体を見据えたロードマップを策定します。

- 技術的実装支援:再送メカニズム、冪等性確保、署名検証といった技術的要素を、貴社の既存システムや利用ツール(CRM、MA、SFA、広告プラットフォームなど)に合わせて具体化し、設計から開発、テスト、本番環境への導入まで一貫して伴走します。

- 継続的な運用・改善:導入後の監視体制構築、パフォーマンス最適化、セキュリティ強化のための継続的なサポートを提供します。貴社のビジネス成長に合わせて、Webhook連携も進化し続けるよう支援します。

私たちとの協業を通じて、貴社は以下のような未来を築くことができます。

- 顧客一人ひとりに最適化されたパーソナライズされたマーケティング施策を、リアルタイムで展開し、顧客エンゲージメントを最大化する。

- 複雑なデータ連携の課題に悩むことなく、データドリブンな意思決定を加速させ、市場の変化に迅速に対応できる。

- 運用コストを最適化し、従業員がより創造的な業務に集中できる環境を構築することで、企業全体の生産性と競争力を高める。

- 変化の速いデジタルマーケティングの世界において、常に一歩先を行く柔軟かつ強固なビジネス基盤を確立する。

「壊れない配信連携」は、貴社のマーケティングDXを次のステージへと引き上げるための、強力な推進力となるでしょう。貴社の具体的な課題や目標について、ぜひ一度私たちにご相談ください。専門家として、貴社のビジネス成長に貢献できる具体的な解決策をご提案いたします。