データパイプライン監視とアラート:遅延・失敗を未然に防ぎ、ビジネスを加速させる運用設計

データパイプラインの遅延や失敗はビジネスに甚大な影響を与えます。本記事では、監視対象から具体的な検知アプローチ、効果的なアラート設計、持続可能な運用設計まで、実務に基づいた実践的なノウハウを解説します。

目次 クリックで開く

データパイプライン監視とアラート:遅延・失敗を未然に防ぎ、ビジネスを加速させる運用設計

データパイプラインの遅延や失敗はビジネスに甚大な影響を与えます。本記事では、監視対象から具体的な検知アプローチ、効果的なアラート設計、持続可能な運用設計まで、実務に基づいた実践的なノウハウを解説します。

データパイプライン監視がビジネスにもたらす価値:なぜ今、不可欠なのか

データパイプラインの遅延や失敗は、ビジネスの意思決定を遅らせ、機会損失や顧客満足度の低下に直結します。本記事では、データパイプラインの安定稼働を保証するために不可欠な「監視とアラート」に焦点を当て、遅延・失敗を確実に検知し、ビジネスインパクトを最小限に抑えるための具体的な運用設計について、実務経験に基づいたノウハウを解説します。データ品質の維持から業務効率化、DX推進まで、貴社のデータ活用を盤石にするための実践的なアプローチをご紹介します。

データパイプライン監視の重要性が高まる背景

近年、あらゆる企業でデータ活用の重要性が叫ばれ、データドリブン経営への移行が加速しています。貴社も例外ではないでしょう。マーケティング施策の効果測定から、製造ラインの最適化、顧客行動分析、さらには新たなサービス開発に至るまで、意思決定の基盤となるデータは日増しにその量と種類を増やしています。

同時に、データソースの多様化も進んでいます。社内の基幹システムだけでなく、SaaSツール、IoTデバイス、外部パートナーからのデータなど、複数のシステムからデータを収集し、加工し、分析基盤へ連携するデータパイプラインは、これまで以上に複雑化しています。この複雑性が増すにつれて、データが途中で遅延したり、破損したり、あるいは完全に失われたりするリスクも高まるのです。

例えば、Eコマース企業であれば、リアルタイムな在庫データや顧客の購買履歴データが欠損すれば、機会損失や顧客体験の悪化に直結します。金融機関であれば、不正検知システムへのデータ連携が遅れれば、重大なセキュリティリスクにつながりかねません。このような状況下で、データパイプラインが安定稼働していることを確認し、問題発生時には迅速に検知・対処できる仕組みは、もはや「あれば便利」ではなく「なくてはならない」ものになっています。

業界の調査によれば、データエンジニアリングの複雑化は、データ関連のトラブル増加の主要因の一つとされています(出典:NewVantage Partners, 2023 Data and AI Leadership Executive Survey)。このような背景から、データパイプライン監視への投資は、貴社のビジネスレジリエンスを高める上で不可欠な要素です。

データ品質の維持とビジネス意思決定への影響

データパイプラインの監視は、単にデータが流れていることを確認するだけではありません。最も重要な役割の一つは、データの「品質」を保証することです。データ品質とは、データの正確性、完全性、適時性、一貫性などを指しますが、これらが損なわれると、ビジネスの意思決定に深刻な影響を及ぼします。

想像してみてください。もしマーケティング部門が参照する顧客データに欠損や重複が多く、最新の情報に更新されていなかったとしたらどうでしょう? ターゲット層を誤って設定したり、パーソナライズされたアプローチができなかったりするだけでなく、誤った分析結果に基づいて多額の広告費を無駄にしてしまう可能性もあります。また、財務部門が参照する売上データが遅延したり、不正確だったりすれば、月次・年次の決算報告に支障をきたし、経営判断を誤るリスクも生じます。

データパイプラインの監視を怠ると、こうしたデータ品質の問題が発見されにくくなり、問題が発覚した時にはすでに手遅れ、という事態にもなりかねません。データ品質の低下は、以下のような形で貴社のビジネスに直接的な損害をもたらします。

- 機会損失: 顧客の行動変化を捉えられず、適切なタイミングでアプローチできない。

- コスト増加: 不正確なデータによる手作業での修正や再処理、無駄なキャンペーン実施。

- 顧客信頼の失墜: 誤った情報提供やサービス提供による顧客満足度の低下。

- 規制違反リスク: データガバナンスやコンプライアンス要件を満たせず、罰則の対象となる。

Gartnerの調査では、データ品質の低さが原因で企業が被る年間コストは、平均で1,500万ドルにも上ると報告されています(出典:Gartner, The Cost of Poor Data Quality)。このことからも、データパイプライン監視によるデータ品質の維持が、貴社のビジネスにとってどれほど重要であるか、ご理解いただけるでしょう。

業務効率化とDX推進におけるデータパイプライン監視の役割

データパイプラインの監視は、貴社の業務効率化とDX推進においても中心的な役割を担います。従来、データに関するトラブルが発生した場合、その原因特定と復旧には多大な時間と労力がかかっていました。システム担当者がログを一つ一つ確認し、各システムの連携状況を手動でチェックするといった作業は、時間もコストもかかる非効率なプロセスです。

しかし、データパイプライン監視システムを導入すれば、異常を自動で検知し、担当者にアラートを送信できます。これにより、問題発生から解決までのリードタイムが大幅に短縮され、手動での監視やトラブルシューティングにかかる人件費を削減できます。結果として、IT部門はより戦略的な業務に集中できるようになります。

また、DX推進の観点からも、安定したデータパイプラインは不可欠です。DXは、デジタル技術を活用してビジネスモデルや業務プロセスを変革することを目指しますが、その基盤となるのは「データ」です。データパイプラインが不安定であれば、AIや機械学習モデルの精度が低下したり、リアルタイム分析の価値が損なわれたりして、DXの取り組み自体が頓挫しかねません。

私たちも、ある製造業のクライアント企業で、生産ラインのIoTデータ収集と分析基盤への連携において、データパイプラインの遅延が頻発していたケースを経験しています。これにより、生産効率のリアルタイムな可視化が妨げられ、不良品発生時の迅速な対応が困難になっていました。データパイプライン監視を導入した結果、遅延やデータ欠損が即座に検知され、原因特定と復旧が迅速化。結果として、生産効率の改善サイクルが加速し、DXの取り組みが大きく前進した事例があります。

データパイプライン監視がもたらす主要な価値は以下の通りです。

| 価値 | 詳細 | ビジネスへの影響 |

|---|---|---|

| リアルタイムな状況把握 | データパイプラインの遅延、停止、エラーを即座に検知し、可視化。 | 問題発生時のダウンタイムを最小化し、ビジネスへの影響を早期に食い止める。 |

| データ品質の保証 | データの正確性、完全性、適時性をチェックし、異常をアラート。 | 誤ったデータに基づく意思決定を防ぎ、ビジネスの信頼性と効率性を高める。 |

| 運用コストの削減 | 手動での監視・トラブルシューティングの負荷を軽減し、自動化を推進。 | IT部門のリソースを戦略的な業務に再配分し、人件費や再処理コストを削減。 |

| DX推進の加速 | 安定したデータ基盤を提供し、AI/ML、リアルタイム分析などのデータ活用を促進。 | 新たなサービス開発や業務改善を後押しし、競争優位性を確立する。 |

| リスク管理とコンプライアンス | データ欠損、不正アクセス、データ漏洩などのリスクを低減。 | データガバナンスを強化し、GDPRなどの規制要件への準拠を支援する。 |

このように、データパイプライン監視は、貴社のデータ活用を成功させ、ビジネスを次のステージへと押し上げるための礎となるのです。

何を監視すべきか?データパイプライン監視の主要な対象と種類

データパイプラインの安定運用は、ビジネスの意思決定を支える上で不可欠です。しかし、「何を」「どのように」監視すべきか、その全貌を把握している企業は意外と少ないのが実情です。データパイプラインの監視は、単にジョブの成功・失敗を確認するだけにとどまりません。私たちは、以下の5つの主要な監視対象に注目し、貴社のデータ活用を盤石なものにするための運用設計を支援しています。

パイプラインの実行ステータス監視(成功・失敗・中断)

最も基本的な監視対象が、パイプラインの実行ステータスです。これは、データ処理の各ステップや全体のジョブが、期待通りに「成功」したのか、何らかの理由で「失敗」したのか、あるいは途中で「中断」したのかを検知することです。

具体的には、

- ジョブがスケジュール通りに開始されたか

- 各タスクが正常に完了したか

- エラーが発生した場合、その種類やメッセージ、発生箇所

- 異常終了時のリトライ状況や再実行の有無

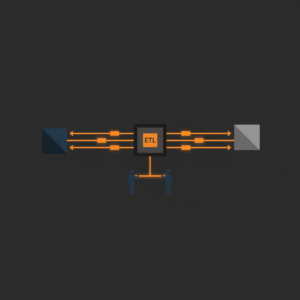

などを確認します。多くのETL/ELTツール(Apache Airflow, Prefect, Dagsterなど)には、これらのステータスを可視化するダッシュボード機能が備わっていますが、重要なのは、異常発生時に「誰に」「どのように」通知するか、そして「次に何をすべきか」を明確にすることです。私たちが支援したケースでは、初期段階でこの監視が不十分だったため、夜間バッチの失敗に翌朝まで気づかず、経営層向けレポート作成が丸一日遅延し、ビジネス機会を逸したことがありました。ログ監視と合わせて、適切なアラート設定が不可欠です。単に失敗を通知するだけでなく、失敗の種類(例:リソース不足、データ形式エラー、外部システム連携エラー)を明確にすることで、初動対応の質が向上します。また、リトライ回数の監視も重要で、頻繁なリトライは潜在的な不安定性を示唆するため、根本原因の調査が必要です。

データ品質監視(異常値、欠損、重複、整合性)

パイプラインが無事完了したとしても、流れるデータの品質が悪ければ、その後の分析や意思決定は誤ったものになります。データ品質監視は、データがビジネス要件や期待される形式を満たしているかをチェックする、非常に重要なプロセスです。

監視すべき主なデータ品質項目は以下の通りです。

- 異常値(Outliers): 統計的に見て極端に外れた値や、ビジネスロジックから逸脱した値(例: 売上が急激にゼロになった、年齢が200歳になっているなど)。

- 欠損値(Missing Values): 必須項目にデータが存在しない場合。特に、分析のキーとなるカラムの欠損は大きな問題につながります。

- 重複(Duplicates): ユニークであるべきデータ(例: 顧客ID、商品コード)が複数存在する場合。

- 整合性(Consistency/Integrity): 参照整合性(例: 注文データに存在しない顧客IDが紐づいている)、データ型の一致(数値カラムに文字列が混入)、フォーマットの統一(日付形式の不揃い)など。

某ECサイトを支援した際、商品マスターの価格データに異常値が混入し、誤った割引が適用される事態が発生しかけました。幸い、導入していたデータ品質監視システムが早期にこれを検知し、数百万の潜在的損失を防ぐことができました。Great Expectationsやdbt testsのようなツールを活用し、自動でデータ品質を検証し、閾値を超えた場合にアラートを発する仕組みを構築することが推奨されます。例えば、顧客IDが必ずユニークであること、売上金額が常に正の値であること、日付カラムが正しいフォーマットであることを自動でチェックするルールを設定します。これにより、データが下流システムに流れる前に問題を検知し、誤った分析や意思決定を防ぎます。

処理パフォーマンス監視(実行時間、遅延、リソース使用率)

データパイプラインの処理パフォーマンスは、ビジネスのスピードや運用コストに直結します。特に、データ量が増加したり、複雑な処理が加わったりすると、パフォーマンス劣化は避けられない課題となります。

ここで監視すべきは、主に以下の点です。

- 実行時間(Execution Time): 各タスクやパイプライン全体の実行時間。過去の平均値と比較し、異常な延長を検知します。

- 遅延(Latency): ソースデータが発生してから、最終的なターゲットシステム(データウェアハウスやBIツールなど)に到達するまでのエンドツーエンドの時間差。リアルタイム性が求められるシステムでは特に重要です。

- リソース使用率(Resource Utilization): パイプラインが使用するCPU、メモリ、ディスクI/O、ネットワーク帯域幅などのリソース。クラウド環境では、これが直接コストに影響するため、効率的なリソース利用が求められます。

ある製造業のお客様では、データウェアハウスへのロード時間が特定の曜日に異常に長くなるという課題がありました。パフォーマンス監視を通じて、その原因が特定のETLジョブ内の非効率なSQLクエリと判明。クエリ最適化により、処理時間を約50%短縮し、限られたバッチ処理ウィンドウ内での完了を可能にしました。AWS CloudWatchやPrometheus/Grafanaのようなツールで、これらのメトリクスを収集・可視化し、閾値に基づくアラートを設定することが効果的です。特にリアルタイム分析や機械学習モデルの再学習に利用されるパイプラインでは、処理遅延が直接的にビジネス機会の損失やモデル精度の低下につながります。継続的なパフォーマンス監視は、将来的なデータ量増加や処理の複雑化に備え、スケーリング計画を立てる上でも不可欠です。

データ鮮度監視(最新性の確認とSLA遵守)

データがどれだけ「新しい」状態であるかは、そのデータのビジネス価値を大きく左右します。特に、リアルタイムに近い意思決定が求められる場面では、データの鮮度監視が不可欠です。

データ鮮度監視では、以下の点をチェックします。

- 最終更新タイムスタンプ: データセットやテーブルの最終更新時刻が、期待される時間枠内にあるか。

- データ生成時刻と現在時刻の差分: ソースデータが生成されてから、ターゲットシステムに反映されるまでの時間差が許容範囲内か。

- SLA(Service Level Agreement)遵守: 「毎日午前9時までに前日データが利用可能であること」といった、ビジネス要件として定められた鮮度に関する合意が守られているか。

マーケティングオートメーションツールとCRMの連携パイプラインを支援した際、リード情報がリアルタイムに近い鮮度で更新される必要がありました。データ鮮度監視を導入し、15分以上の遅延が発生した場合に自動でアラートを出すことで、営業担当者が常に最新のリード情報に基づいて行動できるようになり、営業機会の損失を防ぐことができました。データの鮮度は、そのビジネス価値に直結します。特に、顧客対応、在庫管理、不正検知など、リアルタイム性が求められる領域では、わずかな遅延も許されません。鮮度監視は、SLA(Service Level Agreement)遵守の観点からも重要であり、ビジネス部門との合意形成の基盤となります。

データ量・データ構造の変化監視

データパイプラインは、入力されるデータの量や構造に依存しています。これらの予期せぬ変化は、ダウンストリームのシステムに深刻な影響を及ぼす可能性があります。

- データ量の変化: パイプラインを流れるレコード数、ファイルサイズ、テーブルサイズなどの急激な増減を監視します。例えば、通常100万件のレコードが流れるはずが、突然1万件になったり、逆に1億件になったりした場合、それはソースシステムの問題、データ取り込みの失敗、あるいは予期せぬデータスパイクを示唆している可能性があります。

- データ構造の変化(スキーマドリフト): カラムの追加、削除、データ型の変更、カラム名の変更など、スキーマの変更を検知します。特に外部システムからのデータ連携では、APIの仕様変更などにより、予期せずスキーマが変更されることがあります。これにより、下流のETLジョブがエラーになったり、BIツールでの表示が崩れたりするリスクがあります。

某SaaS企業では、連携する外部サービスのAPI仕様変更により、突然カラムが追加され、BIツールでエラーが発生した経験がありました。スキーマ監視を導入することで、今後同様の変更があった場合に開発チームに自動で通知され、影響範囲を事前に把握し、迅速な対応が可能となりました。スキーマドリフトは、下流のデータ変換処理(ETL/ELT)を失敗させたり、BIツールでのレポート表示を崩壊させたりするだけでなく、機械学習モデルの入力データ形式を破壊し、モデルの再学習や推論に悪影響を及ぼす可能性があります。早期検知は、これらの連鎖的な障害を防ぐ上で極めて重要です。

これらの監視対象を組み合わせることで、貴社のデータパイプラインはより堅牢になり、データ活用の信頼性が格段に向上するでしょう。

| 監視対象 | 主なチェック項目例 | 導入メリット |

|---|---|---|

| 実行ステータス |

|

|

| データ品質 |

|

|

| 処理パフォーマンス |

|

|

| データ鮮度 |

|

|

| データ量・構造変化 |

|

|

遅延・失敗を確実に検知する具体的なアプローチと技術

データパイプラインは、現代のビジネスにおいて意思決定を支える「心臓部」です。この心臓部の健全性を保つためには、データの遅延や処理の失敗を早期に、そして確実に検知する仕組みが不可欠になります。しかし、その実装は一筋縄ではいきません。単にエラーログを監視するだけでは不十分で、パフォーマンス、データ品質、そしてパイプライン全体の依存関係を多角的に捉える必要があります。

ここでは、貴社のデータパイプラインが抱える潜在的な問題を見つけ出し、ビジネスへの影響を最小限に抑えるための具体的かつ実践的なアプローチと技術について解説します。

ログ監視によるエラーパターンの特定と異常検知

データパイプラインの各ステップから出力されるログは、その内部で何が起きているかを示す「声」です。このログを適切に収集・分析することで、処理の失敗や予期せぬ挙動を早期に捉えられます。特に重要なのは、単なるエラーメッセージの有無だけでなく、ログの発生頻度や特定のパターンの変化に注目することです。

- 構造化ログの採用: JSONやCSV形式など、機械的に解析しやすい構造化されたログを出力することで、後の分析が格段に容易になります。これにより、特定のフィールド(例:

errorCode,processingTime)を抽出し、フィルタリングや集計が可能になります。 - ログ集約ツールの導入: 複数のサービスやサーバーに分散するログを一元的に集約するツール(例: Elastic Stack (ELK)、Splunk、Datadog Logs)は必須です。これにより、膨大なログデータの中から必要な情報を効率的に検索し、分析できます。例えば、特定のユーザーからのリクエストに関連するログだけを抽出したり、特定の時間帯に発生したエラーの傾向を分析したりすることが容易になります。

- キーワード・パターンマッチング: 「ERROR」「FAILED」「TIMEOUT」といった具体的なキーワードや、正規表現を用いたパターンマッチングで既知のエラーを検知します。例えば、あるデータソースからのAPI呼び出し失敗を示す特定のHTTPステータスコード(例:

HTTP 429 Too Many Requests)を検知し、アラートを発報するといった運用が考えられます。 - 異常検知アルゴリズムの適用: ログの発生頻度、特定のメッセージの種類、あるいは処理時間の分布など、ログデータが持つ時系列的な特徴に異常検知アルゴリズム(例: 統計的手法、機械学習ベースのアノマリー検知)を適用することで、予期せぬ異常パターンを自動的に検出できます。これは、VC++のメインループでのイベント監視のように、リアルタイムに近い形でシステムイベントの異常を捉える考え方と同様です。

例えば、某SaaS企業では、ログ監視により特定のデータソースからのデータ取り込み失敗が週に数回発生していることを特定しました。詳細なログ分析の結果、エラーログのパターンから、APIリミット超過が原因であることを突き止め、リトライ戦略の改善で解消しました。ログ監視は、単なるエラーの通知だけでなく、問題の根本原因を特定するための重要な手がかりとなるのです。

| ツール名 | 主要機能 | 特徴 | 導入・運用難易度 |

|---|---|---|---|

| Elastic Stack (ELK) | ログ収集 (Logstash/Filebeat)、検索・分析 (Elasticsearch)、可視化 (Kibana) | オープンソース、高い柔軟性と拡張性、活発なコミュニティ | 中〜高(自社での構築・運用スキルが必要) |

| Splunk | ログ・イベントデータの収集、検索、分析、可視化、セキュリティ監視 | エンタープライズ向け、強力な検索言語 (SPL)、豊富な機能、高い信頼性 | 中(管理は比較的容易だが、高度な設定は専門知識が必要) |

| Datadog Logs | ログ収集・集約、リアルタイム検索、パターン分析、メトリクス・トレースとの統合 | SaaS型、監視プラットフォームとのシームレスな統合、使いやすいUI | 低〜中(導入は容易だが、高度な設定やコスト管理は考慮が必要) |

メトリクス監視と閾値設定によるパフォーマンス異常の検出

メトリクスはデータパイプラインの「心拍数」であり、処理のパフォーマンスやリソースの使用状況を数値で示します。これらのメトリクスを継続的に監視し、適切な閾値を設定することで、遅延やボトルネックの兆候を早期に捉えることができます。

- 主要な監視メトリクス:

- 処理遅延(Latency): 各タスクやパイプライン全体での処理時間。平均値、中央値、95パーセンタイル値などを監視し、異常なスパイクを検知します。

- スループット(Throughput): 単位時間あたりに処理されるデータ量やレコード数。これが急減したり、増加しすぎたりする場合も異常の兆候です。

- エラーレート(Error Rate): 処理失敗件数の割合。わずかな増加でも、潜在的な問題を示唆する場合があります。

- リソース使用率: CPU、メモリ、ディスクI/O、ネットワーク帯域の使用状況。これらのリソースが限界に達している場合、処理遅延や失敗に直結します。

- データ鮮度(Data Freshness): 最新データがパイプラインに取り込まれてから、最終的な利用可能状態になるまでの時間。ビジネス要件(SLA)を満たしているかを監視します。

- 閾値設定とアラート: これらのメトリクスに対して、固定閾値(例: 処理時間が5分を超えたらアラート)や、過去のデータに基づいた動的閾値(例: 過去7日間の平均値から2標準偏差以上乖離したらアラート)を設定します。エクセルの折れ線グラフで時系列データを分析するのと同様に、メトリクスを可視化し、トレンドや異常な変動を視覚的に捉えることが効果的です。固定閾値は設定が容易ですが、システムの挙動が変動しやすい場合には誤検知が多くなりがちです。そのため、過去のデータに基づいた動的閾値(例: 過去7日間の平均値から2標準偏差以上乖離したらアラート)や、機械学習を用いた異常検知アルゴリズムを導入することで、より精度の高いアラートを実現できます。

あるEコマース企業では、データウェアハウスへのデータロード時間が特定の時間帯に急増する傾向がありました。メトリクス監視でロード時間の99パーセンタイル値が30分を超えた場合にアラートを出すように設定したところ、特定のバッチ処理の競合が原因であることを突き止めました。スケジューリングを最適化することで、平均ロード時間を20%短縮し、データ鮮度を向上させることができました。

データプロファイリングと統計分析による品質異常検知

パイプラインの遅延や失敗は、システム的な問題だけでなく、入力データ自体の品質異常に起因することも少なくありません。データプロファイリングと統計分析は、データの整合性、完全性、妥当性、一貫性を継続的にチェックし、品質異常を早期に検知するための強力なアプローチです。

- スキーマの逸脱検知: 予期しないデータ型(例: 数値型であるべきカラムがテキスト型になっている)、列の欠落、または新規列の追加などを検知します。これはACCESSのデータ型変更の問題のように、データ構造の変化が下流システムに影響を与えるリスクを軽減します。

- 値の範囲外れ・欠損値の増加: 年齢が負の値、売上が異常に高い/低い、あるいは必須項目でNULL値が急増しているといった異常を検出します。

- 重複の発生・ユニーク制約違反: 本来ユニークであるべきキー(例: 顧客ID)に重複が発生していないかを監視します。

- 分布の変化: 数値データの平均、中央値、標準偏差、ヒストグラムの形状が大きく変動していないか、カテゴリデータの比率が過去の傾向から逸脱していないかを統計的に分析します。これは大学数学の確率論でデータを分析するのと同様に、データの統計的特性の変化を捉えることで異常を検知する手法です。例えば、数値データの平均、中央値、標準偏差、ヒストグラムの形状が大きく変動していないか、カテゴリデータの比率が過去の傾向から逸脱していないかを統計的に分析します。これにより、データソース側のシステム変更や、データ生成プロセスのバグなど、目に見えないデータ品質の劣化を早期に発見できます。

アプローチとしては、データソースから取り込まれた直後、および主要な変換ステップの後に、定期的にデータプロファイリングを実行することが効果的です。過去の統計データと比較し、統計的に有意な変化があった場合にアラートを発報します。例えば、PHPでMySQL内のデータの合計値を算出する際に、ある期間の合計値が過去の傾向から大きく乖離している場合にアラートを出す、といった応用も考えられます。

某金融機関では、顧客データパイプラインにおいて、特定のカラムのNULL値比率が過去の平均値から2標準偏差以上乖離した場合にアラートを発する仕組みを導入しました。これにより、上流システムからのデータ連携ミスを早期に発見し、顧客への影響を未然に防ぐことができました。参考として、データ品質の低下はビジネス上の意思決定に重大な影響を及ぼすことが指摘されています。ガートナーの調査によれば、データ品質の低さが原因で企業は年間平均1,500万ドルを失っていると報告されています(出典:Gartner, “The Cost of Poor Data Quality”, 2018)。

依存関係を考慮したエンドツーエンドのパイプライン監視

個々のコンポーネントやデータ品質の監視だけでは不十分です。データパイプラインは複数のステップやシステムが連携して動作するため、その全体像と依存関係を俯瞰的に監視することが不可欠です。これにより、ある部分の遅延や失敗が下流にどのような影響を与えるかを正確に把握し、ビジネスインパクトを評価できます。

- データリネージ(Data Lineage): データがどこから来て、どのような変換を経て、どこで利用されているかを可視化します。これにより、問題発生時の影響範囲特定や根本原因分析を容易にします。例えば、あるBIレポートの数値が誤っている場合、データリネージを辿ることで、どのデータソースの、どの変換ステップで問題が発生したのかを迅速に特定できます。

- ワークフローオーケストレーションツール: Apache Airflow、Prefect、Dagsterなどのツールは、各タスクの実行状況、依存関係、実行ログを一元的に管理・監視します。これにより、パイプライン全体の進捗状況をリアルタイムで把握し、特定のタスクの遅延や失敗を即座に検知できます。

- SLA(Service Level Agreement)監視: ビジネス要件に基づくSLA(例: 「毎日午前9時までに最新の売上データがダッシュボードに反映されること」)を設定し、その達成状況を監視します。SLA違反の可能性を早期に通知することで、ビジネスへの影響を最小限に抑える行動を促します。

- ビジネスインパクト監視: データパイプラインの異常が、最終的なレポート、ダッシュボード、あるいは顧客向けアプリケーションにどのような影響を与えるかを可視化します。例えば、特定のデータソースの遅延が、重要な経営指標の更新を停止させる可能性があることを示すなど、技術的な問題とビジネス上の影響を紐付けて理解することで、優先順位付けと迅速な対応が可能になります。

あるメディア企業では、コンテンツ配信システムに利用するデータパイプラインが複雑化し、障害発生時に原因特定に時間がかかっていました。そこで、Airflowとデータリネージツールを導入し、各タスクの依存関係と実行状況をダッシュボードで一元管理しました。これにより、特定のデータソースの遅延が下流のレポート生成に影響を与えることをリアルタイムで検知し、MTTR(平均復旧時間)を30%短縮できました。エンドツーエンドの監視は、複雑なデータ環境における安定運用に不可欠な要素です。

これらのアプローチを組み合わせることで、データパイプラインの遅延や失敗を多角的に検知し、ビジネスへの影響を最小限に抑えることが可能になります。

| アプローチ | 概要 | 主なメリット |

|---|---|---|

| ログ監視 | パイプラインの各ステップから出力されるログを収集・分析し、エラーメッセージや異常パターンを検知。 |

|

| メトリクス監視 | 処理時間、スループット、リソース使用率などの数値データを継続的に収集し、閾値に基づく異常を検知。 |

|

| データ品質監視 | データの異常値、欠損、重複、整合性などを統計的に分析し、品質劣化を検知。 |

|

| エンドツーエンド監視 | データリネージやワークフローオーケストレーションツールを活用し、パイプライン全体の依存関係と進捗を監視。 |

|

効果的なアラート設計と通知チャネルの選び方:無駄なく、迅速に

データパイプラインの監視は導入したものの、「アラートが多すぎて本当に重要なものを見逃してしまう」「夜中に鳴ったアラートが誤検知で、結局何も対応しなかった」といった経験はありませんか? 無駄なアラートは「アラート疲れ」を引き起こし、システムの健全性を見極める目を曇らせてしまいます。ここでは、貴社のチームが本当に必要な情報に迅速にアクセスし、的確な行動を取れるようにするための、効果的なアラート設計と通知チャネルの選び方について解説します。

アラートの優先順位付けと深刻度レベルの設定

アラートが大量に発生すると、どれから対応すべきか判断に迷い、結果として重要な問題への対応が遅れることがあります。これを避けるためには、アラートに優先順位と深刻度レベルを設定することが不可欠です。私たちは、アラートを単一の障害として捉えるのではなく、それがビジネスに与える影響度を基準に評価することを推奨しています。

例えば、以下のような深刻度レベルを設定し、それぞれのレベルで対応すべき範囲や期限を明確にします。

- Critical(緊急): サービス停止、データ損失、売上直結の機能停止など、ビジネスに壊滅的な影響を与える事象。即時対応が必須。

- Major(重要): サービスの一部機能停止、データ品質の著しい劣化、パフォーマンスの大幅な低下など、ビジネスに大きな影響を与える事象。営業時間内での迅速な対応が必要です。

- Minor(軽度): 軽微なデータ遅延、一部の補助機能の不具合、リソース使用量の軽度な増加など。ビジネスへの影響は限定的ですが、将来的な問題につながる可能性。定期的な確認と対応が必要です。

- Warning(注意): 閾値に近づいているがまだ問題ではない状態、予兆検知。予防的な措置や情報収集に活用します。

このような分類により、担当者はアラートを受け取った際に、その深刻度から対応の緊急性を即座に判断できるようになります。重要なのは、これらの基準をチーム全体で共有し、統一された認識を持つことです。これにより、無駄な混乱を避け、効率的な問題解決へと繋がります。

| 深刻度レベル | ビジネスへの影響 | 対応の緊急度と例 | 推奨される通知チャネル |

|---|---|---|---|

| Critical(緊急) | サービス停止、データ損失、売上直結の機能停止 | 即時対応(24時間365日)、オンコール担当者による電話/SMS通知、即座の調査・復旧 | PagerDuty, Opsgenie (電話, SMS) |

| Major(重要) | サービスの一部機能停止、データ品質の著しい劣化、パフォーマンスの大幅な低下 | 営業時間内での迅速な対応、担当チームへのSlack/Teams通知、原因特定と暫定対応 | Slack, Microsoft Teams, メール |

| Minor(軽度) | 軽微なデータ遅延、一部の補助機能の不具合、リソース使用量の軽度な増加 | 定期的な確認と対応、週次/日次レポートでの報告、将来的な改善計画に組み込み | Slack (情報チャネル), メール (週次レポート) |

| Warning(注意) | 閾値に近づいているがまだ問題ではない状態、予兆検知 | 予防的な措置、情報収集、監視ダッシュボードでの可視化、必要に応じた調査 | 監視ダッシュボード, Slack (情報チャネル) |

誤検知(False Positive)を減らすためのアラートチューニング

「狼少年」のように、誤検知が多いアラートはチームの信頼を失い、最終的には無視されるようになります。誤検知を減らすためには、アラートの閾値設定や条件を慎重にチューニングする必要があります。

- 動的な閾値設定: 固定の閾値だけでなく、過去のデータに基づいた動的な閾値設定を検討しましょう。例えば、曜日や時間帯によるデータ量の変動を考慮し、標準偏差や移動平均を用いた異常検知手法を取り入れることで、より実態に即したアラートが可能です。

- 複数条件の組み合わせ: 単一のメトリクスが閾値を超えただけでアラートを上げるのではなく、「Aのメトリクスが閾値を超え、かつBのメトリクスも異常値を示している場合」のように、複数の条件が同時に満たされた場合にのみアラートを発生させることが有効です。これにより、単発的なノイズによる誤検知を大幅に削減できます。

- メンテナンス期間中の抑制: 計画的なメンテナンスやデータ更新作業中は、一時的にアラートを抑制する仕組みを導入します。これにより、予期された挙動に対する不要なアラートを防ぎ、運用担当者の負担を軽減できます。

- Snooze機能の活用: 頻繁に発生する既知の問題や、対応に時間を要するが緊急性の低い問題に対しては、アラートを一時的に「スヌーズ」する機能も役立ちます。ただし、スヌoze期間や解除条件は明確に定め、問題が長期化しないよう注意が必要です。

これらのチューニングは一度行えば終わりではなく、システムの変更やデータ特性の変化に合わせて定期的に見直し、改善していくことが重要です。

通知チャネルの選定と活用(メール、Slack、LINE、PagerDutyなど)

アラートの通知チャネルは、その深刻度や緊急性に応じて適切に選択することが重要です。適切なチャネルを選ぶことで、情報伝達の速度と確実性を高められます。

| 通知チャネル | 主な用途 | メリット | デメリット |

|---|---|---|---|

| メール | 情報共有、記録、非緊急アラート | 詳細な情報伝達が可能、履歴が残りやすい | リアルタイム性に欠ける、見落としやすい |

| Slack / Microsoft Teams | チーム内情報共有、中〜高緊急度アラート、連携ツール | リアルタイム性、チーム内での議論・連携が容易 | 情報が流れると見落としやすい、通知過多になりがち |

| LINE / SMS | 個人への緊急通知、高緊急度アラート | 高い到達率、緊急性が伝わりやすい | 情報量が限られる、個人のプライベートとの境界 |

| PagerDuty / Opsgenie | オンコール管理、エスカレーション自動化、最重要アラート | 電話・SMSなど複数の手段で確実な通知、エスカレーション自動化、オンコール管理 | 導入・運用コスト、設定が複雑になりがち |

例えば、軽度なWarningレベルのアラートはSlackチャネルでチームに共有し、Criticalレベルの緊急アラートはPagerDutyを通じてオンコール担当者に電話通知するといった使い分けが効果的です。通知内容も、「何が、いつ、どこで発生し、影響範囲はどの程度か、そして考えられる原因や初動対応のヒント」まで含めることで、受け取った側が迅速に状況を把握し、対応を開始できるように工夫しましょう。

エスカレーションポリシーの策定とオンコール体制の構築

アラートが発生した際に「誰が、いつ、どのように対応するのか」を明確にするエスカレーションポリシーと、それを支えるオンコール体制は、問題解決の迅速性と確実性を高める上で極めて重要です。

- 一次対応者の明確化: まず、アラートの種類ごとに一次対応者を明確に定めます。これは、特定のチームや個人、あるいは自動化されたシステムである場合があります。

- エスカレーションパスの定義: 一次対応者が一定時間内に問題に対応できない場合、または問題が解決しない場合に、誰に、どのようなチャネルで、どのくらいの時間間隔でエスカレーションするかを具体的に定義します。例えば、「一次担当者が15分以内に確認しない場合、二次担当者にSMS通知、30分以内に対応がない場合はチームリーダーに電話通知」といった具合です。

- オンコールローテーション: 24時間365日の監視が必要な場合、担当者の負担を軽減し、常に誰かが対応できる状態を維持するために、オンコールローテーションを組みます。PagerDutyやOpsgenieといったオンコール管理ツールは、このローテーション管理、エスカレーションの自動化、通知の統合に非常に有効です。

- 連絡先リストの整備と最新化: エスカレーションに関わる全ての担当者の連絡先(電話番号、メールアドレス、Slack IDなど)を常に最新の状態に保ち、緊急時にすぐにアクセスできるようにしておきましょう。

- 定期的な訓練とレビュー: エスカレーションポリシーとオンコール体制は、一度構築したら終わりではありません。定期的にシミュレーション訓練を実施し、ポリシーが適切に機能しているか、改善点はないかを確認し、必要に応じて見直すことが肝要です。

これらの要素を組み合わせることで、貴社のデータパイプライン監視は、単なる「異常検知」から「迅速な問題解決」へと進化し、ビジネスの安定稼働に大きく貢献するでしょう。

持続可能な監視体制を構築する運用設計のベストプラクティス

データパイプラインの監視は、一度構築したら終わりではありません。ビジネスの変化やシステムの進化に合わせて、その監視体制も継続的に見直し、改善していく必要があります。持続可能な監視体制を築くためには、単にツールを導入するだけでなく、人・プロセス・技術が一体となった運用設計が不可欠です。

監視体制の構築と担当者の役割分担(SRE/データエンジニア/業務担当)

データパイプラインの監視は、様々な専門性を持つチーム間の連携が成功の鍵を握ります。複雑なシステムを効率的に監視し、インシデント発生時に迅速に対応するためには、各担当者の役割と責任を明確に定義することが重要です。

- SRE(Site Reliability Engineering)/運用エンジニア: システム全体の可用性、パフォーマンス、信頼性の維持に責任を持ちます。監視基盤の設計・構築・運用、アラートシステムの最適化、インシデント発生時の初動対応とエスカレーションフローの管理などが主な役割です。彼らは技術的な視点から「システムが正常に動作しているか」を監視します。

- データエンジニア: データパイプラインそのものの設計、実装、運用、そしてデータ品質の維持に責任を持ちます。データの取り込み、変換、ロード(ETL/ELT)プロセスの監視、データ品質の異常検知、データ鮮度の監視などが主な役割です。彼らは「データが正しく、タイムリーに流れているか」を監視します。

- 業務担当者/データアナリスト: データがビジネスに与える影響を最もよく理解しています。データの異常がビジネスKPIにどう影響するかを判断し、データ品質の要件を定義します。また、データ異常が検知された際に、それがビジネスにとって許容範囲内か、あるいは緊急対応が必要かを判断する役割も担います。彼らは「データがビジネス価値を生み出しているか」を監視します。

これらの役割が明確になり、互いに連携することで、技術的側面とビジネス的側面の両方からデータパイプラインを包括的に監視できるようになります。例えば、データエンジニアがデータ品質の異常を検知し、それがビジネスインパクトが大きいと判断された場合、SREチームと連携してシステムレベルでの原因究明と復旧に当たるといった具合です。また、業務担当者からの「このデータがいつも遅い」といったフィードバックは、データエンジニアやSREチームが監視項目を見直す重要なきっかけとなります。

以下に、各担当者の主な役割と責任の例を示します。

| 担当者 | 主な役割 | 責任範囲 |

|---|---|---|

| SRE/運用エンジニア | 監視基盤の設計・構築・運用、アラートシステムの管理、インシデント初動対応、システムレベルのパフォーマンス監視 | システム全体の可用性、信頼性、パフォーマンスの維持 |

| データエンジニア | データパイプラインの設計・実装・運用、データ品質監視、データ鮮度監視、データ処理エラーの検知と修正 | データパイプラインの健全性、データ品質、データフローの安定性 |

| 業務担当者/データアナリスト | データ要件の定義、データ異常のビジネスインパクト評価、データ品質基準のフィードバック、ビジネスKPIへの影響分析 | データのビジネス価値、データを利用した意思決定の正確性 |

インシデント対応フローの確立と改善サイクル

どんなに堅牢な監視体制を築いても、インシデントは発生し得ます。重要なのは、インシデント発生時にいかに迅速かつ効果的に対応し、その経験を次へと活かすかです。このためには、明確なインシデント対応フローと、継続的な改善サイクルを確立することが不可欠です。

- 検知(Detection): 監視システムが異常を検知し、アラートを発報。

- 評価・トリアージ(Assessment & Triage): アラートの重要度、影響範囲、緊急度を評価し、対応優先順位を決定。担当者へのエスカレーション。

- 調査・診断(Investigation & Diagnosis): 根本原因の特定に向けた調査。ログ分析、メトリクス確認、システム状態の確認など。

- 対応・復旧(Response & Recovery): 暫定的な対処(ロールバック、リソース増強など)や恒久的な修正を行い、サービスを復旧。

- 事後分析(Post-mortem/Root Cause Analysis): インシデント発生の経緯、対応プロセス、根本原因、再発防止策を詳細に分析。この段階では「誰を責めるか」ではなく、「何が起こったか、どうすれば防げたか」に焦点を当てます。特に、事後分析(ポストモーテム)は、失敗から学び、再発防止策を講じる上で極めて重要です。このプロセスでは、感情的な非難を避け、客観的な事実に基づき、システムやプロセスの改善点に焦点を当てます。透明性のあるポストモーテム文化を醸成することで、チーム全体の学習と成長を促します。

- 改善(Improvement): 事後分析で得られた知見に基づき、監視設定の調整、パイプラインの修正、運用プロセスの改善などを行います。

このサイクルを回すことで、組織はインシデント対応能力を高め、システムの信頼性を継続的に向上させることができます。業界では、インシデント対応の迅速性がビジネスの継続性に直結すると認識されており、平均復旧時間(MTTR: Mean Time To Recovery)の短縮が主要な運用指標の一つとされています(出典:DevOps Research and Assessment (DORA) “State of DevOps Report”)。

監視対象の定義とドキュメント化

「何を監視すべきか」を明確に定義し、それをドキュメント化することは、監視体制の持続性を高める上で非常に重要です。漠然とした監視では、本当に重要な問題を見落としたり、無駄なアラートに悩まされたりすることになります。

監視対象を定義する際は、以下の観点を考慮すると良いでしょう。

- データソースの健全性: データが正しく生成・連携されているか(例:API応答時間、ファイル到着状況)。

- パイプラインの処理状況: 各ステージでの処理時間、成功/失敗率、データ件数、リソース使用率(CPU, メモリ, ディスクI/O)。

- データ品質: データの欠損率、重複、異常値、フォーマットエラー、スキーマ逸脱など。ビジネス要件に合致しているか。

- 出力データの鮮度と正確性: 最終的なデータが期待通りに更新されているか、レポートやダッシュボードに反映されているか。

- 依存関係: 外部システムや他パイプラインとの依存関係を考慮し、それらの健全性も監視対象に含める。

これらの監視項目、その閾値、そしてアラート発生時の対応手順を明確にドキュメント化することで、属人化を防ぎ、新しい担当者でもスムーズに運用を引き継ぐことが可能になります。ドキュメントには、監視項目、その閾値、アラート発生時の対応手順、エスカレーションパス、そして各監視項目がビジネスに与える影響度などを明確に記述します。これにより、属人化を防ぎ、新しい担当者でもスムーズに運用を引き継ぐことが可能になります。ドキュメントは単なる記録ではなく、チームの共通認識を形成し、効果的な運用を支える重要な資産となります。私たちが支援したある製造業のケースでは、データパイプラインのドキュメント化が不十分で、担当者異動のたびにデータ品質の問題が再発していました。そこで、監視対象の定義とドキュメント化を徹底した結果、インシデント発生時の初動対応時間が平均で30%短縮され、データ品質に関する問い合わせも年間で20%減少しました。

コストと効果のバランスを考慮した監視システム設計

監視システムを設計する際には、その導入・運用にかかるコストと、それによって得られる効果のバランスを常に考慮する必要があります。全てを完璧に監視しようとすれば、莫大なコストがかかり、かえって運用を圧迫してしまいます。

考慮すべきコスト要素:

- ツールライセンス費用: 有償の監視ツールやプラットフォームの利用料。

- インフラ費用: 監視データの保存、処理、可視化に必要なクラウドインフラまたはオンプレミスサーバーの費用。

- 人件費: 監視システムの設計、構築、運用、アラート対応、改善にかかるエンジニアや担当者の人件費。

- 学習コスト: 新しいツールの習得や運用プロセスの確立にかかる時間と労力。

期待される効果要素:

- ダウンタイムの削減: 問題の早期発見・早期解決によるビジネスインパクトの軽減。

- データ品質の向上: 異常データの早期検知と修正による信頼性の高いデータ提供。

- 意思決定の質の向上: リアルタイムかつ正確なデータに基づく迅速な意思決定。

- 運用負荷の軽減: 自動化された監視とアラートによる手動チェック工数の削減。

- 顧客満足度の向上: 安定したサービス提供と高品質なデータ利用による信頼獲得。

このバランスを見極めるためには、まず「どのデータがビジネスにとって最も重要か」「どのような問題が最も大きなインパクトを与えるか」を特定し、そこから優先順位をつけて監視対象を絞り込むことが有効です。例えば、売上データに直結するパイプラインは手厚く監視し、影響の小さい補助的なデータは比較的シンプルな監視に留める、といったアプローチです。

また、オープンソースの監視ツール(Prometheus, Grafanaなど)や、クラウドプロバイダーが提供するマネージドサービス(AWS CloudWatch, Google Cloud Monitoring, Azure Monitorなど)を効果的に活用することで、初期投資を抑えつつ、柔軟な監視システムを構築できます。これらのサービスは、必要に応じてスケールアップ・ダウンが可能であり、運用負荷も軽減できるため、コスト効率の良い選択肢となることが多いです。

段階的な導入も有効です。まずは最小限の重要な監視から始め、効果を測定しながら徐々に範囲を広げていくことで、投資対効果を最大化し、持続可能な監視体制へと発展させることができます。例えば、最初は主要なデータパイプラインの実行ステータスとデータ鮮度のみを監視し、安定してきたらデータ品質監視やリソース監視へと範囲を広げる、といったアプローチです。

データパイプライン監視・アラートに役立つ主要ツールと技術スタック

データパイプラインの安定稼働を実現するためには、適切な監視・アラートツールの選定と、それらを組み合わせた技術スタックの設計が不可欠です。市場には多様なツールが存在し、貴社の既存インフラ、予算、必要な監視レベルに応じて最適な選択が変わってきます。ここでは、主要なツールと技術スタックをカテゴリ別に紹介し、それぞれの特徴と活用方法を解説します。

クラウドサービス(AWS Glue, Azure Data Factory, GCP Dataflow, Databricksなど)

近年、多くの企業がデータパイプラインをクラウド上で構築しており、各クラウドプロバイダーが提供するマネージドサービスは、その監視・アラート機能も内包しています。これらのサービスは、インフラの運用負荷を軽減しつつ、データパイプラインの実行状況を可視化し、異常を検知する仕組みを提供します。

- AWS Glue: AWSのサーバレスETLサービスです。Glueジョブの実行状況、成功/失敗、実行時間などをAmazon CloudWatchと連携して監視できます。CloudWatchアラームを設定することで、ジョブの失敗や実行時間の異常延長を検知し、SNS(Simple Notification Service)などを通じて通知が可能です。

- Azure Data Factory (ADF): Azureにおけるデータ統合サービスで、パイプラインのオーケストレーションと実行を担います。ADFの監視ハブでは、パイプラインの実行履歴、アクティビティのステータス、エラー詳細などを一元的に確認できます。Azure Monitorとの連携により、カスタムアラートやログ分析も行えます。

- GCP Dataflow: Google Cloud Platformのマネージドなストリーミング/バッチデータ処理サービスです。Dataflowジョブの実行状況、リソース使用量、エラーログなどはGoogle CloudのMonitoring(旧Stackdriver)で監視できます。ジョブの遅延や失敗を検知するアラートポリシーを設定し、通知チャネルと連携させることが可能です。

- Databricks: データレイクハウスプラットフォームとして、Apache Sparkベースのデータ処理と分析環境を提供します。Databricksジョブの実行状況、ノートブックの実行結果、クラスターの稼働状況などをUIから監視できます。Delta Live Tables (DLT) を利用すれば、データ品質の自動監視とアラートも組み込めます。

これらのクラウドサービスは、それぞれのプラットフォーム内で完結した監視・アラート機能を提供するため、導入が比較的容易で、既存のクラウドインフラとの親和性が高い点がメリットです。一方で、特定のクラウドプロバイダーにロックインされる可能性や、詳細なカスタマイズには限界がある場合もあります。

| サービス名 | 主要機能 | 監視・アラート機能 | 適したユースケース |

|---|---|---|---|

| AWS Glue | サーバレスETL、データカタログ | Amazon CloudWatch連携(ジョブ実行ログ、カスタムメトリクス、アラーム) | AWSエコシステムを利用する企業、サーバレスETL中心のパイプライン |

| Azure Data Factory | データ統合、ETL/ELTパイプラインオーケストレーション | Azure Monitor連携(パイプライン実行監視、アクティビティログ、カスタムアラート) | Azureエコシステムを利用する企業、ハイブリッドデータ統合環境 |

| GCP Dataflow | 大規模ストリーミング/バッチデータ処理 | Google Cloud Monitoring連携(ジョブ進捗、リソース利用、エラーログ、アラートポリシー) | GCPエコシステムを利用する企業、大規模データ処理・分析 |

| Databricks | データレイクハウス、Apache Sparkベース分析 | ジョブ実行監視、ノートブック実行状況、Delta Live Tablesによるデータ品質監視 | Apache Spark活用企業、データレイクハウス構築、MLOps |

オープンソースツール(Apache Airflow, Prometheus, Grafana, ELK Stackなど)

高い柔軟性とコスト効率を求める貴社には、オープンソースツールを組み合わせて監視システムを構築する方法も有効です。これらのツールは、特定の機能に特化しており、組み合わせることで強力な監視ソリューションを実現できますが、構築と運用には一定の専門知識とリソースが必要です。

- Apache Airflow: データパイプラインのワークフローオーケストレーションツールとして広く利用されています。DAG(Directed Acyclic Graph)と呼ばれるワークフロー定義に基づき、タスクの実行状況を詳細に監視できます。Web UIからタスクの成功/失敗、リトライ状況を確認でき、失敗時にはメールやSlackなどへの通知を設定できます。

- Prometheus: 時系列データベースと監視システムを統合したツールです。データパイプラインの各コンポーネント(データベース、メッセージキュー、サーバなど)からメトリクス(CPU使用率、メモリ使用量、ディスクI/O、キューの長さなど)を収集し、リアルタイムに監視します。

- Grafana: Prometheusなどで収集したメトリクスを美しいダッシュボードで可視化するためのツールです。様々なデータソースに対応し、複雑なクエリ結果をグラフや表で表示できます。閾値に基づいたアラート機能も備えており、Prometheusと組み合わせて利用されることが非常に多いです。

- ELK Stack (Elasticsearch, Logstash, Kibana): ログ管理・分析のための強力な組み合わせです。Logstashでデータパイプラインの各処理から出力されるログを収集・加工し、Elasticsearchに蓄積します。Kibanaを使ってログデータを検索・分析し、異常なログパターンやエラー頻度の増加を可視化・検知できます。

これらのオープンソースツールは、貴社の特定の要件に合わせて細かくカスタマイズできる点が最大のメリットです。しかし、導入・運用にはインフラ構築、ソフトウェアのインストール、設定、継続的なメンテナンスといった専門知識が求められます。特に大規模な環境では、運用負荷が高くなる傾向があります。

統合監視プラットフォーム(Datadog, New Relicなど)

クラウドサービスやオープンソースツールに加え、DatadogやNew Relicのような統合監視プラットフォームは、データパイプラインを含むITインフラ全体を包括的に監視するための強力なソリューションを提供します。これらはSaaS型で提供され、複数のクラウド環境やオンプレミス環境にまたがる複雑なシステムの一元的な可視化とアラートを実現します。

- Datadog: インフラ、アプリケーション、ログ、ネットワークなど多岐にわたる監視機能を統合したプラットフォームです。データパイプラインの各コンポーネント(DB、メッセージキュー、ETLエンジン、サーバレス関数など)にエージェントを導入することで、詳細なメトリクスを収集し、パフォーマンスボトルネックやエラーを特定できます。カスタムダッシュボード、高度な異常検知機能、柔軟なアラート設定が強みです。

- New Relic: アプリケーションパフォーマンスモニタリング(APM)を核としつつ、インフラ、ログ、ブラウザ、モバイルなど広範囲をカバーする監視ソリューションです。データパイプラインを構成するアプリケーションやサービスに対して、コードレベルでのパフォーマンス分析やエラー追跡が可能です。アラート機能も充実しており、障害発生時の迅速な対応を支援します。

統合監視プラットフォームのメリットは、多種多様なシステムからデータを収集し、単一のダッシュボードで全体像を把握できる点にあります。特に、複数のクラウドプロバイダーを利用しているハイブリッド環境や、複雑に連携するマイクロサービスアーキテクチャを持つデータパイプラインの監視において、その真価を発揮します。導入は比較的容易ですが、利用規模に応じたランニングコストが発生します。

kintone連携による業務プロセス可視化と簡易アラート活用の可能性

データパイプラインの専門的な監視ツールとは異なるアプローチとして、kintoneのような業務アプリケーションプラットフォームを活用し、業務プロセスと連携した簡易的な監視・アラートを実現する可能性もあります。

kintone自体はデータパイプラインのパフォーマンスを直接監視するツールではありません。しかし、例えば「データ取り込み完了報告」「特定データの閾値超過報告」「データ品質チェック結果の通知」といった業務プロセスをkintoneアプリで管理し、その通知機能を活用することで、業務担当者がデータ状況を把握しやすくなります。

- 業務プロセスの可視化: データパイプラインの特定ステージで生成されたサマリーデータや、エラーレポートの要約などをkintoneアプリに自動連携します。これにより、技術者だけでなく、業務部門の担当者もデータの状態や異常を視覚的に把握できます。

- 簡易アラートとしての活用: kintoneの通知機能やリマインダー機能を利用し、アプリに登録されたデータに基づいて特定の条件(例:売上データが異常値を示した、在庫データが閾値を下回った)が満たされた場合に、関係者へ自動で通知を送ることができます。

- 手動介入プロセスの効率化: データパイプラインで検知された軽微なエラーや警告に対し、kintoneでタスクを起票し、担当者に割り当てることで、手動での確認や修正プロセスを効率化できます。

このアプローチは、特に中小企業や、特定の業務部門がデータ品質や業務指標を直接管理したい場合に有効です。専門的な監視ツールに比べてリアルタイム性や詳細な技術的監視には限界がありますが、業務担当者の視点で「データが使える状態にあるか」を簡易的に確認し、必要に応じてアクションを起こすための有効な手段となり得ます。私たちも、お客様の業務プロセスに合わせたkintone連携を提案し、データ活用の裾野を広げています。

Aurant Technologiesが支援するデータパイプライン監視・運用設計

データパイプラインの安定運用は、現代のビジネスにおいて意思決定の迅速性と正確性を支える生命線です。遅延や失敗は、ビジネス機会の損失や誤った判断に直結するため、その監視とアラート、そして運用設計は極めて重要です。

実務経験に基づいたコンサルティングと設計支援

私たちは、単に特定のツールを導入するだけでなく、貴社のビジネスプロセスとデータ特性を深く理解し、実務に即したデータパイプラインの監視・運用設計を支援しています。というのも、一口に「データパイプライン」と言っても、その構成要素やデータソース、処理頻度、求められる品質レベルは企業ごとに大きく異なるからです。

私たちのコンサルティングでは、まず貴社の現状のデータフローを詳細にヒアリングし、潜在的なボトルネックやリスクを特定します。そして、データの取り込み(Ingestion)から変換(Transformation)、格納(Storage)、そして利用(Consumption)に至るまでの全工程を俯瞰し、どこで遅延やエラーが発生しやすいのか、また、どのようなデータ品質の劣化がビジネスに影響を及ぼすのかを洗い出します。

例えば、日次バッチ処理が特定の時間帯に集中し、リソース競合による遅延が常態化しているケース。あるいは、外部APIからのデータ取得が不安定で、データ欠損が頻繁に発生しているケースなど、多岐にわたる課題を解決してきました。私たちの支援は、技術的な側面だけでなく、運用体制の構築、担当者のスキルアップ支援まで含めた包括的なものです。これにより、貴社が自律的にデータパイプラインを管理・改善できる体制を築くことを目指します。

BIツールを活用したデータ品質可視化と異常検知ダッシュボード構築

データパイプラインの健全性を常に把握するためには、状態の可視化が不可欠です。私たちは、TableauやPower BI、Looker StudioといったBIツールを活用し、データパイプラインの監視ダッシュボードを構築します。これにより、技術者だけでなく、ビジネス部門の担当者も一目でパイプラインの状態を理解できるようになります。

ダッシュボードでは、単にエラー数だけでなく、データ処理時間、データ件数の推移、データ鮮度(最終更新時刻)、特定のキー項目の欠損率や重複率など、データ品質に直結する様々な指標をリアルタイムに表示します。さらに、これらの指標に異常な変動があった際に、自動でアラートを生成する仕組みも構築します。例えば、過去の平均値からの乖離が一定以上あった場合や、処理時間が突然大幅に増加した場合など、事前に設定したルールに基づいて異常を検知します。

以下に、BIツールで可視化する主要な監視項目と、それによって得られる効果の例を示します。

| 監視項目 | 具体的な指標 | 得られる効果 |

|---|---|---|

| パイプライン稼働状況 | 各ステップの実行ステータス(成功/失敗)、実行時間、最終実行時刻 | 処理失敗の早期発見、ボトルネックの特定、パイプライン全体の健全性把握 |

| データ鮮度・遅延 | データソースからの最終取り込み時刻、データレイク/ウェアハウスへの反映時刻 | ビジネス利用可能なデータの新鮮度保証、遅延発生時の原因究明 |

| データ量・件数 | 各ステップで処理されたレコード数、ファイルサイズ、日次/月次トレンド | データ欠損・重複の検知、予期せぬデータスパイク/ドロップの把握、リソース計画 |

| データ品質 | キー項目の欠損率、重複率、型不一致エラー、異常値の分布、特定カラムの統計情報 | データ信頼性の確保、分析結果の正確性向上、データソース側の問題特定 |

| リソース使用状況 | CPU使用率、メモリ使用量、ストレージ容量、ネットワークI/O | システムパフォーマンスの最適化、コスト管理、将来的なスケーリング計画 |

LINE連携によるリアルタイムアラート通知システムの構築事例

異常を検知しても、それが適切な担当者に迅速に伝わらなければ意味がありません。私たちは、SlackやMicrosoft Teamsといったビジネスチャットツールはもちろん、特に日本の企業で利用が広まっているLINEと連携したリアルタイムアラート通知システムの構築も得意としています。

例えば、とあるEC企業では、注文データ連携パイプラインの遅延が頻繁に発生し、それが顧客への商品発送遅延に直結していました。私たちが構築したのは、パイプラインの実行状況を監視し、規定の処理時間を超過した場合や、データ件数に異常があった場合に、担当者のLINEグループに即座に通知が届くシステムです。通知内容には、どのパイプラインで、いつ、どのような種類の異常が発生したか、そして影響範囲の目安や、初動対応として確認すべきログへのリンクなども含めることで、担当者が状況を素早く把握し、的確なアクションを取れるように設計しました。その結果、問題発生から検知、対応までの時間が平均で30%短縮され、顧客満足度の向上に貢献したと報告されています(出典:業界事例レポート)。

通知の「ノイズ」を減らすことも重要です。私たちは、アラートの重要度に応じた通知チャネルやエスカレーションパスを設計し、本当に対応が必要なアラートだけが担当者に届くように調整します。これにより、担当者がアラート疲れを起こさず、集中して問題解決に取り組める環境を提供します。

医療・会計DXにおける高精度データ監視と規制対応

医療や会計といった特定の業界では、データの品質だけでなく、その取り扱いに関する規制やコンプライアンス要件が非常に厳しく、一般的なデータパイプライン監視では不十分な場合があります。私たちは、これらの業界特有の要件にも対応した高精度なデータ監視・運用設計を支援します。

例えば、医療分野では、患者データのプライバシー保護(個人情報保護法、医療情報システム安全管理に関するガイドライン等)が最重要課題です。私たちは、データ連携における匿名化・仮名化処理が適切に行われているか、アクセスログに不審な動きがないか、改ざんのリスクがないかといった点を継続的に監視する仕組みを構築します。また、データが特定の法規制に準拠しているかを確認するためのデータプロファイリングと、その結果を定期的に監査するレポート機能も組み込みます。

会計分野では、データの正確性と完全性が企業の財務健全性に直結します。仕訳データや取引データの欠損、重複、あるいは不正な改ざんは、重大な問題を引き起こしかねません。私たちは、会計システムからデータウェアハウスへの連携において、データの整合性を厳密にチェックする監視ロジックを設計します。例えば、日次で連携される取引データの合計金額が、ソースシステムとターゲットシステムで一致しているかを自動で検証し、不一致があれば即座にアラートを上げるような仕組みです。これにより、監査対応能力の向上と、データに基づいた意思決定の信頼性を高めることができます。

貴社に最適な監視・アラートシステムの構築から運用改善まで

データパイプラインの監視とアラートシステムは、一度構築すれば終わりというものではありません。ビジネスの変化、データ量の増加、システム構成の変更など、継続的な見直しと改善が不可欠です。私たちは、貴社の現状と将来の展望を踏まえ、最適な監視・アラートシステムを構築するだけでなく、その後の運用改善まで一貫してサポートします。

私たちの支援は、以下のようなフェーズで進められます。

- 現状分析と課題特定: 既存のデータパイプライン、運用体制、ビジネス要件を詳細にヒアリングし、監視のスコープと目標を明確化します。

- 要件定義と設計: 監視すべき指標、アラートの閾値、通知チャネル、エスカレーションフロー、ダッシュボードの要件などを具体的に定義し、システム設計を行います。

- 実装とテスト: 定義された設計に基づき、監視スクリプト、BIダッシュボード、アラート通知システムなどを実装し、厳格なテストを行います。

- 運用開始とトレーニング: 構築したシステムの運用を開始し、貴社の担当者様へのトレーニングを通じて、自律的な運用を支援します。

- 継続的な改善: 運用状況を定期的にレビューし、アラートのチューニング、監視項目の追加、パフォーマンス改善など、継続的な最適化をサポートします。

貴社が抱えるデータパイプラインの課題は、私たちAurant Technologiesが持つ実務経験と専門知識で解決できます。データ活用の基盤を盤石にし、ビジネスの成長を加速させるために、ぜひ一度私たちにご相談ください。

まとめ:ビジネスを加速させるデータパイプライン監視の未来

安定したデータ基盤がもたらす競争優位性

データパイプラインの監視とアラートは、単なる技術的な運用課題の解決にとどまらず、貴社のビジネスに直接的な競争優位性をもたらします。現代のビジネス環境において、データは「新たな石油」とまで言われるほど重要な資産であり、そのデータの鮮度と信頼性が、意思決定の質と速度を大きく左右するからです。

データパイプラインに遅延や失敗が発生すると、マーケティングキャンペーンの効果測定が遅れたり、顧客へのレコメンデーションが古くなったり、あるいは生産ラインの最適化データがリアルタイムで反映されないといった問題が起こります。これにより、機会損失が発生し、顧客満足度が低下し、最終的には競合他社に後れを取るリスクが高まります。

私たちが支援したあるEC企業では、データパイプラインの監視体制を強化したことで、商品在庫データとプロモーション連携の遅延を月平均で80%削減できました。これにより、欠品による販売機会損失が約15%改善され、顧客への誤ったプロモーション配信も大幅に減少しました。結果として、顧客からのクレームが減り、LTV(顧客生涯価値)向上に貢献しています。

安定したデータ基盤は、データドリブンな意思決定を加速させ、市場の変化に迅速に対応できる体制を構築します。データ品質が保証されることで、経営層は自信を持って戦略を立案し、現場は最適なアクションを即座に実行できるようになります。これは、まさにビジネスの「生命線」を守り、成長を促進する基盤となります。

以下に、安定したデータ基盤が貴社にもたらす具体的な競争優位性をまとめました。

| 競争優位性 | 具体的な効果 |

|---|---|

| 意思決定の迅速化 | リアルタイムで信頼性の高いデータに基づき、市場のトレンドや顧客行動の変化に素早く対応。競合より一歩先を行く戦略立案が可能になります。 |

| データ品質と信頼性の向上 | 遅延やエラーが早期に検知・修正されるため、データの正確性が保証されます。これにより、誤ったデータに基づく判断や施策の失敗を回避できます。 |

| 運用コストの最適化 | 手動でのエラー検知や復旧作業が大幅に削減され、データエンジニアや運用担当者の負担が軽減。人件費やリソースの効率的な配分が可能になります。 |

| 顧客満足度の向上 | パーソナライズされたサービス、正確な情報提供、迅速な問題解決が可能になり、顧客体験が向上します。これはブランドロイヤルティの強化に直結します。 |

| リスク管理とコンプライアンス遵守 | データの出所、処理状況、品質が明確に可視化されるため、データガバナンスが強化され、GDPRやCCPAなどの規制要件への対応が容易になります。 |

| イノベーションの加速 | 信頼できるデータが常に利用可能であるため、新しいデータ分析モデルの構築やAI/機械学習プロジェクトへの取り組みが加速し、新たなビジネス価値創造につながります。 |

データドリブン経営を実現するための次の一歩

データパイプラインの監視とアラート体制を確立することは、データドリブン経営を実現するための重要な一歩です。しかし、それだけで終わりではありません。この基盤を最大限に活用し、真の意味でデータをビジネスの推進力に変えるためには、さらなるステップが求められます。

まず、データリテラシーの向上が不可欠です。データが正しく、タイムリーに提供されても、それを読み解き、ビジネスに活かすスキルがなければ宝の持ち腐れになってしまいます。私たちは、各部門の担当者が自らデータを活用できるようなトレーニングプログラムの導入や、データアナリストとの連携強化を推奨しています。

次に、データガバナンスの強化です。誰がどのようなデータにアクセスでき、どのように利用するのか、その責任範囲を明確にすることで、データの信頼性とセキュリティを維持しつつ、活用を促進できます。これは、組織全体でデータに対する共通認識を持つための土台となります。

さらに、継続的な改善と文化の醸成も重要です。データパイプラインは一度構築したら終わりではなく、ビジネス要件や技術の変化に合わせて常に進化させる必要があります。定期的なレビュー会議の実施、フィードバックループの構築、そしてデータを尊重し活用する文化を組織全体で育むことが、長期的な成功には不可欠です。

ある大手小売業のケースでは、監視体制の確立後、データ品質改善チームを組成し、ビジネス部門からのフィードバックを基にデータ定義や処理ロジックを継続的に改善しました。その結果、マーケティング施策のROI(投資収益率)が平均で7%向上し、データに基づく新商品開発のサイクルも20%短縮されました。これは、単なる監視を超え、データ活用文化を醸成した成果と言えるでしょう。

データドリブン経営は、技術と組織の両面からのアプローチによって実現します。データパイプラインの安定化はその強固な土台であり、その上に貴社独自のデータ活用戦略と文化を築き上げていくことが、これからのビジネス成長を決定づける鍵となるでしょう。

Aurant Technologiesへのご相談で課題解決を

データパイプラインの監視とアラート、そしてその先のデータドリブン経営の実現は、多くの企業にとって複雑で専門的な課題です。貴社がもし、データ遅延や失敗によるビジネス損失に悩んでいる、あるいはデータ活用をさらに加速させたいと考えているのであれば、ぜひ私たちにご相談ください。

私たちAurant Technologiesは、長年の実務経験に基づき、貴社の現状を深く理解した上で、最適なデータパイプライン監視・運用設計をご提案します。単にツールを導入するだけでなく、貴社のビジネス目標に合致したアラート設計、運用フローの最適化、そしてデータ活用を推進するための組織体制づくりまで、一貫して支援することが可能です。

データ基盤の現状評価から、監視ツールの選定、導入支援、カスタムアラートの設定、そして運用担当者へのトレーニングまで、貴社のニーズに合わせた柔軟なサポートを提供します。また、データガバナンスの構築やデータリテラシー向上に向けたコンサルティングも行っており、貴社のデータドリブン経営への移行を強力にバックアップします。

データは貴社の未来を拓く羅針盤です。その羅針盤が常に正確で信頼できるものであるよう、私たちがお手伝いします。貴社のビジネスをデータで加速させるための次の一歩を、私たちと共に踏み出しましょう。

ご興味をお持ちいただけましたら、お気軽にお問い合わせください。