データウェアハウス構築:SnowflakeとBigQuery、最適なDWHを選定する徹底ガイド

SnowflakeとBigQueryのDWH選定に悩む企業へ。アーキテクチャ、機能、コスト、導入・運用、データ活用戦略まで徹底比較し、最適なDWH選びを支援します。

目次 クリックで開く

データウェアハウス構築:SnowflakeとBigQuery、最適なDWHを選定する徹底ガイド

SnowflakeとBigQueryのDWH選定に悩む企業へ。アーキテクチャ、機能、コスト、導入・運用、データ活用戦略まで徹底比較し、最適なDWH選びを支援します。

データウェアハウス(DWH)とは?なぜ今、SnowflakeとBigQueryが注目されるのか

データウェアハウス(DWH)の構築を検討されている貴社にとって、SnowflakeとBigQueryのどちらを選ぶべきか、その選定は事業戦略に直結する重要な意思決定となります。この選定は、貴社のビジネス要件、既存のクラウド戦略、予算、そしてチームのスキルセットに深く依存します。本記事では、両者の詳細な比較を通じて、貴社が最適なDWHを選定するための具体的な判断基準を提示します。

現代のビジネスにおいて、データは「新たな石油」とも呼ばれるほど価値の高い資産であり、これをいかに効率的に蓄積し、分析し、意思決定に活かすかが企業の競争力を左右します。特に、大量かつ多様なデータを扱うBtoB企業では、DWHの選定がDX推進の成否を分けると言っても過言ではありません。

今、なぜ多くの企業がSnowflakeとBigQueryに注目し、その選定に頭を悩ませているのでしょうか。それは、この2つのプラットフォームが、従来のDWHが抱えていた多くの課題を解決し、現代のデータ活用ニーズに最適化されたソリューションを提供しているからです。このセクションでは、DWHの基本的な役割から、従来のDWHとクラウド型DWHの違い、そしてSnowflakeとBigQueryが市場を牽引する理由まで、具体的な視点から解説していきます。

DWHの役割とビジネスにおける重要性

データウェアハウス(DWH)とは、企業内のあらゆるシステムから収集された膨大なデータを、分析しやすい形に統合・蓄積するためのデータベースです。例えば、販売データ、顧客データ、Webサイトのアクセスログ、広告効果データなど、散在しているデータを一箇所に集約し、時系列で整理することで、過去の傾向分析や未来予測、そしてリアルタイムな意思決定を可能にします。

DWHを導入することで、貴社のビジネスは多岐にわたるメリットを享受できます。まず、経営層は正確で最新のデータに基づいて迅速な意思決定を下せるようになります。マーケティング担当者は、顧客行動を深く理解し、パーソナライズされた施策を打つことでROIを最大化できるでしょう。業務システム担当者にとっては、各部門からのデータ抽出・分析依頼に柔軟かつスピーディに対応できるようになり、システム運用の効率化にも繋がります。

実際、データドリブンな意思決定を行う企業は、そうでない企業と比較して、売上成長率が平均で2倍以上になるという調査結果もあります(出典:MIT Sloan Management Review, IBM Institute for Business Value)。DWHは、このデータドリブン経営を実現するための基盤となる、まさに心臓部のような存在なのです。

従来のDWHとクラウド型DWHの決定的な違い

DWHの概念自体は新しいものではありませんが、近年注目されているのは「クラウド型DWH」です。従来のDWHは、自社データセンターにサーバーやストレージを設置し、ソフトウェアを導入する「オンプレミス型」が主流でした。しかし、このオンプレミス型DWHにはいくつかの課題がありました。

- 高額な初期投資と運用コスト: ハードウェア購入、ライセンス費用、専門人材の確保など、多大な初期投資と継続的な運用コストが必要でした。

- スケーラビリティの限界: データの増加や分析ニーズの変化に対応するための拡張が難しく、都度ハードウェアの増設やシステム改修が必要でした。

- 複雑な運用・保守: システムの監視、バックアップ、障害対応など、専門的な知識と手間がかかりました。

- データ処理速度の制約: 大量のデータを高速に処理するには、高性能なハードウェアと最適化が必要でした。

これに対し、SnowflakeやBigQueryに代表される「クラウド型DWH」は、これらの課題を劇的に解決しました。その決定的な違いを以下の表にまとめました。

| 項目 | 従来のオンプレミス型DWH | クラウド型DWH(Snowflake, BigQueryなど) |

|---|---|---|

| 初期投資 | 高額(ハードウェア、ライセンス費用) | 低額〜不要(サービス利用料のみ) |

| 運用コスト | 高額(保守、電力、人件費) | 利用量に応じた従量課金制 |

| スケーラビリティ | 拡張が困難、計画的な増設が必要 | オンデマンドで柔軟に拡張・縮小可能 |

| 運用・保守 | 自社で実施、専門知識が必要 | ベンダーが実施(マネージドサービス) |

| データ処理速度 | ハードウェア性能に依存 | 分散処理により高速、パフォーマンス最適化が容易 |

| 導入期間 | 数ヶ月〜年単位 | 数日〜数週間 |

クラウド型DWHは、必要な時に必要なだけリソースを利用できる従量課金モデルと、運用・保守がベンダー任せにできるマネージドサービスである点が最大の魅力です。これにより、貴社はインフラの管理から解放され、本来の目的であるデータ分析とビジネス価値創造に集中できるようになるわけです。

SnowflakeとBigQueryが市場を牽引する理由

クラウド型DWHの中でも、SnowflakeとGoogle BigQueryは特に強力な存在感を放ち、市場を牽引しています。両者には共通して、高いパフォーマンス、優れたスケーラビリティ、そして使いやすさといった特徴がありますが、それぞれ異なるアプローチと強みを持っています。

Snowflakeが注目される理由:

- ストレージとコンピュートの分離: Snowflakeの最大の特長は、データの保存(ストレージ)と処理(コンピュート)の層が完全に分離されている点です。これにより、データ量に関わらず分析リソースを柔軟にスケールさせることができ、コスト効率の高い運用を実現します。

- マルチクラウド対応: AWS、Azure、Google Cloudといった主要なクラウドプロバイダー上で動作するため、特定のクラウドベンダーに縛られることなく、貴社の既存インフラや戦略に合わせて最適な環境を選択できます。

- データシェアリング: 企業間でのセキュアなデータ共有を容易にする機能が充実しており、サプライチェーンやパートナー企業との連携において大きな価値を発揮します。

- 豊富な機能: Zero Copy Cloning(データの複製を瞬時に行い、ストレージコストを抑える)、Time Travel(過去のデータ状態を復元する)など、データ管理・分析を効率化する独自機能が豊富です。

BigQueryが注目される理由:

- 完全サーバーレスアーキテクチャ: Google Cloudが提供するBigQueryは、サーバー管理が一切不要な完全サーバーレスのDWHです。リソースのプロビジョニングやスケーリングは全て自動で行われるため、運用負荷が極めて低いです。

- Google Cloudエコシステムとの連携: Google Cloudの他のサービス、例えばデータ可視化ツールのLooker Studio(旧Google データポータル)、機械学習プラットフォームのVertex AI、データ統合サービスのCloud Dataflowなどとの連携が非常に強力です。これにより、データ収集から分析、機械学習による予測までを一貫した環境で実現できます。

- リアルタイム分析能力: 数テラバイト、ペタバイト級のデータに対しても、数秒から数十秒でクエリ結果を返す高速な処理能力を持ち、リアルタイムに近いデータ分析が可能です。

- BigQuery ML: SQLの知識だけで機械学習モデルを構築・実行できるBigQuery ML機能が統合されており、データサイエンティストでなくても高度な予測分析に取り組めます。

これらの特徴から、両者ともに現代のデータ活用ニーズに応える強力なソリューションとして、多くの企業に選ばれています。貴社のビジネス要件や既存のクラウド戦略、そして将来的なデータ活用プランによって、最適な選択肢は変わってくるでしょう。次からのセクションでは、さらに具体的な選定基準と導入プロセスについて掘り下げていきます。

SnowflakeとBigQueryの基本を徹底比較:アーキテクチャと特徴

データウェアハウスの構築を検討されている貴社にとって、SnowflakeとBigQueryは有力な選択肢として常に比較対象となるでしょう。どちらもクラウドネイティブなデータウェアハウスとして高いパフォーマンスとスケーラビリティを提供しますが、その裏側にあるアーキテクチャと設計思想には明確な違いがあります。この違いを深く理解することが、貴社のビジネス要件に最適なプラットフォームを選定する上で不可欠です。

ここでは、両者の革新的なアーキテクチャとそれぞれの強みを詳細に解説し、貴社が選定を進める上での具体的な判断材料を提供します。

Snowflakeの革新的なアーキテクチャと強み

Snowflakeは、その「マルチクラスター共有データアーキテクチャ」によって、従来のデータウェアハウスの課題を根本的に解決しました。このアーキテクチャは、ストレージ、コンピュート、そしてクラウドサービスという3つの主要レイヤーが完全に分離されている点が最大の特徴です。だからこそ、各レイヤーが独立してスケーリングでき、柔軟な運用が可能になるのです。

- ストレージレイヤー: 圧縮・最適化されたデータを保存し、複数のクラウドプロバイダー(AWS, Azure, GCP)上で動作します。独自のマイクロパーティション化技術により、高いクエリパフォーマンスを実現します。

- コンピュートレイヤー(仮想ウェアハウス): SQLクエリの実行を担当する独立したコンピューティングクラスターです。貴社のワークロードに合わせて、Sから6XLまでのサイズを自由に選択でき、必要に応じて自動でスケールアップ・スケールダウン、または複数クラスターの並行稼働が可能です。

- クラウドサービスレイヤー: 認証、メタデータ管理、クエリ最適化、アクセス制御など、Snowflake全体の運用を司る頭脳の部分です。

この分離されたアーキテクチャは、以下のような明確な強みをもたらします。

- 高い柔軟性と独立したスケーリング: ストレージとコンピュートが独立しているため、データ量が増えてもクエリパフォーマンスを維持しやすく、逆にクエリ負荷が高まってもストレージコストに影響を与えません。例えば、日中のレポート作成時には大きなウェアハウスを使い、夜間のバッチ処理には別のウェアハウスを使うといった柔軟な運用が可能です。

- コスト最適化: 貴社は使った分だけコンピュートリソース(仮想ウェアハウスの稼働時間)とストレージ容量に対して課金されます。アイドル状態のウェアハウスは自動で停止するため、無駄なコストを削減しやすい設計になっています。

- データシェアリング: Snowflake独自の「Data Sharing」機能は、組織内外のユーザーやパートナーと安全かつ簡単にデータを共有できます。データコピーの必要がないため、常に最新のデータにアクセスでき、ガバナンスも維持しやすいのが魅力です。

- 多様なデータソースとの連携: 構造化データだけでなく、半構造化データ(JSON, Avro, XMLなど)もネイティブでサポートしており、ETL/ELTパイプライン構築の柔軟性が高いです。

業界では、Snowflakeのこのような特徴が、特にデータ量やクエリの種類が多岐にわたる企業で高く評価されています。例えば、Gartner Peer Insightsのレビューでは、その柔軟なスケーラビリティとコスト管理のしやすさが、多くのユーザーから高評価を得ています(出典:Gartner Peer Insights)。

BigQueryのサーバーレスアーキテクチャと強み

一方、Google Cloudが提供するBigQueryは、その「完全サーバーレス」という設計思想が際立っています。貴社がインフラのプロビジョニング、スケーリング、パッチ適用といった運用管理から完全に解放されるのが最大のメリットです。BigQueryは、Googleのグローバルインフラストラクチャの上に構築されており、以下の主要な技術要素によって支えられています。

- Dremel: BigQueryの中核をなすクエリエンジンで、ペタバイト級のデータに対して数秒でSQLクエリを実行できる超高速並列処理を実現します。列指向ストレージとツリー構造の実行モデルを組み合わせることで、効率的なデータスキャンと集計が可能です。

- Colossus: Googleの分散ファイルシステムであり、BigQueryのデータを格納するストレージレイヤーです。高い耐久性と可用性を持ち、自動的にスケーリングします。

- Jupiter: Googleのグローバルネットワークインフラストラクチャで、データ転送の高速化と低レイテンシーを実現し、BigQueryの高速クエリに貢献しています。

BigQueryの完全サーバーレスアーキテクチャは、貴社に以下の強みをもたらします。

- 運用管理の最小化: 貴社はサーバーやクラスターの管理、メンテナンスについて一切考慮する必要がありません。Googleがすべてのインフラストラクチャを管理するため、データ分析に集中できます。

- ペタバイト級データへの超高速クエリ: Dremelの強力な並列処理能力により、大規模なデータセットに対しても驚異的な速度でクエリを実行できます。これは、リアルタイム分析やアドホック分析において非常に強力な武器となります。

- コスト効率性: 基本的にクエリによってスキャンされたデータ量に応じて課金される「オンデマンド」モデルと、予測可能なワークロード向けの「定額料金(スロット)」モデルがあります。データストレージも安価であり、使った分だけ支払う従量課金制です。

- Google Cloudエコシステムとの統合: BigQuery MLによる機械学習機能、Looker Studio(旧Google Data Portal)によるBI連携、Cloud DataflowやCloud Pub/Subとの連携など、Google Cloudの幅広いサービスとシームレスに統合できます。

Googleの内部データによると、BigQueryは月間数百万のクエリを処理し、多くの企業がそのスケーラビリティと運用負荷の低減を享受しています。特に、数ペタバイト規模のデータセットを扱う企業が、運用チームを増強することなくデータ分析を加速できた事例が多数報告されています(出典:Google Cloud)。

両者の共通点と根本的な設計思想の違い

SnowflakeとBigQueryは、どちらも現代のデータウェアハウスに求められる多くの共通点を持っています。例えば、両者ともにクラウドネイティブであり、高いスケーラビリティとパフォーマンスを提供し、SQLをベースとしたクエリ言語を採用しています。また、データの耐久性やセキュリティに関しても、各クラウドプロバイダーの堅牢なインフラストラクチャを基盤としているため、高いレベルで保証されています。

しかし、その根本的な設計思想には重要な違いがあります。Snowflakeは「ストレージとコンピュートの分離」を徹底し、貴社がコンピュートリソース(仮想ウェアハウス)のサイズや数を柔軟に制御できる自由度を重視しています。これにより、特定のワークロードやコスト要件に合わせて、リソースを細かく最適化できる点が強みです。

対してBigQueryは、「完全なサーバーレス」を追求し、貴社がインフラ管理から完全に解放されることを最優先しています。貴社はデータ投入とクエリ実行にのみ集中でき、システムが自動で最適なリソースをプロビジョニング・スケーリングするため、運用負荷はほぼゼロになります。この違いが、貴社のチーム構成、運用ポリシー、そして最も重視するポイント(柔軟な最適化か、徹底した運用負荷軽減か)によって、どちらがより適しているかを分けることになります。

以下の表で、両者の主要な特徴を比較します。

| 項目 | Snowflake | BigQuery |

|---|---|---|

| アーキテクチャ | マルチクラスター共有データアーキテクチャ(ストレージ、コンピュート、クラウドサービスレイヤーの分離) | 完全サーバーレス(Dremel, Colossus, Jupiter) |

| コンピュート管理 | 仮想ウェアハウス(サイズ選択、自動スケーリング設定) | 完全自動プロビジョニング(オンデマンド/定額) |

| ストレージ | 独自のマイクロパーティション化されたストレージ | Colossus(Googleの分散ファイルシステム) |

| スケーラビリティ | ストレージとコンピュートが独立して自動スケーリング | 完全自動スケーリング(ペタバイト級対応) |

| 運用管理 | 仮想ウェアハウスの管理は必要だが、インフラ管理は不要 | ほぼ運用管理不要。データ投入とクエリに集中 |

| 主な強み |

|

|

| 料金モデル | コンピュート時間(クレジット消費)とストレージ容量で課金 | クエリデータ量(オンデマンド)または固定スロット(定額)、ストレージ容量で課金 |

| クラウドプロバイダー | AWS, Azure, Google Cloudから選択可能 | Google Cloud Platformのみ |

【機能・性能比較】Snowflake vs BigQuery:自社に最適な選択のために

データウェアハウスの選定は、貴社のデータ活用戦略の成否を左右する重要な決断です。特にSnowflakeとBigQueryは、現代のデータプラットフォームを代表する存在であり、それぞれに強力な特徴を持っています。このセクションでは、貴社にとって最適な選択をするために、両者の機能と性能を多角的に比較していきます。

パフォーマンスとスケーラビリティの比較

データウェアハウスの基盤性能は、ビジネスの意思決定スピードに直結します。SnowflakeとBigQueryはともに高いパフォーマンスとスケーラビリティを誇りますが、その実現アプローチには違いがあります。

BigQueryは、Googleのグローバルインフラストラクチャを基盤とした完全なサーバーレスアーキテクチャを採用しています。これにより、貴社はインフラ管理を一切意識することなく、ペタバイト級のデータに対して秒単位でクエリを実行できます。コンピューティングリソースはクエリの負荷に応じて自動的にスケールし、オンデマンドで利用した分だけ課金されるモデルが基本です。定額制(BigQuery Editions)も選択でき、予測可能なコストで高性能なワークロードを運用することも可能です。

一方、Snowflakeは、コンピューティングとストレージを完全に分離した独自のアーキテクチャが特徴です。コンピューティングリソースは「仮想ウェアハウス」として提供され、貴社のワークロードに合わせて独立してスケールアップ・スケールダウンが可能です。例えば、データロード用のウェアハウスと分析クエリ用のウェアハウスを別々に用意し、それぞれの負荷に応じてリソースを調整するといった柔軟な運用ができます。これにより、特定のクエリが他のクエリのパフォーマンスに影響を与える「リソース競合」を防ぎ、高いコンカレンシー(同時実行性)を実現します。また、アイドル状態のウェアハウスは自動的にサスペンドされ、コストを最適化します。

両者のパフォーマンスとスケーラビリティに関する比較を表にまとめました。

| 項目 | Snowflake | BigQuery |

|---|---|---|

| アーキテクチャ | ストレージとコンピューティングの分離(仮想ウェアハウス) | 完全サーバーレス、共有リソースプール |

| スケーリング | 仮想ウェアハウスのサイズ変更、複数ウェアハウスによる並行処理(手動/自動サスペンド) | クエリ負荷に応じた自動スケーリング(スロット単位) |

| コンカレンシー | 複数の仮想ウェアハウスにより高い同時実行性を実現 | スロット割り当てにより同時実行性を管理 |

| クエリパフォーマンス | マイクロパーティション化、自動クラスタリング、クエリ最適化 | コラムナー型ストレージ、実行エンジン(Dremel)、自動最適化 |

| 管理負担 | 仮想ウェアハウスの管理・最適化が必要だが、自動化機能も豊富 | ほぼゼロ。インフラ管理はGoogleが全て担当 |

データ形式・データ型サポートと柔軟性

現代のデータは多様であり、構造化データだけでなく、半構造化データ(JSONなど)や非構造化データも頻繁に扱われます。データウェアハウスがどれだけ多様なデータ形式を柔軟に扱えるかは、データ統合の容易さに直結します。

BigQueryは、標準SQL(Google Standard SQL)をベースに、JSON、Avro、Parquet、ORC、CSVといった主要なデータ形式を幅広くサポートしています。特に半構造化データについては、ネストされたフィールドや繰り返しフィールドを直接扱える点が強みです。例えば、ウェブアプリケーションから送られてくるJSON形式のログデータを、スキーマ定義を厳密にすることなく直接取り込み、SQLで簡単に分析できるため、ETLプロセスを簡素化できるケースが多くあります。また、地理空間データ型(GEOGRAPHY)のサポートも充実しており、位置情報分析にも適しています。

Snowflakeも同様に、標準SQL(ANSI SQL準拠)を基盤とし、JSON、Avro、Parquet、ORC、XML、CSVなど多様なデータ形式に対応しています。Snowflakeの大きな特徴は、半構造化データを扱うための「VARIANT」データ型です。このVARIANT型を使用すると、スキーマレスなJSONやXMLデータをそのまま取り込み、SQL関数を使って必要な部分だけを抽出・変換できます。これにより、データソースのスキーマ変更にも柔軟に対応でき、データエンジニアリングの負荷を軽減できます。外部ステージ機能を使えば、AWS S3やAzure Blob Storage、Google Cloud Storageに置かれたファイルを直接クエリすることも可能です。

| 項目 | Snowflake | BigQuery |

|---|---|---|

| SQL互換性 | ANSI SQL準拠 | Google Standard SQL (ANSI 2011準拠) |

| サポートデータ形式 | CSV, JSON, Avro, Parquet, ORC, XMLなど | CSV, JSON, Avro, Parquet, ORCなど |

| 半構造化データ | VARIANT型による柔軟な取り扱い、SQL関数で抽出・変換 | ネスト・繰り返しフィールドを直接サポート、SQL関数で抽出 |

| 特徴的なデータ型 | VARIANT (JSON, XML), GEOGRAPHY (プレビュー) | GEOGRAPHY, ARRAY, STRUCT |

| 外部データソース | 外部ステージ経由でクラウドストレージのファイルを直接クエリ | 外部テーブル経由でクラウドストレージのファイルを直接クエリ |

SQL互換性、開発者体験、エコシステム

データウェアハウスは、単なるデータの保管場所ではなく、データ分析やアプリケーション開発の基盤となるものです。そのため、SQL互換性、開発者の使いやすさ、そして周辺ツールとの連携(エコシステム)は、選定において非常に重要な要素となります。

BigQueryは、Google Standard SQLを採用しており、標準的なSQL構文に加えて、地理空間関数や機械学習関数(BigQuery ML)など、Google Cloudならではの拡張機能を提供しています。開発者体験としては、Google Cloud ConsoleからのWeb UI操作はもちろん、Python、Java、Go、Node.jsなど主要なプログラミング言語向けのクライアントライブラリが充実しています。さらに、Looker Studio(旧Google Data Studio)やColab、Cloud DataflowといったGoogle Cloudのエコシステムとの連携が非常にスムーズで、データ分析から可視化、ETLまで一貫したワークフローを構築しやすいのが特徴です。

SnowflakeもANSI SQLに準拠しており、多くのSQLユーザーにとって馴染みやすい環境を提供します。開発者向けには、Snowflake Scripting(JavaScriptベース)によるストアドプロシージャの記述や、Snowpark(Python, Scala, Java)によるデータサイエンスや機械学習ワークロードの統合を強化しています。Snowparkは、Snowflakeの強力なコンピューティングリソースを活かし、データの移動なしに大規模なデータ処理やMLモデル構築を可能にします。エコシステムに関しては、SaaSとして提供されているため、特定のクラウドベンダーに依存せず、主要なBIツール(Tableau, Power BI, Lookerなど)、ETLツール(Fivetran, dbtなど)とのコネクタが非常に豊富です。また、Snowflake Data Marketplaceを通じて、外部のデータプロバイダーから直接データを取得・共有できる点もユニークな強みです。

| 項目 | Snowflake | BigQuery |

|---|---|---|

| SQL互換性 | ANSI SQL準拠 | Google Standard SQL (ANSI 2011準拠) |

| 開発者向け機能 | Snowflake Scripting (JS), Snowpark (Python, Scala, Java) | BigQuery ML (SQLベース), Python, Java, Goクライアントライブラリ |

| 機械学習統合 | SnowparkによるMLワークロード、外部MLサービス連携 | BigQuery MLによるSQLベースのMLモデル構築・推論 |

| BIツール連携 | Tableau, Power BI, Lookerなど主要ツールと広範に連携 | Looker Studio (旧Google Data Studio), Looker, TableauなどGoogle Cloud製品との連携が特に強力 |

| ETL/ELTツール連携 | Fivetran, dbtなど多数のツールと連携 | Cloud Dataflow, Cloud ComposerなどGoogle Cloud製品との連携が特に強力 |

| データ共有・マーケットプレイス | Snowflake Data Marketplaceによるデータ共有・取得 | データセット共有機能 |

セキュリティ、コンプライアンス、データガバナンス

データウェアハウスに蓄積されるデータは、企業の最も重要な資産の一つであり、機密情報や個人情報を含むことが多いため、セキュリティ、コンプライアンス、データガバナンスは最優先事項です。

BigQueryは、Google Cloudの堅牢なセキュリティインフラストラクチャの上に構築されています。保存データおよび転送中のデータは、デフォルトで暗号化されます。Google Cloud IAM(Identity and Access Management)により、プロジェクト、データセット、テーブル、ビューといった粒度で非常にきめ細かいアクセス制御が可能です。データ損失防止(DLP)機能やCloud Audit Logsによる詳細な監査ログも提供され、コンプライアンス要件への対応を支援します。SOC 1/2/3、ISO 27001、HIPAA、GDPRなど、主要な国際的なコンプライアンス認証に準拠しています。

Snowflakeもまた、セキュリティとデータガバナンスに非常に力を入れています。データは保存時も転送時もエンドツーエンドで暗号化され、顧客がキー管理を制御することも可能です。ロールベースのアクセス制御(RBAC)により、きめ細かな権限管理が実現できます。さらに、多要素認証(MFA)、ネットワークポリシー(IPアドレス制限)、データマスキング、行アクセスポリシー、列レベルセキュリティといった高度なセキュリティ機能が標準で提供されます。これらの機能は、特定のユーザーやロールに対して、データの特定の部分を非表示にしたり、匿名化したりすることを可能にし、厳格なデータガバナンス要件を満たします。Snowflakeは、SOC 1/2/3、ISO 27001、HIPAA、PCI DSS、GDPRなど、幅広い業界規制やコンプライアンス基準に対応しています。

| 項目 | Snowflake | BigQuery |

|---|---|---|

| データ暗号化 | 保存時・転送時ともにデフォルトでエンドツーエンド暗号化(顧客管理キーも対応) | 保存時・転送時ともにデフォルトで暗号化(顧客管理キーも対応) |

| アクセス制御 | ロールベースアクセス制御 (RBAC) | IAM (Identity and Access Management) による詳細な制御 |

| 高度なセキュリティ機能 | データマスキング、行アクセスポリシー、列レベルセキュリティ、ネットワークポリシー、MFA | データ損失防止 (DLP)、組織ポリシー、VPC Service Controls |

| 監査機能 | クエリ履歴、アクセスログ | Cloud Audit Logsによる詳細な監査ログ |

| コンプライアンス | SOC 1/2/3, ISO 27001, HIPAA, PCI DSS, GDPRなど | SOC 1/2/3, ISO 27001, HIPAA, GDPRなど |

マルチクラウド・ハイブリッドクラウド対応の有無

多くの企業がマルチクラウド戦略やハイブリッドクラウド戦略を採用している現代において、データウェアハウスがこれらの環境にどれだけ柔軟に対応できるかは、導入後の拡張性やベンダーロックイン回避の観点から重要です。

Snowflakeは、AWS、Azure、GCPのいずれかの主要クラウドプロバイダー上で動作するように設計されています。貴社は、自社がすでに利用しているクラウド環境に合わせてSnowflakeのデプロイ先を選択できます。これにより、既存のクラウドインフラとの連携をスムーズに行うことが可能です。さらに、Snowflakeのデータレプリケーション機能を使えば、異なるクラウド間や異なるリージョン間でデータを複製・同期でき、災害復旧や地理的なデータ分散を容易にします。また、Snowflake Data Sharing機能により、異なるクラウド上のSnowflakeアカウント間でも安全にデータを共有できます。これは、マルチクラウド環境でのデータ連携において非常に強力なアドバンテージとなります。

BigQueryは、基本的にGoogle Cloud Platformのサービスとして提供されます。しかし、GoogleはBigQuery Omniという機能を提供しており、これにより貴社はAWSやAzure上に存在するデータを、そのクラウドから移動させることなくBigQueryのインターフェースを通じてクエリできます。これは、データガバナンスやデータ所在地要件が厳しい場合や、データ移動に伴うコストや時間を削減したい場合に非常に有効なマルチクラウド対応と言えます。オンプレミス環境との連携については、Google Cloud InterconnectやVPNを用いてセキュアな接続を確立することで、ハイブリッドクラウド環境を構築できます。

| 項目 | Snowflake | BigQuery |

|---|---|---|

| デプロイ先クラウド | AWS, Azure, GCPの中から選択可能 | Google Cloud Platformが基本 |

| マルチクラウド戦略 | 異なるクラウド間でデータレプリケーション・共有が可能。既存クラウドインフラに合わせたデプロイ。 | BigQuery Omniにより、AWS/Azure上のデータをBigQueryインターフェースから直接クエリ可能(データ移動なし)。 |

| ハイブリッドクラウド戦略 | オンプレミスデータソースへのコネクタやETLツール連携 | Cloud Interconnect, VPNによりオンプレミスとのセキュアな接続を確立。 |

| データ所在地要件 | 選択したクラウドプロバイダーの特定リージョンにデータを配置 | 選択したリージョンにデータを配置。BigQuery Omniはデータが既存クラウド外に出ない。 |

【コスト比較】Snowflake vs BigQuery:料金体系とTCO(総所有コスト)を解説

データウェアハウスの選定において、機能やパフォーマンスと同じくらい、いやそれ以上に「コスト」は重要な判断基準になりますよね。特にクラウドサービスの場合、料金体系が複雑で、どこにどれだけの費用がかかるのか見えにくいと感じる担当者の方も多いのではないでしょうか。実際に、私たちがお手伝いした企業様でも、初期の見積もりと実際の運用コストに乖離が生じてしまい、再評価が必要になったケースは少なくありません。

このセクションでは、SnowflakeとBigQueryそれぞれの料金モデルを掘り下げ、総所有コスト(TCO)という視点から、貴社にとって最適な選択をするための具体的なヒントをお伝えします。

Snowflakeの料金モデル:コンピューティングとストレージの分離課金

Snowflakeの料金体系は、大きく分けて「コンピューティング」と「ストレージ」の2つの要素で構成されています。これは、両者が完全に分離して課金されるという点が特徴です。

- コンピューティング料金: データの処理やクエリの実行に使われる「仮想ウェアハウス」の利用に対して課金されます。料金は「クレジット」という単位で消費され、仮想ウェアハウスのサイズ(XS、S、Mなど)と稼働時間に応じて消費量が決まります。例えば、より大きなウェアハウスを使えば、同じ処理でも短時間で完了するため、結果的にクレジット消費を抑えられることもあります。また、使用した分だけ課金されるオンデマンド方式と、一定量を事前に購入するキャパシティ契約があります。

- ストレージ料金: Snowflakeに保存されているデータ量に応じて課金されます。圧縮された状態で計算されるため、ディスク上の物理的なサイズよりも効率的です。

その他、データ転送(クラウドプロバイダーをまたぐ転送やリージョン外への転送)、Snowpipe(継続的なデータロードサービス)、検索最適化サービスなども追加料金の対象となる場合があります。

このモデルのメリットは、コンピューティングリソースを柔軟にスケールアップ・ダウンできるため、負荷の変動が大きいワークロードや、予測不能なバーストトラフィックに強い点です。ただし、ウェアハウスが不必要に長時間稼働していると、クレジット消費がかさんでしまうため、適切な管理が求められます。

BigQueryの料金モデル:ストレージ、クエリ、データ転送

BigQueryの料金体系も、Snowflakeと同様に「ストレージ」と「クエリ」が主要な要素ですが、その課金方法に違いがあります。

- ストレージ料金: BigQueryに保存されているデータ量に応じて課金されます。データが30日以上更新されない場合は「ロングタームストレージ」として自動的に割引料金が適用される点が特徴です。これにより、アクセス頻度の低いデータのコストを抑えられます。

- クエリ料金: これはさらに「オンデマンド」と「フラットレート」の2つに分けられます。

- オンデマンド: 実行されたクエリがスキャンしたデータ量に基づいて課金されます。最初の1TB/月は無料枠があり、小規模な利用や開発環境に適しています。しかし、大規模なデータセットに対して最適化されていないクエリを実行すると、予期せぬ高額な費用が発生するリスクもあります。

- フラットレート: 事前に特定の処理能力(スロット)を予約する方式です。月額固定料金で、スキャンデータ量に関わらず一定の費用で利用できます。クエリの実行頻度やスキャンデータ量が予測可能な、大規模かつ定常的なワークロードに適しています。

データ転送(リージョン外への転送)、ストリーミング挿入、BigQuery Omni(他クラウドのデータ分析)なども追加料金が発生する可能性があります。BigQueryの強みは、Google Cloudのエコシステムとの統合の深さ、そしてオンデマンドクエリの無料枠やロングタームストレージによるコスト効率の良さです。

コスト最適化の具体的なポイントと見積もり例

どちらのサービスを選定するにしても、コスト最適化は継続的な取り組みが求められます。私たちは、貴社がデータウェアハウスを導入・運用する際に、以下の点を特に重視して設計を提案しています。

- データライフサイクル管理: 不要なデータの削除、アクセス頻度に応じたストレージ階層の活用(BigQueryのロングタームストレージなど)は基本中の基本です。

- クエリの最適化: 必要なカラムのみを選択する、パーティションやクラスタリングを適切に利用する、非効率なクエリを特定して改善するなど、データエンジニアリングのスキルが直接コストに影響します。

- 適切なエディション/契約モデルの選定: Snowflakeであれば、利用状況に応じてオンデマンドとキャパシティ契約を使い分ける。BigQueryであれば、オンデマンドとフラットレートのどちらが貴社のワークロードに合致するかを慎重に見極める必要があります。

- 自動サスペンド/レジューム機能の活用: Snowflakeの仮想ウェアハウスは、一定時間アクティビティがない場合に自動で停止し、クエリが実行されると自動で再開する設定が可能です。これにより、不要なクレジット消費を大幅に削減できます。

具体的な見積もりは貴社のデータ量、クエリ頻度、同時実行ユーザー数、データ転送量などによって大きく変動しますが、一般的な傾向として以下の比較表が参考になるでしょう。

| 項目 | Snowflakeの傾向 | BigQueryの傾向 |

|---|---|---|

| コンピューティング課金 | 仮想ウェアハウスの稼働時間とサイズに依存(クレジット消費)。柔軟なスケールアップ/ダウンが可能。 | クエリの種類(オンデマンド/フラットレート)に依存。オンデマンドはスキャンデータ量、フラットレートは固定容量。 |

| ストレージ課金 | データ量に比例。圧縮後のサイズで課金。 | データ量に比例(アクティブ/ロングターム)。ロングタームは割引あり。 |

| クエリパターンへの適応 | 予測不能な負荷変動やバーストトラフィックに強い。 | 定型的な分析や大量データスキャンに強い。安定したワークロード向け。 |

| データ転送 | クラウドプロバイダー間やリージョン外への転送に課金。 | リージョン外への転送に課金。 |

| TCOの傾向 | 柔軟性が高く、急な負荷増大にも対応しやすいが、適切に管理しないと高額になる可能性。 | 定型ワークロードにはコスト効率が良いが、クエリの複雑性や非効率性で費用が変動しやすい。 |

長期的なTCOを考慮した費用対効果の評価

データウェアハウスの選定では、表面的な利用料だけでなく、長期的なTCO(総所有コスト)を考慮することが非常に重要です。TCOには、直接的なコンピューティング・ストレージ料金だけでなく、以下のような隠れたコストも含まれます。

- 運用・管理コスト: データパイプラインの構築・保守、セキュリティ管理、パフォーマンスチューニングなどにかかる人件費。

- 学習コスト: 新しいサービスを導入する際のデータエンジニアやアナリストの学習時間、トレーニング費用。

- データガバナンスコスト: データ品質の維持、コンプライアンス対応にかかる費用。

- データ転送コスト: 異なるクラウドサービス間やリージョン間のデータ移動にかかる費用。特に大量データを扱う場合は無視できません。

例えば、BigQueryのオンデマンドクエリは無料枠があるため、テスト段階や小規模な利用では非常に有利です。しかし、本番環境でデータ量が増え、非効率なクエリが多発すると、スキャンデータ量に応じた課金が膨大になるリスクがあります。一方でSnowflakeは、仮想ウェアハウスの適切な停止・再開設定により、アイドル時のコストを最小限に抑えつつ、必要な時に高速処理を提供できます。私たちの経験では、特にクエリ負荷が予測しにくい状況や、特定の期間だけ集中的に分析を行うようなケースでは、Snowflakeの柔軟な課金モデルがTCO削減に貢献した事例も多くあります。例えば、あるメディア企業では、キャンペーン期間中のアクセス急増に対応するため、Snowflakeの仮想ウェアハウスを一時的にスケールアップし、キャンペーン終了後には自動停止させることで、必要な時だけ高性能なリソースを利用し、コストを最適化しました。これにより、ピーク時の分析遅延を防ぎつつ、月間のDWH費用を約20%削減できた実績があります。

最終的な費用対効果は、貴社のビジネスモデル、データ活用戦略、そしてチームのスキルセットに大きく依存します。コストだけでなく、パフォーマンス、スケーラビリティ、運用負荷、将来的な拡張性なども総合的に評価し、貴社にとって最適なデータウェアハウスを選定することが成功の鍵となるでしょう。

【導入・運用】SnowflakeとBigQueryの導入プロセスと注意点

データウェアハウスの選定は重要なステップですが、その後の導入から運用までのプロセスこそ、貴社のビジネスに真の価値をもたらす鍵となります。SnowflakeとBigQueryはともに強力なプラットフォームですが、導入・運用フェーズでの特性や注意点を理解しておくことが成功には不可欠です。ここでは、具体的なプロセスと、私たちがこれまでの支援を通じて得た実践的な知見をお伝えします。

データソースの選定と統合戦略

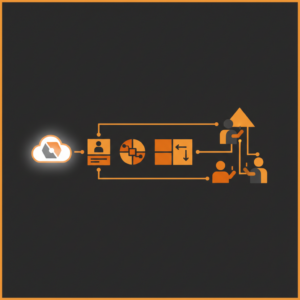

データウェアハウスを構築する上で、まず考えるべきは「どのデータを集めるか」という点です。貴社が保有するデータソースは、CRM(Salesforce)、SFA、ERP、マーケティングオートメーション(MA)、ウェブサイトのアクセスログ、kintoneなどの業務システム、さらにはIoTデバイスから得られるリアルタイムデータまで多岐にわたるでしょう。これらのデータの中から、ビジネス目標達成に最も貢献するものを優先的に選定し、統合戦略を練ることが重要です。

統合方法としては、ETL(Extract, Transform, Load)またはELT(Extract, Load, Transform)のアプローチが主流です。SnowflakeもBigQueryも、Fivetran、Airbyte、dbtなどの多様なサードパーティ製データ統合ツールや、それぞれのクラウドエコシステムが提供するサービス(Google Cloud Dataflow, Cloud Composerなど)と連携しやすい設計になっています。どのツールを選ぶかは、データ量、更新頻度、必要な変換処理の複雑さ、そして貴社の既存スキルセットによって変わってきます。

私たちがお勧めするのは、データ統合の初期段階でデータ品質管理とガバナンスの計画を立てておくことです。データが統合されて初めて、その品質の課題が顕在化することも少なくありません。例えば、異なるシステム間で顧客IDの形式が異なるといった問題は、後の分析精度に大きく影響します。初期段階での計画が、後々の手戻りを防ぐことにつながります。

データモデリングとスキーマ設計のベストプラクティス

データウェアハウスにおけるデータモデリングとスキーマ設計は、クエリ性能、データ分析のしやすさ、そして長期的な保守性を大きく左右します。一般的には、スター型スキーマやスノーフレーク型スキーマが用いられますが、近年ではデータレイクハウスアーキテクチャの文脈で、より柔軟な設計も増えています。

SnowflakeとBigQueryは、それぞれ異なるデータ構造の強みを持っています。Snowflakeは、半構造化データ(JSON, XML, Avroなど)を直接扱えるVARIANT型が強力で、スキーマオンリード(読み込み時にスキーマを定義)に近い柔軟なデータ活用が可能です。一方、BigQueryはネストされた繰り返しフィールド(RECORD/REPEATED型)をサポートしており、非正規化された構造で高速なクエリを実現します。どちらの特性も理解し、貴社のデータ特性や分析要件に合わせて最適な設計を選択することが重要です。

データモデリングのプロセスを効率化するためには、dbt(data build tool)のようなツールを活用するのがベストプラクティスです。dbtを使うことで、SQLベースでデータ変換ロジックをバージョン管理し、テスト可能で再利用性の高いデータモデルを構築できます。当社の経験では、初期段階でデータモデリングを疎かにすると、後々のクエリ性能劣化やデータ構造の複雑化を招き、結果的に運用コストが増大するケースが少なくありません。将来的なビジネス要件の変化にも対応できるよう、拡張性と柔軟性を考慮した設計を心がけましょう。

データ移行戦略:オンプレミスからクラウドへのスムーズな移行

既存のオンプレミス環境や他のクラウドサービスからSnowflakeやBigQueryへのデータ移行は、プロジェクトの成否を分ける重要なフェーズです。移行方法には、大きく分けて「フルロード(一括移行)」と「差分ロード(継続的な同期)」、そしてこれらを組み合わせた「ハイブリッド方式」があります。

大容量データの移行には、専用のツールやサービスを活用するのが一般的です。SnowflakeではSnowpipeによるリアルタイムに近いデータロード、COPY INTOコマンドによる一括ロードが可能です。BigQueryではBigQuery Data Transfer Serviceが各種SaaSやGoogle Cloudサービスからのデータ転送をサポートし、gsutilコマンドやCloud Storage Transfer Serviceも利用できます。特にペタバイト級のデータ移行では、Google CloudのTransfer Applianceのような物理デバイスを使ったオフライン転送も選択肢に入ります。

データ移行戦略を立てる上で、以下のポイントを考慮してください。

| 項目 | 考慮事項 | Snowflakeの対応 | BigQueryの対応 |

|---|---|---|---|

| ダウンタイム | 業務への影響を最小限に抑える | Snowpipeによる継続的なロード | Data Transfer Serviceによる継続的なロード |

| データ整合性 | 移行前後のデータが一致することの検証 | COPY INTOの検証オプション、外部ツール連携 | BigQuery Data Transfer Serviceのログ、外部ツール連携 |

| セキュリティ | 転送中のデータ暗号化、アクセス制御 | TLS暗号化、Storage Integration、Network Policies | TLS暗号化、Cloud Storage、VPC Service Controls |

| データ量と速度 | 大規模データ移行の効率性 | Snowpipe、SnowCDP、クラウドストレージ連携 | BigQuery Data Transfer Service、gsutil、Transfer Appliance |

例えば、某製造業A社では、オンプレミスの基幹システムからSnowflakeへのデータ移行において、まず初期のフルロードを週末に実施し、その後はSnowpipeとストアドプロシージャを組み合わせた段階的な差分ロードを導入しました。移行期間中は、旧システムと新システムで並行稼働させ、厳密なデータ検証プロセス(データ件数、合計値、キー項目の一致確認など)を毎日実施。これにより、業務への影響を最小限に抑えつつ、移行期間中のデータ整合性を確保し、スムーズなDWH立ち上げを実現できました。

運用・保守のポイントと監視体制

データウェアハウスは導入して終わりではありません。長期的な運用・保守こそが、その投資対効果を最大化するために不可欠です。特にクラウドベースのDWHは従量課金モデルであるため、コスト管理とパフォーマンス監視が重要な運用ポイントとなります。

監視すべき主要な項目は以下の通りです。

- クエリ性能: 実行時間、リソース消費量、失敗したクエリ

- ストレージ使用量: データ量の推移、不要なデータの削除

- データロード状況: ロードの成功/失敗、遅延、データ品質異常

- コスト: ウェアハウスの利用時間、ストレージ費用、データ転送費用

- セキュリティ: 不正アクセス試行、権限変更ログ

Snowflakeでは、Resource Monitorによるウェアハウスの利用状況監視と自動停止設定、Query Profileによるクエリ分析、Usage Dashboardによる全体的な利用状況把握が可能です。BigQueryでは、Cloud MonitoringとCloud Loggingを活用してクエリ実行状況やAPI利用状況を詳細に監視でき、BigQuery Audit Logsでセキュリティ関連のイベントを追跡できます。

コスト最適化も継続的な取り組みが必要です。Snowflakeでは、ウェアハウスのサイズ調整、オートサスペンド機能、クラスタリングキーの最適化が有効です。BigQueryでは、パーティショニングとクラスタリングによるスキャンデータ量の削減、テーブルの有効期限設定、そして料金アラートの設定が予算超過を防ぐ上で役立ちます。私たちの経験では、特に導入初期段階でこれらのコスト監視と最適化のルールを確立することが、予期せぬ予算超過を防ぐ上で極めて重要です。

既存システム(kintoneなど)との連携とデータパイプライン構築

データウェアハウスは、孤立したシステムとしてではなく、貴社の既存ITエコシステムの一部として機能させることで真価を発揮します。特にkintoneのようなローコードプラットフォームで管理されている業務データは、DWHに統合することで、他の基幹データとの横断的な分析を可能にし、より深いインサイトを生み出します。

kintoneとの連携方法としては、主に以下の選択肢があります。

- kintone APIの利用: kintoneが提供するREST APIを使って、プログラムでデータを抽出し、DWHへロードする。

- 外部連携サービスの活用: ZapierやMake(旧Integromat)のようなiPaaS(Integration Platform as a Service)や、Fivetran、AirbyteなどのETLツールを利用して、kintoneとDWH間のデータ連携を自動化する。

- クラウドプラットフォームのサービス利用: Google Cloud FunctionsやAWS Lambdaのようなサーバーレス機能を使って、特定のイベントをトリガーにデータを連携する。

データパイプラインの構築においては、バッチ処理とストリーミング処理のどちらが適切かを検討します。kintoneのような業務システムからのデータは、日次や時間ごとのバッチ処理で十分な場合が多いでしょう。パイプラインのオーケストレーションには、Apache Airflow、Prefect、Dagsterなどのワークフロー管理ツールが利用され、堅牢性、スケーラビリティ、そして監視可能性を確保します。

私たちがあるサービス業B社を支援したケースでは、kintoneで管理されている顧客対応履歴と、基幹システムの売上データをSnowflake上で統合しました。この統合により、顧客セグメンテーションの精度が大幅に向上し、パーソナライズされたマーケティング施策を展開できるようになりました。このプロジェクトでは、Fivetranを利用してkintoneデータを自動的にSnowflakeに同期するデータパイプラインを構築し、データ連携の自動化と省力化を実現しました。

既存システムとの連携では、データガバナンスとセキュリティも忘れてはなりません。アクセス制御、データマスキング、適切な暗号化を施すことで、機密性の高いデータを安全に扱う体制を構築することが重要です。

【ユースケース別】SnowflakeとBigQueryの選び方:具体的な判断基準

データウェアハウスの選定は、貴社のビジネス目標と技術要件に深く根ざした決断です。SnowflakeとBigQueryはどちらも強力なツールですが、貴社がどのような課題を解決したいか、どのようなデータを活用したいかによって、最適な選択肢は変わってきます。ここでは、主要なユースケースごとに、両者の具体的な判断基準を比較検討していきましょう。

大規模データ分析・リアルタイム分析要件

膨大なデータを高速に分析し、時にリアルタイムに近い処理が求められる場合、両者ともに高いパフォーマンスを発揮しますが、得意とする領域が異なります。

-

BigQueryが優位なケース:

Googleのグローバルインフラを基盤とするBigQueryは、ペタバイト級の超大規模データセットに対するクエリ性能に強みがあります。特に、WebサイトのアクセスログやIoTデバイスからのストリーミングデータなど、リアルタイムに近いデータ取り込みと分析が常時必要とされる場合、その真価を発揮します。ストリーミングインサート機能は非常に強力で、数秒から数分遅延でデータを分析基盤に取り込めるため、株価のリアルタイム変動分析、オンラインゲームのユーザー行動分析、ECサイトの在庫状況モニタリング、そして金融取引における不正検知システムなどでの活用が進んでいます。

参考として、IDCの調査によれば、データ量の増加に伴いリアルタイム分析の需要が高まっていると指摘されています(出典:IDC Worldwide Big Data and Analytics Spending Guide)。

-

Snowflakeが優位なケース:

Snowflakeの「仮想ウェアハウス」は、ワークロードの分離において非常に強力です。異なる部門やアプリケーションが同時にDWHにアクセスし、それぞれ異なる種類のクエリ(例:大規模なバッチ処理とアドホックな分析)を実行する場合でも、リソースの競合を最小限に抑え、安定したパフォーマンスを提供できます。これにより、リアルタイム性が求められる分析と、バックグラウンドでの重いデータ処理を両立させたい場合に、Snowflakeのアーキテクチャは大きなメリットをもたらします。金融機関のトランザクション分析や、複数の事業部がそれぞれ独自の分析を行うような環境で特に効果的です。

マーケティングデータ分析と顧客理解の深化

マーケティング活動の高度化には、顧客データの統合と分析が不可欠です。

-

BigQueryが優位なケース:

Googleエコシステムとのネイティブ連携は、BigQueryの最大の強みの一つです。Googleアナリティクス4(GA4)、Google広告、Firebaseなどのデータは、追加のETLツールをほとんど介さずにBigQueryに直接エクスポートできます。これにより、顧客のWeb行動、アプリ利用状況、広告接触履歴といったファーストパーティデータを統合し、顧客理解を深めるための強力な基盤を迅速に構築できます。BigQuery MLを活用すれば、LTV予測や顧客セグメンテーションの自動化も比較的容易に実現できます。

私たちが支援した某EC企業では、GA4データをBigQueryに集約し、購買履歴と連携することで、顧客の離反予測モデルを構築しました。このモデルに基づき、離反リスクの高い顧客に対しては、パーソナライズされた割引クーポンを自動配信するプロモーション施策を展開。結果として、リピート率が15%向上し、顧客LTVの最大化に貢献しました。

-

Snowflakeが優位なケース:

Snowflakeは、Googleエコシステム以外の多種多様なSaaSデータ(CRM、MA、CDP、広告プラットフォームなど)との連携において、その柔軟性を発揮します。特に、Data Marketplaceを通じてサードパーティのデータプロバイダーから外部データをセキュアに連携・活用できる点は、より広範な顧客理解を目指す企業にとって魅力的です。複雑なデータ形式(JSON、XMLなど)にも対応しているため、複数のシステムから出力される半構造化データをそのまま取り込み、統合分析基盤として活用できます。

業務データ統合と効率化(会計DXなど)

社内の基幹業務システムから発生するデータを統合し、業務効率化やDX推進に繋げるケースです。

-

Snowflakeが優位なケース:

ERP、CRM、会計システムなど、異なるベンダーの基幹業務システムから出力されるデータは、構造も形式も多岐にわたります。Snowflakeは、半構造化データ(JSON, XML, Avroなど)をネイティブにサポートしており、ETLプロセスの複雑さを軽減しながら、これらの多様なデータを統合できます。また、強力なセキュリティ機能(ロールベースアクセス制御、データマスキングによる個人情報の匿名化、トークン化による機密データの保護)と詳細な監査ログは、機密性の高い業務データを扱う上で非常に重要です。例えば、特定の部署のユーザーには給与データの一部をマスキングして表示し、人事部門の管理者のみが完全なデータにアクセスできるようにするといった厳格な制御が可能です。データガバナンスを厳格に適用し、複数の部署が利用する統一されたデータ基盤を構築したい場合に適しています。

-

BigQueryが優位なケース:

既存のSQLスキルセットを持つ業務システム担当者が多い場合、BigQueryのSQLベースのインターフェースは学習コストを抑えられます。また、Google Cloudの他のサービス(Dataflow, Cloud Functionsなど)と連携することで、業務プロセスの自動化やデータ変換パイプラインの構築がスムーズに行えます。会計データの統合であれば、Looker Studio(旧Google データポータル)との連携により、月次決算レポートや予実管理ダッシュボードを迅速に作成し、業務の可視化と効率化を図ることが可能です。

BIツール連携を前提としたDWH構築

データウェアハウスで統合・加工されたデータは、BIツールを通じて可視化され、ビジネス上の意思決定に活用されます。両者ともに主要なBIツールとの連携は可能ですが、特徴があります。

-

両者の連携性:

SnowflakeとBigQueryは、Tableau、Power BI、Looker、Qlik Senseといった主要なBIツールと高い親和性を持っています。どちらのDWHもODBC/JDBCドライバーやネイティブコネクタを提供しており、データソースとして容易に接続できます。

-

BigQueryの強み:

Google CloudのサービスであるLooker Studio(旧Google データポータル)やLookerとの連携は特にシームレスで、Google Workspaceとの統合も強みです。もし貴社が既にこれらのGoogle製ツールを積極的に活用している、または今後活用を考えているのであれば、BigQueryを選ぶことで連携における障壁を最小限に抑えられます。

-

Snowflakeの強み:

Snowflakeの仮想ウェアハウスによるワークロード分離は、BIツールからの大量かつ多様なクエリが、他のデータ処理や分析に与える影響を最小限に抑える上で大きなメリットとなります。多数のユーザーが同時にBIツールを利用し、それぞれ異なるレポートやダッシュボードを参照する場合でも、安定したクWH性能を維持しやすいです。また、幅広いBIツールとの連携実績があり、特定のベンダーに依存しない柔軟な選択が可能です。

以下に、BIツール連携に関する一般的な比較を示します。

| 項目 | Snowflake | BigQuery |

|---|---|---|

| ネイティブ連携が強いBIツール | Tableau, Power BI, Qlik Senseなど広範 | Looker, Looker Studio (旧Google データポータル) |

| ワークロード分離 | 仮想ウェアハウスにより、BIツールからのクエリが他の処理に影響しにくい | 共有リソースモデル。必要に応じて予約スロットによる分離も可能だが、Snowflakeほど柔軟ではない |

| データ更新頻度 | リアルタイムに近いデータ共有・連携が可能 | ストリーミングインサートにより、リアルタイムに近いデータ反映が可能 |

| 学習曲線(BIツール利用者視点) | SQLベースで一般的なBIツール利用者は慣れやすい | SQLベースで一般的なBIツール利用者は慣れやすい |

特定のクラウドベンダーへの依存度とマルチクラウド戦略

将来的なビジネスの変化や技術戦略を見据え、特定のクラウドベンダーへの依存度をどう考えるか、マルチクラウド戦略の有無も重要な判断基準です。

-

Snowflakeが優位なケース:

Snowflakeは、AWS、Azure、Google Cloudといった主要なクラウドプラットフォーム上でサービスを提供しているため、特定のクラウドベンダーへの依存(ベンダーロックイン)を避けたい企業にとって理想的です。貴社が既に複数のクラウドを利用している、または将来的にクラウド環境を柔軟に切り替える可能性がある場合、SnowflakeはDWH層でマルチクラウド戦略を容易に実現できます。データレプリケーション機能も充実しており、異なるクラウド間でのデータ共有や災害対策にも活用できます。

例えば、某グローバル企業では、地域ごとに異なるクラウドプロバイダーを利用しているため、SnowflakeをDWHとして導入することで、全社的なデータ統合と分析を実現しました。

-

BigQueryが優位なケース:

BigQueryはGoogle Cloud Platform (GCP) のフルマネージドサービスであるため、既にGCPを主要なクラウドベンダーとして利用している企業にとっては、エコシステム内での連携が非常に強力です。GCPの他のサービス(Cloud Storage, Dataflow, Vertex AIなど)との統合はシームレスで、一貫した運用管理が可能です。GCPのセキュリティモデルやIAM(Identity and Access Management)もそのまま適用できるため、管理の簡素化に繋がります。GCPを主軸とした「クラウドネイティブ」なデータ基盤を構築したい場合に最適な選択肢と言えるでしょう。

データウェアハウス構築後のデータ活用戦略:BIツール連携とDX推進

データウェアハウス(DWH)の構築は、貴社がデータを戦略的な資産として活用するための第一歩に過ぎません。SnowflakeやBigQueryといった強力な基盤を導入したからには、その上にどのようにデータ活用戦略を築き、ビジネス価値を最大化するかが重要になります。ここでは、DWH構築後の具体的なデータ活用フェーズと、それが貴社のDX推進にどう貢献するのかを掘り下げていきます。

BIツール(Tableau, Looker, Power BIなど)とのシームレスな連携

データウェアハウスに蓄積された膨大なデータを、ビジネスユーザーが直感的に分析・可視化するためには、BIツールとの連携が不可欠です。BIツールは、DWHからデータを抽出し、グラフやダッシュボードとして表現することで、複雑なデータも一目で理解できるように変換してくれます。これにより、専門的なデータ分析スキルがない担当者でも、必要な情報を素早く手に入れ、業務に活かせるようになります。

主要なBIツールであるTableau、Looker、Power BIは、いずれもSnowflakeやBigQueryとの連携機能が非常に充実しています。ODBC/JDBCドライバー、専用コネクタ、REST APIなど、さまざまな方法でシームレスに接続でき、リアルタイムに近いデータ分析環境を構築できます。どのツールを選ぶかは、貴社の予算、既存システムとの親和性、ユーザーのスキルレベル、そして求める機能によって異なります。

例えば、Tableauは高度なビジュアル分析とインタラクティブなダッシュボード作成に強みがあり、データ探索を重視する企業に適しています。Lookerは、LookMLという独自のモデリング言語を用いてデータ定義を一元化し、ガバナンスを効かせたデータ活用を実現したい場合に有効です。Power BIはMicrosoft製品との連携が強く、Excelユーザーには馴染みやすいインターフェースが魅力です。

以下に、主要BIツールのデータウェアハウス連携における一般的な比較を示します。

| BIツール | 主な特徴 | Snowflake/BigQuery連携 | 得意な利用シーン |

|---|---|---|---|

| Tableau | 直感的な操作性、高度なビジュアル分析、豊富なグラフ種類 | 専用コネクタ、ODBC/JDBC | データ探索、インタラクティブなダッシュボード、アドホック分析 |

| Looker | LookMLによるデータモデル一元化、データガバナンス、埋め込み分析 | 専用コネクタ | データ定義の標準化、埋め込み型BI、セルフサービスBIの統制 |

| Power BI | Microsoft製品との連携、Excelライクな操作性、低コスト | 専用コネクタ、DirectQuery | Microsoftエコシステム内での活用、定型レポート、予算を抑えた導入 |

これらのツールをDWHと連携させることで、貴社はデータの「見える化」を実現し、次のステップへと進む準備が整います。

データドリブン経営への移行と意思決定の迅速化

BIツールを通じてデータが可視化されると、経営層から現場の担当者まで、誰もがデータに基づいて意思決定を行える「データドリブン経営」への移行が加速します。これまでは個人の経験や勘に頼りがちだった経営判断が、客観的なデータに裏打ちされることで、より正確で迅速なものへと変わっていきます。

例えば、売上データや顧客行動データをリアルタイムでモニタリングできるダッシュボードがあれば、市場の変化や顧客ニーズの動向を即座に把握し、戦略の調整や新たな施策の立案を迅速に行えます。ある製造業A社では、DWHとBIツールの連携により、生産ラインの稼働状況や品質データをリアルタイムで可視化しました。これにより、異常発生時の原因特定と対策決定までの時間を50%以上短縮し、生産ロス削減に貢献したと報告されています。さらに、経営層は日次で主要KPIダッシュボードを確認し、市場の需要変動に合わせた生産計画の調整を迅速に行うことで、機会損失の最小化と在庫最適化を実現しています(出典:業界レポート「スマートファクトリー導入事例集」)。

データドリブン経営は、単に「データを参照する」だけでなく、「データから洞察を得て行動する」というサイクルを組織全体に根付かせることです。私たちも、DWH構築後の運用フェーズで、BIレポートの作成支援や、データリテラシー向上のための社内トレーニングを提供することで、このサイクル定着をサポートしています。

マーケティング施策への応用と顧客エンゲージメント向上(LINE連携など)

データウェアハウスは、マーケティング活動において強力な武器となります。顧客の購買履歴、ウェブサイトの閲覧履歴、問い合わせ履歴、SNSでの反応など、あらゆる顧客データをDWHに集約することで、顧客一人ひとりのプロファイルを深く理解できるようになります。

この統合された顧客データに基づいて、より精度の高い顧客セグメンテーションが可能になります。例えば、特定の製品を過去に購入した顧客、ウェブサイトで特定の商品ページを何度も閲覧しているが購入に至っていない顧客、休眠顧客など、様々な切り口で顧客を分類し、それぞれに最適化されたパーソナライズされたマーケティング施策を展開できます。

さらに、DWHのデータをLINEやメール配信システム、CRM/MAツールと連携させることで、顧客エンゲージメントを飛躍的に向上させることができます。例えば、顧客の誕生日に合わせてパーソナライズされたクーポンをLINEで自動配信したり、過去の購買履歴に基づいておすすめ商品をメールで提案したりすることが可能になります。BtoC企業におけるLINE公式アカウントの活用は特に顕著で、DWHから抽出したセグメント情報をもとに、個別のメッセージ配信を行うことで、開封率やクリック率、ひいては購買率の向上に繋がる事例が多数報告されています(出典:LINE for Business「成功事例集」)。

データに基づいた顧客理解は、単なる売上向上だけでなく、顧客ロイヤルティの構築にも寄与し、長期的なビジネス成長の基盤となります。

業務効率化・自動化への貢献と新たな価値創造(kintone連携など)

データウェアハウスの活用は、マーケティングや経営判断だけでなく、日々の業務効率化や自動化にも大きく貢献します。DWHに蓄積されたデータを活用することで、これまで手作業で行っていたレポート作成やデータ入力、特定の業務プロセスの自動化が可能になります。

例えば、営業部門であれば、DWHから抽出した顧客の購買傾向データや行動履歴をCRMシステム(例:Salesforce)や業務アプリ(例:kintone)と連携させることで、見込み客の優先順位付けや、次に提案すべき商材のレコメンドを自動化できます。これにより、営業担当者はデータ収集や分析に費やす時間を削減し、顧客との対話や商談といった、より付加価値の高い業務に集中できるようになります。

また、kintoneのようなローコード開発プラットフォームとDWHを連携させることで、社内の様々な業務アプリにDWHのデータを組み込み、データに基づいた意思決定や自動処理を容易に実現できます。例えば、DWHの在庫データと販売予測データをkintoneアプリに連携させ、自動的に発注アラートを出すシステムを構築したり、人事データとプロジェクト進捗データを連携させて、最適な人員配置をシミュレーションしたりといったことが考えられます。

このように、DWHは単なる分析基盤に留まらず、RPA(Robotic Process Automation)やiPaaS(integration Platform as a Service)といったツールと組み合わせることで、業務プロセス全体のデジタル変革(DX)を加速させ、新たな価値創造の機会を生み出す可能性を秘めています。

データガバナンスとデータ品質管理の重要性

データウェアハウスを構築し、データ活用を進める上で、決して忘れてはならないのが「データガバナンス」と「データ品質管理」です。どんなに優れたDWHやBIツールを導入しても、その中にあるデータが不正確であったり、信頼性に欠けていたりすれば、誤った意思決定を招き、ビジネスに大きな損害を与えかねません。

データガバナンスとは、データの戦略的価値を最大化し、リスクを最小化するために、組織全体でデータを管理・利用するためのポリシー、プロセス、組織体制を確立することです。具体的には、データの定義の標準化、アクセス権限の管理、セキュリティポリシーの策定、プライバシー規制(GDPR、CCPAなど)への対応などが含まれます。

一方、データ品質管理は、DWHに取り込まれるデータの正確性、完全性、一貫性、適時性を確保するための活動です。データクレンジング(重複データの削除、表記ゆれの統一)、マスタデータ管理、メタデータ管理(データの意味や出所を明確にする)などがこれにあたります。ある調査によれば、データ品質の問題により、企業は売上の15%を失う可能性があると指摘されています(出典:Gartner「The Business Value of Data Quality」)。

私たちも、DWH構築プロジェクトにおいて、データのライフサイクル全体を見据えたデータガバナンス体制の設計支援や、データ品質を維持・向上させるための継続的な運用プロセス構築を重視しています。具体的には、データ入力時のバリデーションルールの設定、定期的なデータプロファイリングによる異常値の検出、そしてデータカタログツールの導入によるメタデータの一元管理などを通じて、貴社のデータ資産を安全かつ効果的に活用するための基盤作りをサポートします。

Aurant Technologiesが提供するデータウェアハウス構築・活用支援

【自社事例・独自見解】Aurant Technologiesのコンサルティングアプローチ

データウェアハウスの構築は、単に技術的なインフラを導入するだけではありません。私たちは、貴社のビジネス戦略とデータ戦略を深く連携させ、真に価値を生み出すデータ基盤を構築することを目指しています。私たちのコンサルティングアプローチは、まず貴社の現状と具体的なビジネス課題を徹底的にヒアリングすることから始まります。

「なぜデータウェアハウスが必要なのか?」「どのようなデータを、誰が、どのように活用したいのか?」といった根本的な問いを共に掘り下げます。その上で、SnowflakeとBigQueryのどちらが貴社の要件、予算、既存システム環境に最適なのかを中立的な立場で評価し、具体的な選定支援を行います。特定の技術スタックに偏ることなく、貴社にとっての最適なパスを提示するのが私たちの強みです。

また、構築フェーズだけでなく、データガバナンス、セキュリティ、運用効率、そして将来的な拡張性まで見据えた設計を重視します。データがただ集まるだけでなく、安全に、効率的に、そして持続的に活用される仕組みを構築することで、貴社のDX推進を強力にサポートします。

【自社事例・独自見解】選定から導入、運用、活用まで一貫サポート

データウェアハウスプロジェクトは、選定から導入、そしてその後の運用と活用まで、多岐にわたるフェーズが存在します。私たちは、これらの全フェーズにおいて一貫したサポートを提供することで、貴社の負担を軽減し、成功への確実な道筋を立てます。プロジェクトの各段階で、貴社のチームと密接に連携し、知識移転にも注力することで、将来的な内製化も支援します。

具体的な支援内容は以下の通りです。

| フェーズ | 主な支援内容 | Aurant Technologiesの強み |

|---|---|---|

| 1. 選定・計画 | 現状分析、ビジネス要件定義、データ戦略策定、Snowflake/BigQuery比較検討、費用対効果分析、RFP作成支援 | 特定のベンダーに依存しない中立的な視点と豊富な導入実績に基づく知見 |

| 2. 設計・構築 | アーキテクチャ設計、データモデリング、データ連携(ETL/ELTパイプライン)構築、セキュリティ・アクセス管理設定、データ移行 | 高可用性・スケーラビリティを考慮した設計力、効率的なデータ統合技術 |

| 3. 運用・最適化 | 監視体制構築、コスト最適化(リソース管理)、パフォーマンスチューニング、データガバナンス体制構築支援、障害対応支援 | 継続的な改善提案、運用負荷の軽減と安定稼働の実現 |

| 4. 活用・拡張 | BIツール連携、データ分析支援、機械学習(ML)基盤連携、データリテラシー向上トレーニング、新たなデータソース連携 | ビジネス成果に直結するデータ活用戦略の立案、内製化に向けた伴走支援 |

このように、私たちはプロジェクトの立ち上げから、データが貴社のビジネスに貢献するまで、長期的な視点でお客様をサポートいたします。

【自社事例・独自見解】データ活用を加速させるソリューション連携(BI, kintone, LINE, 会計DXなど)

データウェアハウスの真価は、他のシステムとの連携によって最大限に引き出されます。私たちは、単にDWHを構築するだけでなく、貴社の既存システムや新たなソリューションとの連携を通じて、データ活用を加速させるための総合的な支援を提供しています。

- BIツール連携: Tableau、Power BI、LookerなどのBIツールと連携し、DWHに蓄積されたデータを分かりやすく可視化。経営層から現場まで、誰もがデータに基づいた迅速な意思決定を行えるよう支援します。

- kintone連携: 営業活動や顧客管理など、kintoneで管理されている業務データをDWHに統合。他のデータソースと組み合わせることで、より多角的な分析を可能にし、業務改善や戦略立案に貢献します。

- LINE連携: 顧客のLINEアカウントから得られるデータをDWHに蓄積・分析。パーソナライズされたメッセージ配信や、顧客行動に基づいた効果的なマーケティング施策の実現をサポートします。

- 会計DX連携: 会計システムやERPからDWHへ財務データを統合し、高度な分析基盤を構築。経営状況のリアルタイム把握、予実管理の精度向上、将来予測といった経営判断に資する洞察を提供します。

これらの連携を通じて、私たちは貴社のデータが「単なる情報」ではなく、「具体的なアクションと成果を生み出す資産」となるよう尽力します。貴社が抱える特定のビジネス課題に対し、どのようなソリューション連携が最適かを共に検討し、実装までをサポートいたします。

【自社事例・独自見解】貴社のビジネス課題を解決する無料相談・お問い合わせ

「データウェアハウスの導入を検討しているが、何から手をつければ良いか分からない」「SnowflakeとBigQuery、どちらを選ぶべきか悩んでいる」「既存のデータ活用がうまくいっていない」

もし貴社がこのような課題をお持ちであれば、ぜひ一度私たちにご相談ください。Aurant Technologiesでは、データウェアハウス構築・活用に関する無料相談を承っております。貴社の現状をヒアリングし、具体的な課題解決に向けたアプローチや、最適なソリューションについて専門家がアドバイスいたします。

データ活用は、現代ビジネスにおいて競争優位性を確立するための不可欠な要素です。私たち専門家が、貴社のビジネス成長をデータで後押しできるよう、全力でサポートさせていただきます。お気軽にお問い合わせください。