BigQueryでマーケ/EC/会計データを統合する「勘所」:設計から運用、ビジネス価値創出まで

BigQueryでマーケ/EC/会計データを統合し、経営とマーケティングを加速。テーブル設計、運用、コスト最適化、セキュリティ、ビジネス価値創出の「勘所」を詳解。

目次 クリックで開く

BigQueryでマーケ/EC/会計データを統合する「勘所」:設計から運用、ビジネス価値創出まで

BigQueryでマーケ/EC/会計データを統合し、経営とマーケティングを加速。テーブル設計、運用、コスト最適化、セキュリティ、ビジネス価値創出の「勘所」を詳解。

BigQueryでマーケ/EC/会計データを統合する意義:なぜ今、データ統合が必要なのか

現代のビジネス環境において、データは「新たな石油」と称されるほど重要な資産です。しかし、多くの企業では、この貴重なデータが部門ごとに散在し、その真価を発揮できていない現状があります。特にマーケティング、EC、会計といったビジネスの中核を担うデータがそれぞれ独立して管理されている「データサイロ化」は、ビジネスの成長を阻害し、大きな機会損失を生み出しています。

データサイロ化がもたらすビジネス課題と機会損失

貴社では、マーケティング部門が広告効果を分析する際、EC部門の売上データや会計部門の利益率データにスムーズにアクセスできず、部分的な情報で意思決定を行っていることはありませんか?あるいは、ECサイトの顧客行動データと、会計システム上の顧客のLTV(顧客生涯価値)が紐づいておらず、最適な顧客戦略を打ち出せずにいる、といった課題はないでしょうか。

このようなデータサイロ化は、以下のような具体的なビジネス課題と機会損失を貴社にもたらします。

| 課題領域 | 具体的な問題点 | 機会損失の例 |

|---|---|---|

| マーケティング | 広告費と実際の売上・利益貢献の関連性が不明瞭。顧客の購買履歴や収益性に基づいたセグメンテーションが困難。 | ROIの低い施策への無駄な投資。優良顧客へのアプローチ不足によるLTVの最大化機会喪失。 |

| EC(Eコマース) | サイト内行動データと、会計上の製品原価や利益率が連携せず、真に収益性の高い商品の特定が困難。顧客ごとの購買サイクルや離反リスクの予測が不正確。 | 価格戦略の誤りによる利益率低下。在庫最適化の失敗による販売機会損失や過剰在庫。 |

| 会計・財務 | 売上や費用データが、マーケティング施策やECサイトの特定イベントと紐付かないため、事業活動ごとの費用対効果が測りにくい。 | 予算配分の最適化ができない。投資判断の遅延や誤り。 |

| 全体的な意思決定 | 部門間でデータの定義や集計方法が異なり、共通認識に基づいた議論ができない。経営層がリアルタイムでビジネス全体を俯瞰できない。 | 意思決定の遅延。部門間の対立。市場変化への対応の遅れによる競争力低下。 |

このような状況では、データに基づいた迅速かつ正確な意思決定は難しく、結果としてビジネスの成長機会を逃してしまうことになります。

BigQueryが解決するデータ活用の壁とDX推進

これらのデータサイロ化がもたらす課題を解決し、貴社のDX(デジタルトランスフォーメーション)を加速させる強力なツールが、Google Cloud Platform (GCP) が提供するフルマネージドなデータウェアハウス「BigQuery」です。

従来のデータ統合は、複雑なETL(Extract, Transform, Load)処理、高額なインフラ投資、専門知識を持つ人材の確保といった多くの障壁を伴いました。しかし、BigQueryはこれらのデータ活用の壁を根本から取り除きます。

- スケーラビリティとパフォーマンス: BigQueryはペタバイト規模のデータを処理できる能力を持ちながら、非常に高速なクエリ実行を実現します。データ量が増加してもパフォーマンスが低下することなく、貴社のビジネス成長に合わせて柔軟に拡張できます。

- フルマネージドサービス: インフラの構築、メンテナンス、パッチ適用といった運用管理はGoogleが全て行います。貴社はデータ分析に集中でき、IT運用コストとリソースを大幅に削減可能です。

- コスト効率: データのストレージコストは低く、クエリ料金は処理したデータ量に応じて発生するため、使った分だけ支払う従量課金制です。これにより、初期投資を抑えつつ、効率的なデータ活用が可能です。

- SQLベースの使いやすさ: 多くのデータアナリストやエンジニアが慣れ親しんでいる標準SQLでデータを操作できるため、学習コストが低く、迅速に導入・活用を開始できます。

BigQueryは、単にデータを集約するだけでなく、そのデータを活用してビジネス課題を解決し、新たな価値を創造するための強力な基盤となります。これにより、データドリブンな意思決定が促進され、貴社のDX推進に不可欠な要素となるでしょう。

統合データがもたらす意思決定の迅速化と競争優位性

BigQueryによってマーケティング、EC、会計データが統合されると、貴社は「単一の真実の源泉(Single Source of Truth)」を持つことができます。これにより、以下のような具体的なメリットが生まれます。

- 顧客理解の深化とパーソナライゼーション: 顧客のサイト行動、購買履歴、問い合わせ履歴、さらには会計上のLTVまでを一元的に分析することで、顧客のニーズを深く理解し、より精度の高いパーソナライズされたマーケティング施策や商品レコメンデーションが可能になります。

- マーケティングROIの最大化: 広告費用とEC売上、さらには商品ごとの利益率をリアルタイムで紐付けて分析することで、費用対効果の低い広告を特定し、予算を最適配分することが可能になります。これにより、マーケティング投資のROIを大幅に向上させることができます。

- 商品開発と在庫最適化の精度向上: ECサイトの需要予測データと会計上の原価・利益データを組み合わせることで、市場のトレンドを捉えつつ、収益性の高い新商品を開発できます。また、正確な需要予測に基づいた在庫管理により、過剰在庫のリスクを低減し、販売機会損失を防ぐことができます。

- 経営意思決定の迅速化: 経営層は、各部門のデータを統合したダッシュボードを通じて、ビジネス全体のパフォーマンスをリアルタイムで把握できます。これにより、市場の変化や競合の動向に対し、迅速かつ的確な意思決定を下し、競争優位性を確立することが可能になります。

データ統合は、単なる情報の集約に留まらず、貴社のビジネスモデルそのものを変革し、持続的な成長を可能にするための戦略的な投資なのです。

BigQueryの基本概要とGCPにおける位置づけ

BigQueryは、Google Cloud Platform (GCP) が提供する主要な分析サービスの一つです。GCPは、Googleが自社のサービス(Google検索、YouTubeなど)で培ったインフラ技術とノウハウを一般企業向けに提供するクラウドコンピューティングプラットフォームであり、BigQueryはその中でも特に大規模データ分析に特化したサービスとして位置づけられています。

BigQueryは、データウェアハウスとしての機能に加え、データレイク(Cloud Storageなど)からのデータ取り込み、機械学習(BigQuery ML)による予測分析、データ可視化ツール(Looker Studio、Looker)との連携など、データ活用に必要な一連のプロセスをシームレスにサポートします。これにより、貴社はデータ収集から分析、洞察の抽出、そしてアクション実行までを一貫してGCP上で完結させることができ、真のデータドリブン経営を実現するための強固な基盤を構築できます。

統合対象となるマーケティング/EC/会計データの種類と特徴

BigQueryを活用したデータ統合を進める上で、貴社がどのようなデータを統合したいのか、そのデータの種類と特性を深く理解することが成功の鍵となります。マーケティング、EC、会計といった異なる領域のデータは、それぞれ異なる性質を持ち、BigQueryへの取り込み方やその後の活用方法も異なります。ここでは、主要なデータカテゴリと、それぞれの特性、そしてBigQueryへの取り込みにおける考慮点について解説します。

マーケティングデータ(GA4、広告プラットフォーム、CRM、MAなど)

マーケティングデータは、顧客の行動、興味関心、購買意欲を把握し、効果的な施策立案に不可欠な情報源です。貴社が日々行っているマーケティング活動の成果を可視化し、次の打ち手を考える上で中心的な役割を担います。

- Webサイト/アプリ行動データ(Google Analytics 4など): ユーザーがWebサイトやアプリでどのようなページを閲覧し、どの機能を利用し、最終的にコンバージョンに至ったかといった行動履歴を詳細に記録します。GA4の場合、イベントベースのデータモデルにより、ユーザーのカスタマージャーニーをより包括的に捉えることができます。

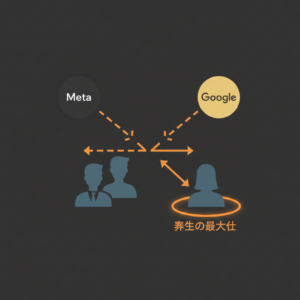

- 広告プラットフォームデータ(Google広告、Yahoo!広告、Facebook/Instagram広告など): 広告の表示回数(インプレッション)、クリック数、費用、コンバージョン数など、広告キャンペーンのパフォーマンスに関するデータです。プラットフォームごとに異なるAPIを通じて収集されます。

- CRMデータ(Salesforce、HubSpotなど): 顧客の氏名、連絡先、企業情報、リードステージ、商談履歴、顧客サポート履歴など、顧客との関係性に関する包括的な情報が含まれます。顧客のライフタイムバリュー(LTV)を算出する上で重要なデータです。

- MAデータ(Pardot、Marketoなど): メール開封率、クリック率、フォーム入力、ウェビナー参加履歴など、マーケティングオートメーションツールを通じて得られるリードの行動データです。リードスコアリングやナーチャリング施策の評価に活用されます。

これらのデータは、一般的にデータ量が膨大で、リアルタイムに近い更新頻度が求められることがあります。スキーマ構造は、Web行動データのように柔軟なイベントベースのものから、CRMのように比較的固定されたものまで多岐にわたります。BigQueryでは、GA4のネイティブ連携(BigQuery Export)をはじめ、広告プラットフォームのAPI連携、CRM/MAツールのデータエクスポート機能などを活用して取り込むことが一般的です。

ECデータ(受注、商品、顧客、在庫、配送など)

ECデータは、貴社のオンラインビジネスの核心をなす情報であり、売上、顧客満足度、サプライチェーンの効率性を直接的に反映します。これらのデータを統合することで、より深いビジネスインサイトを得られます。

- 受注データ: 注文ID、注文日時、商品ID、数量、単価、合計金額、顧客ID、配送先情報、決済方法など、個々の注文に関する詳細なトランザクションデータです。

- 商品データ: 商品ID、SKU、商品名、カテゴリ、ブランド、価格、商品説明、画像URLなど、商品のマスタ情報です。

- 顧客データ: 顧客ID、氏名、住所、連絡先、登録日時、購買履歴のサマリーなど、ECサイトに登録された顧客の属性情報と行動履歴の一部です。

- 在庫データ: 商品IDごとの現在の在庫数、入庫・出庫履歴、在庫ロケーションなど、商品の供給状況に関するデータです。

- 配送データ: 配送業者、追跡番号、配送ステータス(出荷済み、配送中、配達完了など)、配送予定日など、注文商品の物流に関するデータです。

ECデータは、トランザクションデータとマスタデータの両方を含み、データの整合性と鮮度が特に重要です。例えば、在庫データはリアルタイムに近い更新が求められることもあります。BigQueryへの取り込みには、ShopifyやEC-CUBEなどのECプラットフォームが提供するAPI、または直接データベースからのレプリケーション、定期的なCSV/JSONエクスポートとCloud Storage経由での取り込みなどが用いられます。

会計データ(仕訳、勘定科目、請求、決済など)

会計データは、貴社の財務状況を正確に把握し、経営戦略を立案するための基盤となる情報です。高い信頼性と正確性が求められ、法規制への準拠も不可欠です。

- 仕訳データ: 日付、勘定科目、借方金額、貸方金額、摘要、証憑番号など、すべての取引を記録したデータです。

- 勘定科目マスタ: 勘定科目コード、勘定科目名、分類(資産、負債、純資産、収益、費用)など、会計処理の基本となる情報です。

- 請求データ: 請求書番号、請求先、請求日、支払期日、請求金額、入金状況など、売掛金や買掛金に関するデータです。

- 決済データ: 決済サービスからの入金情報、決済手数料、決済日など、実際の資金移動に関するデータです。

会計データは、厳密な整合性と時系列の正確性が求められるため、データの品質管理が極めて重要です。また、監査証跡として利用されるため、データの変更履歴も管理すべきです。BigQueryへの取り込みは、freeeや弥生会計などの会計システムが提供するAPI連携、またはデータベースからの定期的なエクスポート(CSV/JSON)とバッチ処理が主流となります。データの機密性が高いため、セキュリティ対策も十分に講じる必要があります。

各データの特性とBigQueryへの取り込み方

上記で挙げた各データカテゴリは、BigQueryに取り込む際にそれぞれ異なる特性を考慮する必要があります。貴社のビジネス要件に合わせて最適な取り込み戦略を策定することが重要です。

以下に、各データソースの一般的な特性と、BigQueryへの取り込み方法の選択肢をまとめました。

| データカテゴリ | 主なデータ例 | 一般的なデータ量 | 更新頻度 | スキーマ構造の傾向 | 取り込み難易度 | BigQueryへの推奨される取り込み方法 |

|---|---|---|---|---|---|---|

| マーケティングデータ | GA4イベント、広告パフォーマンス、CRM顧客情報、MAメール行動 | 大〜特大 | リアルタイム〜日次 | 柔軟(イベントベース)〜固定 | 中〜高 | GA4 BigQuery Export、API連携(バッチ/ストリーミング)、ETL/ELTツール |

| ECデータ | 受注、商品、顧客、在庫、配送 | 中〜大 | リアルタイム〜日次 | 比較的固定(トランザクション/マスタ) | 中 | ECプラットフォームAPI、DBレプリケーション、ETL/ELTツール |

| 会計データ | 仕訳、勘定科目、請求、決済 | 小〜中 | 日次〜月次 | 厳密に固定 | 中〜高 | 会計システムAPI、DB連携(バッチ)、CSVインポート |

BigQueryへのデータ取り込みには、大きく分けてバッチ処理とストリーミング処理があります。バッチ処理は、定期的に大量のデータをまとめて取り込む方法で、日次や週次レポートに適しています。一方、ストリーミング処理は、データが発生するたびにほぼリアルタイムで取り込む方法で、リアルタイム分析やダッシュボード更新に利用されます。多くの企業では、これらの方法を組み合わせ、データの鮮度とコストのバランスを取っています。

さらに、データを取り込む際には、ETL(Extract, Transform, Load)またはELT(Extract, Load, Transform)のプロセスを考慮する必要があります。ETLは、データをBigQueryに取り込む前に変換(クレンジング、結合など)を行う手法であり、ELTは、まずBigQueryに生データをロードし、その後BigQuery内で変換を行う手法です。BigQueryの強力な処理能力とスケーラビリティを最大限に活用するためには、ELTアプローチが推奨されるケースが多くあります(出典:Google Cloud公式ドキュメント)。

どのような取り込み方法を選択するにしても、データの品質とガバナンスは極めて重要です。データの重複、欠損、不整合は、分析結果の信頼性を損ない、誤った意思決定につながる可能性があります。データクレンジングのプロセスを組み込み、データスキーマの一貫性を保ち、適切なアクセス管理と監査ログの仕組みを構築することが、BigQuery運用における「勘所」と言えるでしょう。

BigQueryテーブル設計の「勘所」:パフォーマンスとコストを両立させるスキーマ設計

BigQueryの真価を引き出すには、単にデータを投入するだけでなく、そのテーブル設計に深い戦略が必要です。特にマーケティング、EC、会計といったビジネスの根幹をなすデータを扱う場合、パフォーマンスとコストのバランスは極めて重要になります。ここでは、貴社のデータ活用を成功に導くためのBigQueryテーブル設計の「勘所」を、具体的な手法と注意点を交えて解説します。

正規化と非正規化のバランス:ユースケースに応じた選択

リレーショナルデータベースの設計では正規化が基本とされますが、分析用途のデータウェアハウスであるBigQueryにおいては、非正規化も有効な戦略となり得ます。どちらを選択するかは、貴社のデータ利用パターンとクエリの特性によって判断すべきです。

正規化はデータの一貫性を保ち、更新処理を効率化する一方で、複雑なクエリ(JOINの多用)が必要となり、分析クエリのパフォーマンスが低下する可能性があります。一方、非正規化はJOINの回数を減らし、クエリの記述を簡素化できるため、分析クエリの高速化に寄与します。しかし、データの冗長性が増し、更新時の整合性維持が難しくなるというデメリットもあります。

私たちの経験では、例えばECの注文データであれば、注文ヘッダー情報と注文明細情報を非正規化して一つのテーブルにまとめることで、注文ごとの分析が非常に効率的になります。ただし、マスタデータ(商品マスタ、顧客マスタなど)は別途正規化されたテーブルとして保持し、必要に応じてJOINするハイブリッドなアプローチが現実的です。

| 設計アプローチ | メリット | デメリット | BigQueryにおける推奨ユースケース |

|---|---|---|---|

| 正規化 |

|

|

|

| 非正規化 |

|

|

|

パーティショニング戦略:日付・カテゴリによる分割とクエリ効率化

BigQueryにおけるパーティショニングは、大規模なテーブルをより小さなセグメント(パーティション)に分割することで、クエリ対象データを絞り込み、パフォーマンス向上とコスト削減を図るための非常に強力な機能です。

主なパーティショニングの種類は以下の通りです。

- 日付パーティショニング: 特定の

DATE、TIMESTAMP、DATETIME型の列、またはデータがBigQueryに取り込まれた時間(取り込み時間パーティショニング)に基づいて分割します。マーケティングやECのデータでは、日次・月次の売上、アクセスログ、広告効果データなど、時系列で発生するデータが多いため、日付パーティショニングは最も一般的で効果的です。クエリで日付範囲を指定することで、スキャンするデータを大幅に削減できます。 - 整数範囲パーティショニング:

INT64型の列の範囲に基づいて分割します。例えば、顧客IDのハッシュ値や商品カテゴリIDなどでパーティションを分割することが考えられますが、日付パーティショニングほど一般的には使われません。

例えば、日次のアクセスログを扱う場合、日付列でパーティショニングすることで、「過去7日間のアクセス数」といったクエリは、7つのパーティションのみをスキャンすればよく、テーブル全体をスキャンするよりもはるかに高速かつ低コストで実行できます。適切にパーティショニングされていないテーブルで大規模な日付範囲クエリを実行すると、TB単位のデータをスキャンし、高額な費用が発生することがあります。

| パーティショニングの種類 | 適用可能なデータ型 | 主なメリット | 注意点 | マーケティング/EC/会計での活用例 |

|---|---|---|---|---|

| 日付/タイムスタンプ | DATE, TIMESTAMP, DATETIME |

|

|

|

| 取り込み時間 | なし(BigQueryが自動付与) |

|

|

|

| 整数範囲 | INT64 |

|

|

|

クラスタリングの活用:大規模データセットのクエリ性能向上とコスト削減

クラスタリングは、パーティショニングと組み合わせて利用することで、さらにクエリ性能を向上させ、コストを削減できる機能です。パーティショニングがテーブルを物理的に分割するのに対し、クラスタリングはパーティション内のデータを指定した列(クラスタリングキー)でソートし、関連性の高いデータを物理的に近くに配置します。

これにより、WHERE句やGROUP BY句、ORDER BY句でクラスタリングキーを使用するクエリは、BigQueryがスキャンするデータの量を最小限に抑えることができます。例えば、日付でパーティションされたECの注文テーブルで、顧客IDや商品カテゴリIDをクラスタリングキーに設定すると、「特定の日付範囲で、特定の顧客の購入履歴」や「特定のカテゴリの商品の売上」を検索する際に、BigQueryは関連データが密集しているブロックのみを読み込むため、クエリが高速化します。

クラスタリングキーは最大4列まで指定でき、指定した順序でデータがソートされます。パーティショニングとクラスタリングを組み合わせることで、TB級のデータセットでもミリ秒単位でのクエリ応答を目指すことが可能です。

| 項目 | パーティショニング | クラスタリング |

|---|---|---|

| 目的 | テーブルを物理的に分割し、スキャンするデータ量を削減 | パーティション内のデータをソートし、関連データを物理的に集約 |

| 適用対象 | テーブル全体 | パーティション内 |

| キーの数 | 1つ(日付、取り込み時間、整数範囲) | 最大4つ |

| 主なメリット |

|

|

| 推奨ユースケース |

|

|

データ型とNULL許容:効率的なストレージとクエリパフォーマンス

BigQueryで最適なパフォーマンスとコスト効率を実現するには、適切なデータ型を選択することが不可欠です。データ型は、ストレージ容量、クエリの実行速度、そして結果の正確性に直接影響を与えます。

例えば、数値を格納する際にSTRING型を使用すると、数値演算ができないだけでなく、ストレージ消費が増え、クエリ速度も低下します。また、日付や時刻をSTRING型で格納するのも避けるべきです。BigQueryにはDATE, TIMESTAMP, DATETIMEといった専用の型があり、これらを使用することで、日付関数を使ったクエリが高速化され、ストレージも効率的に利用できます。

特に注意したいのは、STRING型です。BigQueryではSTRING型のデータはUTF-8エンコードで格納され、文字数ではなくバイト数でストレージが消費されます。短い文字列であれば問題ありませんが、長文やJSON形式のテキストをSTRING型で大量に格納すると、ストレージコストとクエリコストが跳ね上がる可能性があります。

また、NULL許容(Nullable)の設計も重要です。BigQueryでは、明示的にNOT NULLを指定しない限り、全ての列がNULLを許容します。NULL値はストレージを消費しますが、必須ではないデータについてはNULLを許容することで、データの柔軟性を高めることができます。ただし、NULL値が多い列をフィルタリングの条件に使うと、パフォーマンスに影響を与える場合もあるため、ユースケースに応じて慎重に検討が必要です。

| データ型 | 説明 | 推奨される利用法 | 避けるべき利用法 |

|---|---|---|---|

| INT64 | 64ビット符号付き整数 | ID、数量、価格、カウント | 浮動小数点数、日付、文字列 |

| FLOAT64 | 64ビット浮動小数点数 | 平均値、比率、割合(厳密な精度が不要な場合) | 通貨(NUMERIC/BIGNUMERICを推奨)、ID |

| NUMERIC / BIGNUMERIC | 固定小数点数(高精度) | 通貨、金融データ、厳密な計算が必要な数値 | 一般的な整数、浮動小数点数(オーバーヘッドがあるため) |

| STRING | 可変長文字列(UTF-8) | 名前、説明、URL、短いテキスト | 日付、数値、ID(可能な限り専用型を使用) |

| BOOL | 真偽値(TRUE/FALSE) | フラグ、ステータス | 1/0のINT64(BOOLがより明確) |

| DATE | 日付(年-月-日) | 誕生日、取引日、レポート日 | 時刻情報が必要な場合(DATETIME/TIMESTAMP) |

| TIMESTAMP | タイムスタンプ(UTC、マイクロ秒精度) | イベント発生時刻、ログ時刻、システム処理時刻 | タイムゾーン情報が重要な場合(DATETIMEと併用検討) |

| DATETIME | 日付と時刻(タイムゾーンなし) | 現地時刻でのイベント、会議予約時刻 | タイムゾーンを考慮した分析が必要な場合(TIMESTAMP) |

ネストされた繰り返しフィールド(RECORD/ARRAY)の活用と注意点

BigQueryの強力な機能の一つに、ネストされた繰り返しフィールド、すなわちRECORD(構造体)とARRAY(配列)があります。これらを活用することで、JOIN操作を減らし、スキーマの柔軟性を高めることができます。特に、マーケティングやECデータのように、一つのエンティティ(例:注文、イベント)に複数の関連情報(例:注文明細、イベントパラメータ)が紐づく場合に非常に有効です。

- RECORD (STRUCT): 複数のフィールドをまとめて一つの論理的な構造体として扱うことができます。例えば、ECの注文テーブルで、配送先住所(郵便番号、都道府県、市区町村、番地)を一つの

RECORDとして定義することで、関連する情報をまとめて管理しやすくなります。 - ARRAY: 同じ型の複数の値を一つのフィールドに格納できます。例えば、注文テーブルに

ARRAY型のorder_itemsフィールドを定義し、その中に各商品の詳細(商品ID、数量、単価など)を格納することで、注文と明細の情報を一つのテーブルで完結させることができます。

これにより、従来のRDBで必要だったJOIN操作が不要になり、クエリの記述が簡素化され、パフォーマンスも向上します。特に、注文明細のように、親テーブルに対して子テーブルが多数存在し、常にセットで参照されるようなデータ構造において、その効果は顕著です。Googleアナリティクス4(GA4)のBigQueryエクスポートスキーマも、イベントパラメータをARRAYとして格納しており、この設計思想を体現しています(出典:Google Analyticsヘルプ)。

ただし、ネストされたフィールドを過度に使用すると、スキーマが複雑になり、クエリの記述が難しくなる場合があります。特に、UNNEST演算子を使って配列を展開するクエリは、適切に記述しないとパフォーマンスが劣化したり、予期せぬ結果を招く可能性もあります。利用する際は、そのメリットとデメリットを十分に理解し、ユースケースに合わせたバランスを見極めることが重要です。

| 機能 | 説明 | メリット | 注意点 | マーケティング/ECでの活用例 |

|---|---|---|---|---|

| RECORD (STRUCT) | 複数の異なる型のフィールドをまとめた構造体 |

|

|

|

| ARRAY | 同じ型の複数の値を格納できる配列 |

|

|

|

【自社事例・独自見解】データモデリングのベストプラクティスと失敗事例

データモデリングは、BigQueryに限らずデータ分析基盤の成否を分ける最も重要な工程の一つです。私たちの経験では、技術的な知識だけでなく、ビジネス要件への深い理解と、将来の拡張性を見据えた設計が不可欠です。

データモデリングのベストプラクティス

- ビジネス要件の徹底的なヒアリング: 誰が、何を、どのように分析したいのかを明確にする。ここが曖昧だと、後々スキーマ変更が頻発し、運用負荷が増大します。

- ユースケース駆動設計: 最も頻繁に実行されるクエリやレポート要件に基づいて、パーティショニング、クラスタリング、非正規化の度合いを決定します。

- 段階的な導入とアジャイルな改善: 最初から完璧なスキーマを目指すのではなく、まずは必要最小限のデータで開始し、フィードバックを得ながら段階的に洗練させていくアプローチが現実的です。

- データガバナンスの確立: スキーマ変更のプロセス、データ定義、品質基準などを明確にし、チーム全体で共有します。

- ドキュメンテーションの徹底: 各テーブル、列の定義、データソース、更新頻度、利用目的などを詳細にドキュメント化することで、属人化を防ぎ、長期的な運用を可能にします。

データモデリングの失敗事例

一方で、以下のような失敗事例も多く見受けられます。

- 過度な正規化・非正規化: RDBの正規化ルールをそのまま適用しすぎてJOIN地獄に陥ったり、逆に何でもかんでも非正規化しすぎてデータ冗長性が高く、更新管理が困難になるケース。

- 不適切なパーティショニング・クラスタリング: 日付以外のカーディナリティの低い列でパーティショニングしたり、クラスタリングキーの順序を考慮しなかったりすることで、期待したパフォーマンス改善が得られず、かえってコストが増大する場合があります。

- データ型の誤用: 全ての列を

STRING型で定義したり、FLOAT64型で通貨を扱ったりすることで、データ精度やクエリパフォーマンスに問題が生じるケース。 - スキーマの硬直化: 初期設計で全ての将来要件を予測しようとし、変更が困難なスキーマになってしまい、新しい分析ニーズに対応できないケース。

- ドキュメンテーション不足: スキーマの意図や各列の意味が不明確なため、新しい担当者がデータを利用する際に大きな障壁となるケース。

これらの失敗を避けるためには、データエンジニア、データアナリスト、ビジネス部門の担当者が密に連携し、共通認識を持ってデータモデリングに取り組むことが重要です。私たちは、貴社のビジネス特性とデータ活用ニーズを深く理解し、これらのベストプラクティスに基づいた最適なBigQueryテーブル設計を支援いたします。

データ連携とETL/ELT:BigQueryへの効率的なデータ取り込みと加工

BigQueryをデータ統合基盤として最大限に活用するには、多様なデータソースからの効率的なデータ取り込みと、その後の適切な加工・変換が不可欠です。このセクションでは、貴社のマーケティング、EC、会計データをBigQueryへスムーズに連携し、分析に耐えうる形に整えるための具体的な方法と勘所について解説します。

各種データソースからの連携方法(GCPサービス、外部ETLツール、API連携)

BigQueryへのデータ取り込み方法は多岐にわたります。貴社のデータの種類、量、鮮度要件、そして既存の技術スタックに合わせて最適な方法を選択することが重要です。

GCPサービスを活用した連携

- Cloud Storage: CSV、JSON、ParquetなどのファイルをBigQueryにロードする最も基本的な方法です。バッチ処理に適しており、大量データの初回ロードや定期的なデータ更新に利用されます。

- Cloud Dataflow (Apache Beam): 大規模なデータ変換、移動、処理をストリーミングまたはバッチで実行できるフルマネージドサービスです。複雑なETLパイプラインやリアルタイム処理に強みがあります。

- Cloud Pub/Sub: イベント駆動型のメッセージングサービスで、リアルタイムなデータストリーミングの起点となります。WebサイトのクリックストリームデータやIoTデバイスデータなどの取り込みに利用されます。

- BigQuery Data Transfer Service: Google広告、Google Analytics、YouTube、Salesforceなど、特定のSaaSアプリケーションからBigQueryへデータを自動的に転送するサービスです。設定が容易で、定期的なデータ同期をコードなしで実現できます。

外部ETLツールを活用した連携

Fivetran、Stitch、Airbyteといった外部のSaaS型ETL/ELTツールは、多種多様なデータソース(CRM、MA、ERP、データベースなど)とのコネクタを豊富に提供しています。これらのツールを利用することで、開発工数を大幅に削減し、専門知識がなくても迅速にデータパイプラインを構築できます。

- メリット:

- 開発・メンテナンス工数の削減

- 幅広いデータソースへの対応

- スキーマ変更への自動対応

- デメリット:

- ツール利用料が発生

- ベンダーロックインのリスク

- 細かいカスタマイズが難しい場合がある

API連携によるカスタム開発

特定のシステムやニッチなデータソースからのデータ取得には、Pythonなどのプログラミング言語を用いたAPI連携によるカスタム開発が有効です。Cloud FunctionsやCloud Runと組み合わせることで、イベント駆動型またはコンテナベースで柔軟なデータ取得ロジックを実装できます。

- メリット:

- 高い柔軟性とカスタマイズ性

- 特定の要件に合わせた最適化

- デメリット:

- 開発・メンテナンス工数が必要

- 専門知識を持つエンジニアが必要

以下に、主要なデータ連携方法の比較表を示します。

| 連携方法 | 特徴 | メリット | デメリット | 適したケース |

|---|---|---|---|---|

| GCPサービス (例: Cloud Storage, BigQuery Data Transfer Service) | Google Cloudのエコシステム内で完結。フルマネージドサービスが多く、運用負担が少ない。 | 安定性、スケーラビリティ、既存GCP環境との親和性。 | 複雑な変換にはDataflowなど他のサービスとの組み合わせが必要。 | GCP上にデータがある場合、特定SaaSからの自動転送。 |

| 外部ETL/ELTツール (例: Fivetran, Stitch) | 多種多様なSaaSやDBへのコネクタを提供。コード不要でパイプライン構築。 | 開発工数削減、迅速な導入、メンテナンス軽減。 | 利用料が発生、カスタマイズの限界、ベンダーロックイン。 | 多くのSaaSデータを統合したい場合、開発リソースが限られる場合。 |

| API連携 (カスタムスクリプト) | プログラミング言語でAPIを直接叩き、データを取得・加工。 | 高い柔軟性、特定の要件への最適化、コストの最適化(自社開発の場合)。 | 開発・メンテナンス工数が必要、専門知識が必須。 | ニッチなデータソース、複雑な取得ロジックが必要な場合。 |

バッチ処理とストリーミング処理の使い分けと実装パターン

データの鮮度要件に応じて、バッチ処理とストリーミング処理を使い分けることが重要です。

- バッチ処理:

- 特徴: 一定期間に蓄積されたデータをまとめて処理します。リアルタイム性は不要で、日次、週次、月次などの定周期で更新されるデータに適しています。

- 適したデータ: ECの売上実績、マーケティングキャンペーンの終了後レポート、会計データの月次締め処理など、比較的鮮度要求めが低いデータや大量の履歴データ。

- 実装パターン:

- Cloud Storageにファイルをアップロードし、BigQueryのロードジョブで取り込む。

- BigQuery Data Transfer ServiceでSaaSデータを定期的に転送する。

- Cloud Composer (Apache Airflow) やCloud Workflowsで、複数のバッチ処理をオーケストレーションする。

- ストリーミング処理:

- 特徴: データが発生するたびにリアルタイムまたはほぼリアルタイムで処理します。高い鮮度要件を持つデータに適しています。

- 適したデータ: Webサイトのクリックストリーム、ユーザー行動ログ、広告インプレッション、IoTセンサーデータなど、即時性が求められるデータ。

- 実装パターン:

- Cloud Pub/Subでイベントを収集し、Cloud Dataflowで変換・集計してBigQueryにストリーミングインサートする。

- Cloud Functionsを使って、特定のイベント(例: Cloud Storageへのファイルアップロード)をトリガーにBigQueryへデータを挿入する。

貴社のビジネス要件とコストを考慮し、それぞれの処理方式を適切に組み合わせることで、データ活用の幅を広げることができます。

ELT(Extract, Load, Transform)アプローチのメリットとBigQueryとの親和性

近年、データウェアハウスにおける主流のアプローチは、従来のETL(Extract, Transform, Load)からELT(Extract, Load, Transform)へと移行しています。ELTは、データを抽出(Extract)し、そのままデータウェアハウスにロード(Load)した後、データウェアハウス内で変換(Transform)を行う手法です。

ELTアプローチのメリット

- 柔軟性と俊敏性: 生データをそのままロードするため、後から変換ロジックを変更したり、新しい分析要件に合わせて異なる形でデータを加工したりすることが容易です。

- スケーラビリティとパフォーマンス: BigQueryのような高性能なデータウェアハウスの計算能力を最大限に活用し、大規模なデータセットでも高速な変換処理が可能です。専用の変換サーバーを用意する必要がありません。

- 生データの保持: 常に生データが利用可能な状態であるため、監査要件への対応や、将来的な分析ニーズ(例えば、新しい機械学習モデルの訓練データとして利用)にも柔軟に対応できます。

- 開発プロセスの簡素化: 変換ロジックをSQLで記述できるため、データエンジニアだけでなく、SQLに慣れたデータアナリストやマーケターもデータ加工に参加しやすくなります。

BigQueryとの高い親和性

BigQueryは、そのスケーラブルなストレージ、高速なクエリエンジン、およびコスト効率の高い従量課金モデルにより、ELTアプローチと非常に高い親和性を持っています。生データを大量にロードしてもストレージコストは低く抑えられ、その後の複雑な変換処理もBigQueryの強力な計算能力で迅速に実行できます。これにより、貴社はデータ加工のボトルネックを解消し、より迅速にインサイトを得ることが可能になります。

データ加工と変換:SQL、Dataform、dbtなどの活用

BigQueryにロードされた生データは、そのままでは分析に適さないことがほとんどです。集計、結合、正規化、クレンジングなどの加工・変換を経て、初めてビジネス価値を生み出す「分析可能なデータ」となります。この工程で活用される主要なツールを紹介します。

- SQL: BigQueryの標準的なデータ変換言語です。ビューやマテリアライズドビューを作成し、複雑なクエリをモジュール化することで、再利用性とパフォーマンスを向上させることができます。データアナリストやマーケターでも学習しやすく、手軽にデータ加工が行える点が強みです。

- Dataform (旧: Google Cloud Dataform): Google Cloudが提供するフルマネージドのデータ変換サービスです。SQLワークフローの構築、テスト、バージョン管理、依存関係の解決などをコードベースで行えます。Gitとの連携により、チームでの開発やCI/CDパイプラインへの組み込みも容易です。BigQueryネイティブであるため、他のGCPサービスとの連携もスムーズです。

- dbt (data build tool): SQLベースのデータ変換ツールで、Dataformと同様に、データモデルの構築、テスト、ドキュメント化を支援します。オープンソースであり、BigQueryだけでなく、SnowflakeやRedshiftなど多様なデータウェアハウスに対応しています。DataformがGCPに特化しているのに対し、dbtはマルチクラウド環境での利用を検討している企業に適しています。

これらのツールを適切に選択・組み合わせることで、貴社のデータチームは効率的かつ信頼性の高いデータ変換パイプラインを構築し、データガバナンスを強化することができます。

| ツール | 特徴 | メリット | デメリット | 推奨される利用シーン |

|---|---|---|---|---|

| SQL (BigQuery標準) | BigQueryのクエリ言語を直接使用し、ビューやマテリアライズドビューを作成。 | 学習コストが低い、手軽に始められる、BigQueryの機能を最大限活用。 | 大規模なパイプライン管理には限界、バージョン管理やテストが手動になりがち。 | 小規模なデータ変換、アドホック分析、SQLに慣れたチーム。 |

| Dataform | Google Cloudのフルマネージドサービス。SQLベースのデータ変換ワークフローをコードで管理。 | BigQueryとの高い親和性、Git連携によるバージョン管理、テスト・ドキュメンテーション機能。 | GCP環境に限定される、dbtに比べてコミュニティが小さい。 | GCPを中心にデータ基盤を構築している企業、データガバナンスを強化したい場合。 |

| dbt | オープンソースのSQLベース変換ツール。モデル構築、テスト、ドキュメンテーション。 | マルチクラウド/DWH対応、大規模なコミュニティ、豊富なプラグイン。 | 別途インフラ(VMやコンテナ)が必要、セットアップに手間がかかる場合がある。 | マルチクラウド戦略を持つ企業、データエンジニアリングの専門知識があるチーム。 |

kintoneデータ連携による業務データ統合と効率化

kintoneは、顧客管理、案件管理、プロジェクト管理、日報、SFAなど、多様な業務アプリケーションをノーコード・ローコードで構築できるプラットフォームです。kintoneに蓄積された業務データをBigQueryに統合することで、マーケティングやECデータと連携させ、全社的な視点でのデータ分析と業務効率化を実現できます。

kintoneデータ連携のメリット

- 全社データの一元化: 営業活動、顧客サポート、プロジェクト進捗などの業務データと、Webサイトの行動ログ、広告効果、EC売上などのマーケティング・ECデータをBigQuery上で統合し、より多角的な分析を可能にします。

- 顧客理解の深化: kintone上の顧客対応履歴や案件情報と、マーケティング施策の反応、購入履歴を紐付けることで、顧客のLTV(Life Time Value)向上に向けたパーソナライズされたアプローチを検討できます。

- 業務プロセスの改善: 業務データとパフォーマンスデータを統合分析することで、ボトルネックの特定や、より効率的な業務フローの設計に役立てることができます。

具体的な連携方法

kintoneデータをBigQueryに連携する方法としては、主に以下のオプションが考えられます。

- kintone REST APIを活用したカスタム開発: Pythonなどのスクリプト言語を用いてkintoneのAPIを呼び出し、定期的にデータを取得してBigQueryにロードします。Cloud FunctionsやCloud Runと組み合わせることで、サーバーレスで効率的な連携パイプラインを構築できます。

- 連携サービス・ツールを活用: DataSpider CloudやCData Syncのようなデータ連携ツールは、kintoneとBigQuery間のコネクタを提供しており、ノーコードまたはローコードでデータ転送設定を行うことが可能です。これにより、開発工数を抑えつつ、安定した連携を実現できます。

私たちAurant Technologiesは、貴社のkintone活用状況とBigQueryへの統合ニーズをヒアリングし、最適なデータ連携戦略と実装を支援いたします。業務データと分析データの壁を取り払い、データ駆動型の経営を推進しましょう。

BigQuery運用と管理の「勘所」:安定稼働とデータ品質の維持

BigQueryは強力なデータ分析基盤ですが、その真価を引き出し、持続的に活用するためには適切な運用と管理が不可欠です。特に、マーケティング、EC、会計といったビジネスの根幹をなすデータを扱う場合、安定稼働とデータ品質の維持は、貴社のビジネス意思決定の信頼性に直結します。ここでは、私たちが数多くのプロジェクトで培ってきたBigQuery運用の「勘所」を具体的なポイントとともにお伝えします。

データガバナンスとアクセス管理:IAMによる権限設計

BigQueryに集約される機密性の高いデータを保護し、適切なユーザーが適切な情報にのみアクセスできるようにするためには、強固なデータガバナンスとアクセス管理が不可欠です。Google CloudのIAM(Identity and Access Management)を適切に設計することが、情報漏洩リスクの低減と誤操作の防止につながります。

最小権限の原則に基づき、ユーザーやサービスアカウントには業務遂行に必要な最小限の権限のみを付与することが重要です。BigQueryでは、プロジェクト、データセット、テーブルの各階層で詳細な権限設定が可能です。例えば、マーケティング担当者には分析に必要なデータセットへの「データ閲覧者」権限のみを付与し、テーブルの作成や削除は制限するといった運用が可能です。

また、個々のユーザーに直接権限を付与するのではなく、Googleグループやサービスアカウントを活用し、グループ単位で権限を管理することで、運用を効率化し、権限の棚卸しを容易にできます。定期的な権限のレビューと監査ログ(Cloud Audit Logs)によるアクセス状況の監視も欠かせません。

| IAMロール(BigQuery関連) | 主な権限 | 推奨される利用シーン |

|---|---|---|

| BigQuery 管理者(roles/bigquery.admin) | プロジェクト内のBigQueryリソースのフルアクセス | システム管理者、データエンジニアリングチームのリーダー(限定的に) |

| BigQuery データ編集者(roles/bigquery.dataEditor) | データセット内のテーブルへのデータの追加、更新、削除 | データエンジニア、ETLプロセスを実行するサービスアカウント |

| BigQuery データ閲覧者(roles/bigquery.dataViewer) | データセット内のテーブルデータの読み取り | データアナリスト、マーケティング担当者、業務部門の意思決定者 |

| BigQuery ジョブユーザー(roles/bigquery.jobUser) | クエリ実行などBigQueryジョブの実行 | BigQueryを利用するアプリケーション、分析ツール、ダッシュボード |

| BigQuery データセットオーナー(roles/bigquery.dataOwner) | データセットとその中のテーブルへの完全なアクセス(データセットレベル) | 特定のデータセットを管理するチームリーダー |

これらのロールを適切に組み合わせることで、貴社の組織構造と業務フローに合わせたセキュアなデータアクセス環境を構築できます。

データ品質管理とモニタリング:異常検知とアラート設定

BigQueryに統合されたデータが、常に正確で信頼できるものであることは、正しいビジネスインサイトを得る上で極めて重要です。データ品質の低下は、誤った意思決定やビジネス機会の損失に直結するため、継続的なデータ品質管理とモニタリング体制の構築が不可欠です。

データ品質管理では、以下の要素に注目してモニタリングを行います。

- データ投入量の異常:日次・月次のデータ投入量が急増・急減していないか。

- スキーマ逸脱:期待されるデータ型や形式から外れたデータが投入されていないか。

- NULL値の急増:必須項目にNULL値が異常に多く含まれていないか。

- 値の範囲外:特定カラムの値が、定義された許容範囲外になっていないか(例:年齢が200歳以上)。

- データの鮮度:最新データが予定通りに投入されているか。

これらの異常を早期に検知するために、Cloud MonitoringやCloud Loggingを活用したアラート設定が有効です。例えば、特定のテーブルの行数が前日比で50%以上減少した場合や、特定のカラムのNULL値比率が閾値を超えた場合に、Slackやメールで担当者に通知する仕組みを構築します。

また、データ変換処理(ETL/ELT)の途中でデータ品質チェックを組み込むことも重要です。Dataformやdbtといったツールは、データ品質テストをコードとして管理し、自動で実行できるため、データパイプライン全体での品質担保に貢献します(出典:Google Cloud Dataform ドキュメント、dbt Labs)。

定期的なデータプロファイリングや監査クエリの実行も、潜在的なデータ品質問題を発見する上で役立ちます。これにより、データソース側の問題やパイプラインのバグを早期に特定し、迅速な対応が可能になります。

クエリ最適化とパフォーマンスチューニングのポイント

BigQueryはペタバイト級のデータを高速に処理できますが、非効率なクエリはコストの増大や分析パフォーマンスの低下を招きます。クエリを最適化し、適切にチューニングすることは、運用コストを削減し、分析者がより迅速にインサイトを得るために必須です。

クエリ最適化の基本的なアプローチは以下の通りです。

- 必要なカラムのみを選択する(SELECT * を避ける):BigQueryはスキャンしたデータ量に基づいて課金されるため、`SELECT *`は避けて、必要なカラムだけを明示的に指定します。

- フィルタリングを徹底する(WHERE句の活用):`WHERE`句でデータを絞り込むことで、スキャン対象のデータ量を大幅に削減できます。パーティション分割されたテーブルでは、パーティションキーによるフィルタリングが特に効果的です。

- パーティショニングとクラスタリングの活用:

- パーティショニング:日付や数値範囲でテーブルを分割し、クエリが対象とするパーティションのみをスキャンするようにします。

- クラスタリング:特定のカラムでデータを物理的に並べ替えることで、フィルタリングやJOINのパフォーマンスを向上させます。

- JOINの最適化:大きなテーブルと小さなテーブルをJOINする場合、小さなテーブルを先にフィルタリングしたり、`BROADCAST JOIN`を活用したりすることでパフォーマンスが向上します。結合キーのデータ型が一致していることも重要です。

- サブクエリやCTE(Common Table Expressions)の適切な利用:複雑なロジックを段階的に記述することで、可読性を高めつつ、中間結果をBigQueryが効率的に処理しやすくなります。

- ワイルドカードテーブルの適切な利用:多数の類似テーブルを跨いでクエリする場合に便利ですが、不要なテーブルまでスキャンしないよう、`_TABLE_SUFFIX`や`_TABLE_PREFIX`で範囲を絞り込みます。

- BigQueryのキャッシュを活用する:同一クエリを一定時間内に再実行する場合、BigQueryはキャッシュを利用してコストをかけずに高速に結果を返します。

クエリの実行計画やスキャンされたデータ量、処理時間などは、BigQuery UIの「クエリの詳細」やCloud Monitoringで確認できます。これらの情報をもとに、継続的にクエリを改善していくことが、コスト効率とパフォーマンスの高いBigQuery運用につながります。

定期的なテーブルメンテナンスとスキーマ変更管理

BigQueryのテーブルは、一度作成したら終わりではありません。データの鮮度維持、パフォーマンス最適化、将来的な拡張性確保のためには、定期的なメンテナンスと計画的なスキーマ変更管理が不可欠です。

テーブルメンテナンスのポイント

- 不要データの削除とライフサイクル管理:

- 特定の期間を過ぎた古いデータは、コスト削減とクエリパフォーマンス向上のため、

DELETE文で削除するか、テーブルの有効期限(TTL: Time-To-Live)を設定して自動削除します。 - 必要に応じて、アーカイブ用の低コストストレージ(例:Cloud StorageのNearline/Coldline)へのエクスポートを検討します。

- 特定の期間を過ぎた古いデータは、コスト削減とクエリパフォーマンス向上のため、

- パーティションの最適化:パーティション分割されたテーブルの場合、データ量が増えるにつれてパーティションの粒度や構成が適切か見直します。

- クラスタリングの見直し:クエリパターンが変化した場合、クラスタリングキーを再検討し、必要に応じて再クラスタリングを実行します。

スキーマ変更管理

ビジネス要件の変化に伴い、テーブルのスキーマ(列の追加、データ型の変更など)を変更する必要が生じることは珍しくありません。BigQueryはスキーマの柔軟性が高いですが、変更は慎重に行う必要があります。

- 後方互換性の維持:既存のダッシュボードやレポート、アプリケーションに影響を与えないよう、後方互換性を考慮した変更を心がけます。例えば、列の削除は既存のクエリを壊す可能性が高いため、非推奨としてマークし、新しい列に移行させるなどの段階的なアプローチが推奨されます。

- 開発環境でのテスト:本番環境に適用する前に、必ず開発環境でスキーマ変更の影響範囲をテストし、関連するクエリやアプリケーションが正常に動作することを確認します。

- バージョン管理:Dataformやdbtなどのツールを利用して、スキーマ定義やデータ変換ロジックをコードとしてバージョン管理することで、変更履歴を追跡し、ロールバックを容易にします。

- ビューの活用:基となるテーブルのスキーマ変更があった場合でも、ビューを介してデータを提供することで、ダウンストリームのシステムへの影響を最小限に抑えることができます。

これらのメンテナンスと変更管理のプロセスを明確にし、チーム内で共有することで、BigQuery環境の健全性と信頼性を長期的に維持できます。

【自社事例・独自見解】運用の自動化と効率化を実現する仕組み

BigQuery運用の安定稼働とデータ品質維持には、手動による作業を極力減らし、自動化を推進することが不可欠です。人的ミスを排除し、担当者の負荷を軽減することで、より戦略的な業務に集中できる環境を構築できます。

私たちが支援したケースでは、某EC企業B社において、手動で行っていた日次データ投入と品質チェックのプロセスが大きな課題となっていました。データ投入はスクリプト実行に依存し、エラー発生時には手動での原因特定と再実行が必要でした。また、データ品質の確認も目視に頼っており、異常検知に時間がかかることが常でした。

この課題に対し、私たちは以下の自動化ソリューションを導入しました。

- データ投入の自動化:

- Cloud StorageにアップロードされたCSVファイルがトリガーとなり、Cloud Functionsが起動。

- Cloud Functions内でBigQuery Data Transfer ServiceのAPIを呼び出すか、直接BigQuery Streaming Insert APIを利用してデータをBigQueryテーブルに投入。

- エラー発生時にはCloud Loggingに詳細を記録し、Cloud Monitoring経由で担当者にアラート通知。

- データ品質チェックの自動化:

- データ投入完了後にCloud Functionsが起動し、BigQueryに対して品質チェック用のSQLクエリ(例:NULL値比率、レコード件数、特定カラムの値の範囲チェック)を実行。

- 品質チェックの結果が閾値を超えた場合、Cloud Monitoringで異常を検知し、Slackやメールで担当者に即座にアラートを送信。

この自動化により、某EC企業B社では、データ投入ミスを年間10件から0件に削減し、担当者の月間作業時間を約20時間削減することに成功しました。さらに、異常データ検知からアラート発報までのタイムラグを平均3時間から15分に短縮し、迅速な意思決定を支援することが可能になりました。

運用の自動化は、単なる工数削減以上の価値をもたらします。それは、データ基盤の信頼性を飛躍的に向上させ、貴社のビジネスが常に最新かつ高品質なデータに基づいた意思決定を行えるようになるということです。BigQueryのAPIとGoogle Cloudの各種サービスを組み合わせることで、貴社の運用要件に合わせた柔軟な自動化を実現できます。

コスト最適化とセキュリティ:BigQueryを安全かつ経済的に利用するために

BigQueryは、ペタバイト規模のデータ分析を可能にする強力なツールですが、その利便性と引き換えに、コスト管理とセキュリティ対策は貴社にとって避けて通れない重要な課題です。特にマーケティング、EC、会計といった機密性の高いデータを扱う場合、適切な設計と運用が不可欠です。このセクションでは、BigQueryを安全かつ経済的に利用するための具体的な戦略と勘所を解説します。

ストレージコストとクエリコストの管理戦略

BigQueryのコストは主に「ストレージコスト」と「クエリコスト」の2つで構成されます。これらを効率的に管理することで、予期せぬ高額請求を防ぎ、投資対効果を最大化できます。

ストレージコストの最適化

ストレージコストは、保存するデータ量に応じて発生します。以下の手法で最適化を図ります。

- パーティション分割(Partitioning):テーブルを日付や特定の列で分割することで、特定の期間や条件のデータのみをスキャン対象とし、クエリの処理量を削減します。例えば、日次の売上データであれば日付でパーティション分割することで、過去1週間の売上分析時に不要なデータをスキャンせずに済みます。

- クラスタリング(Clustering):特定の列のデータを物理的に近い場所に配置することで、検索効率を高めます。これにより、クエリがスキャンするデータ量を減らし、クエリコストと実行時間を削減できます。

- データ有効期限の設定:不要になったデータや、鮮度が落ちた古いデータに対して自動的に削除される有効期限を設定します。これにより、ストレージ容量を常に最適化し、無駄なコスト発生を防ぎます。特にログデータなど、一定期間経過後に重要度が下がるデータに有効です。

クエリコストの最適化

クエリコストは、クエリが処理するデータ量に応じて発生します。以下の手法で最適化を図ります。

- SELECT * の回避:必要な列のみを明示的に指定することで、スキャンするデータ量を最小限に抑えます。特にワイドテーブル(列数の多いテーブル)では効果が顕著です。

- クエリプレビュー機能の活用:クエリを実行する前に、処理されるデータ量をプレビューで確認し、意図しない大量スキャンを防ぎます。Google Cloud Consoleやbqコマンドラインツールで表示されます。

- キャッシュの活用:BigQueryは、同一のクエリ結果を最大24時間キャッシュします。頻繁に実行される同じクエリは、キャッシュヒットにより無料で実行されるため、コスト削減に貢献します。

- 中間テーブルの作成:複雑なクエリや繰り返し利用されるサブクエリの結果を一時的な中間テーブルとして保存し、以降のクエリでその中間テーブルを参照することで、処理負荷とコストを分散します。

- ワイルドカードテーブルの慎重な利用:複数のテーブルをまとめてクエリする際に便利な機能ですが、不要なテーブルまでスキャンしないよう、適切なフィルタリング条件と組み合わせることが重要です。

これらのコスト管理戦略を表にまとめました。

| コストタイプ | 最適化手法 | 具体的な効果 |

|---|---|---|

| ストレージコスト | パーティション分割 | クエリ対象データを限定し、ストレージとクエリ処理量を削減 |

| ストレージコスト | クラスタリング | 関連データを物理的に集約し、クエリ効率とスキャン量を改善 |

| ストレージコスト | データ有効期限の設定 | 不要なデータを自動削除し、ストレージ容量とコストを最適化 |

| クエリコスト | SELECT * の回避 | 必要な列のみをスキャンし、処理データ量を最小化 |

| クエリコスト | クエリプレビュー | 実行前に処理データ量を確認し、予期せぬコストを防止 |

| クエリコスト | キャッシュの活用 | 同一クエリ結果の再利用で、無料クエリ実行を促進 |

| クエリコスト | 中間テーブルの作成 | 複雑なクエリの負荷分散と再利用性の向上 |

予約スロットとオンデマンド料金の選択と判断基準

BigQueryのクエリ料金には、大きく分けて「オンデマンド料金」と「予約スロット(定額料金)」の2つのモデルがあります。貴社の利用パターンに応じて最適な料金モデルを選択することが、コスト最適化の鍵となります。

オンデマンド料金(従量課金)

オンデマンド料金は、クエリが処理したデータ量に応じて課金されるモデルです。一般的に、最初の1TBは無料で、それ以降は1TBあたり$6.25(2024年5月現在、リージョンによって変動あり、出典:Google Cloud BigQuery 料金)といった形で課金されます。

- メリット:初期費用が不要で、利用量が少ない場合は非常に経済的です。突発的な分析ニーズや、利用量の予測が難しい場合に適しています。

- デメリット:クエリ処理量が多い場合や、利用が急増した場合にはコストが青天井になるリスクがあります。他のユーザーとコンピューティングリソースを共有するため、クエリのパフォーマンスが安定しない場合があります。

予約スロット(定額料金)

予約スロットは、一定量のコンピューティングリソース(スロット)を事前に購入し、定額で利用するモデルです。スロットはBigQueryのクエリ実行能力を示す単位で、100スロット単位で利用できます。購入期間は月単位、年単位などがあります(出典:Google Cloud BigQuery 料金)。

- メリット:利用量が多い場合、オンデマンドよりも総コストを抑えられる可能性が高いです。専用のリソースを確保するため、クエリのパフォーマンスが安定しやすく、SLA(サービス品質保証)が提供されます。

- デメリット:初期費用や月額費用が発生します。利用量がスロット容量を下回る場合、費用対効果が悪くなる可能性があります。

選択の判断基準

貴社がどちらの料金モデルを選択すべきか、以下の表を参考に検討してください。

| 項目 | オンデマンド料金 | 予約スロット(定額料金) |

|---|---|---|

| 利用頻度・量 | 散発的、データ処理量が少ない(月数TB以下目安) | 継続的、データ処理量が多い(月数十TB以上目安) |

| コスト予測 | 変動が大きく、予測が難しい | 安定しており、予測しやすい |

| パフォーマンス | 他のユーザーに影響され、変動する可能性あり | 安定したパフォーマンスを確保 |

| 初期費用 | 不要 | 必要(月額または年額) |

| 適したケース | PoC、新規プロジェクト、利用量が少ない部署 | 基幹システム連携、大規模データ分析、SLA重視 |

まずはオンデマンドで利用を開始し、利用量が増加し、月間のクエリ処理データ量が数十TBを超えるようになった時点で、予約スロットへの切り替えを検討するのが一般的なアプローチです。BigQueryの管理画面で利用状況やコストを常時モニタリングし、最適なタイミングで判断を下しましょう。

IAMによる厳格なアクセス制御と監査ログの活用

BigQueryに集約されたマーケティング、EC、会計データは、貴社にとって最も重要な資産の一つです。これらの機密情報を保護するためには、IAM(Identity and Access Management)による厳格なアクセス制御と、監査ログによる継続的な監視が不可欠です。

IAMによるアクセス制御

IAMは、Google Cloudリソースへのアクセスを管理するためのフレームワークです。BigQueryにおいては、誰がどのデータセット、テーブル、ビューにアクセスできるかを詳細に定義します。

- 最小権限の原則:ユーザーやサービスアカウントには、業務遂行に必要最低限の権限のみを付与します。例えば、マーケティング担当者にはマーケティングデータセットへの参照権限のみを付与し、会計担当者には会計データセットへの参照権限と、必要であれば特定のテーブルへの書き込み権限を付与するといった形です。

- カスタムロールの活用:BigQueryには「BigQuery データ閲覧者」「BigQuery データ編集者」「BigQuery 管理者」などの事前定義ロールがありますが、よりきめ細やかな権限設定が必要な場合は、カスタムロールを作成して特定の権限セットを定義できます。

- データセットレベル、テーブルレベルのアクセス制御:BigQueryでは、データセット全体、または特定のテーブルやビューに対してアクセス権限を設定できます。これにより、異なる部署やプロジェクト間でデータを安全に共有しつつ、必要な情報のみを公開することが可能です。

- 行レベルセキュリティと列レベルセキュリティ:より高度な制御として、行レベルセキュリティ(特定の条件を満たす行のみを表示)や列レベルセキュリティ(特定の列を非表示にする)を活用することで、さらに詳細なデータアクセス制限を実装できます。これにより、特定のユーザーには個人情報(P.I.I.)をマスクしたデータのみを表示させるといった運用が可能になります(出典:Google Cloud BigQuery ドキュメント)。

監査ログ(Cloud Logging)の活用

BigQueryにおけるすべての操作は、Cloud Loggingによって自動的にログとして記録されます。この監査ログは、セキュリティとコンプライアンスの観点から極めて重要です。

- 不正アクセスの検知:誰が、いつ、どのデータにアクセスし、どのような操作を行ったかを詳細に記録します。これにより、不審なアクセスパターンや不正なデータ操作を早期に検知できます。

- コンプライアンス要件への対応:GDPRやHIPAAなどの規制では、データへのアクセス履歴の監査が求められます。監査ログは、これらのコンプライアンス要件を満たすための重要な証拠となります。

- 運用状況の可視化:BigQueryの利用状況やパフォーマンスに関する洞察を得るためにも活用できます。特定のクエリが頻繁に実行されているか、エラーが発生していないかなどを確認できます。

監査ログは、Cloud Loggingのログエクスプローラで確認できるほか、BigQueryにエクスポートして詳細な分析を行うことも可能です。定期的なログのレビューと、異常を検知した際の自動アラート設定は、セキュリティ運用において不可欠です。

データ暗号化とコンプライアンス対応(GDPR, HIPAAなど)

BigQueryは、保存データと転送データの両方に対して堅牢な暗号化機能を提供しており、GDPRやHIPAAといった厳格なデータ保護規制への対応を強力に支援します。

データの暗号化

BigQueryでは、以下の暗号化オプションが利用可能です。

- デフォルト暗号化:BigQueryに保存されるすべてのデータは、Googleによって管理される暗号化キーで自動的に暗号化されます。貴社が特別な設定を行う必要はありません。これは、データの機密性を確保するための基本的なセキュリティ対策です。

- 顧客管理の暗号化キー(CMEK: Customer-Managed Encryption Keys):より高度なセキュリティ要件を持つ場合、貴社がGoogle Cloud Key Management Service(KMS)で管理する暗号化キーを使用して、BigQueryデータを暗号化できます。これにより、暗号化キーのライフサイクル全体を貴社が制御できるようになり、規制要件への対応が容易になります(出典:Google Cloud BigQuery ドキュメント)。

転送中のデータ(クライアントとBigQuery間、またはBigQuery内部のサービス間)は、TLS(Transport Layer Security)によって暗号化され、傍受や改ざんから保護されます。

コンプライアンス対応

BigQueryは、多くの国際的なコンプライアンス基準と規制に準拠しています。貴社のビジネスが特定の規制対象である場合、BigQueryの機能を活用して対応を強化できます。

- GDPR (一般データ保護規則):欧州連合(EU)の個人データ保護に関する規制です。BigQueryはデータ所在地(Data Residency)の選択肢を提供しており、EU圏内のリージョンにデータを保存することで、GDPRのデータ主権要件を満たすことが可能です。また、IAMによるアクセス制御と監査ログは、データ処理の透明性と説明責任を果たす上で重要です。

- HIPAA (医療保険の相互運用性と説明責任に関する法律):米国の医療情報保護に関する規制です。BigQueryはHIPAA準拠をサポートしており、PHI(Protected Health Information)を安全に処理・保存するための環境を提供します。CMEKの利用や厳格なアクセス制御が、HIPAA準拠のための重要な要素となります(出典:Google Cloud コンプライアンスレポート)。

- その他の規制:ISO 27001, SOC 1/2/3など、BigQueryは様々な国際的なセキュリティ標準の認証を取得しています。貴社が求めるコンプライアンス要件に応じて、適切な設定と運用を行うことで対応が可能です。

コンプライアンス対応においては、技術的な対策だけでなく、データガバナンスポリシーの策定、従業員への教育、定期的な監査といった組織的な取り組みも重要です。BigQueryはその技術的な基盤を提供しますが、最終的なコンプライアンスは貴社の運用全体にかかっています。

【自社ソリューション連携】会計DXにおけるデータセキュリティの重要性

会計データは、企業の経営状態を映し出す最も機密性の高い情報であり、そのセキュリティは企業の存続に直結します。BigQueryを活用した会計DXを進める上で、データセキュリティは最優先事項として考慮すべきです。

会計データの特殊性とセキュリティリスク

会計データには、売上、費用、利益、負債といった財務情報に加え、取引先情報、従業員の給与情報など、外部に漏洩した場合に甚大な損害をもたらす可能性のある個人情報や企業機密が含まれます。不正アクセス、データ改ざん、誤ったデータ利用は、企業の信用失墜、法的責任、経済的損失に直結します。

会計DXによって、これらのデータがBigQueryのようなデータウェアハウスに集約されることで、分析の機会は飛躍的に拡大します。しかし同時に、データの集約はセキュリティリスクの集中も意味します。単一の侵害が、企業全体の財務健全性を脅かす事態につながりかねません。

BigQueryが提供するセキュリティ基盤と会計DX

BigQueryは、会計データの統合基盤として、以下の点で強力なセキュリティ機能を提供します。

- 堅牢な暗号化:保存データと転送データの両方で、業界標準の暗号化がデフォルトで適用されます。CMEKを利用すれば、貴社が暗号化キーを完全に管理できるため、特に厳格なセキュリティポリシーを持つ会計部門の要件にも対応可能です。

- 詳細なアクセス制御(IAM):会計データは、アクセス権限を持つユーザーを極めて限定する必要があります。BigQueryのIAMは、データセット、テーブル、さらには行・列レベルでの詳細なアクセス制御を可能にし、会計部門の特定の担当者のみが特定の財務諸表や詳細な取引データにアクセスできるよう設定できます。これにより、職務分掌を明確にし、内部統制を強化します。

- 包括的な監査ログ:会計データへのすべてのアクセスと操作は、Cloud Loggingによって詳細に記録されます。これにより、誰がいつ、どのような会計データにアクセスし、どのようなクエリを実行したかを追跡できます。不正アクセスやデータ改ざんの試みを早期に検知し、インシデント発生時には迅速な調査と対応を可能にします。

- コンプライアンス準拠:BigQueryは、金融業界や企業会計に求められる多くの国際的なセキュリティ・コンプライアンス基準(ISO 27001, SOC 2など)に準拠しています。これにより、貴社はBigQueryを基盤として、会計DXを進めつつ、規制要件を満たす運用を構築できます。

私たちは、会計DXを推進する上で、技術的なセキュリティ対策だけでなく、貴社の内部統制、データガバナンスポリシー、そして従業員のセキュリティ意識向上といった多角的なアプローチが不可欠だと考えています。BigQueryを安全に活用し、会計データの価値を最大限に引き出すためのご支援を通じて、貴社のDX成功に貢献いたします。

統合データで実現するビジネス価値:マーケティング施策と経営意思決定への応用

BigQueryによってマーケティング、EC、会計といった異なるソースから統合されたデータは、単なる情報の集約に留まらず、貴社のビジネスに計り知れない価値をもたらします。ここでは、統合データがどのように具体的な施策や意思決定に結びつき、企業の成長を加速させるのかを深掘りします。

顧客360度ビューの構築とパーソナライズされたマーケティング戦略

BigQueryで顧客データを統合することで、貴社は「顧客360度ビュー」を構築し、個々の顧客を多角的に理解できるようになります。CRMデータ(属性、購買履歴)、Webサイトの行動ログ(閲覧履歴、滞在時間)、アプリ利用状況、メールの開封・クリック履歴、SNSでのエンゲージメント、さらにはオフラインの店舗購買履歴や問い合わせ履歴まで、あらゆる顧客接点からのデータを一元的に分析することが可能です。

この統合されたデータ基盤は、顧客の過去の行動パターン、現在のニーズ、将来の購買意欲を高い精度で予測することを可能にします。これにより、一人ひとりの顧客に最適化されたパーソナライズされたマーケティング戦略を展開できるようになります。例えば、特定のカテゴリ商品を閲覧した顧客には関連商品のレコメンデーションを、過去に購入した商品のアフターケア情報や関連アクセサリーの提案を、離反リスクのある顧客には特別なリテンションオファーを自動で送るといった施策が実現できます。

私たちが支援する中で、こうしたパーソナライズ施策は顧客エンゲージメントの向上、コンバージョン率の改善、そして長期的な顧客ロイヤルティの構築に大きく貢献するケースが多く見られます。例えば、あるBtoC企業では、BigQueryで統合したデータに基づき顧客セグメントを細分化し、各セグメントに合わせたメールマーケティングを実施した結果、メールからのコンバージョン率が平均で15%向上しました(参考:Adobe「Digital Trends 2023」では、パーソナライゼーションが顧客体験と売上向上に寄与すると報告)。

| 実現するマーケティング施策 | BigQuery統合データの活用例 | 期待されるビジネス効果 |

|---|---|---|

| パーソナライズされたレコメンデーション | 購買履歴、閲覧履歴、カート投入状況から関連商品を提案 | 顧客単価(AOV)向上、クロスセル・アップセル促進 |

| セグメント別メール・キャンペーン | 顧客属性、LTV、行動履歴に基づいたターゲット選定 | メール開封率・クリック率向上、コンバージョン率改善 |

| Webサイトコンテンツの最適化 | Web行動ログ、CRMデータから個々の顧客に合わせたコンテンツ表示 | サイト滞在時間延長、離脱率低下、コンバージョン率向上 |

| 顧客離反防止(リテンション) | 購買頻度、最終購買日、サービス利用状況から離反リスクを予測し、早期にアプローチ | 顧客維持率向上、LTV最大化 |

ECサイトの売上予測と在庫最適化、LTV向上施策

ECサイト運営において、BigQueryによるデータ統合は、売上予測の精度向上、在庫の最適化、そして顧客のライフタイムバリュー(LTV)向上施策の実現に不可欠です。ECサイトの購買履歴、閲覧履歴、カート投入データ、配送状況といったデータに加え、会計データ(原価、利益率、返品コストなど)をBigQueryに集約することで、単なる売上高だけでなく、真の収益性を顧客や商品単位で分析できるようになります。

BigQueryは、その膨大なデータ処理能力を活かし、過去の販売データ、季節性、プロモーション効果、さらには外部データ(天候、経済指標、競合動向など)を組み合わせた高度な売上予測モデルの構築を可能にします。特にBigQuery MLと連携することで、機械学習を活用した高精度な需要予測が実現し、過剰在庫による陳腐化リスクや、在庫不足による販売機会損失を大幅に削減できます。

在庫最適化においては、需要予測に基づいた自動発注システムの構築や、リアルタイムでの在庫状況可視化により、倉庫間の最適な商品配置や配送ルートの最適化にも貢献します。これにより、物流コストの削減と顧客への迅速な商品提供を両立できます。

LTV向上施策では、統合データを用いて顧客をRFM(Recency, Frequency, Monetary)分析などの指標でセグメンテーションし、優良顧客、休眠顧客、新規顧客といった各グループに合わせたパーソナライズされたアプローチを展開します。例えば、優良顧客には限定特典や先行販売情報を提供し、休眠顧客には再活性化を促すキャンペーンを実施することで、顧客ロイヤルティを醸成し、LTVの最大化を図ります。当社の経験では、このような施策により、LTVが年間で10%以上向上した事例も存在します(参考:Bain & Companyの調査では、顧客維持率が5%向上すると利益が25%から95%増加する可能性があると報告)。

経営状況のリアルタイム可視化と迅速な意思決定(BIツール連携)

経営層にとって、散在するデータから迅速かつ正確な経営状況を把握することは常に大きな課題です。BigQueryで統合されたマーケティング、EC、会計データは、BIツール(Business Intelligenceツール)と連携することで、この課題を根本的に解決します。BigQueryはその高速なクエリ処理能力とスケーラビリティにより、大量のデータをBIツールにほぼリアルタイムで提供できます。

BIツール(Looker Studio、Tableau、Power BIなど)は、BigQueryから取得したデータを活用し、視覚的に分かりやすいダッシュボードやレポートを自動生成します。これにより、経営層は主要なKGI(重要目標達成指標)やKPI(重要業績評価指標)を常に最新の状態で確認できるようになります。例えば、マーケティング費用対効果(ROAS)、顧客獲得単価(CPA)、商品別粗利率、キャッシュフロー、部門別収益性といった多岐にわたる指標を、時間軸やセグメント別にドリルダウンして詳細に分析することが可能です。

このリアルタイムな経営状況の可視化は、迅速な意思決定を可能にします。市場の変化や事業の課題を早期に察知し、データに基づいた客観的な判断を下すことで、機会損失の回避やリスクの最小化、そして成長戦略の加速が期待できます。レポート作成にかかっていた時間と労力も大幅に削減され、データ分析に集中できる環境が整います。

| BIツール連携によるメリット | 詳細 |

|---|---|

| リアルタイムなデータ把握 | BigQueryの最新データをBIツールで即座に可視化し、常に最新の経営状況を把握 |

| 多角的な分析と深掘り | 統合されたデータソースを横断し、様々な角度からドリルダウン分析が可能 |

| 意思決定の迅速化 | データに基づいた客観的な情報を基に、経営層が迅速かつ的確な判断を下せる |

| レポート作成の自動化 | 手作業によるレポート作成の手間を削減し、定型レポートを自動生成 |

| 部門間の連携強化 | 共通のデータ基盤とダッシュボードを通じて、部門間の情報共有と協力体制を促進 |

【自社ソリューション連携】BIツールを活用したデータ分析とレポート作成支援

貴社がBigQueryでデータを統合し、そのデータを最大限にビジネス価値に転換するためには、適切なBIツールの選定と、それを活用したデータ分析・レポート作成のノウハウが不可欠です。私たちは、BigQueryでのデータ統合から、その後のBIツールを活用したデータ分析、そして具体的なビジネス戦略立案まで、一貫した支援を提供しています。

私たちの専門家チームは、まず貴社のビジネス目標と現状の課題を深く理解するための要件定義を行います。そこから、BigQuery上でBIツールが最も効率的にデータを読み込み、分析できるよう、最適なデータモデリングを設計します。次に、経営層から各部門の現場担当者まで、それぞれの役割とニーズに合わせたカスタムダッシュボードを設計・実装し、必要なKPIが常に可視化される環境を構築します。

さらに、定型レポートの自動生成設定や、ダッシュボードの運用・保守支援はもちろんのこと、貴社内でのデータ分析スキル向上のための人材育成プログラムも提供しています。これにより、貴社自身で継続的にデータを活用し、自律的な改善サイクルを回せるようになることを目指します。

私たちは、Looker Studio、Tableau、Power BIなど、様々なBIツールの導入・活用実績があり、BigQueryとの親和性、機能、コスト、拡張性といった多角的な視点から、貴社に最適なBIツール選定をサポートします。貴社のデータ活用を次のレベルへと引き上げるために、ぜひ私たちにご相談ください。

Aurant Technologiesが提供するBigQuery活用支援

貴社がBigQueryを活用し、マーケティング、EC、会計といった多岐にわたるデータを統合し、ビジネスを加速させたいとお考えなら、私たちにご相談ください。データ活用の専門家集団として、計画から実装、運用、そしてその先のビジネス成果まで、貴社のDXジャーニーを一貫してサポートします。

BigQuery導入コンサルティングとロードマップ策定

BigQueryの導入は単なるツールの導入ではなく、貴社のデータ活用文化を根底から変革するプロジェクトです。私たちは、まず貴社の現状とビジネス目標を深く理解することから始めます。どのようなデータを統合し、どのようなインサイトを得て、最終的にどのようなビジネス成果を達成したいのか。この問いに対する明確な答えを見つけることが、成功への第一歩です。

私たちのコンサルティングでは、以下のステップで貴社に最適なBigQuery導入ロードマップを策定します。

- 現状分析と課題特定: 貴社の既存データソース、システム構成、データ活用の現状を詳細に評価し、ボトルネックや非効率な点を特定します。

- 目標設定とユースケース定義: BigQuery導入を通じて達成したい具体的なビジネス目標(例:マーケティングROIの20%向上、EC顧客単価の15%アップ、月次決算早期化)を設定し、それを実現するための具体的なデータ活用ユースケースを定義します。

- 技術要件定義とアーキテクチャ設計: BigQueryを中心としたデータ分析基盤の全体像を設計します。これには、既存システムとの連携方法、セキュリティ要件、データガバナンスポリシーなどが含まれます。

- コスト最適化計画: BigQueryの従量課金モデルを最大限に活用できるよう、初期段階からコスト効率の良い運用計画を立案します。ストレージ、クエリ、データ転送など、各要素における最適化戦略を提案します。

- ロードマップ策定とROI評価: 導入フェーズ、必要なリソース、期間、期待されるROI(投資対効果)を明確にした詳細なロードマップを作成します。

こうしたプロセスを通じて、貴社がBigQuery導入に際して直面するであろう潜在的なリスクを洗い出し、効果的な対策を講じることで、スムーズかつ確実なプロジェクト推進を支援します。

テーブル設計・データ連携・ETL/ELT構築支援

BigQueryの真価を引き出すには、適切なテーブル設計と堅牢なデータパイプラインが不可欠です。私たちは、貴社のビジネスロジックと将来の分析ニーズを深く理解し、最適なテーブル設計を支援します。

- 最適なテーブルスキーマ設計: マーケティング、EC、会計といった異なるドメインのデータを効率的に統合し、分析しやすい構造を設計します。パーティショニング、クラスタリングを活用し、クエリパフォーマンスとコスト効率を最大化するスキーマを提案します。

- 多様なデータソースからのデータ連携: CRM(Salesforceなど)、MAツール(HubSpot、Marketoなど)、ECプラットフォーム(Shopify、EC-CUBEなど)、会計システム(SAP、勘定奉行など)、広告プラットフォーム(Google Ads、Facebook Adsなど)、SaaSアプリケーション、オンプレミスのデータベース、CSVファイルなど、貴社が持つあらゆるデータソースからのBigQueryへの安全かつ効率的なデータ連携を実現します。

- 堅牢なETL/ELTパイプライン構築: Google Cloud Dataflow, Cloud Composer, Cloud Functions, Cloud StorageといったGoogle Cloudの豊富なサービス群を組み合わせ、データの抽出(Extract)、変換(Transform)、読み込み(Load)プロセスを自動化・最適化します。データ品質の維持、エラーハンドリング、モニタリング機能も考慮したパイプラインを構築し、データの鮮度と信頼性を保証します。

私たちの支援により、貴社はデータ準備にかかる時間と労力を大幅に削減し、本来の目的であるデータ分析とビジネス意思決定に集中できるようになります。

データ分析基盤構築とBIツール連携

BigQueryに集約されたデータは、分析を通じて初めて価値を発揮します。私たちは、貴社がデータを最大限に活用できるよう、強力なデータ分析基盤の構築と、各種BIツールとのシームレスな連携を支援します。

- BIツール選定・導入支援: Google CloudのネイティブBIツールであるLookerやLooker Studio(旧 Google Data Studio)はもちろん、Tableau、Power BIなど、貴社の既存環境やニーズに最適なBIツールの選定から導入、設定までを支援します。

- BIダッシュボード・レポート開発: 経営層向けのKPIダッシュボード、マーケティング担当者向けのキャンペーン効果分析レポート、EC担当者向けの顧客行動分析ダッシュボードなど、各ユーザーの役割と目的に合わせた視覚的に分かりやすいダッシュボードやレポートを開発します。これにより、データに基づいた迅速な意思決定を可能にします。

- 高度なデータ分析支援: BigQuery MLを活用した機械学習モデルの構築支援(顧客セグメンテーション、LTV予測、離反予測など)や、データサイエンティストと連携した深層分析プロジェクトの推進をサポートします。

- データガバナンスとセキュリティ: BigQueryのアクセス制御、データ暗号化、監査ログ機能を活用し、厳格なデータガバナンス体制を構築します。機密性の高い会計データや顧客データも安心して取り扱えるよう、セキュリティポリシーの策定と実装を支援します。

私たちが構築するデータ分析基盤は、単なるデータの可視化に留まらず、貴社のビジネス成長を継続的に支える「生きた資産」となることを目指します。

【自社ソリューション】kintone連携、BIダッシュボード構築、LINE連携、会計DX、医療系データ分析など、貴社に最適なDXを支援

私たちは、BigQueryを核としたデータ統合・分析基盤の構築だけでなく、貴社の特定のビジネス課題を解決するための幅広いDXソリューションを提供しています。

| ソリューション領域 | 主な支援内容 | 貴社へのメリット |

|---|---|---|

| kintone連携とデータ活用 | kintone上の業務データをBigQueryに統合し、他システムデータと合わせて分析。顧客管理、案件管理、プロジェクト管理データの可視化。 | 散在しがちなkintoneデータを一元化し、部門横断的な分析を可能に。業務プロセスの改善点や売上向上機会を発見。 |

| BIダッシュボード構築 | Google Looker Studio, Looker, Tableauなどを活用し、経営層から現場まで各レイヤーに最適化されたカスタムダッシュボードを開発。 | タイムリーな経営判断を支援。各部門が自律的にデータに基づいた意思決定を行える環境を構築。 |

| LINE連携とマーケティングDX | LINE公式アカウントの顧客データ、メッセージ配信データと、EC・CRMデータをBigQueryで統合。パーソナライズされたLINEマーケティング施策の立案・実行。 | 顧客エンゲージメント向上、コンバージョン率改善、顧客LTV最大化。より効果的なOne-to-Oneコミュニケーションを実現。 |

| 会計DXと経営可視化 | 会計システム、販売管理システム、経費精算システムなどの会計関連データをBigQueryに集約。予実管理、キャッシュフロー分析、収益性分析の高度化。 | 月次決算の早期化、経営指標のリアルタイム把握、精度の高い経営戦略策定を支援。不正検知やコスト最適化にも寄与。 |

| 医療系データ分析 | 匿名化・セキュリティを厳格に管理しながら、カルテデータ、レセプトデータ、臨床データなどをBigQueryで分析。疾患予測、治療効果分析、医療資源最適化。 | 医療サービスの質向上、研究開発の加速、効率的な病院経営を支援。プライバシー保護を最優先。 |

| その他個別DX支援 | 貴社固有の課題や業界特性に応じた、オーダーメイドのDXソリューションを提供。データ活用に関するあらゆるご要望に対応。 | 既存の枠にとらわれない、真に貴社にフィットする変革を実現。競争優位性の確立。 |

私たちは、貴社のビジネスモデルや業界特有の課題に深く寄り添い、BigQueryの持つ無限の可能性を最大限に引き出すことで、貴社のDX推進を力強く支援します。データドリブンな経営への転換を、私たちと共に実現しませんか。