社内AIの「それっぽい回答」は事業を破壊する?信頼性を保証する参照ルール設計の極意

社内AIの「それっぽい回答」は、誤った意思決定を招き事業に致命的な損害を与えます。この危険を排除し、AIを信頼できるビジネスパートナーに変える参照ルール設計の極意を、Aurant Technologiesが解説します。

目次 クリックで開く

社内AIの「それっぽい回答」は事業を破壊する?信頼性を保証する参照ルール設計の極意

社内AIの「それっぽい回答」は、誤った意思決定を招き事業に致命的な損害を与えます。この危険を排除し、AIを信頼できるビジネスパートナーに変える参照ルール設計の極意を、Aurant Technologiesが解説します。

社内AIの「それっぽい回答」がもたらす致命的なリスクとは

社内AIの導入は、業務効率化や意思決定の迅速化に大きな期待が寄せられています。しかし、AIが生成する「それっぽい回答」が、貴社に致命的なリスクをもたらす可能性があることをご存存じでしょうか。表面上はもっともらしく見えても、事実に基づかない情報は、時に取り返しのつかない損害を引き起こします。このセクションでは、その具体的なリスクとその影響について詳しく解説します。

ハルシネーション(AIの幻覚)のメカニズムとビジネスへの影響

「ハルシネーション」とは、AIが事実に基づかない、あるいは学習データには存在しない情報を、あたかも事実であるかのように自信を持って生成する現象を指します。これは、AIが論理的に推論しているのではなく、学習した膨大なデータから確率的にもっともらしい単語の連なりを生成するために起こります。

ハルシネーションのメカニズムは複雑ですが、主な要因は以下の通りです。

- 学習データの限界と偏り: AIは学習データに含まれる情報しか知りません。特定の情報が不足していたり、偏りがあったりすると、その隙間を「もっともらしい」情報で埋めようとします。

- 推論の不確実性: AIは常に100%正確な回答を保証できるわけではありません。曖昧な指示や複雑な質問に対して、自信のない部分を補完するために架空の情報を生成することがあります。

- モデルの複雑性: 大規模な言語モデル(LLM)は内部構造が非常に複雑であり、人間がその動作を完全に理解・制御することは困難です。結果として、意図しないハルシネーションが発生しやすくなります。

このハルシネーションは、ビジネスにおいて以下のような具体的な影響をもたらします。

- 顧客対応の質の低下: AIチャットボットが誤った製品情報やサービス内容を顧客に提供し、不満や混乱を招きます。

- 営業・マーケティング活動の信頼性低下: AIが生成した市場調査レポートや競合分析資料に誤ったデータが含まれることで、戦略立案の根拠が揺らぎ、企業の信頼性が損なわれる可能性があります。

- 社内業務プロセスの非効率化: AIが作成した要約資料や議事録に事実誤認が含まれる場合、その後の確認作業や修正に余計な時間とコストがかかります。

このようなAIの「幻覚」がもたらすリスクは無視できません。実際、ガートナーの予測では、2027年までに企業の25%がハルシネーション関連のビジネスリスクに直面する可能性があると指摘されています(出典:Gartner)。

誤情報が引き起こす具体的な業務上の損害とコスト

社内AIが生成する誤情報は、多岐にわたる業務プロセスにおいて具体的な損害とコストを引き起こします。AIの回答が「それっぽい」だけに、人間が見過ごしやすく、気づかないうちに問題が深刻化するケースも少なくありません。

具体的な業務シナリオにおける損害とコストの例を挙げます。

マーケティング部門:

- AIが競合分析レポートで誤った市場規模や競合製品の優位性を提示した場合、貴社は間違ったターゲット設定や広告戦略を立案してしまう可能性があります。これにより、広告費の無駄遣いや機会損失が発生します。

- AIが生成したブログ記事やSNS投稿に誤った情報が含まれると、公開後に訂正作業が必要となり、担当者の工数が増加します。また、誤情報が拡散されれば、企業の信頼性にも影響します。

営業部門:

- AIが作成した顧客向け提案書に、製品の誤った仕様、価格、納期などが記載されていた場合、顧客からのクレームにつながり、商談の破談や失注のリスクが高まります。

- 誤情報に基づく契約締結は、後々のトラブルや契約解除による違約金発生の原因にもなり得ます。

法務・コンプライアンス部門:

- AIが参照した判例や法規に誤りがあったり、最新の情報が反映されていなかったりすると、誤った法的アドバイスを提供してしまう可能性があります。これは、訴訟リスクの増大やコンプライアンス違反に直結します。

開発部門:

- AIが生成したコードに潜在的なバグやセキュリティ脆弱性が含まれていた場合、システム障害やデータ漏洩といった重大なインシデントにつながる可能性があります。修正には多大な時間とコストがかかり、ビジネス機会の損失にもつながります。

これらの誤情報が引き起こす具体的な損害とコストを以下の表にまとめました。

| リスクの種類 | 具体的な損害 | 発生しうるコスト |

|---|---|---|

| 時間的コスト | 誤情報の発見と修正、再確認、再作成にかかる時間 | 人件費の増加、プロジェクト遅延、機会損失 |

| 金銭的コスト | 誤った意思決定による投資失敗、契約解除の違約金、訴訟費用、広告費の無駄遣い | 直接的な損失、罰金、賠償金、回収不能な費用 |

| 信頼・ブランド毀損 | 顧客、取引先、従業員からの信頼失墜、ブランドイメージの低下 | 顧客離反、売上減少、採用活動への悪影響 |

| 法的・規制リスク | 個人情報保護法違反、著作権侵害、コンプライアンス違反 | 罰則、訴訟、企業イメージの悪化 |

| 業務効率の低下 | AIへの不信感による手動確認の増加、二度手間 | 従業員のモチベーション低下、生産性の悪化 |

意思決定の誤り、ブランドイメージの毀損、法規制・倫理リスク

社内AIの「それっぽい回答」は、単なる業務上のミスにとどまらず、貴社の経営判断、ブランド価値、さらには法的・倫理的責任にまで影響を及ぼす可能性があります。

意思決定の誤り

AIが生成するもっともらしい情報に依存しすぎると、経営層や現場のリーダーが誤った意思決定を下すリスクが高まります。例えば、AIがハルシネーションを起こして生成した市場分析レポートを基に、新規事業への巨額な投資を決定してしまい、結果的に事業が失敗に終わるケースも考えられます。このような誤った判断は、企業の財務状況に深刻な打撃を与え、株主からの信頼を失うことにもつながりかねません。

ブランドイメージの毀損

AIを導入した顧客対応チャットボットが不正確な情報を提供したり、不適切な表現を使用したりした場合、顧客は貴社に対して不信感を抱きます。一度失われた顧客からの信頼は、取り戻すのが非常に困難です。SNSやニュースメディアを通じて誤情報が拡散されれば、企業のブランドイメージは瞬く間に毀損され、売上の減少や新規顧客獲得の困難さといった長期的な悪影響を及ぼします。例えば、某企業のAIチャットボットが特定の問い合わせに対して誤った製品情報を繰り返し提供し、SNS上で「不正確な情報で時間だけが奪われた」といった批判が殺到した事例も報告されています(出典:ITmedia ビジネスオンライン)。

法規制・倫理リスク

AIの不適切な利用は、法規制違反や倫理的な問題を引き起こす可能性も孕んでいます。

- 個人情報保護: AIが学習データに含まれる機微な個人情報を意図せず生成したり、開示してしまったりするリスクがあります。これは、GDPR(EU一般データ保護規則)やCCPA(カリフォルニア州消費者プライバシー法)、日本の個人情報保護法といった各国の規制に違反し、多額の罰金や企業イメージの失墜につながります。

- 著作権侵害: AIが既存の著作物を参照元として明記せずに生成物に含めてしまうことで、著作権侵害の問題が発生する可能性があります。特に、マーケティングコンテンツや開発コードの生成においては、このリスクに注意が必要です。

- 差別・偏見: AIの学習データに存在する社会的な偏見が、AIの回答に反映されてしまうことがあります。例えば、採用活動でAIを活用する際に、特定の属性(性別、人種など)に対する差別的な回答を生成してしまうと、倫理的な問題だけでなく、差別禁止法などの法的問題にも発展する可能性があります。

- 説明責任: AIの判断プロセスがブラックボックス化しているため、問題が発生した際に、その原因や判断根拠を企業が明確に説明できないという「説明責任」の問題も生じます。これは、顧客や規制当局からの信頼を得る上で大きな障壁となります。

これらのリスクは、貴社がAIを導入する上で避けて通れない課題です。AIの利便性だけを追求するのではなく、その裏に潜むリスクを正確に理解し、適切な対策を講じることが極めて重要です。

「それっぽい回答」を排除するための参照ルール設計の基本原則

社内AIが「それっぽい」が故に誤った回答をしてしまう問題は、ビジネスにおける意思決定の質を低下させ、最悪の場合、企業の信頼性や法的リスクにまで発展する可能性があります。このようなリスクを回避し、AIを真に信頼できるビジネスパートナーとするためには、AIが参照する情報源とそのプロセスを厳格に管理する「参照ルール」の設計が不可欠です。

このセクションでは、AIの回答精度と信頼性を飛躍的に高めるための基本原則として、RAG(Retrieval Augmented Generation)の導入、信頼できる情報源の特定と一元化、そしてデータガバナンスと品質管理の徹底について解説します。

RAG(Retrieval Augmented Generation)の導入と重要性

生成AIが抱える大きな課題の一つに「ハルシネーション(幻覚)」があります。これは、AIが学習データに基づいて「もっともらしい」が事実とは異なる情報を生成してしまう現象です。この問題を根本的に解決し、AIの回答の正確性を高めるために注目されているのが、RAG(Retrieval Augmented Generation:検索拡張生成)の導入です。

RAGは、AIが回答を生成する前に、社内の信頼できるデータベースやドキュメントから関連情報を「検索(Retrieval)」し、その検索結果を基に「生成(Generation)」を行うフレームワークです。これにより、AIは自身の学習データだけでなく、常に最新かつ正確な社内情報を参照して回答を構築するため、ハルシネーションのリスクを大幅に低減できます。例えば、顧客サポートAIがRAGを導入することで、最新の製品マニュアルやFAQを参照し、正確なトラブルシューティングを提供できるようになります。

RAG導入の主なメリットと考慮すべき点をまとめます。

| メリット | 考慮すべき点 |

|---|---|

| 回答の信頼性向上: 最新かつ正確な社内情報に基づき回答を生成するため、ハルシネーションのリスクを大幅に低減します。 | 情報源の品質管理: 参照する情報源自体の品質が低い場合、RAGの効果も限定的になります。 |

| 情報源の明示: AIが参照した元のドキュメントやページを明示することで、ユーザーは回答の根拠を確認できます。 | 検索精度の最適化: 適切な情報を効率的に検索できるよう、検索アルゴリズムやインデックスのチューニングが必要です。 |

| 情報の鮮度維持: データベースを更新するだけでAIの知識を常に最新の状態に保てるため、再学習のコストを削減できます。 | インフラコスト: 検索システムと生成AIを連携させるためのインフラ構築・運用コストが発生します。 |

| 専門分野への対応: 特定の業界用語や社内固有の知識についても、専用のデータベースを参照することで正確に対応可能です。 | 複雑な質問への対応: 複数の情報源を横断するような複雑な質問に対して、最適な検索結果を組み合わせる難しさがあります。 |

RAGの導入は、単にAIの性能を高めるだけでなく、貴社内のナレッジマネジメントの質の向上にも寄与します。どの情報が信頼できるか、どの情報が最新かといった基準が明確になるため、結果として社内全体の情報共有文化が改善される効果も期待できます。

信頼できる情報源の特定と一元化

RAGを効果的に機能させるためには、AIが参照する「信頼できる情報源」を明確に特定し、それらを一元的に管理することが極めて重要です。情報源が多岐にわたり、それぞれが異なる部門で管理されている場合、AIが参照すべき真の情報を見失い、「それっぽい」情報に惑わされるリスクが高まります。

信頼できる情報源として考慮すべきは、以下のようなものです。

- 公式文書: 会社の規定、業務マニュアル、製品仕様書、サービス約款など。

- 実績データ: 過去の顧客対応ログ、プロジェクト報告書、契約書、財務データなど。

- 専門知識: 開発部門の技術文書、法務部門の法的見解、営業部門の成功事例集など。

- 公開情報: 貴社の公式ウェブサイト、プレスリリース、IR資料など。

これらの情報源を特定したら、次にそれらを一元的に管理する仕組みを構築します。これは、単にファイルを一か所に集めるだけでなく、各情報源の「信頼レベル」や「更新頻度」を定義し、メタデータとして付与することも含まれます。例えば、法務部門が承認した契約書テンプレートは「最高レベルの信頼性」、営業部門が作成した顧客向け提案資料は「高レベルの信頼性」といった具合です。これにより、AIは質問内容に応じて適切な信頼レベルの情報源を優先的に参照できるようになります。

情報の一元化は、AIだけでなく、従業員が情報を探す手間を省き、業務効率を向上させる効果もあります。例えば、Microsoft SharePoint、Confluence、Google Driveなどのクラウドベースのドキュメント管理システムや、専用のナレッジベースシステムを活用することで、情報へのアクセス性と管理の効率性を高めることができます。

データガバナンスと品質管理の徹底

参照ルール設計の最後の、しかし最も重要な要素は、データガバナンスと品質管理の徹底です。どんなに優れたRAGシステムを導入しても、参照するデータそのものが不正確であったり、古かったりすれば、AIの回答は信頼性を失います。

データガバナンスとは、企業内のデータ資産を適切に管理・運用するための組織的な枠組みとプロセスのことです。AIにおけるデータガバナンスは、以下の点に焦点を当てます。

- 情報更新プロセスの確立:

- 各情報源の担当部門と責任者を明確にし、情報の更新頻度や承認プロセスを定めます。例えば、製品マニュアルは新製品リリース時に必ず更新し、法務関連文書は法改正時に速やかに改訂するといったルールです。

- 当社の経験では、週次で更新される営業資料と、四半期ごとにレビューされる技術仕様書では、AIが参照する際の優先度や回答の鮮度に関する期待値が異なります。これを明確にすることで、AIはより適切な情報源を選択できるようになります。

- 情報のレビュー体制:

- AIが参照する情報は、定期的に専門家によるレビューを受け、その正確性、網羅性、最新性が保証される必要があります。誤情報や古い情報が紛れ込んでいないか、定期的に監査する仕組みを構築します。

- 参考として、IDCの調査によれば、データガバナンスが不十分な企業は、年間で売上の10%以上をデータ品質の問題で失っている可能性があると報告されています(出典:IDC)。

- アクセス権限とセキュリティ:

- 機密性の高い情報へのAIのアクセスは、厳格な権限管理のもとで行われるべきです。誰がどの情報にアクセスできるのか、AIが参照する情報の範囲をどのように制限するのかを明確にします。

- 古い情報・誤情報の排除プロセス:

- 情報が陳腐化したり、誤りが見つかったりした場合に、それを速やかにシステムから削除またはアーカイブし、AIが参照しないようにするプロセスを確立します。

- 例えば、廃止された製品のマニュアルや、過去のキャンペーン情報などは、AIの回答から除外されるべきです。

これらのデータガバナンスと品質管理の徹底は、AIの回答の正確性を担保するだけでなく、貴社全体の情報資産の価値を高めることにも繋がります。AI導入を契機に、貴社のデータ管理体制を抜本的に見直す絶好の機会と捉えることができます。

AIが「それっぽい」だけの、信頼できない回答を出力する最大の原因は、参照するデータの品質と設計にあります。AIを貴社の業務に深く組み込み、真に価値ある示唆や正確な情報を提供させるためには、社内ナレッジを「羅針盤」として機能させるための綿密なデータ準備が不可欠です。

このセクションでは、AIが参照すべき社内データをどのように準備し、活用するかについて、具体的な方法論と注意点をお伝えします。データの種類に応じたアプローチから、既存システムとの連携、そして最も重要なデータクレンジングのプロセスまで、貴社のAI導入を成功に導くための実践的な知見を提供します。

構造化データと非構造化データの適切な活用

AIが参照するデータは、大きく「構造化データ」と「非構造化データ」に分けられます。それぞれが持つ特性を理解し、適切に活用することが、AIの回答精度を高める鍵となります。

- 構造化データ: データベースやスプレッドシートのように、事前に定義された形式(行と列)で整理されたデータです。顧客情報、製品マスタ、販売履歴、会計データなどがこれにあたります。AIは構造化データから、特定の事実や数値に基づいた正確な情報を迅速に抽出できます。

- 非構造化データ: テキスト文書(契約書、議事録、メール、報告書)、PDFファイル、画像、音声、動画など、定まった形式を持たないデータです。これらのデータは情報量が膨大で、文脈やニュアンスを含みますが、そのままではAIが直接的に理解しにくいという課題があります。

AIが「それっぽい」回答ではなく、文脈に沿った深く、かつ正確な情報を提供するためには、この両方のデータをバランス良く参照させる「Retrieval-Augmented Generation (RAG)」のようなアプローチが有効です。構造化データで事実の正確性を担保しつつ、非構造化データから背景情報や詳細な説明を補完することで、より包括的で信頼性の高い回答を生成できるようになります。

非構造化データの活用においては、その膨大な情報をAIが効率的に参照できるよう、前処理が重要です。具体的には、OCR(光学文字認識)によるテキスト化、自然言語処理(NLP)を用いたキーワード抽出やカテゴリ分類、そしてベクトルデータベースへの格納などが挙げられます。これにより、AIが文脈や意味の類似性に基づいて関連情報を検索できるようになり、回答の質が飛躍的に向上します。

| データ種別 | 特徴 | AIへの貢献 | 活用例 | 前処理・技術的アプローチ |

|---|---|---|---|---|

| 構造化データ | 定型的なフォーマット(DB、スプレッドシート) 明確な項目と値 |

事実に基づく正確な情報提供 数値分析、特定情報の抽出 |

顧客情報、製品マスタ、販売実績、会計データ | データベース連携、API統合、データウェアハウス |

| 非構造化データ | 非定型なフォーマット(文書、PDF、メール、画像、音声) 文脈やニュアンスを含む |

文脈理解、詳細な説明、背景情報の補完 柔軟な情報検索 |

契約書、議事録、報告書、FAQ、顧客対応記録、製品マニュアル | OCR、自然言語処理(NLP)、埋め込み表現(Embedding)、ベクトルデータベース |

kintone連携による業務データのリアルタイム参照と活用

貴社がkintoneを導入している場合、その柔軟性とリアルタイム性をAIの参照データとして最大限に活用しない手はありません。kintoneは、部門ごとの業務アプリをノーコード・ローコードで構築できるため、顧客管理、案件進捗、日報、FAQ、申請承認フローなど、多岐にわたる業務データが日々蓄積されています。

これらのkintone上の最新データをAIが参照することで、以下のような大きなメリットが生まれます。

- リアルタイム性: 常に最新の業務データに基づいて回答を生成できるため、情報鮮度が高く、陳腐化した情報による誤回答を防げます。

- 業務特化型: 貴社固有の業務プロセスやルール、顧客情報に即したパーソナライズされた回答が可能になります。

- データの一元化: 散在しがちな業務データをkintoneに集約することで、AIが参照すべき「羅針盤」を効率的に整備できます。

具体的な活用例としては、営業部門での顧客ごとの過去の商談履歴や提案資料、対応履歴をAIが参照し、パーソナライズされた提案文の作成支援や、顧客からの問い合わせに対する迅速なFAQ応答が挙げられます。また、カスタマーサポート部門では、最新の製品情報やトラブルシューティング、顧客対応記録に基づいて、より迅速かつ的確なサポート回答を提供できます。社内ヘルプデスクにおいても、社内規定や申請フロー、IT関連のFAQなどを参照し、従業員の問い合わせに即座に対応するAIアシスタントを構築することが可能です。

技術的には、kintoneが提供するAPIを活用することで、AIシステムとのデータ連携は比較的容易に行えます。これにより、kintoneに登録されたレコードの追加・更新・削除をトリガーとしてAIモデルを再学習させたり、リアルタイムでAIがkintoneのデータを検索・参照したりする仕組みを構築できます。

| 部門 | kintone参照データ例 | AI活用メリット |

|---|---|---|

| 営業部門 | 顧客情報、案件進捗、商談履歴、提案資料、日報 | 顧客に合わせた提案文の自動生成、営業戦略の立案支援、競合分析 |

| カスタマーサポート部門 | 製品FAQ、トラブルシューティング、顧客対応履歴、製品仕様書 | 顧客からの問い合わせに対する自動応答、担当者への回答候補提示、対応履歴の要約 |

| 社内ヘルプデスク | 社内規定、申請フロー、ITヘルプ、人事関連FAQ | 従業員からの質問への即時回答、関連文書の提示、申請手続きの案内 |

| マーケティング部門 | キャンペーンデータ、顧客セグメント情報、リード情報 | パーソナライズされたコンテンツ生成、ターゲット顧客分析、市場トレンド予測 |

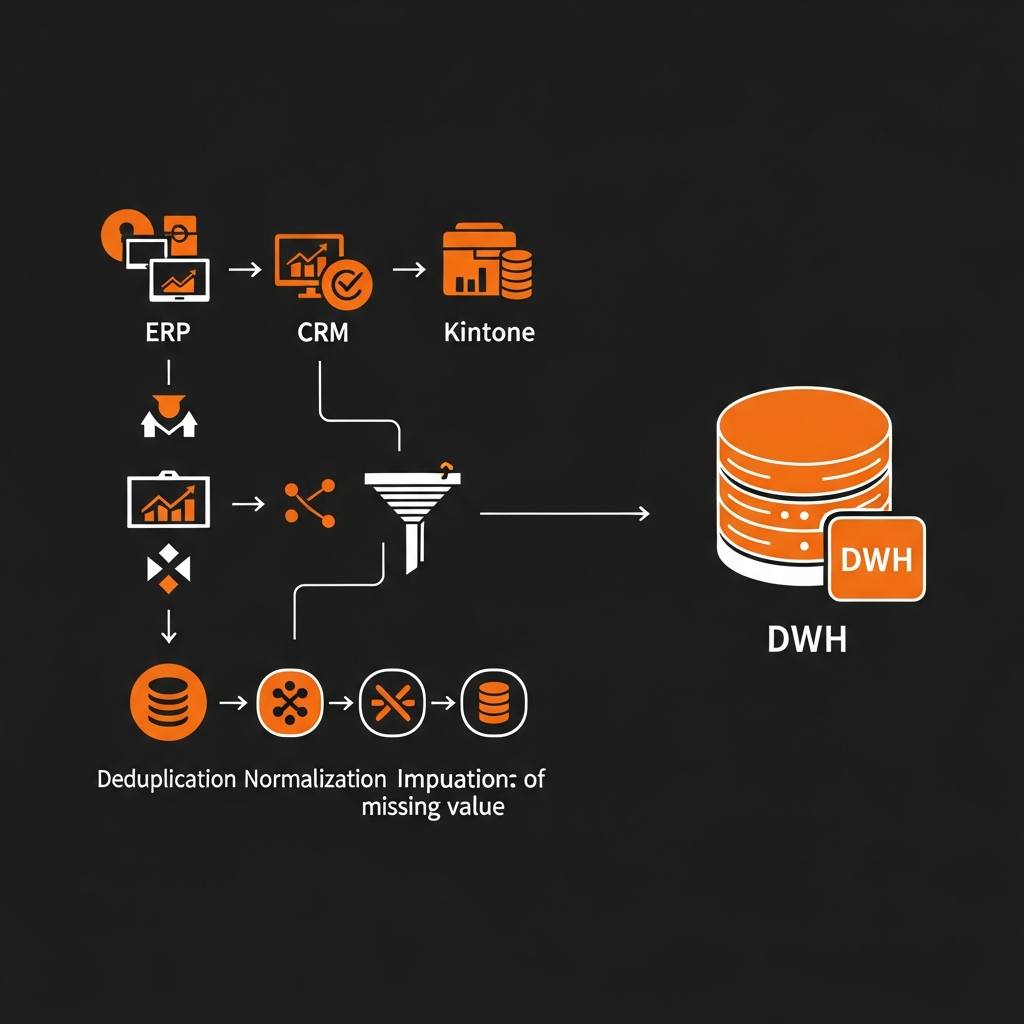

既存システム(基幹システム、CRMなど)からのデータ連携とクレンジング

貴社には、すでに様々な業務システムが存在し、膨大なデータが蓄積されているはずです。基幹システム(ERP)、CRM(顧客関係管理)、SFA(営業支援)、MA(マーケティングオートメーション)ツールなどが持つ顧客データ、販売データ、生産データは、AIにとって極めて価値の高い情報源となります。これらの既存システムからデータを適切に連携し、AIが参照可能な状態にすることは、AIの回答精度と実用性を高める上で不可欠です。

しかし、既存システムからのデータ連携には、いくつかの課題が伴います。

- データサイロ: 各システムにデータが分散し、一元的な管理や連携が困難な場合が多いです。

- データ品質: 重複データ、表記ゆれ、欠損値、古い情報など、データの品質に問題があるケースが散見されます。AIは入力されたデータの品質に大きく依存するため、不正確なデータは「それっぽい」が誤った回答につながります。

- セキュリティとプライバシー: 機密性の高い顧客情報や企業データが含まれるため、厳格なセキュリティ対策と個人情報保護への配慮が求められます。

これらの課題をクリアし、AIが信頼できる「羅針盤」として機能させるためには、データクレンジングが最も重要なプロセスの一つとなります。

データクレンジングは、単に不要なデータを削除するだけでなく、データの正確性、一貫性、完全性、鮮度を確保するための包括的な作業です。主なステップは以下の通りです。

- データ統合と一元化: 各システムからデータを抽出し、データウェアハウス(DWH)やデータレイクといった一元的な貯蔵庫に集約します。

- 重複排除: 複数のシステムに存在する同一の顧客や製品情報を識別し、統合します。

- 表記ゆれ修正: 企業名や商品名、住所などの表記を統一します。(例:「株式会社〇〇」と「(株)〇〇」を統一)

- 欠損値補完: 不足しているデータを特定し、可能な範囲で補完または適切な処理を行います。

- データ鮮度の維持: 古いデータや更新されていない情報を特定し、最新の情報に更新する仕組みを構築します。定期的な更新や自動化が必要です。

- 個人情報保護: 機密性の高いデータについては、匿名化や仮名化などの処理を施し、プライバシーリスクを低減します。

データ連携の方法としては、各システムが提供するAPIを利用したリアルタイム連携、ETL(Extract, Transform, Load)ツールを用いたバッチ処理、またはデータハブと呼ばれる中間層を設けて柔軟な連携を可能にするアプローチなどがあります。貴社のシステム構成やデータの特性に応じて最適な方法を選択することが重要です。

| データクレンジングの主要ステップ | 目的 | 具体的な作業例 | AIへの影響(クレンジングをしない場合) |

|---|---|---|---|

| データ統合と一元化 | 散在データを集約し、AIが参照しやすい状態にする | DWH/データレイク構築、各システムからのデータ抽出 | 情報の一貫性がなく、AIが異なる情報源を参照し混乱する |

| 重複排除 | 同一データの複数存在を解消し、正確性を高める | 顧客IDの統一、名寄せ処理 | 同じ顧客に対して異なる回答をしたり、不正確な集計を行う |

| 表記ゆれ修正 | データの記述形式を統一し、認識精度を高める | 会社名、商品名、住所などの正規化 | 異なる表記を別物と認識し、情報検索漏れや誤った関連付けが生じる |

| 欠損値補完 | 不足データを適切に処理し、情報完全性を確保する | 平均値・中央値での補完、関連データからの推定、欠損データの除外 | 不完全な情報に基づいて回答し、ユーザーに誤解を与える |

| データ鮮度の維持 | 最新の情報を常に提供し、陳腐化を防ぐ | 定期的な自動更新、タイムスタンプによる管理 | 古い情報に基づいて回答し、ユーザーに不利益をもたらす |

| 個人情報保護 | 機密データの安全性を確保し、法的リスクを回避する | 匿名化、仮名化、アクセス制御 | 個人情報漏洩のリスク、コンプライアンス違反 |

データクレンジングは時間とコストがかかる作業ですが、AIの信頼性と実用性を確保するためには決して避けて通れないプロセスです。質の高い参照データこそが、AIが貴社の強力な「羅針盤」として機能するための基盤となるのです。

プロンプトエンジニアリングによる「参照強制」テクニック

社内AIの導入において、最も懸念されるリスクの一つが「ハルシネーション」、つまりAIが事実に基づかない情報をあたかも真実のように生成してしまう現象です。特に機密性の高い社内情報を取り扱う場合、このリスクは貴社の業務に甚大な影響を及ぼしかねません。この課題を克服し、AIが「それっぽい」回答ではなく、信頼できる情報源に基づいた正確な回答を生成するように導くのが、プロンプトエンジニアリングにおける「参照強制」のテクニックです。

このセクションでは、AIが参照すべき情報源を明確にし、その根拠を回答に含めるよう促す具体的なプロンプト設計手法について、実践的なアプローチをご紹介します。

参照元を明記させるプロンプト設計の具体例

AIが参照すべきドキュメントやデータセットを明確に指定し、その情報を基に回答を生成させ、さらに参照元を明記させることは、ハルシネーション対策の基本です。特に、RAG(Retrieval-Augmented Generation)のような技術と組み合わせることで、AIは指定された社内ナレッジベースから関連情報を検索し、その内容を要約・加工して回答を生成する能力を格段に向上させます。

貴社がAIに「参照強制」を課すために、以下のプロンプト設計を参考にしてください。

- 情報源の明示と優先順位付け:

- 「以下の情報を参考にしてください:[ドキュメントA]、[ドキュメントB]、[社内データベースC]。特に[ドキュメントA]の内容を優先してください。」

- 「回答は、添付された『2023年度営業マニュアル』および『最新の顧客対応ガイドライン』のみを参照し、それ以外の情報源は使用しないでください。」

- 参照元の明記義務化:

- 「回答の各項目について、参照したドキュメント名とその該当ページ番号、またはデータベースのレコードIDを必ず括弧書きで追記してください。」

- 「回答の最後に、参照したすべての情報源のリスト(ドキュメント名、版数、最終更新日など)をまとめて記載してください。」

- 不確実性の表明:

- 「指定された情報源に該当する情報がない場合、その旨を明確に述べ、『情報なし』と回答してください。推測で回答することは避けてください。」

- 「情報が不完全な場合や複数の解釈が可能な場合は、その不確実性を指摘し、考えられる選択肢を提示してください。」

これらのプロンプトを組み合わせることで、AIは指定された情報源の範囲内で回答を生成し、その根拠を明確に示すようになります。これにより、ユーザーはAIの回答がどの情報に基づいているのかを一目で確認でき、信頼性を評価することが可能になります。

回答の根拠を求めるプロンプトの工夫と効果

AIが単に回答を提示するだけでなく、その回答に至った「思考プロセス」や「論理的な根拠」を説明させることは、回答の信頼性を飛躍的に向上させ、ハルシネーションの検知にも繋がります。これは「思考の連鎖(Chain of Thought)」と呼ばれるテクニックの応用であり、AIにステップバイステップで考えさせることで、内部的な整合性を高める効果があります。

以下に、回答の根拠を求めるプロンプトの工夫とその効果をまとめました。

| プロンプトの工夫 | 具体的なプロンプト例 | 期待される効果 |

|---|---|---|

| 思考プロセスの明示要求 | 「結論に至るまでの思考プロセスを、箇条書きでステップごとに詳細に記述してください。」 「まず、問題の定義を行い、次に主要な論点を抽出し、その上で結論を導き出してください。」 |

AIが回答を導く過程を可視化し、論理の飛躍や誤りの有無をユーザーが確認しやすくなります。 |

| 根拠の具体化要求 | 「提示する各主張について、なぜそう言えるのか、具体的なデータや事実、参照した文書の記述を引用して説明してください。」 「この施策が成功すると判断した根拠となる過去の成功事例や市場調査結果を提示してください。」 |

回答の信頼性が向上し、ユーザーは提示された根拠に基づいて回答の妥当性を評価できます。ハルシネーションの発生時に、根拠の欠如から異常を検知しやすくなります。 |

| 反証可能性の検討要求 | 「提示した回答に対する反論や、異なる視点からの解釈はありますか?もしあれば、その可能性も簡潔に述べてください。」 「この提案の潜在的なリスクや、考慮すべき課題点についても言及してください。」 |

AIが多角的に情報を評価し、よりバランスの取れた、網羅的な回答を生成するよう促します。クリティカルシンキングの要素をAIに付与できます。 |

| 根拠と結論の分離 | 「まず根拠となる情報を提示し、その後にその情報から導かれる結論を明確に述べてください。」 「事実と意見を明確に区別して記述してください。」 |

ユーザーが事実に基づいた客観的な情報と、そこから導かれる解釈や提案を区別して理解しやすくなります。 |

これらの工夫により、AIは単に情報を出力するだけでなく、その情報の背後にある論理や根拠を深掘りするようになります。これは、特に経営層が意思決定を行う際のインサイト提供において、非常に有効なアプローチです。

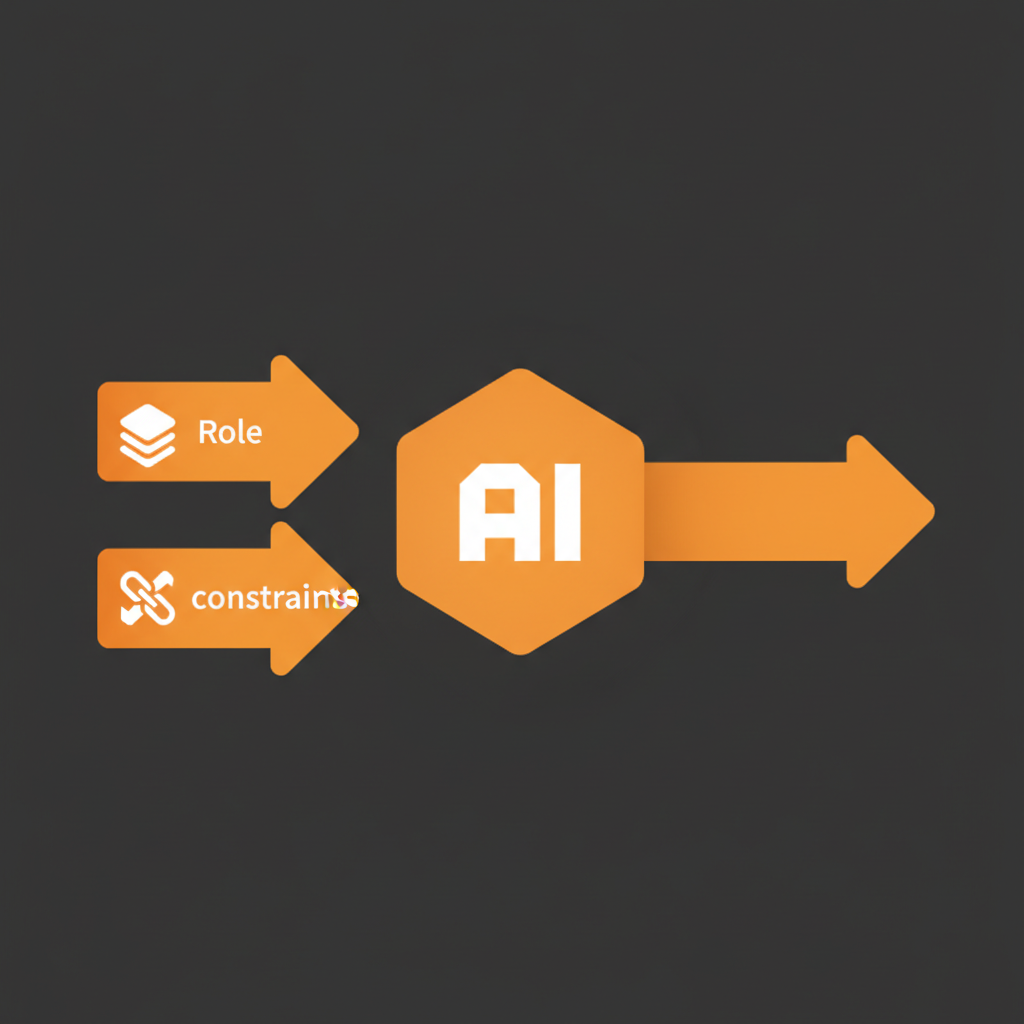

役割付与と制約条件の設定による回答精度の向上

プロンプトエンジニアリングでは、AIに特定の「役割」を与えることで、回答のトーン、スタイル、専門性を制御し、さらに「制約条件」を設けることで、回答の形式や内容を厳密に管理することが可能です。これにより、AIは「それっぽい」一般的な回答ではなく、貴社のビジネス文脈に最適化された、より精度の高い専門的な回答を生成するようになります。

- 役割付与の具体例:

- 「あなたは当社のベテラン営業担当者です。顧客の課題を深く理解し、当社の製品・サービスがどのように解決に貢献できるかを、具体的な成功事例を交えて説明してください。」

- 「あなたは法務部の専門家です。提示された契約書の条項について、リスクを最小限に抑えるための修正案と、その法的根拠を明確に示してください。」

- 「あなたはマーケティングアナリストです。最新の市場トレンドと競合他社の動向を踏まえ、当社の新製品プロモーション戦略についてデータに基づいた提言を行ってください。」

- 制約条件の具体例:

- 形式の指定:「回答は箇条書きで、各項目は200字以内に要約してください。」「回答はHTML形式で、主要な見出しはh3タグを使用してください。」

- 語彙・表現の制限:「専門用語は避け、一般のビジネスパーソンにも理解しやすい言葉で説明してください。」「ポジティブな表現を心がけ、否定的な言葉遣いは避けてください。」

- 情報の範囲制限:「2022年以前の情報は参照しないでください。」「競合他社の具体的な企業名は挙げないでください。」

- 禁止事項の明示:「個人的な意見や推測は一切述べないでください。」「機密情報に触れる可能性のある内容は絶対に含めないでください。」

これらの役割付与と制約条件を組み合わせることで、AIは単なる情報検索エンジンではなく、まるで貴社の社内専門家の一員であるかのように振る舞い、貴社の業務に深く貢献する高精度な回答を生成できるようになります。

私たちAurant Technologiesは、貴社のビジネスプロセスとナレッジベースを深く理解し、最適なプロンプト設計を通じて社内AIの真の価値を引き出すご支援をいたします。単なる技術導入に留まらず、貴社の業務効率化と意思決定の高度化に貢献するAI活用を共に実現しましょう。

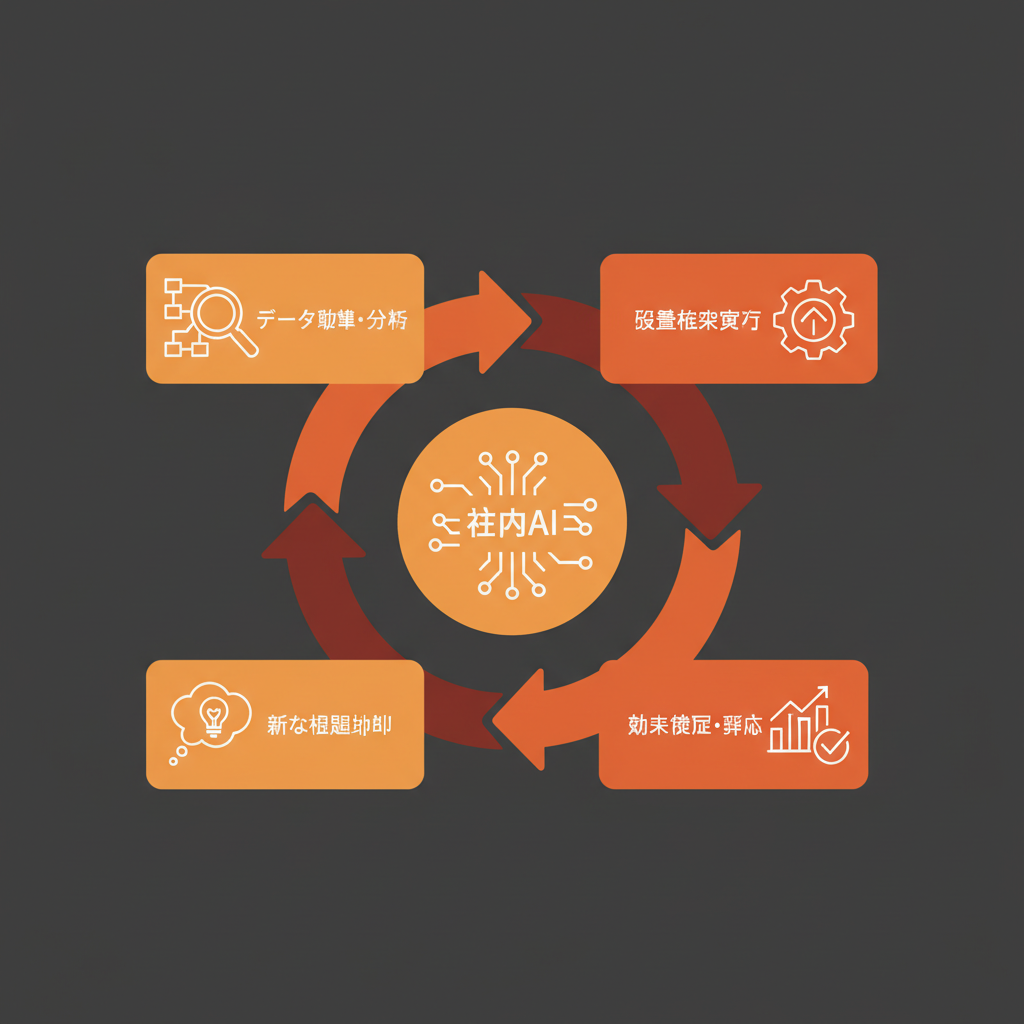

AIの回答精度を高める評価と継続的改善サイクル

社内AIの導入は、業務効率化や意思決定の迅速化に大きな可能性をもたらします。しかし、AIモデルは一度導入すれば終わりではありません。特に「それっぽい回答」ではなく、正確で実用的な回答を継続的に提供するためには、その精度を定期的に評価し、改善し続けるサイクルが不可欠です。

AIモデルは、学習データや利用環境の変化、あるいは新たな情報源の追加によって、時間の経過とともにパフォーマンスが低下する可能性があります。これを「モデルドリフト」と呼びます。このドリフトを防ぎ、AIが常に最適な状態で機能するよう、継続的な評価と改善の仕組みを貴社内に構築することが、AI活用成功の鍵となります。

評価指標(精度、網羅性、関連性など)の設定とモニタリング

AIの回答精度を客観的に評価するためには、明確な指標を設定し、継続的にモニタリングすることが不可欠です。漠然と「回答が良くなった」と感じるだけでは、具体的な改善策を講じることはできません。

主要な評価指標

貴社のAIシステムに合わせた評価指標を選定し、その定義と測定方法を明確にすることが重要です。一般的に、以下の指標が用いられます。

- 回答精度(Accuracy):生成された回答が、事実に基づき、かつ正確であるかを示す指標です。例えば、社内規定に関する質問に対して、正しい情報源から正しい内容を引用しているかなどです。

- 網羅性(Completeness):質問に対する回答が、必要な情報をすべて含んでいるかを示す指標です。回答が正確であっても、情報が不十分であれば、ユーザーは追加の質問を強いられます。

- 関連性(Relevance):生成された回答が、ユーザーの質問の意図と合致しているかを示す指標です。質問とは異なるトピックや不要な情報が含まれていないかを確認します。

- 一貫性(Consistency):同様の質問に対して、常に一貫した回答が生成されるかを示す指標です。特に、参照ルールが頻繁に更新される環境では重要です。

- 安全性(Safety):不適切、差別的、誤解を招く、あるいは機密情報を漏洩する可能性のある回答が生成されていないかを確認します。

- 回答速度(Latency):質問から回答が生成されるまでの時間です。ユーザー体験に直結するため、特にリアルタイム性が求められるシステムでは重要な指標です。

- ユーザー満足度(User Satisfaction):AIの回答に対するユーザーの満足度を直接的に測定する指標です。回答に対する評価ボタンやアンケートを通じて収集します。

モニタリングと閾値の設定

これらの指標は、定期的に(例えば週次や月次で)モニタリングし、パフォーマンスの変動を追跡します。各指標に対して、許容できる最低限のパフォーマンスを示す閾値(しきいち)を設定し、それを下回った場合にはアラートを発する仕組みを構築すると良いでしょう。例えば、「回答精度が90%を下回ったら要確認」といったルールです。

モニタリングには、AIプラットフォームが提供するダッシュボード機能や、カスタムで構築したログ解析ツールなどを活用します。特に、回答ログとユーザーフィードバックを紐付けて分析することで、具体的な改善点を発見しやすくなります。

| 評価指標 | 定義 | 測定方法の例 | 推奨される閾値(目安) |

|---|---|---|---|

| 回答精度 | 生成された回答が、事実に基づき正確であるか | 人間による手動評価(正誤判定)、参照元との一致度(自動評価) | 90%以上 |

| 網羅性 | 質問に対する必要な情報をすべて含んでいるか | 人間による手動評価(情報欠落の有無)、関連情報源からのカバー率 | 85%以上 |

| 関連性 | 回答が質問の意図と合致し、不要な情報がないか | 人間による手動評価(質問とのズレ)、キーワードマッチング率 | 90%以上 |

| 一貫性 | 同様の質問に対し、常に一貫した回答が生成されるか | 同一質問を複数回実行し、回答の一致度を評価 | 95%以上 |

| 安全性 | 不適切、差別的、機密情報漏洩などのリスクがないか | コンテンツフィルタリングツールの適用、人間によるレビュー | 0件(リスク回答) |

| 回答速度 | 質問から回答生成までの時間 | システムログからの平均応答時間 | 3秒以内(対話型の場合) |

| ユーザー満足度 | AIの回答に対するユーザーの満足度 | 回答に対する「いいね/わるいね」評価、アンケート | 「いいね」率80%以上 |

フィードバックループの構築と運用体制

AIの回答精度を向上させるためには、ユーザーからの直接的なフィードバックを収集し、それを改善プロセスに組み込む「フィードバックループ」の構築が不可欠です。どれだけ精緻な評価指標を設定しても、実際のユーザー体験から得られる生の声には及びません。

フィードバックチャネルの設計

ユーザーがAIの回答に対して簡単にフィードバックできる仕組みを複数用意することが重要です。

- 回答に対する評価ボタン:最もシンプルで導入しやすい方法です。例えば、「この回答は役に立ちましたか?(はい/いいえ)」や、星評価、👍/👎ボタンなどです。

- コメント/テキスト入力欄:評価ボタンだけでは捉えきれない、具体的な改善点や不満点をユーザーが自由に記述できる場所を提供します。

- 専用の問い合わせフォーム:より複雑な問題や、詳細な情報が必要な場合に利用できるチャネルです。

- 専門チームによるレビュー:AIの回答ログを定期的に確認し、問題のある回答や改善の余地がある回答を特定する専門チームを設けます。

フィードバックの収集、分類、優先順位付け

収集したフィードバックは、ただ集めるだけでなく、効率的に分類し、改善の優先順位を付ける必要があります。例えば、以下のような分類が考えられます。

- 誤情報/不正確な回答:最優先で対処すべき項目です。

- 情報不足/網羅性不足:回答に情報が足りないケースです。

- 関連性不足/質問の意図とのズレ:質問への理解が不十分なケースです。

- 表現の問題(不自然、不明瞭など):回答の質を高めるための改善点です。

- 安全性/倫理的な問題:即座に対処が必要です。

これらのフィードバックを基に、AIモデルの改善、参照ルールの見直し、プロンプトの調整など、具体的なアクションを決定します。

運用体制の確立

フィードバックループを継続的に運用するためには、明確な役割分担と責任体制が必要です。典型的な運用体制は以下の通りです。

- AI運用チーム:フィードバックの収集、分類、初期分析を行います。

- データサイエンティスト/AIエンジニア:フィードバックを基に、モデルの再学習やファインチューニング、プロンプトの最適化などを実施します。

- 業務部門担当者:AIが回答する業務領域の専門家として、回答の正確性や網羅性を評価し、参照ルールの内容を最新に保つ責任を負います。

- プロジェクトマネージャー:全体の進捗管理、リソース配分、関係者間の調整を行います。

また、フィードバックに対するSLA(Service Level Agreement)を設定し、例えば「誤情報に関するフィードバックは24時間以内に分析し、72時間以内に改善計画を策定する」といった具体的な目標を設けることで、迅速な対応を促すことができます。

ファインチューニングと再学習によるAIモデルの最適化

収集されたフィードバックやモニタリング結果に基づき、AIモデルそのものや、その回答生成プロセスを継続的に最適化していくことが、長期的なAI活用の成功には不可欠です。主な最適化手法として、ファインチューニングと再学習があります。

ファインチューニング(Fine-tuning)

ファインチューニングとは、あらかじめ大量の汎用データで学習された大規模言語モデル(LLM)を、貴社独自の特定のタスクやデータセットに合わせて微調整するプロセスです。これにより、モデルは貴社の業務固有の専門用語、文脈、回答スタイルを習得し、より的確な回答を生成できるようになります。

例えば、特定の業界の専門用語や社内の略語、製品コードなど、一般的なLLMでは学習しきれない情報を、ファインチューニングによってモデルに覚え込ませることができます。これは、参照ルールで外部知識を与える「RAG(Retrieval-Augmented Generation)」と組み合わせることで、さらに強力な効果を発揮します。

- ファインチューニングのメリット:

- 特定の業務やドメインに特化した高い精度を実現できます。

- モデルのハルシネーション(嘘の生成)を抑制できます。

- 独自の回答スタイルやトーンを確立できます。

- ファインチューニングの課題:

- 高品質な学習データ(貴社内の過去のQ&Aログ、専門文書など)の準備が必要です。

- 一度行ったファインチューニングの効果は、時間の経過とともに薄れる可能性があるため、定期的な更新が必要です。

再学習(Retraining)とデータセットの品質管理

ファインチューニングが既存モデルの微調整であるのに対し、再学習は、モデルをゼロから、あるいは大幅に更新されたデータセットで学習し直すことを指します。これは、モデルの基盤となる知識や構造自体を大きく変更する必要がある場合や、環境が大きく変化した場合に検討されます。

どちらの場合も、学習に用いるデータセットの品質が極めて重要です。不正確なデータ、古いデータ、偏ったデータを学習させると、AIの回答精度はかえって悪化します。フィードバックループを通じて収集された「誤った回答」や「改善された回答」のデータは、次回のファインチューニングや再学習のための貴重な教師データとなります。

- データセットの準備と品質管理のポイント:

- データのクレンジング:ノイズ、重複、不整合なデータを排除します。

- アノテーション(タグ付け):質問と回答のペア、参照元の明記など、モデルが学習しやすい形式にデータを加工します。

- 最新性の維持:常に最新の情報が学習データに含まれるように、データソースを定期的に更新します。

- 多様性の確保:様々な質問パターンや回答形式を含むことで、モデルの汎用性を高めます。

モデルのバージョン管理とA/Bテスト

最適化されたAIモデルを導入する際は、いきなり全面展開するのではなく、バージョン管理を徹底し、旧モデルとの比較検証を行うことが推奨されます。A/Bテストを実施し、一部のユーザーグループに新モデルを適用し、パフォーマンス指標(回答精度、ユーザー満足度など)を比較することで、新モデルの効果を客観的に評価します。

このプロセスを通じて、期待通りの改善が見られない場合は、さらにモデルやプロンプト、参照ルールを調整し、再度テストを行うといった反復的なアプローチが重要です。

RAG(Retrieval-Augmented Generation)強化とプロンプトエンジニアリングの改善

参照ルールに基づいた回答生成(RAG)を導入している場合、ファインチューニングと並行して以下の点の最適化も継続的に行います。

- 外部知識ソースの質向上:参照する社内文書の最新性、正確性、構造化を常に保ちます。不要な情報や古い情報は削除し、関連性の高い情報源を優先的に参照できるようにします。

- チャンク分割の最適化:文書をAIが理解しやすい「チャンク(断片)」に分割する方法を調整します。文脈が失われない範囲で適切なチャンクサイズを見つけることが重要です。

- 埋め込みモデルの選択と更新:テキストを数値ベクトルに変換する埋め込みモデルの性能も、RAGの検索精度に大きく影響します。より高性能なモデルへの更新や、貴社データでファインチューニングされた埋め込みモデルの導入も検討します。

- プロンプトエンジニアリングの改善:AIへの指示文(プロンプト)の設計も、継続的な改善の対象です。より明確で具体的な指示、役割設定、出力形式の指定など、プロンプトの微調整によって回答精度や形式を最適化します。成功したプロンプトはテンプレート化し、チーム内で共有することで、一貫した高品質な回答生成を促します。

これらの継続的な評価、フィードバック、最適化のサイクルを通じて、貴社の社内AIは「それっぽい回答」から脱却し、真に業務に貢献する強力なツールへと進化していくでしょう。

安全な社内AI運用を支える倫理・セキュリティ・従業員教育

社内AIの導入は、業務効率化や生産性向上に大きな期待を寄せられる一方で、適切な管理と運用がなされなければ、情報漏洩や倫理的な問題、従業員の混乱を招くリスクも孕んでいます。特に、機密情報を取り扱うBtoB企業においては、セキュリティ対策、倫理ガイドラインの策定、そして従業員のリテラシー向上が不可欠です。ここでは、安全かつ効果的な社内AI運用を実現するための重要な柱について解説します。

情報漏洩リスクとセキュリティ対策の徹底

社内AI、特に生成AIを利用する上で最も懸念されるのが情報漏洩のリスクです。従業員が意図せず、あるいは誤って機密情報や個人情報、顧客データをAIに入力してしまうことで、それらの情報がAIモデルの学習データとして利用されたり、外部に流出したりする可能性があります。

例えば、ある調査では、企業の約60%がAI利用における情報漏洩リスクを重大な課題と認識していることが報告されています(出典:日本情報システム・ユーザー協会(JUAS)「企業IT動向調査2023」)。このリスクを最小限に抑えるためには、以下のセキュリティ対策を徹底する必要があります。

- 入力データの匿名化・非識別化の徹底: AIに入力するデータから、個人を特定できる情報(PII: Personally Identifiable Information)や企業秘密に該当する情報を事前に削除、マスキング、あるいは抽象化するプロセスを義務付けます。専用の匿名化ツールやデータクレンジングツールを導入することも有効です。

- データガバナンスとアクセス制御: AIが利用するデータに対する厳格なアクセス制御を設け、権限を持つ従業員のみが特定のデータにアクセスできるようにします。また、AIの利用履歴や入力・出力ログを詳細に記録し、不審な挙動がないか定期的に監視する体制を構築します。

- セキュリティ機能の活用:

- データ分離(サンドボックス環境): AI環境を他のシステムから隔離し、万が一の事態でも被害が拡大しないようにします。

- 暗号化: AIが処理するデータ、保管されるデータ、ネットワークを介して転送されるデータをすべて暗号化し、傍受や不正アクセスから保護します。

- 脆弱性診断とマルウェア対策: AIシステム自体や関連インフラに対して定期的な脆弱性診断を実施し、最新のマルウェア対策ソフトウェアを導入します。

- 利用規約とデータレジデンシーの確認: 外部のAIサービスを利用する場合、そのサービス提供者の利用規約を詳細に確認し、入力データがAIモデルの学習に利用されないこと、データの保管場所(データレジデンシー)が明確であることなどを確認します。特に、欧州のGDPRや日本の個人情報保護法など、各国の法規制に準拠しているかを確認することが重要です。

これらの対策は、単にツールを導入するだけでなく、組織全体でセキュリティ意識を高め、継続的に運用・改善していくことが求められます。

以下に、社内AI導入時に考慮すべきセキュリティ対策のチェックリストを示します。

| 項目 | 詳細 | チェックポイント |

|---|---|---|

| データ匿名化・非識別化 | 機密情報や個人情報をAI入力前に自動または手動で処理 |

✔ PII(個人識別情報)のマスキング・削除ルールを確立しているか? ✔ 特定の機密情報(顧客リスト、製品設計図など)の入力禁止ルールを設けているか? |

| アクセス制御とログ監視 | AIシステムへのアクセス権限を最小限に制限し、利用状況を記録 |

✔ ロールベースのアクセス制御(RBAC)を導入しているか? ✔ AIの入力・出力履歴、利用ユーザー、日時を記録・監査しているか? |

| データ暗号化 | 保管データ、転送データの暗号化 |

✔ AIが利用する全てのデータが保管時・転送時に暗号化されているか? |

| ベンダー選定と契約確認 | 外部AIサービス利用時のベンダーのセキュリティレベルと契約内容確認 |

✔ ベンダーがISO 27001などのセキュリティ認証を取得しているか? ✔ 契約書で入力データが学習に利用されない旨が明記されているか? ✔ データレジデンシー(データ保管場所)が明確で、貴社のポリシーに合致しているか? |

| 従業員教育とポリシー | 情報セキュリティポリシーとAI利用ガイドラインの周知徹底 |

✔ 全従業員に対し、AI利用時の情報セキュリティ教育を実施しているか? ✔ AI利用に関する具体的なガイドラインや罰則規定を設けているか? |

AI倫理ガイドラインの策定と遵守

技術的なセキュリティ対策に加えて、組織としてのAI利用に関する倫理観を明確にし、ガイドラインとして策定することが不可欠です。AI倫理は、AIが社会や人間に与える影響を考慮し、公平性、透明性、説明責任、プライバシー保護などの原則に基づいてAIを開発・利用するための指針となります。経済産業省や総務省もAIに関するガイドラインを公開しており、これらを参考に貴社独自の指針を定めることが推奨されます(出典:経済産業省「AI社会原則」、総務省「AIネットワーク社会推進会議」)。

AI倫理ガイドラインに含めるべき主な項目は以下の通りです。

- 利用目的の明確化: どのような目的でAIを利用し、どのような価値創造を目指すのかを明確にします。

- データ利用の原則: どのようなデータを、どのような範囲でAIに利用させるかを定めます。不適切なデータ利用はバイアスや差別につながるため、慎重な検討が必要です。

- 公平性とバイアス対策: AIの学習データに含まれる偏り(バイアス)が、出力結果に不公平な影響を与えないよう、定期的な監査やデータ補正のプロセスを義務付けます。例えば、採用活動におけるAI利用では、性別や人種、年齢などによる差別が発生しないよう、細心の注意を払う必要があります。

- 透明性と説明責任: AIによる意思決定プロセスやその根拠を、可能な限り人間が理解できる形で説明できるメカニズムを構築します。AIの「ブラックボックス化」を防ぎ、問題発生時に責任の所在を明確にするためです。

- 人による監督(Human-in-the-Loop): AIの最終的な判断や重要な意思決定においては、必ず人間が関与し、最終的な責任を負うという原則を確立します。特に、顧客対応や契約関連の業務では、AIの提案を鵜呑みにせず、人間のチェックを必須とすべきです。

- 知的財産権の尊重: AIが生成したコンテンツが既存の著作物や知的財産権を侵害しないよう、利用ルールを定めます。また、AI生成物の著作権の取り扱いについても、社内での方針を明確にします。

- プライバシー保護: 個人情報や機密情報の取り扱いについて、関連法規(個人情報保護法など)を遵守し、AI利用においても厳格なプライバシー保護策を講じます。

これらのガイドラインは、一度策定したら終わりではなく、AI技術の進化や社会情勢の変化に合わせて定期的に見直し、更新していく柔軟な姿勢が求められます。

従業員へのAIリテラシー教育と活用促進

どんなに優れたAIシステムや厳格なガイドラインがあっても、それらを活用する従業員のリテラシーが不足していれば、効果的な運用は望めません。従業員一人ひとりがAIの特性を理解し、安全かつ適切に使いこなせるようになるための教育と、積極的な活用を促す文化づくりが重要です。

AIリテラシー教育の目的は、単にAIツールの操作方法を教えるだけでなく、AIが「何ができるのか」「何が苦手なのか」「どのようなリスクがあるのか」を深く理解させ、批判的思考力を持ってAIと協働できる人材を育成することにあります。

具体的な教育内容としては、以下の要素を含めるべきです。

- AIの基礎知識: 生成AIの仕組み、得意なタスク(要約、アイデア出し、翻訳など)、苦手なタスク(事実確認、複雑な論理的思考、感情理解など)を解説します。

- プロンプトエンジニアリングの基本: AIから質の高い出力を得るための効果的な指示(プロンプト)の出し方を実践的に学びます。具体例として、役割付与、制約条件の指定、具体例の提示などのテクニックを習得させます。

- リスク教育: 情報漏洩、ハルシネーション(虚偽情報の生成)、著作権侵害、バイアスといったAI利用に伴う具体的なリスクとその対策について、事例を交えて説明します。

- AI倫理ガイドラインの解説: 貴社が策定したAI倫理ガイドラインの内容を、具体的な業務シーンに落とし込んで理解を深めます。疑問点や懸念事項を議論する場を設けることも有効です。

- 活用事例の共有: 他部署や他社でのAI活用成功事例を紹介し、従業員自身の業務にAIをどのように適用できるかのヒントを提供します。

教育方法としては、eラーニング、集合研修、ワークショップ形式など、多様なアプローチを組み合わせることが効果的です。また、社内AIコミュニティを立ち上げたり、AI活用に長けた「AIチャンピオン」を育成して各部署の相談役としたりすることで、自律的な学習と活用促進を促すことができます。

従業員がAIを単なるツールとしてではなく、自身の生産性を高め、新たな価値を創造する「協働者」として捉えることができれば、社内AIの導入は貴社の競争力強化に大きく貢献するでしょう。AIリテラシーの向上は、従業員個人のキャリア形成にも寄与し、エンゲージメントの向上にもつながります。

Aurant Technologiesが提供する「信頼できる社内AI」構築支援

AIを社内業務に導入する際、最も避けなければならないのが「それっぽい、しかし不正確な回答」です。特にBtoB企業においては、顧客への信頼、法規制遵守、そして事業継続に直結するため、AIの回答には絶対的な信頼性が求められます。私たちAurant Technologiesは、この「信頼できるAI」の構築を最重要課題と捉え、貴社のビジネスに合わせた具体的なRAG(Retrieval-Augmented Generation)基盤の構築から、効果測定、そして専門分野への応用まで、多角的な支援を提供しています。

kintone連携による業務データ活用とRAG基盤構築支援

多くの企業で活用されているkintoneは、顧客情報、案件データ、日報、プロジェクト進捗など、業務に関するあらゆる情報が集約された「データの宝庫」です。しかし、これらの非構造化データや半構造化データは、従来の検索システムでは十分に活用しきれていないケースも少なくありません。

私たちは、kintoneに蓄積された貴社の貴重な業務データをAIの参照元として最適化し、RAG基盤を構築する支援を行います。RAGは、生成AIが回答を生成する際に、特定の外部知識ベース(この場合は貴社のkintoneデータ)を参照することで、情報の正確性を飛躍的に高める技術です。これにより、AIは「社内の最新かつ正確な情報」に基づいた回答を生成できるようになります。

具体的な支援内容は以下の通りです。

- データ構造の分析と最適化: kintoneアプリ内のデータをAIが効率的に参照できるよう、データ構造やフィールド設定を見直します。

- RAG基盤の設計・構築: 貴社のデータ量や利用目的に応じたRAGモデルを選定し、セキュアな環境で基盤を構築します。

- kintone API連携: kintoneとRAG基盤をシームレスに連携させ、リアルタイムで最新データをAIが参照できる仕組みを構築します。

- プロンプトエンジニアリング支援: 貴社の業務に特化したAIが最適な回答を生成できるよう、効果的なプロンプトの設計とチューニングをサポートします。

このアプローチにより、AIは単なる情報検索ツールではなく、貴社の業務知識を深く理解し、的確なアドバイスや情報提供を行う強力なアシスタントとなります。例えば、営業担当者が顧客との商談前に過去の案件履歴やクレーム対応事例を瞬時に把握したり、カスタマーサポートがFAQでは解決できない複雑な問い合わせに対して、社内ナレッジを基にした詳細な回答を提供できるようになります。

| メリット | 詳細 |

|---|---|

| 情報検索の効率化 | 社内の膨大なデータから必要な情報を瞬時に引き出し、従業員の検索時間を大幅に削減します。 |

| 回答精度の向上 | 貴社独自の業務データに基づいた回答により、「それっぽい」ではなく「正確な」情報提供が可能になります。 |

| 業務品質の均一化 | 従業員間の知識レベルに依存せず、常に高品質な情報に基づいた業務遂行を支援します。 |

| 意思決定の迅速化 | 必要な情報がすぐに手に入るため、迅速かつ根拠に基づいた意思決定を促進します。 |

| ナレッジ共有の促進 | 個人の持つ暗黙知を形式知としてAIが活用し、組織全体のナレッジとして共有・活用できます。 |

BIツールを活用したAI効果測定とデータドリブンな意思決定支援

AIを導入しただけでは、その真価を測ることはできません。導入効果を定量的に把握し、継続的な改善につなげるためには、データに基づいた効果測定が不可欠です。私たちは、BI(ビジネスインテリジェンス)ツールを活用し、AIの利用状況、回答精度、業務効率化への貢献度などを可視化する支援を行います。

AIの効果測定においては、以下のようなKPI(重要業績評価指標)を設定し、BIダッシュボードでリアルタイムにモニタリングすることが重要です。

- AI利用率: AIがどれくらいの頻度で利用されているか。

- 回答正答率: AIが生成した回答の正確性(ユーザー評価やレビューに基づく)。

- 問い合わせ削減数/率: AIによる自動応答で、人手による対応がどれだけ削減されたか。

- 業務時間短縮効果: AI活用により特定の業務にかかる時間がどれだけ短縮されたか。

- ユーザー満足度: AIの利用に対する従業員や顧客の満足度。

これらのデータをBIツール(例:Tableau, Power BI, Google Data Studioなど)で統合・分析し、直感的なダッシュボードとして可視化することで、貴社はAIの効果を客観的に評価し、改善点を発見できます。例えば、特定の質問に対するAIの回答精度が低い場合、参照データの拡充やプロンプトの調整といった具体的な改善策を講じることが可能です。これにより、AI導入が単なるコストではなく、投資対効果の高い戦略的なツールへと昇華します。

| KPI | 測定の意義 | 改善の方向性 |

|---|---|---|

| AI利用率 | AI機能の浸透度と活用度を把握します。 | 利用促進のための社内啓蒙、UI/UX改善、機能追加。 |

| 回答正答率 | AIが提供する情報の信頼性・正確性です。 | 参照データの品質向上、RAG基盤の強化、プロンプトの最適化。 |

| 問い合わせ削減数 | 人手による対応業務の効率化効果です。 | AIが対応できる範囲の拡大、自動化プロセスの改善。 |

| 業務時間短縮効果 | AIによる業務効率化の直接的な効果です。 | AI適用業務の拡大、AIの応答速度・精度向上。 |

| ユーザー満足度 | 従業員や顧客のAI体験の質です。 | AIの使いやすさ改善、回答の分かりやすさ向上、フィードバック機能強化。 |

高精度なAIが求められる医療系データ分析への応用

医療分野におけるAIの活用は、診断支援、創薬、個別化医療など多岐にわたりますが、同時に「それっぽい回答」が最も危険な結果を招く領域でもあります。人命に関わる判断において、AIの回答には極めて高い精度と信頼性、そしてその根拠の明確性が求められます。

私たちは、医療系データ分析において、厳格な参照ルールとデータガバナンスに基づいたAI構築を支援します。具体的には、電子カルテ、医療画像、ゲノムデータ、医学論文、臨床ガイドラインといった膨大な医療情報を、AIが正確に参照・解釈できるRAG基盤として整備します。この際、データの匿名化、プライバシー保護、セキュリティ対策は最優先事項として徹底します。

支援内容には、医療専門家との連携によるAIモデルの検証、専門用語辞書の構築、そして倫理的ガイドラインに基づいたAIの運用設計が含まれます。例えば、診断支援AIでは、特定の症例に対してAIが参照した根拠となる論文やガイドラインを明示することで、医師がAIの推奨を信頼し、最終的な判断を下す際の補助として活用できるようになります。これにより、医療現場での誤診リスクの低減や、治療方針決定の迅速化に貢献します。

| 要素 | 詳細 |

|---|---|

| データ品質と整合性 | 正確で最新の医療データを確保し、データ間の整合性を維持します。 |

| 参照元の明確化(RAG) | AIの回答がどの医学論文、ガイドライン、臨床データに基づいているかを常に提示します。 |

| 専門家による検証 | 医療専門家がAIの出力結果を定期的にレビューし、精度と安全性を検証します。 |

| 倫理的ガイドライン遵守 | 患者プライバシー保護、公平性、透明性に関する厳格な倫理基準をAI開発・運用に適用します。 |

| セキュリティとプライバシー | 機密性の高い医療データを保護するための強固なセキュリティ対策と匿名化処理を徹底します。 |

| 監査証跡の確保 | AIの意思決定プロセスと参照データを追跡可能な形で記録し、説明責任を確保します。 |

LINE連携によるスムーズなAI導入と社内コミュニケーションの効率化

AIを社内に導入する際、従業員が日常的に使い慣れたインターフェースで利用できることは、導入障壁を大幅に下げる上で非常に重要です。私たちは、LINE WORKSなどのビジネスチャットツールとAIを連携させ、スムーズなAI導入と社内コミュニケーションの効率化を支援します。

LINE WORKSにAIチャットボットを導入することで、従業員は普段のチャットと同じ感覚でAIに質問を投げかけ、必要な情報を瞬時に得ることができます。例えば、人事労務に関するFAQ、ITヘルプデスクへの問い合わせ、社内システムの使い方、営業資料の検索など、多岐にわたる業務でAIを活用することが可能です。これにより、従業員は情報検索にかかる時間を削減し、本来の業務に集中できるようになります。

私たちの支援は、LINE APIを活用したチャットボットの開発だけでなく、貴社の業務内容に合わせた応答ロジックの設計、ナレッジベースの構築、そして運用後の改善提案まで含みます。LINE WORKSのグループチャット機能と連携させることで、特定の部署やプロジェクトチーム内でAIを活用した情報共有や議論の活性化も期待できます。

| 活用例 | 具体的な効果 |

|---|---|

| 人事・総務FAQ | 就業規則、福利厚生、休暇申請など、従業員からの定型的な問い合わせ対応を自動化し、担当者の負担を軽減します。 |

| ITヘルプデスク | PCトラブル、システム操作方法など、一次対応をAIが担い、IT部門の対応時間を短縮し、従業員の自己解決を促進します。 |

| 社内情報検索 | 社内規定、過去の議事録、特定のプロジェクト情報などをチャットで検索でき、情報アクセスを迅速化します。 |

| 営業支援アシスタント | 製品情報、競合情報、過去の提案事例などをAIが提供し、営業担当者の準備時間を短縮し、提案力を強化します。 |

| 経費申請サポート | 経費精算ルールや申請方法に関する質問にAIが回答し、従業員の申請ミスを減らし、経理部門のチェック負担を軽減します。 |

会計DXにおけるAI活用と信頼性確保のためのコンサルティング

会計業務におけるAI活用は、経費精算の自動化、仕訳入力の効率化、不正検知など、大きなポテンシャルを秘めています。しかし、会計は数字の正確性が絶対であり、「それっぽい回答」や誤った情報が致命的な結果を招く可能性が最も高い分野の一つです。私たちは、会計DXにおけるAI活用において、信頼性確保を最優先としたコンサルティングを提供します。

私たちの支援は、単にAIを導入するだけでなく、既存の会計システムや業務プロセスとの連携を深く考慮し、AIが生成する情報の正確性を担保する仕組みを構築することに重点を置きます。具体的には、以下のような取り組みを行います。

- 参照ルールとデータ整合性の確保: AIが参照する会計データ(領収書データ、銀行取引データ、勘定科目マスターなど)の品質を確保し、厳格な参照ルールを設計します。

- 仕訳ルールの学習と検証: 過去の仕訳データからAIが学習する際、専門家による定期的な検証プロセスを組み込み、誤った学習を排除します。

- 監査証跡の確保: AIが自動生成した仕訳や分析結果について、その根拠となったデータやAIの判断プロセスを追跡できる監査証跡を確保します。

- 異常検知AIの導入: 不正取引や入力ミスをAIが早期に検知する仕組みを構築し、リスクを低減します。

- セキュリティとアクセス管理: 機密性の高い会計データを扱うため、厳重なセキュリティ対策と適切なアクセス管理を徹底します。

これにより、AIは会計業務の効率化だけでなく、信頼性の高い情報に基づいた経営判断を支援する強力なツールとなります。例えば、AIが自動で生成した月次レポートは、詳細な参照元情報とともに提示されるため、経営層は安心してその情報を意思決定に活用できます。私たちは、貴社の会計業務にAIを安全かつ効果的に組み込み、デジタルトランスフォーメーションを推進するための最適なロードマップを策定します。

| 項目 | メリット | リスク(信頼性確保の課題) | Aurant Technologiesの支援内容 |

|---|---|---|---|

| 経費精算・仕訳入力 | 入力作業の自動化、処理速度向上、ヒューマンエラー削減。 | AIによる誤った科目分類、証憑との不一致、監査証跡の不明確化。 | 参照ルール設計、学習データ検証、監査証跡機能実装、既存システム連携。 |

| 財務分析・予測 | 多角的なデータ分析、将来予測の精度向上、経営判断の迅速化。 | AIの誤った前提に基づく予測、分析根拠の不明瞭さ、バイアス。 | データ品質管理、RAG基盤による根拠提示、専門家レビュープロセス構築。 |

| 内部統制・不正検知 | 異常取引の早期発見、不正リスクの低減、監査業務の効率化。 | AIの誤検知、見逃し、検知根拠の説明不足、プライバシー侵害リスク。 | 高精度な異常検知モデル構築、検知ロジックの透明化、セキュリティ強化。 |

| レポーティング | レポート作成の自動化、リアルタイム情報提供、データ可視化。 | AIが生成したレポートの数値誤り、根拠不足、解釈の誤り。 | 参照元データの明確化、自動生成レポートの検証フロー構築、BIツール連携。 |

まとめ:社内AIを真のビジネスパートナーにするために

これまでの議論を通じて、社内AIが単なる「それっぽい回答」を生成するリスクを回避し、真にビジネスに貢献するパートナーへと昇華させるためには、精緻な参照ルール設計が不可欠であることをご理解いただけたかと思います。

AIは、適切に設計され、運用されれば、貴社の意思決定の質を高め、業務効率を劇的に改善し、競争優位性を確立する強力な武器となります。その鍵は、AIが参照する情報の信頼性と、その情報をいかに正確かつ効率的に引き出すかの仕組みにあります。

参照ルールがもたらす真の価値

参照ルールは、単にハルシネーション(AIが事実に基づかない情報を生成すること)を防ぐだけでなく、組織全体のナレッジマネジメントを強化し、従業員がより迅速かつ正確な情報に基づいて行動できる環境を構築します。これにより、以下のような具体的な効果が期待できます。

- 意思決定の迅速化と精度向上: 信頼できる情報源に基づいた回答は、経営層から現場まで、あらゆるレベルでの意思決定を加速させ、ミスのリスクを低減します。

- 業務効率の劇的改善: 従業員が情報検索に費やす時間を削減し、本来のコア業務に集中できる時間を増やします。私たちは、ある製造業A社で、営業部門の情報検索時間が平均30%削減されたケースを支援しました。

- ナレッジの属人化解消: 特定の従業員に依存していた専門知識をAIが参照可能な形式で共有することで、組織全体の知識レベルを底上げし、人材流動のリスクを軽減します。

- 顧客対応品質の向上: 顧客からの問い合わせに対し、AIが参照ルールに基づいて一貫性のある正確な情報を提供することで、顧客満足度の向上に直結します。某ITサービス企業B社では、顧客サポート部門でのAI導入により、一次解決率が15%向上したと報告されています(出典:Zendesk「CX Trends 2024」)。

これらの効果は、AIが「それっぽい回答」ではなく、「確かな情報」を基にした回答を生成できるようになることで初めて実現します。参照ルールの設計は、まさにその出発点なのです。

社内AIを真のビジネスパートナーにするための継続的な取り組み

社内AIの導入は一度きりのプロジェクトではなく、継続的な運用と改善が不可欠です。貴社のAIを真のビジネスパートナーとして育てていくためには、以下の点に継続的に取り組む必要があります。

- データガバナンスの徹底: AIが参照するデータは、常に最新で正確、かつ網羅的である必要があります。定期的なデータの更新、監査、品質チェック体制を確立し、情報鮮度を保つことが重要です。

- ユーザー教育とフィードバックループ: 従業員がAIを最大限に活用できるよう、ツールの使い方だけでなく、効果的なプロンプトの記述方法、AIの回答を検証する視点など、リテラシー教育を継続的に実施します。また、AIの回答に対するフィードバックを収集し、参照ルールの改善やデータ更新に活かすサイクルを確立することが不可欠です。

- 技術の進化への対応: AI技術は日進月歩で進化しています。最新のモデルや機能に常にアンテナを張り、貴社のビジネスに最適な形でAIをアップグレードしていく柔軟性を持つことが重要です。モデルの選定、ファインチューニング、新しい機能の検証などを定期的に行います。

- 組織文化への浸透: AIを単なるツールとしてではなく、「協働するパートナー」として受け入れる組織文化を醸成します。AI活用を推進するリーダーシップ、成功事例の共有、従業員のエンゲージメント向上施策などが効果的です。

これらの取り組みを通じて、AIは貴社の業務に深く根ざし、持続的な価値を生み出す存在へと成長していきます。社内AIをビジネスパートナーとするためのロードマップを以下に示します。

| フェーズ | 主要タスク | 成功のポイント |

|---|---|---|

| 1. 計画・現状分析 |

|

|

| 2. 設計・準備 |

|

|

| 3. 実装・検証 |

|

|

| 4. 運用・改善 |

|

|

このロードマップは、社内AIが単なるツールに終わらず、貴社の戦略的なビジネスパートナーとして成長していくための道筋を示しています。特に運用・改善フェーズは、AIの価値を最大化し、持続的な競争優位性を確立するために最も重要な段階となります。

私たちAurant Technologiesは、貴社のDX推進における強力なパートナーとして、このロードマップ全体にわたる専門的な支援を提供しています。参照ルール設計のコンサルティングから、データ準備、AIモデルの選定と導入、そして継続的な運用改善まで、貴社のビジネスに最適化されたAIソリューションの実現をサポートします。

「それっぽい回答」のリスクを乗り越え、社内AIを真のビジネスパートナーへと成長させるために、どのような課題をお持ちでしょうか。貴社の具体的な状況に合わせた最適なアプローチを共に検討し、確かな成果へと導くお手伝いをさせていただきます。ぜひ一度、お気軽にご相談ください。